LiLMaps: Learnable Implicit Language Maps

作者: Evgenii Kruzhkov, Sven Behnke

分类: cs.RO, cs.LG

发布日期: 2025-01-06 (更新: 2025-01-08)

💡 一句话要点

LiLMaps:提出可学习的隐式语言地图,增强机器人环境理解与交互

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 隐式地图 视觉语言 机器人 人机交互 大型语言模型

📋 核心要点

- 现有机器人技术趋势是利用LLM进行命令执行和人机交互,但缺乏环境地图及其语言表示。

- LiLMaps通过集成视觉-语言特征增强隐式地图构建,优化解码器并解决视角不一致问题。

- 实验证明LiLMaps的有效性,并在性能上取得了显著提升,为机器人自主操作提供支持。

📝 摘要(中文)

本文提出了一种名为LiLMaps的方法,旨在通过集成视觉-语言特征来增强增量式隐式地图构建。该方法利用大型语言模型(LLM)实现非预定义命令执行和自然人机交互。为了实现这一目标,本文(i)提出了一种用于隐式语言地图的解码器优化技术,该技术可在场景中出现新对象时使用;(ii)解决了不同视角之间视觉-语言预测不一致的问题。实验结果表明,LiLMaps能够有效提升性能。

🔬 方法详解

问题定义:现有机器人环境地图构建方法通常缺乏与语言信息的有效结合,导致机器人难以理解和利用自然语言指令进行交互。此外,当场景中出现新物体时,地图的更新和语言描述的生成也面临挑战。不同视角下视觉-语言预测的不一致性也会影响地图的准确性和可靠性。

核心思路:LiLMaps的核心思路是将视觉信息和语言信息融合到隐式地图构建过程中,从而使机器人能够更好地理解环境并执行自然语言指令。通过优化解码器,可以有效地处理新物体的出现,并生成相应的语言描述。同时,通过解决不同视角下视觉-语言预测的不一致性,可以提高地图的准确性和鲁棒性。

技术框架:LiLMaps的技术框架主要包括以下几个模块:1) 视觉特征提取模块,用于从图像中提取视觉特征;2) 语言特征提取模块,用于从文本描述中提取语言特征;3) 隐式地图构建模块,用于将视觉特征和语言特征融合到隐式地图中;4) 解码器优化模块,用于优化解码器,使其能够生成准确的语言描述;5) 视角一致性处理模块,用于解决不同视角下视觉-语言预测的不一致性。整体流程是,首先利用视觉和语言特征构建初始隐式地图,然后通过解码器优化和视角一致性处理不断更新和完善地图。

关键创新:LiLMaps的关键创新在于将视觉-语言特征集成到隐式地图构建中,并提出了相应的解码器优化技术和视角一致性处理方法。与现有方法相比,LiLMaps能够更好地理解环境并执行自然语言指令,同时具有更高的准确性和鲁棒性。

关键设计:关于解码器优化,具体方法未知,但推测可能涉及损失函数的设计,以鼓励生成与视觉信息更一致的语言描述。关于视角一致性处理,具体方法未知,但可能涉及使用transformer或者其他注意力机制来对不同视角的特征进行融合,以减少预测的不一致性。具体的网络结构和参数设置未知。

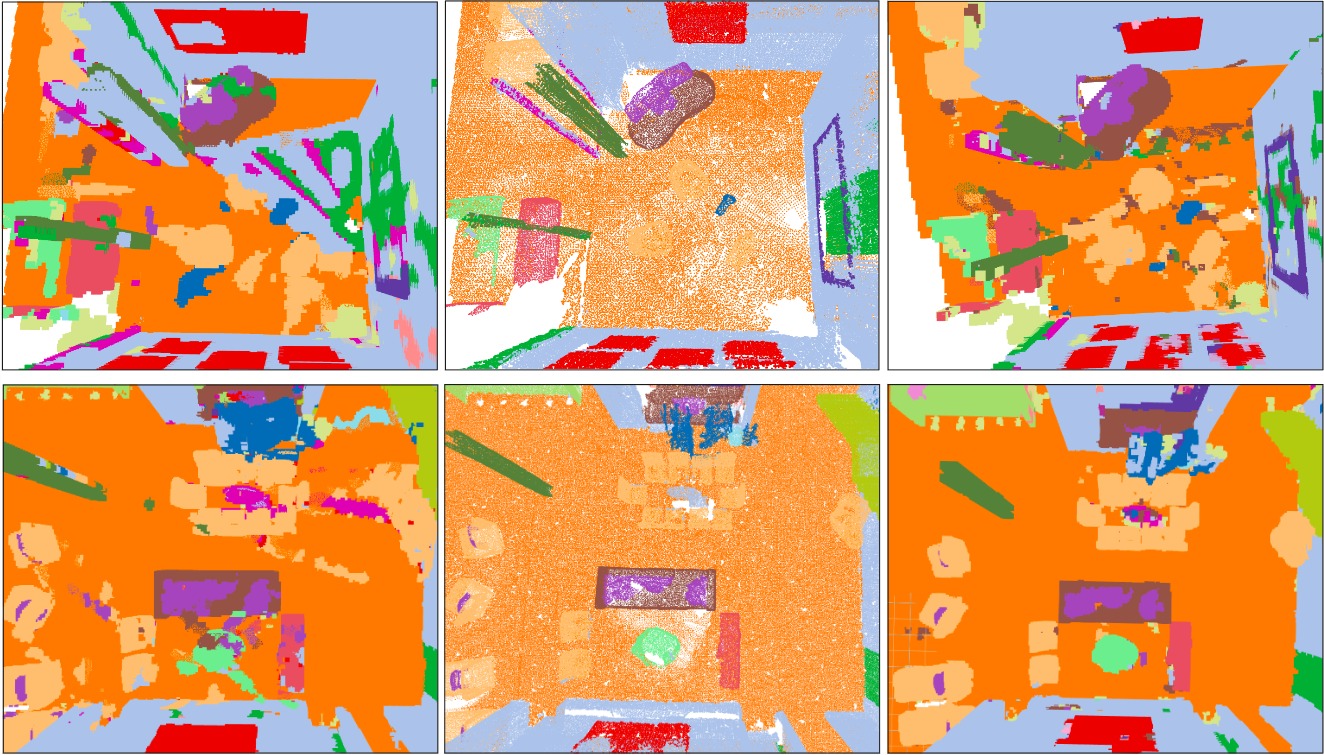

🖼️ 关键图片

📊 实验亮点

论文实验结果表明,LiLMaps在环境理解和人机交互方面取得了显著的性能提升。具体的性能数据和对比基线未知,但摘要中明确指出LiLMaps能够有效提升性能,表明该方法具有一定的实用价值。

🎯 应用场景

LiLMaps可应用于各种机器人场景,例如家庭服务机器人、工业机器人和自动驾驶汽车。它可以使机器人更好地理解环境,执行自然语言指令,并与人类进行更自然的交互。该研究的实际价值在于提高了机器人的自主性和智能化水平,未来有望推动机器人技术的广泛应用。

📄 摘要(原文)

One of the current trends in robotics is to employ large language models (LLMs) to provide non-predefined command execution and natural human-robot interaction. It is useful to have an environment map together with its language representation, which can be further utilized by LLMs. Such a comprehensive scene representation enables numerous ways of interaction with the map for autonomously operating robots. In this work, we present an approach that enhances incremental implicit mapping through the integration of vision-language features. Specifically, we (i) propose a decoder optimization technique for implicit language maps which can be used when new objects appear on the scene, and (ii) address the problem of inconsistent vision-language predictions between different viewing positions. Our experiments demonstrate the effectiveness of LiLMaps and solid improvements in performance.