Targetless Intrinsics and Extrinsic Calibration of Multiple LiDARs and Cameras with IMU using Continuous-Time Estimation

作者: Yuezhang Lv, Yunzhou Zhang, Chao Lu, Jiajun Zhu, Song Wu

分类: cs.RO

发布日期: 2025-01-06

💡 一句话要点

提出一种基于连续时间估计的多LiDAR和相机无目标定标方法

🎯 匹配领域: 支柱八:物理动画 (Physics-based Animation)

关键词: 多传感器标定 无目标定标 连续时间估计 捆绑调整 LiDAR-Camera融合

📋 核心要点

- 多传感器融合需要精确的时空标定,但传感器异步以及相机和LiDAR视野无重叠增加了标定难度。

- 本文提出一种基于连续时间估计的无目标定标方法,可同时标定多LiDAR和相机的内参、外参和时间偏移。

- 实验结果表明,该方法无需标定板和传感器视野重叠,即可实现高精度的多传感器联合标定,且不累积误差。

📝 摘要(中文)

本文提出了一种基于连续时间和捆绑调整(BA)的定标流程,用于同时进行多LiDAR和相机的内参和外参(6自由度变换和时间偏移)定标。该方法不需要相机和LiDAR之间有重叠的视野,也不需要任何标定板。首先,利用运动结构恢复(SFM)建立相机之间的数据关联,并进行相机内参自标定。然后,通过自适应体素地图构建建立LiDAR之间的数据关联,并在地图中优化外参标定。最后,通过匹配LiDAR地图强度投影和相机图像之间的特征,进行内参和外参的联合优化。该流程适用于纹理丰富的结构化环境,允许同时标定任意数量的相机和LiDAR,而无需复杂的传感器同步触发。实验结果表明,该方法能够在传感器之间满足共视性和运动约束,且不累积误差。

🔬 方法详解

问题定义:多LiDAR和相机系统的标定是多传感器融合的关键步骤。现有方法通常依赖于特定的标定物(如标定板)或需要传感器之间有重叠的视野,这限制了其应用场景。此外,传感器之间的异步性以及时间偏移也会影响标定精度。因此,如何在无标定物、无视野重叠的情况下,实现多传感器系统的精确时空标定是一个挑战。

核心思路:本文的核心思路是利用连续时间轨迹估计和捆绑调整(BA)框架,将多传感器标定问题转化为一个优化问题。通过建立相机之间的视觉关联和LiDAR之间的几何关联,以及LiDAR地图强度投影与相机图像之间的特征匹配,实现内参、外参和时间偏移的联合优化。这种方法避免了对标定物的依赖,并允许传感器之间存在异步性。

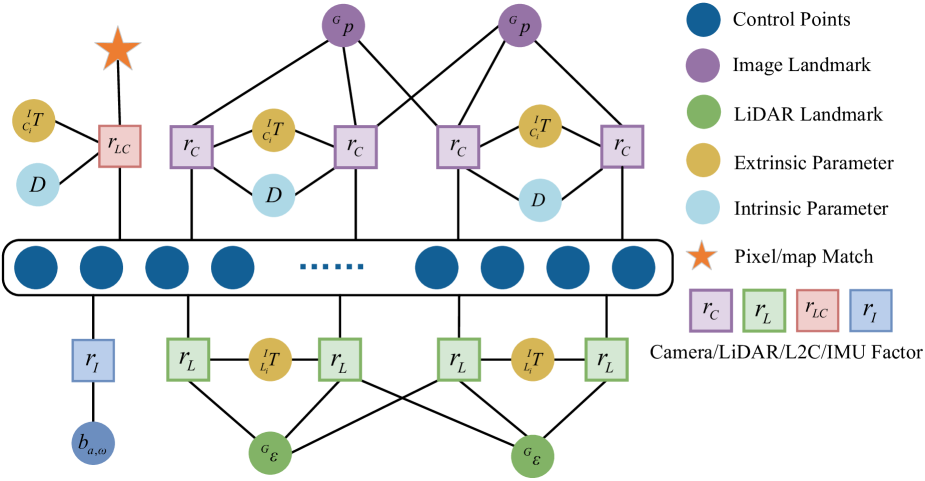

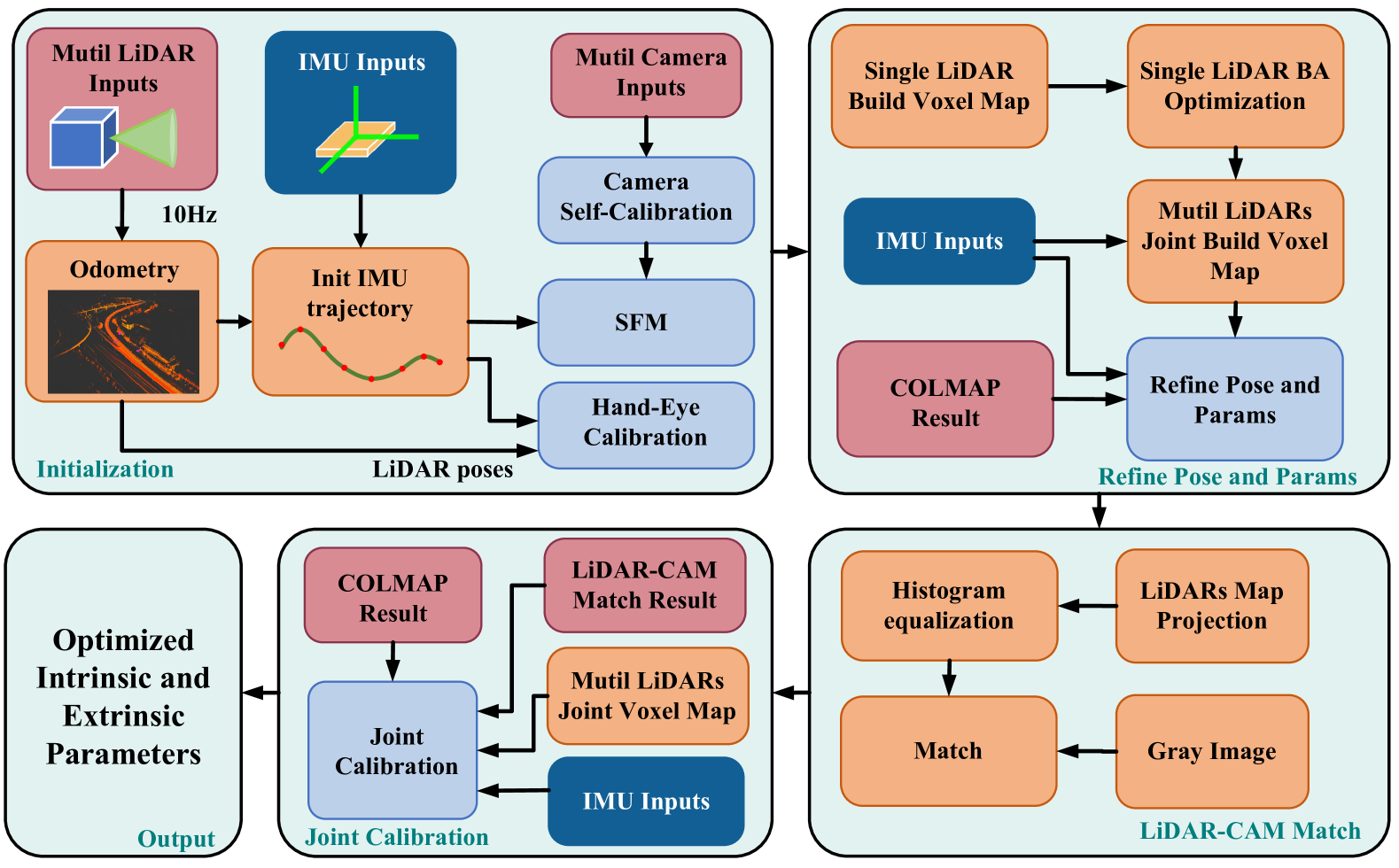

技术框架:该标定流程主要包含三个阶段:1) 相机自标定:利用SFM建立相机之间的视觉关联,并优化相机内参。2) LiDAR外参标定:通过自适应体素地图构建建立LiDAR之间的几何关联,并在地图中优化LiDAR的外参。3) 联合优化:匹配LiDAR地图强度投影和相机图像之间的特征,进行内参、外参和时间偏移的联合优化。整个流程基于连续时间轨迹估计,以处理传感器之间的异步性。

关键创新:该方法的主要创新在于:1) 提出了一个无目标、无视野重叠约束的多传感器标定框架。2) 利用连续时间轨迹估计处理传感器之间的异步性。3) 通过自适应体素地图构建建立LiDAR之间的几何关联,提高了标定精度。4) 实现了内参、外参和时间偏移的联合优化。

关键设计:在相机自标定阶段,使用了标准的SFM流程。在LiDAR外参标定阶段,自适应体素地图的构建允许在不同密度的点云区域进行有效的特征提取和匹配。在联合优化阶段,使用了基于强度投影的特征匹配方法,将LiDAR地图与相机图像关联起来。损失函数的设计考虑了内参、外参和时间偏移的误差,并使用BA进行全局优化。

🖼️ 关键图片

📊 实验亮点

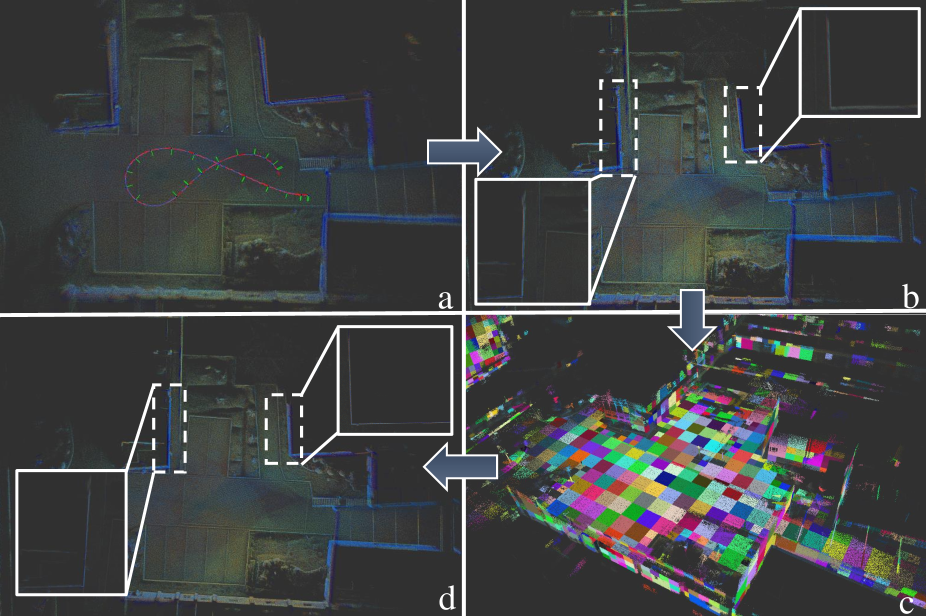

实验结果表明,该方法能够在无标定物和无视野重叠的情况下,实现多LiDAR和相机的精确标定。与现有方法相比,该方法具有更高的灵活性和鲁棒性。具体性能数据未知,但摘要强调了该方法能够满足传感器之间的共视性和运动约束,且不累积误差,表明其具有良好的标定精度和稳定性。

🎯 应用场景

该研究成果可广泛应用于自动驾驶、机器人导航、三维重建等领域。在自动驾驶中,精确的多传感器标定是环境感知和决策规划的基础。该方法无需标定物和视野重叠的特性,使其更易于部署和维护。此外,该方法还可以用于构建高精度的三维地图,为机器人导航提供支持。未来,该方法可以进一步扩展到更多类型的传感器,实现更复杂的多传感器融合系统。

📄 摘要(原文)

Accurate spatiotemporal calibration is a prerequisite for multisensor fusion. However, sensors are typically asynchronous, and there is no overlap between the fields of view of cameras and LiDARs, posing challenges for intrinsic and extrinsic parameter calibration. To address this, we propose a calibration pipeline based on continuous-time and bundle adjustment (BA) capable of simultaneous intrinsic and extrinsic calibration (6 DOF transformation and time offset). We do not require overlapping fields of view or any calibration board. Firstly, we establish data associations between cameras using Structure from Motion (SFM) and perform self-calibration of camera intrinsics. Then, we establish data associations between LiDARs through adaptive voxel map construction, optimizing for extrinsic calibration within the map. Finally, by matching features between the intensity projection of LiDAR maps and camera images, we conduct joint optimization for intrinsic and extrinsic parameters. This pipeline functions in texture-rich structured environments, allowing simultaneous calibration of any number of cameras and LiDARs without the need for intricate sensor synchronization triggers. Experimental results demonstrate our method's ability to fulfill co-visibility and motion constraints between sensors without accumulating errors.