Design and Benchmarking of A Multi-Modality Sensor for Robotic Manipulation with GAN-Based Cross-Modality Interpretation

作者: Dandan Zhang, Wen Fan, Jialin Lin, Haoran Li, Qingzheng Cong, Weiru Liu, Nathan F. Lepora, Shan Luo

分类: cs.RO, eess.SP

发布日期: 2025-01-04

备注: Accepted by IEEE Transactions on Robotics

💡 一句话要点

ViTacTip:一种基于GAN跨模态解释的多模态触觉传感器设计与基准测试

🎯 匹配领域: 支柱一:机器人控制 (Robot Control)

关键词: 多模态触觉传感器 机器人操作 生成对抗网络 跨模态学习 仿生触觉 透明皮肤 多任务学习

📋 核心要点

- 现有机器人触觉传感器在多模态感知和小型化设计方面存在局限,难以同时提供视觉、触觉和力觉等信息。

- ViTacTip采用透明皮肤和仿生触觉单元,结合视觉和触觉信息,并通过GAN实现跨模态数据转换,提升感知能力。

- 实验验证了ViTacTip在物体识别、接触点检测、姿态回归和光栅识别等任务上的有效性,证明了其多功能性。

📝 摘要(中文)

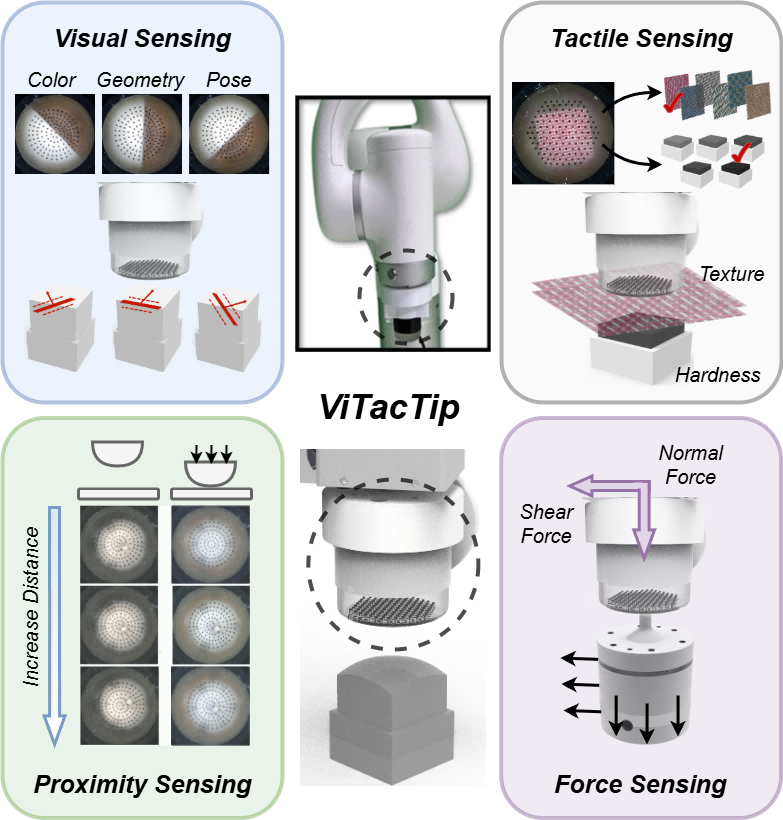

本文提出了一种创新的多模态传感器ViTacTip的设计与基准测试,旨在满足机器人操作中对高级多模态传感的需求。ViTacTip的一个显著特点是其透明皮肤,它结合了一种“透视皮肤”机制。该机制旨在捕捉接触时的详细物体特征,从而显著提高基于视觉和接近感知的能力。同时,嵌入在传感器皮肤中的仿生触觉单元被设计用来放大接触细节,从而大大增强触觉和由此产生的力感知能力。为了展示ViTacTip的多模态能力,我们开发了一个多任务学习模型,可以同时识别硬度、材料和纹理。为了评估ViTacTip的功能并验证其多功能性,我们进行了广泛的基准测试实验,包括物体识别、接触点检测、姿态回归和光栅识别。为了方便在各种传感模式之间无缝切换,我们采用了一种基于生成对抗网络(GAN)的方法。该方法通过实现跨模态解释,增强了ViTacTip传感器在各种环境中的适用性。

🔬 方法详解

问题定义:现有机器人触觉传感器通常在多模态信息融合方面存在挑战,难以同时提供高分辨率的视觉和精确的触觉反馈。此外,小型化设计也是一个难点,限制了其在复杂操作环境中的应用。因此,需要一种能够提供丰富多模态信息,并且体积小巧的触觉传感器,以提升机器人操作的智能化水平。

核心思路:ViTacTip的核心思路是结合视觉和触觉感知,通过透明皮肤实现“透视”效果,从而捕捉更详细的物体特征。同时,利用仿生触觉单元放大接触细节,增强触觉感知能力。为了实现不同模态信息之间的无缝切换和融合,采用GAN进行跨模态数据转换,使得传感器在不同环境下都能有效工作。

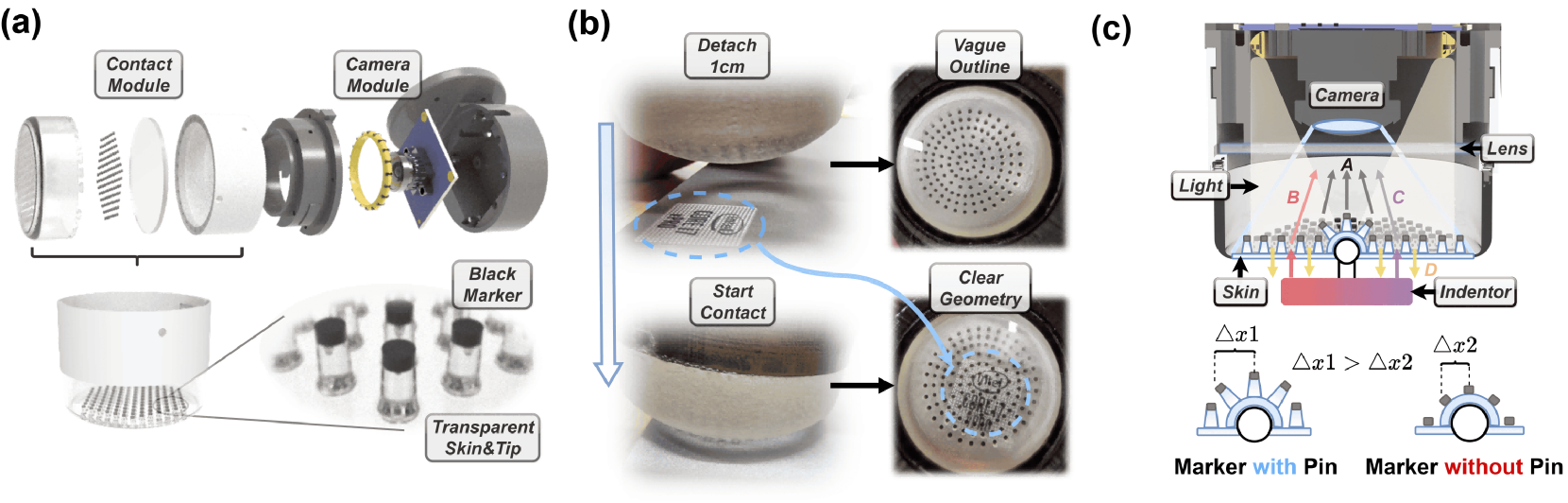

技术框架:ViTacTip的整体框架包括以下几个主要模块:1) 透明皮肤和内部摄像头,用于捕捉物体表面的视觉信息;2) 仿生触觉单元,用于感知接触压力和形变;3) 多任务学习模型,用于同时识别物体的硬度、材料和纹理;4) 基于GAN的跨模态解释模块,用于实现视觉和触觉信息之间的转换和融合。整个流程是从传感器获取多模态数据,经过预处理后输入多任务学习模型和GAN,最终输出对物体的综合感知结果。

关键创新:ViTacTip的关键创新在于其“透视皮肤”设计和基于GAN的跨模态解释方法。“透视皮肤”允许内部摄像头直接观察接触区域,获取高分辨率的视觉信息,而传统的触觉传感器通常只能提供触觉反馈。GAN的引入使得不同模态的信息可以相互转换和补充,从而提高了传感器的鲁棒性和适应性。

关键设计:在透明皮肤的设计上,需要选择合适的材料和厚度,以保证透光性和机械强度。仿生触觉单元的设计需要考虑灵敏度和响应速度。多任务学习模型采用共享特征提取层和多个特定任务的输出层,以实现高效的特征学习。GAN采用Conditional GAN结构,以实现条件式的跨模态转换。损失函数包括多任务学习的损失和GAN的对抗损失,通过联合优化来提高模型的性能。

🖼️ 关键图片

📊 实验亮点

ViTacTip在多个基准测试中表现出色。在物体识别任务中,ViTacTip的准确率显著高于传统触觉传感器。在接触点检测和姿态回归任务中,ViTacTip的误差也明显降低。此外,ViTacTip在光栅识别任务中能够准确识别不同频率的光栅,验证了其高分辨率的触觉感知能力。这些实验结果表明ViTacTip具有优异的多模态感知性能。

🎯 应用场景

ViTacTip在机器人操作、医疗康复、虚拟现实等领域具有广泛的应用前景。在机器人操作中,可以用于精确抓取和操作物体。在医疗康复中,可以用于辅助医生进行触诊和诊断。在虚拟现实中,可以提供更真实的触觉反馈,增强用户体验。该研究的未来影响在于推动机器人触觉感知技术的发展,提高机器人的智能化水平。

📄 摘要(原文)

In this paper, we present the design and benchmark of an innovative sensor, ViTacTip, which fulfills the demand for advanced multi-modal sensing in a compact design. A notable feature of ViTacTip is its transparent skin, which incorporates a `see-through-skin' mechanism. This mechanism aims at capturing detailed object features upon contact, significantly improving both vision-based and proximity perception capabilities. In parallel, the biomimetic tips embedded in the sensor's skin are designed to amplify contact details, thus substantially augmenting tactile and derived force perception abilities. To demonstrate the multi-modal capabilities of ViTacTip, we developed a multi-task learning model that enables simultaneous recognition of hardness, material, and textures. To assess the functionality and validate the versatility of ViTacTip, we conducted extensive benchmarking experiments, including object recognition, contact point detection, pose regression, and grating identification. To facilitate seamless switching between various sensing modalities, we employed a Generative Adversarial Network (GAN)-based approach. This method enhances the applicability of the ViTacTip sensor across diverse environments by enabling cross-modality interpretation.