Eliciting Understandable Architectonic Gestures for Robotic Furniture through Co-Design Improvisation

作者: Alex Binh Vinh Duc Nguyen, Jan Leusmann, Sven Mayer, Andrew Vande Moere

分类: cs.HC, cs.RO

发布日期: 2025-01-03

💡 一句话要点

提出建筑手势,通过协同设计即兴创作,使机器人家具的行为更易理解

🎯 匹配领域: 支柱八:物理动画 (Physics-based Animation)

关键词: 人机交互 机器人家具 自适应建筑 建筑手势 协同设计

📋 核心要点

- 现有自适应建筑中,机器人家具与居住者的交互方式缺乏明确的意图表达,导致难以理解。

- 通过协同设计即兴创作,探索机器人隔断的空间姿态如何表达建筑意图,提出“建筑手势”的概念。

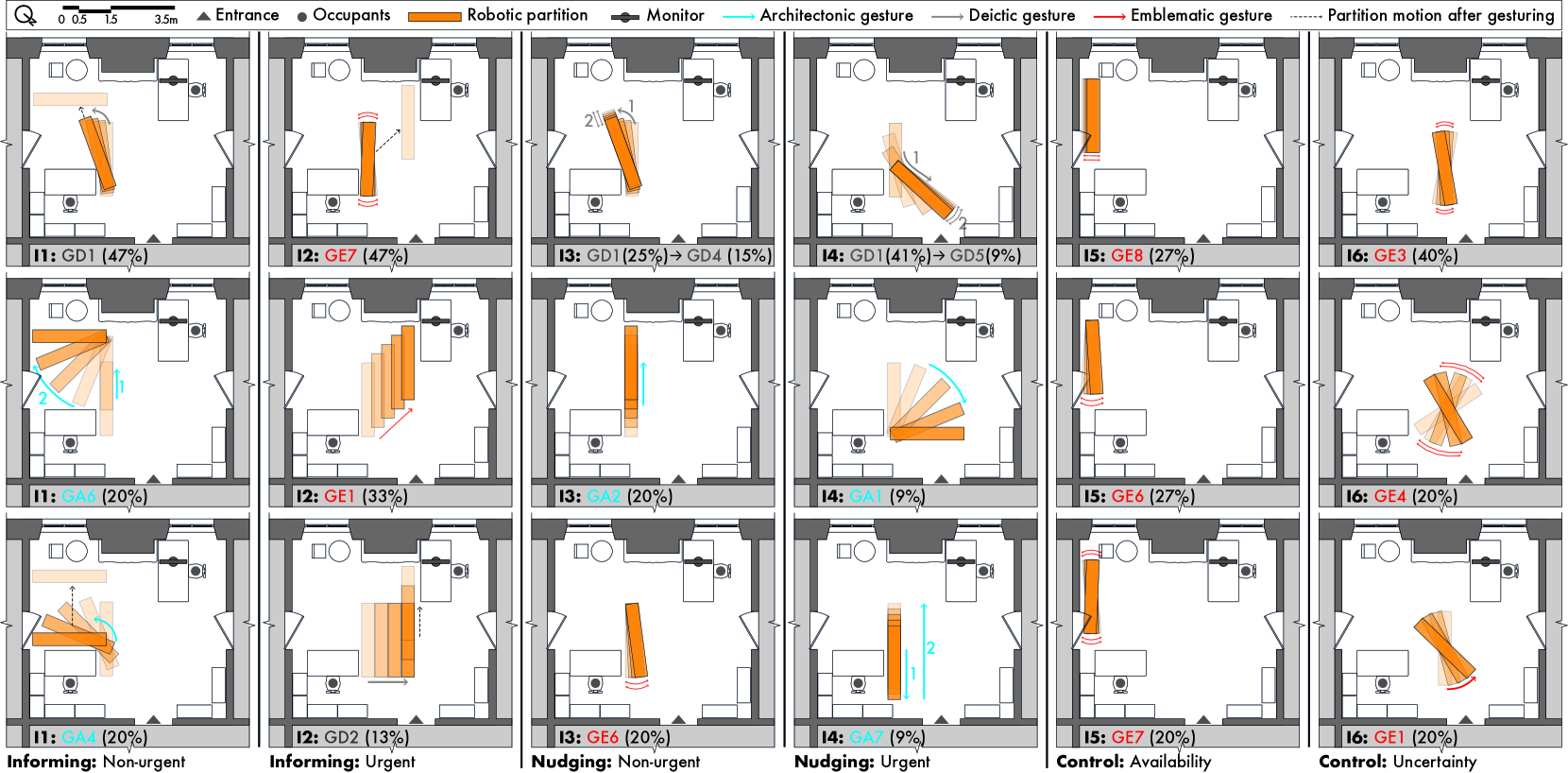

- 实验识别出20种独特的姿势策略,证明建筑手势可以通过空间影响有效传达意图,弥合人机交互与人-建筑交互研究。

📝 摘要(中文)

自适应建筑的愿景提出,机器人技术能够实现室内空间与居住者双向互动式的物理转换。然而,这种互动如何以一种易于理解的方式展开仍然未知。受人机交互研究的启发,该研究假设自适应建筑也可以通过移动机器人隔断执行的姿势来传达意图。为了探索这一设计空间,我们邀请了15位多学科专家参与协同设计即兴创作会议,他们手动操纵一个停用的机器人隔断,设计了六种具有不同目的和紧急程度的建筑意图的姿势。通过姿势启发方法、基于拉班动作分析的问卷和主题分析,我们识别了20种独特的姿势策略。通过分类,我们引入了建筑手势作为机器人家具通过索引方式利用其空间影响来传达意图的新策略,补充了已建立的指示性和象征性手势。因此,我们的研究代表了使自适应建筑的自主姿势更易于理解的探索性步骤。通过理解机器人姿势不仅基于其运动,还基于其空间影响来解释,我们有助于弥合人机交互与人-建筑交互研究之间的差距。

🔬 方法详解

问题定义:论文旨在解决自适应建筑中,机器人家具如何以一种用户可理解的方式表达其意图的问题。现有方法主要集中在指示性或象征性手势,忽略了机器人家具的空间影响,导致用户难以直观理解其行为背后的含义。

核心思路:论文的核心思路是引入“建筑手势”的概念,即机器人家具通过其在空间中的位置和运动轨迹来传达意图。这种方法强调了机器人家具的空间影响,使其行为更具语境性,从而更容易被用户理解。通过协同设计即兴创作,探索不同的建筑意图如何通过不同的空间姿态来表达。

技术框架:该研究采用了一种以人为中心的设计方法,主要包含以下几个阶段: 1. 专家招募:邀请15位多学科专家参与协同设计。 2. 协同设计即兴创作:专家手动操纵停用的机器人隔断,设计表达六种不同建筑意图的姿势。 3. 数据采集:使用动作捕捉系统记录隔断的运动轨迹,并使用基于拉班动作分析的问卷收集专家对姿势的感知。 4. 数据分析:通过主题分析识别不同的姿势策略,并对姿势进行分类。 5. 建筑手势定义:基于分析结果,定义建筑手势的概念,并将其与指示性和象征性手势进行比较。

关键创新:论文的关键创新在于提出了“建筑手势”这一概念,它强调了机器人家具的空间影响在意图表达中的作用。与传统的指示性和象征性手势相比,建筑手势更具语境性,能够更有效地传达复杂的建筑意图。

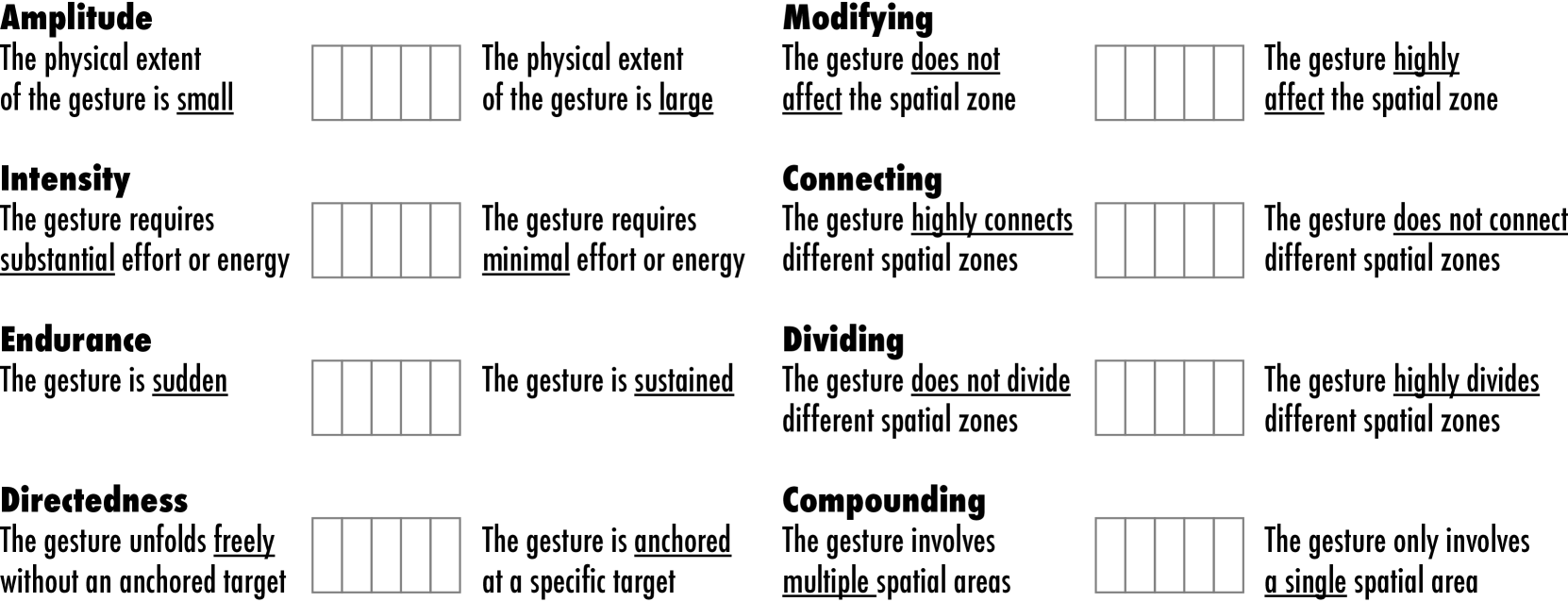

关键设计:研究中,六种建筑意图的选择是关键设计之一,它们涵盖了不同的目的(如提供隐私、创造社交空间)和紧急程度(如紧急避让)。基于拉班动作分析的问卷用于量化专家对姿势的感知,包括空间、重量、时间和流动性等方面。主题分析方法用于识别不同的姿势策略,并将其归纳为不同的类别。

🖼️ 关键图片

📊 实验亮点

研究通过协同设计即兴创作,成功识别出20种独特的姿势策略,并将其归纳为不同的类别。实验结果表明,建筑手势能够有效地传达不同的建筑意图,并且用户对建筑手势的理解程度高于传统的指示性和象征性手势。基于拉班动作分析的问卷结果也验证了建筑手势在空间、重量、时间和流动性等方面的独特性。

🎯 应用场景

该研究成果可应用于智能家居、自适应办公空间、医疗康复环境等领域。通过使机器人家具能够以更易理解的方式表达其意图,可以提高用户对智能环境的信任感和满意度,并促进人与智能环境之间的更自然、更有效的互动。未来,该研究可以扩展到更复杂的机器人家具系统,并探索不同文化背景下用户对建筑手势的理解。

📄 摘要(原文)

The vision of adaptive architecture proposes that robotic technologies could enable interior spaces to physically transform in a bidirectional interaction with occupants. Yet, it is still unknown how this interaction could unfold in an understandable way. Inspired by HRI studies where robotic furniture gestured intents to occupants by deliberately positioning or moving in space, we hypothesise that adaptive architecture could also convey intents through gestures performed by a mobile robotic partition. To explore this design space, we invited 15 multidisciplinary experts to join co-design improvisation sessions, where they manually manoeuvred a deactivated robotic partition to design gestures conveying six architectural intents that varied in purpose and urgency. Using a gesture elicitation method alongside motion-tracking data, a Laban-based questionnaire, and thematic analysis, we identified 20 unique gestural strategies. Through categorisation, we introduced architectonic gestures as a novel strategy for robotic furniture to convey intent by indexically leveraging its spatial impact, complementing the established deictic and emblematic gestures. Our study thus represents an exploratory step toward making the autonomous gestures of adaptive architecture more legible. By understanding how robotic gestures are interpreted based not only on their motion but also on their spatial impact, we contribute to bridging HRI with Human-Building Interaction research.