Self-Disclosure to AI: The Paradox of Trust and Vulnerability in Human-Machine Interactions

作者: Zoe Zhiqiu Jiang

分类: cs.HC, cs.RO

发布日期: 2024-12-29

备注: Accepted at NeurIPS 2024 Creative AI

💡 一句话要点

探讨人机交互中信任与脆弱性的悖论,揭示AI如何诱导人类自我暴露

🎯 匹配领域: 支柱四:生成式动作 (Generative Motion)

关键词: 人机交互 信任 自我暴露 隐私 AI伦理

📋 核心要点

- 核心问题:现有研究对人机交互中信任建立的心理机制理解不足,尤其是在AI诱导自我暴露的场景下。

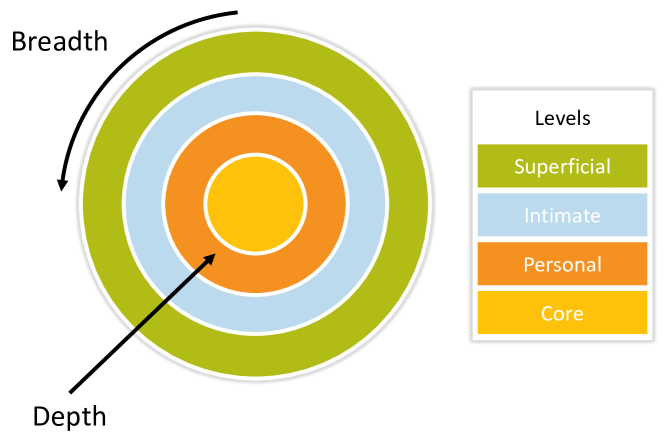

- 方法要点:通过分析BlabDroid项目案例,结合社会渗透理论和沟通隐私管理理论,研究人机交互中的信任与自我暴露。

- 实验或效果:该研究为理解人机交互中的信任动态提供了理论框架,并强调了AI伦理责任的重要性。

📝 摘要(中文)

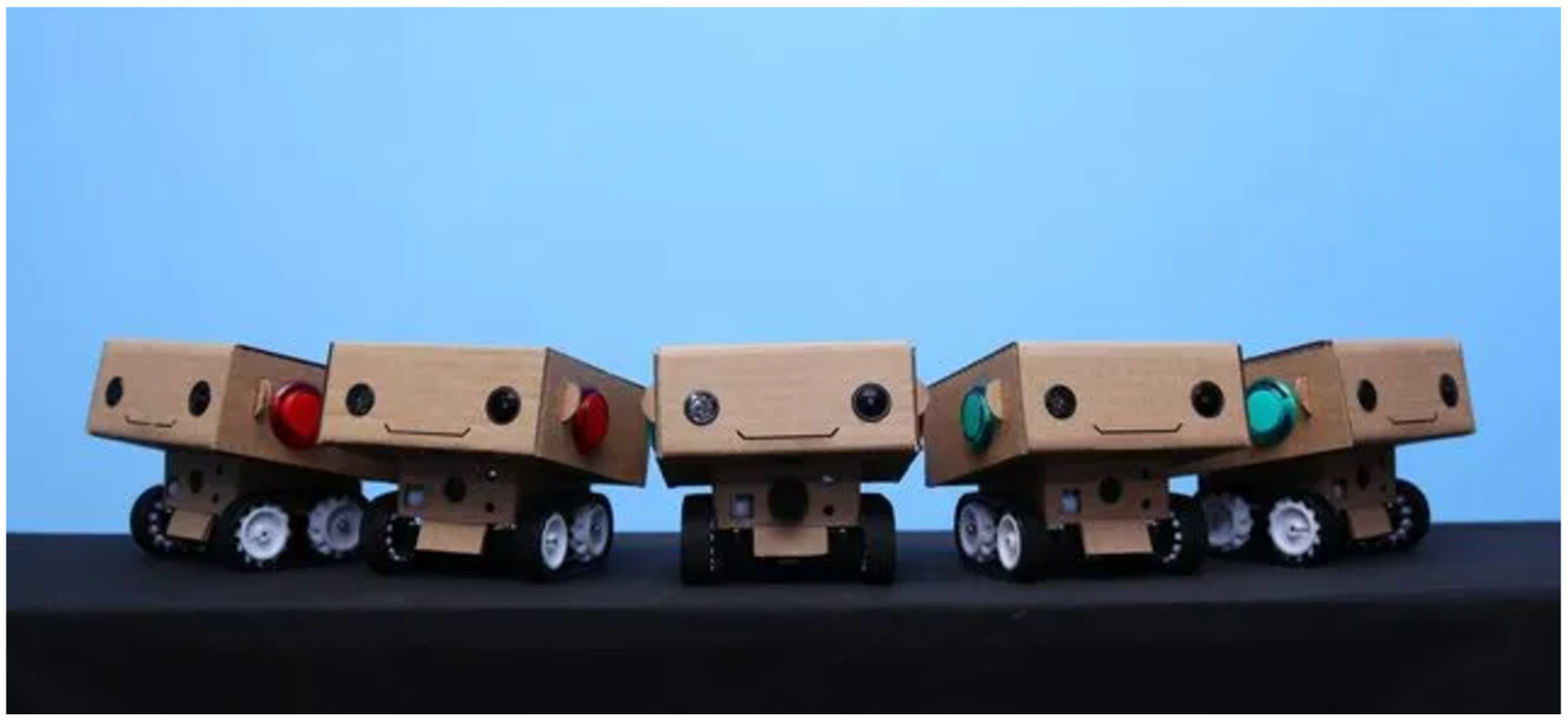

本文探讨了人机交互中信任与脆弱性的悖论,灵感来源于Alexander Reben的BlabDroid项目。该项目利用小型、朴实无华的机器人与人互动,成功地引诱人们透露个人想法或秘密,其效果甚至优于人类。这种现象引发了关于信任和自我暴露如何在与机器(即使是最简单的形式)的互动中运作的有趣问题。我们通过分析此类遭遇背后的心理过程来研究技术信任的变化。该分析应用了社会渗透理论和沟通隐私管理理论,以理解在与机器或AI共享个人信息和秘密时,感知安全与暴露风险之间的平衡。此外,我们还借鉴了后人类主义和现象学等哲学视角,探讨了数字时代中关于信任、隐私和脆弱性的更广泛问题。人工智能迅速融入我们最私密的领域,挑战我们重新思考和定义我们的伦理责任。

🔬 方法详解

问题定义:论文旨在理解人机交互中,人类为何以及如何在多大程度上向AI系统进行自我暴露,尤其是在AI系统主动诱导的情况下。现有方法主要关注人与人之间的信任关系,缺乏对人机信任差异的深入研究,未能充分解释为何人们有时更容易向机器透露秘密,而对人类却有所保留。这种现象挑战了我们对信任和隐私的传统认知。

核心思路:论文的核心思路是,通过分析BlabDroid项目的案例,结合心理学和社会学的相关理论,揭示人机交互中信任建立的特殊机制。论文认为,人们对机器的信任可能并非基于情感连接,而是基于对机器“无害性”的假设,以及对机器不会泄露秘密的信任。这种信任可能导致人们更容易向机器进行自我暴露。

技术框架:论文采用了一种跨学科的研究方法,结合了案例分析、心理学理论和社会学理论。具体来说,论文首先分析了BlabDroid项目的案例,观察人们与机器人互动时的行为和反应。然后,论文运用社会渗透理论和沟通隐私管理理论,分析了人们在人机交互中自我暴露的动机和风险。最后,论文借鉴了后人类主义和现象学等哲学视角,探讨了人机交互对信任、隐私和伦理的更广泛影响。

关键创新:论文的创新之处在于,它首次将社会渗透理论和沟通隐私管理理论应用于人机交互领域,为理解人机信任的特殊性提供了新的视角。此外,论文还通过分析BlabDroid项目的案例,揭示了AI系统诱导人类自我暴露的潜在风险,为AI伦理研究提供了重要的启示。

关键设计:论文没有涉及具体的参数设置、损失函数或网络结构等技术细节,因为它主要关注的是人机交互中的心理和社会学问题。然而,论文对BlabDroid项目的案例分析,以及对相关理论的运用,为后续研究提供了重要的参考框架。

🖼️ 关键图片

📊 实验亮点

该研究通过分析BlabDroid项目,揭示了人们更容易向机器人透露秘密的现象,并提出了人机信任可能不同于人际信任的观点。研究结果表明,即使是简单的机器人,也能有效地引诱人们进行自我暴露,这引发了对AI伦理和隐私保护的深刻思考。

🎯 应用场景

该研究成果可应用于开发更值得信任的人工智能系统,尤其是在心理咨询、情感支持等领域。通过理解人机信任的机制,可以设计出更安全、更负责任的AI产品,避免AI系统被滥用于诱导用户泄露敏感信息。此外,该研究还有助于提高公众对AI伦理问题的认识,促进人与AI的和谐共处。

📄 摘要(原文)

In this paper, we explore the paradox of trust and vulnerability in human-machine interactions, inspired by Alexander Reben's BlabDroid project. This project used small, unassuming robots that actively engaged with people, successfully eliciting personal thoughts or secrets from individuals, often more effectively than human counterparts. This phenomenon raises intriguing questions about how trust and self-disclosure operate in interactions with machines, even in their simplest forms. We study the change of trust in technology through analyzing the psychological processes behind such encounters. The analysis applies theories like Social Penetration Theory and Communication Privacy Management Theory to understand the balance between perceived security and the risk of exposure when personal information and secrets are shared with machines or AI. Additionally, we draw on philosophical perspectives, such as posthumanism and phenomenology, to engage with broader questions about trust, privacy, and vulnerability in the digital age. Rapid incorporation of AI into our most private areas challenges us to rethink and redefine our ethical responsibilities.