Scalable Hierarchical Reinforcement Learning for Hyper Scale Multi-Robot Task Planning

作者: Xuan Zhou, Xiang Shi, Lele Zhang, Chen Chen, Hongbo Li, Lin Ma, Fang Deng, Jie Chen

分类: cs.RO, cs.AI, cs.MA

发布日期: 2024-12-27

💡 一句话要点

提出基于分层强化学习的可扩展多机器人任务规划方法,解决超大规模仓库系统中的维度灾难和动态性问题。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 分层强化学习 多机器人任务规划 仓库自动化 时间注意力网络 课程学习

📋 核心要点

- 现有方法难以应对超大规模多机器人任务规划中的维度灾难和动态性问题,导致效率低下。

- 论文提出一种基于分层强化学习的多阶段规划器,利用分层时间注意力网络和多阶段课程学习来提升扩展性和泛化能力。

- 实验结果表明,该规划器在模拟和真实RMFS中均优于现有方法,并能扩展到包含200个机器人和1000个货架的超大规模场景。

📝 摘要(中文)

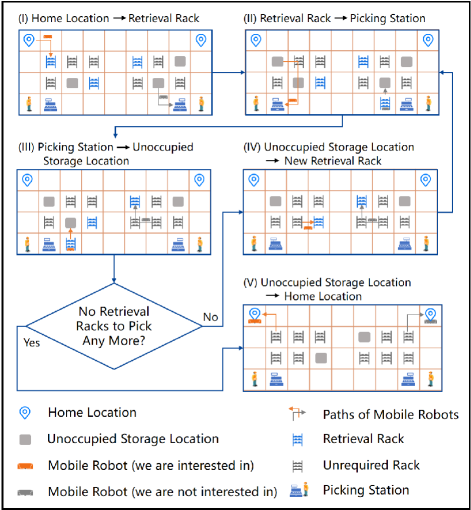

为了提高仓库系统的效率并满足海量客户订单,本文旨在解决机器人移动履行系统(RMFS)中超大规模多机器人任务规划(MRTP)的维度灾难和动态性挑战。现有研究表明,分层强化学习(HRL)是减少这些挑战的有效方法。基于此,我们构建了一个高效的基于多阶段HRL的多机器人任务规划器,用于RMFS中的超大规模MRTP,并且规划过程用一种特殊的时间图拓扑表示。为了确保最优性,规划器采用集中式架构设计,但也带来了扩展和泛化的挑战,这要求策略能够为各种未学习的规模和地图保持性能。为了解决这些困难,我们首先构建了一个分层时间注意力网络(HTAN),以确保处理具有不固定长度的输入的基本能力,然后为分层策略学习设计多阶段课程,以进一步提高扩展和泛化能力,同时避免灾难性遗忘。此外,我们注意到具有分层结构的策略会遭受不公平的信用分配,这与多智能体强化学习中的情况类似,受此启发,我们提出了一种具有反事实回滚基线的分层强化学习算法,以提高学习性能。实验结果表明,我们的规划器在模拟和真实世界的RMFS中的各种MRTP实例上优于其他最先进的方法。此外,我们的规划器可以成功扩展到RMFS中的超大规模MRTP实例,在未学习的地图上最多可容纳200个机器人和1000个检索货架,同时保持优于其他方法的性能。

🔬 方法详解

问题定义:论文旨在解决超大规模机器人移动履行系统(RMFS)中的多机器人任务规划(MRTP)问题。现有方法在处理大规模场景时面临维度灾难,难以泛化到不同的地图和机器人数量,并且难以应对动态变化的环境。这些痛点导致规划效率低下,无法满足海量客户订单的需求。

核心思路:论文的核心思路是利用分层强化学习(HRL)来分解复杂任务,降低维度,并结合注意力机制和课程学习来提高泛化能力和学习效率。通过分层结构,可以将任务分解为高层决策和底层执行,从而降低搜索空间。注意力机制用于处理不同长度的输入,课程学习则帮助模型逐步适应更复杂的场景。

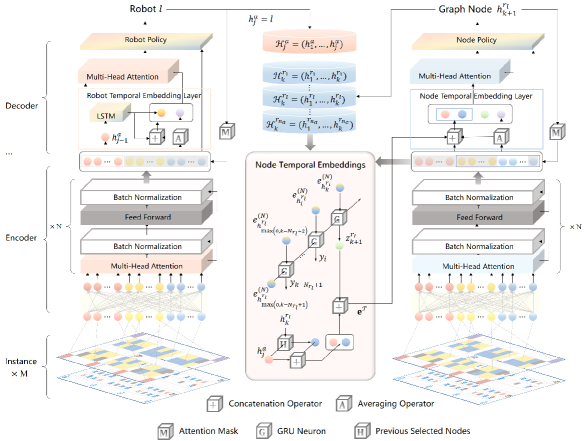

技术框架:整体框架是一个多阶段HRL规划器,包含以下主要模块:1) 分层时间注意力网络(HTAN):用于处理不同规模的输入,提取关键信息。2) 多阶段课程学习:逐步增加任务难度,提高模型的泛化能力。3) 具有反事实回滚基线的分层强化学习算法:解决分层结构中的信用分配问题。规划过程被表示为一个时间图拓扑。

关键创新:论文的关键创新在于将分层强化学习、时间注意力机制和课程学习相结合,并提出了具有反事实回滚基线的HRL算法。与现有方法相比,该方法能够更好地处理超大规模场景,具有更强的泛化能力和更高的学习效率。反事实回滚基线的设计解决了分层结构中常见的信用分配不均问题。

关键设计:HTAN采用分层结构,分别处理不同时间尺度的信息。多阶段课程学习包括从简单到复杂的任务设置,例如逐渐增加机器人数量和地图复杂度。反事实回滚基线通过比较实际动作和反事实动作的奖励差异来调整策略,从而更准确地评估每个动作的贡献。

🖼️ 关键图片

📊 实验亮点

实验结果表明,该规划器在模拟和真实RMFS环境中均优于其他最先进的方法。在包含200个机器人和1000个货架的超大规模场景中,该规划器仍然能够保持优越的性能。与基线方法相比,该规划器在任务完成时间和资源利用率方面均有显著提升。

🎯 应用场景

该研究成果可应用于大规模仓库自动化、物流配送、智能制造等领域。通过高效的多机器人任务规划,可以显著提高仓库运营效率,降低成本,并更好地满足客户需求。未来,该方法有望扩展到其他多智能体协作场景,例如自动驾驶车队管理、无人机集群控制等。

📄 摘要(原文)

To improve the efficiency of warehousing system and meet huge customer orders, we aim to solve the challenges of dimension disaster and dynamic properties in hyper scale multi-robot task planning (MRTP) for robotic mobile fulfillment system (RMFS). Existing research indicates that hierarchical reinforcement learning (HRL) is an effective method to reduce these challenges. Based on that, we construct an efficient multi-stage HRL-based multi-robot task planner for hyper scale MRTP in RMFS, and the planning process is represented with a special temporal graph topology. To ensure optimality, the planner is designed with a centralized architecture, but it also brings the challenges of scaling up and generalization that require policies to maintain performance for various unlearned scales and maps. To tackle these difficulties, we first construct a hierarchical temporal attention network (HTAN) to ensure basic ability of handling inputs with unfixed lengths, and then design multi-stage curricula for hierarchical policy learning to further improve the scaling up and generalization ability while avoiding catastrophic forgetting. Additionally, we notice that policies with hierarchical structure suffer from unfair credit assignment that is similar to that in multi-agent reinforcement learning, inspired of which, we propose a hierarchical reinforcement learning algorithm with counterfactual rollout baseline to improve learning performance. Experimental results demonstrate that our planner outperform other state-of-the-art methods on various MRTP instances in both simulated and real-world RMFS. Also, our planner can successfully scale up to hyper scale MRTP instances in RMFS with up to 200 robots and 1000 retrieval racks on unlearned maps while keeping superior performance over other methods.