Human-Humanoid Robots Cross-Embodiment Behavior-Skill Transfer Using Decomposed Adversarial Learning from Demonstration

作者: Junjia Liu, Zhuo Li, Minghao Yu, Zhipeng Dong, Sylvain Calinon, Darwin Caldwell, Fei Chen

分类: cs.RO, cs.AI

发布日期: 2024-12-19

备注: 9 pages, 8 figures. Accepted by IEEE Robotics and Automation Magazine

💡 一句话要点

提出一种基于分解对抗学习的人形机器人跨形态行为技能迁移框架

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱五:交互与反应 (Interaction & Reaction) 支柱七:动作重定向 (Motion Retargeting)

关键词: 人形机器人 技能迁移 对抗学习 模仿学习 运动学重定向

📋 核心要点

- 人形机器人技能学习面临数据收集困难和平台差异性挑战,限制了其在复杂任务中的应用。

- 该论文提出一种基于分解对抗学习的跨形态迁移框架,利用统一数字人体模型作为桥梁,实现技能泛化。

- 实验表明,该框架在多种人形机器人上实现了稳定的运动操作,有效降低了数据需求并提升了迁移效率。

📝 摘要(中文)

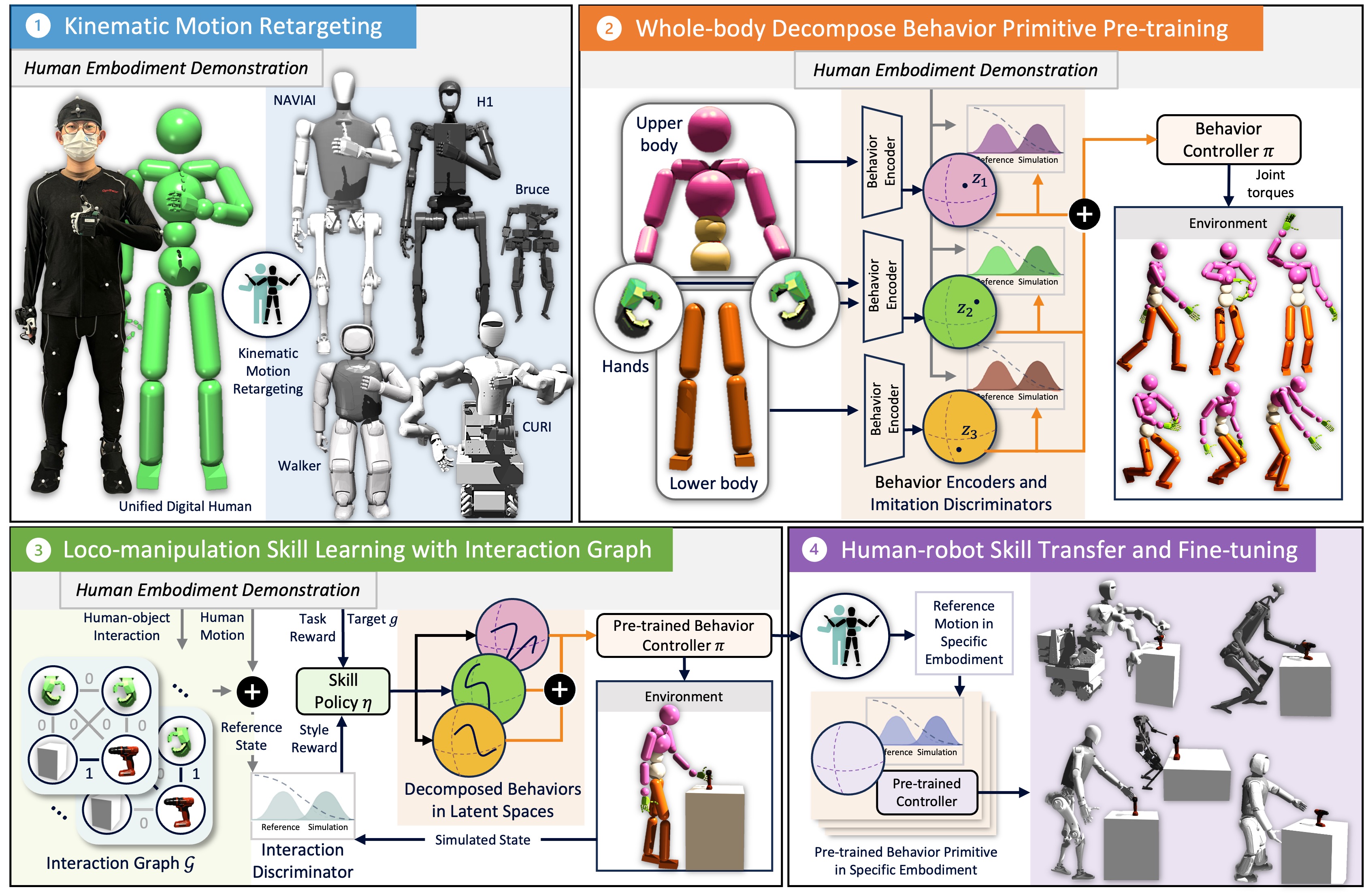

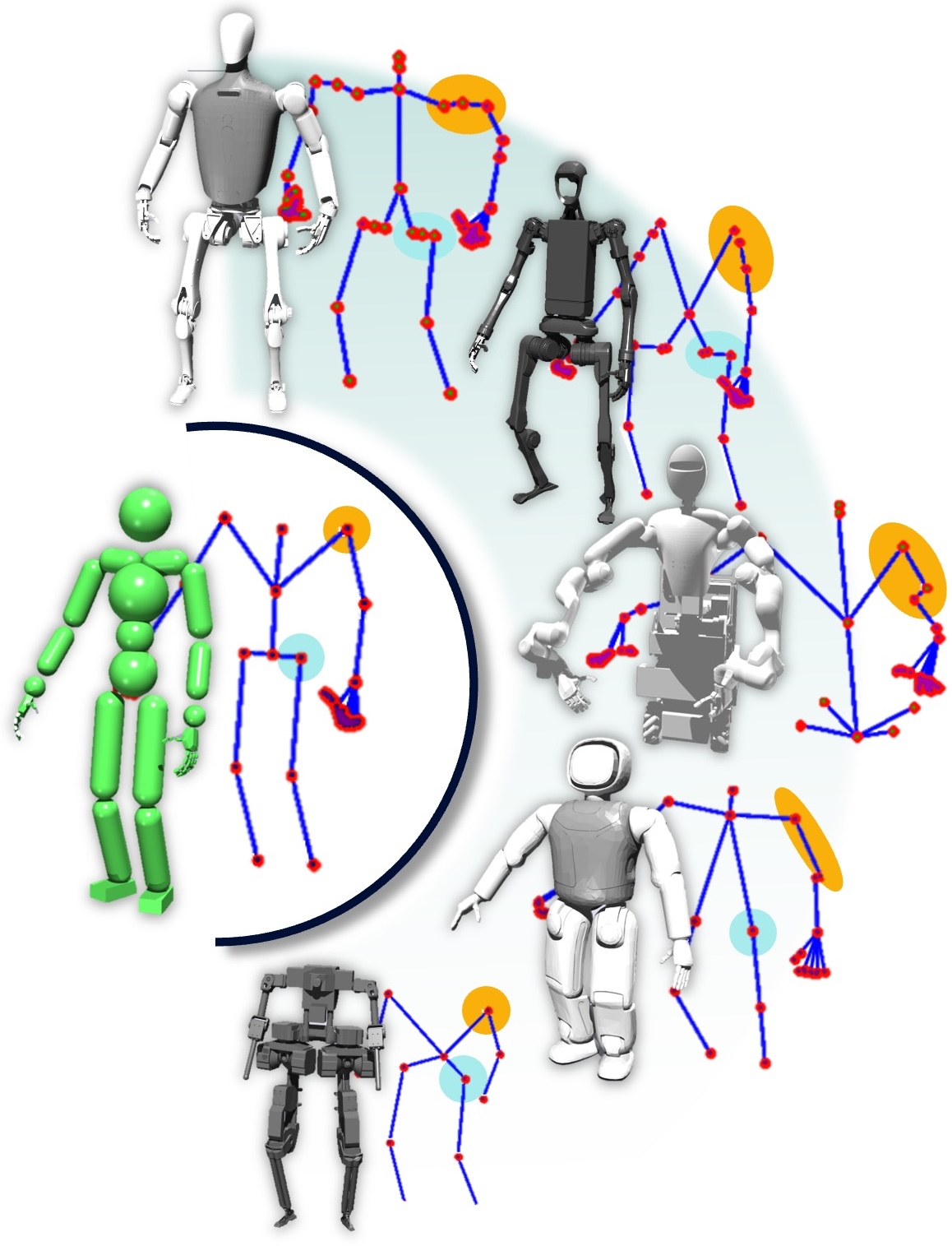

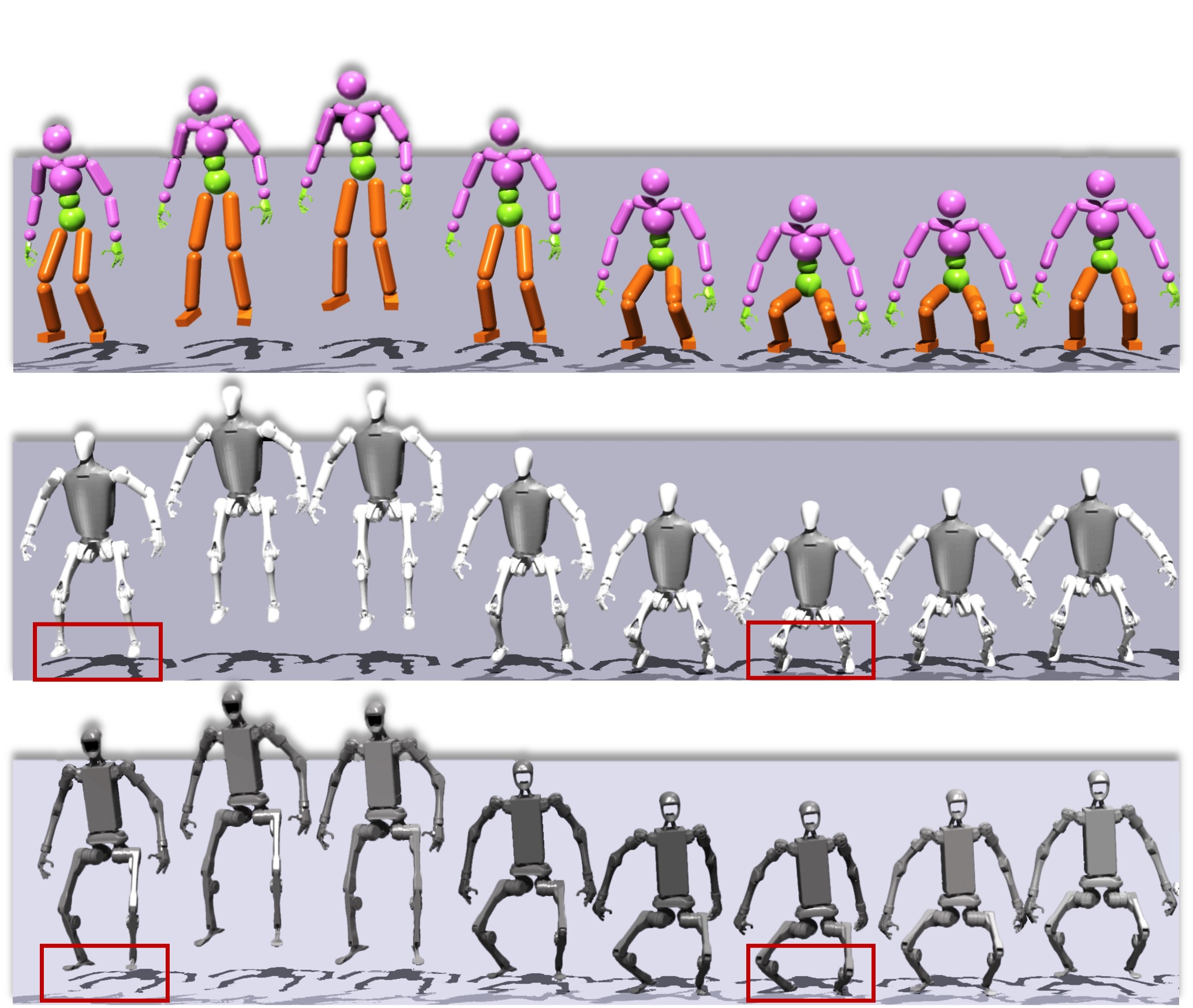

人形机器人被设想为能够执行各种人类水平的运动操作任务的具身智能体,尤其是在需要费力且重复性劳动的场景中。然而,由于人形机器人具有高度的自由度,学习这些技能具有挑战性,并且为人形机器人收集足够的训练数据是一个费力的过程。 鉴于新型人形机器人平台的快速引入,允许通用技能迁移的跨形态框架正变得越来越重要。 为了解决这个问题,我们提出了一个可迁移的框架,该框架通过使用统一的数字人体模型作为通用原型来减少数据瓶颈,并绕过在每个新机器人平台上重新训练的需要。 该模型通过对抗模仿从人类演示中学习行为原语,并将复杂的机器人结构分解为功能组件,每个组件独立训练并动态协调。 通过人-物交互图实现任务泛化,并通过特定于形态的运动学运动重定向和动态微调将技能转移到不同的机器人。 我们的框架在五种具有不同配置的人形机器人上进行了验证,展示了稳定的运动操作,并突出了其在减少数据需求和提高跨平台技能迁移效率方面的有效性。

🔬 方法详解

问题定义:现有的人形机器人技能学习方法通常需要大量特定于机器人的训练数据,且难以在不同机器人平台之间迁移。这导致了高昂的开发成本和漫长的部署周期,阻碍了人形机器人在实际场景中的应用。现有方法难以有效利用人类演示数据,并且缺乏对机器人结构差异的有效处理机制。

核心思路:该论文的核心思路是利用一个统一的数字人体模型作为中间表示,将人类演示数据转化为机器人可执行的技能。通过对抗学习从人类演示中提取行为原语,并将机器人结构分解为功能组件进行独立训练,最后通过运动学重定向和动态微调实现技能在不同机器人平台之间的迁移。这种方法避免了为每个机器人平台重新训练的需要,显著降低了数据需求和开发成本。

技术框架:该框架主要包含以下几个模块:1) 人类演示数据收集:收集人类执行任务的演示数据。2) 行为原语学习:通过对抗模仿学习从人类演示数据中提取行为原语,并将其映射到统一的数字人体模型上。3) 机器人结构分解:将复杂的机器人结构分解为功能组件,例如手臂、腿等。4) 组件独立训练:对每个功能组件进行独立训练,使其能够执行相应的行为原语。5) 运动学重定向:将数字人体模型上的行为原语映射到目标机器人平台上,并进行运动学重定向,以适应机器人的具体结构。6) 动态微调:通过动态微调,进一步优化机器人在目标平台上的运动表现。

关键创新:该论文的关键创新在于:1) 统一数字人体模型:使用统一的数字人体模型作为中间表示,实现了人类演示数据和机器人技能之间的桥梁。2) 分解对抗学习:通过分解对抗学习,将复杂的机器人结构分解为功能组件进行独立训练,提高了训练效率和泛化能力。3) 跨形态迁移:通过运动学重定向和动态微调,实现了技能在不同机器人平台之间的迁移。

关键设计:在对抗学习中,使用了生成器和判别器。生成器负责从人类演示数据中学习行为原语,判别器负责区分生成器生成的行为和真实的人类行为。损失函数包括对抗损失、重构损失和正则化损失。运动学重定向使用了逆运动学算法,并考虑了机器人的关节限制。动态微调使用了强化学习算法,以优化机器人在目标平台上的运动表现。

🖼️ 关键图片

📊 实验亮点

该框架在五种不同配置的人形机器人上进行了验证,实验结果表明,该框架能够实现稳定的运动操作,并且显著降低了数据需求。与传统的机器人技能学习方法相比,该框架能够更有效地利用人类演示数据,并实现技能在不同机器人平台之间的迁移,从而大大提高了机器人技能学习的效率和泛化能力。具体性能数据未知。

🎯 应用场景

该研究成果可广泛应用于人形机器人的技能学习和迁移,尤其是在需要快速部署和适应不同机器人平台的场景中,例如:灾难救援、医疗辅助、智能制造等。通过该框架,可以快速将人类的技能迁移到各种人形机器人上,使其能够执行复杂的任务,从而提高工作效率和安全性。未来,该技术有望进一步扩展到其他类型的机器人,实现更广泛的技能共享和迁移。

📄 摘要(原文)

Humanoid robots are envisioned as embodied intelligent agents capable of performing a wide range of human-level loco-manipulation tasks, particularly in scenarios requiring strenuous and repetitive labor. However, learning these skills is challenging due to the high degrees of freedom of humanoid robots, and collecting sufficient training data for humanoid is a laborious process. Given the rapid introduction of new humanoid platforms, a cross-embodiment framework that allows generalizable skill transfer is becoming increasingly critical. To address this, we propose a transferable framework that reduces the data bottleneck by using a unified digital human model as a common prototype and bypassing the need for re-training on every new robot platform. The model learns behavior primitives from human demonstrations through adversarial imitation, and the complex robot structures are decomposed into functional components, each trained independently and dynamically coordinated. Task generalization is achieved through a human-object interaction graph, and skills are transferred to different robots via embodiment-specific kinematic motion retargeting and dynamic fine-tuning. Our framework is validated on five humanoid robots with diverse configurations, demonstrating stable loco-manipulation and highlighting its effectiveness in reducing data requirements and increasing the efficiency of skill transfer across platforms.