Policy Decorator: Model-Agnostic Online Refinement for Large Policy Model

作者: Xiu Yuan, Tongzhou Mu, Stone Tao, Yunhao Fang, Mengke Zhang, Hao Su

分类: cs.RO, cs.AI, cs.LG

发布日期: 2024-12-18

备注: Explore videos, data, code, and more at https://policydecorator.github.io

💡 一句话要点

Policy Decorator:一种模型无关的在线策略优化方法,用于提升大型策略模型。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 模仿学习 在线学习 策略优化 残差策略 强化学习

📋 核心要点

- 模仿学习模型受限于演示数据的数量、质量和多样性,难以达到最优性能。

- Policy Decorator通过在线交互,利用残差策略优化离线模仿学习模型,提升策略性能。

- 实验表明,Policy Decorator能有效提升离线策略,并保持动作平滑性,避免纯强化学习的剧烈行为。

📝 摘要(中文)

本文提出了一种名为Policy Decorator的方法,旨在通过在线交互来改进离线训练的模仿学习模型。该方法利用一个模型无关的残差策略,在在线交互过程中对大型模仿学习模型进行优化。通过实施受控的探索策略,Policy Decorator实现了稳定且具有样本效率的在线学习。在ManiSkill和Adroit两个基准测试的八个任务上的评估结果表明,Policy Decorator能够有效地改进离线训练的策略,并保持模仿学习模型运动的平滑性,避免了纯强化学习策略中常见的行为不稳定问题。更多视频请访问项目主页:https://policydecorator.github.io。

🔬 方法详解

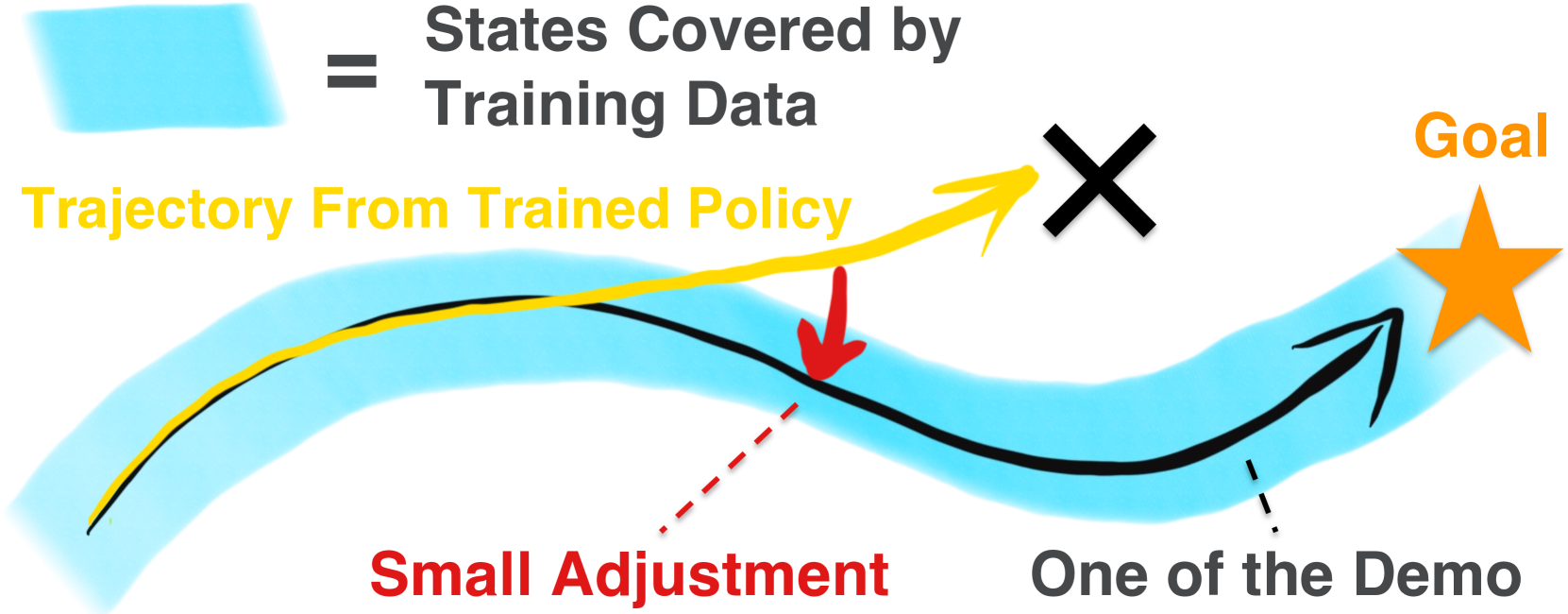

问题定义:现有的大型模仿学习模型虽然可以通过大量演示数据学习到有效的策略,但其性能往往受到演示数据质量和多样性的限制。直接使用强化学习进行微调容易导致策略不稳定,产生剧烈的动作,破坏了模仿学习模型原有的平滑性。因此,如何在保证动作平滑性的前提下,有效地利用在线交互数据提升模仿学习模型的性能是一个关键问题。

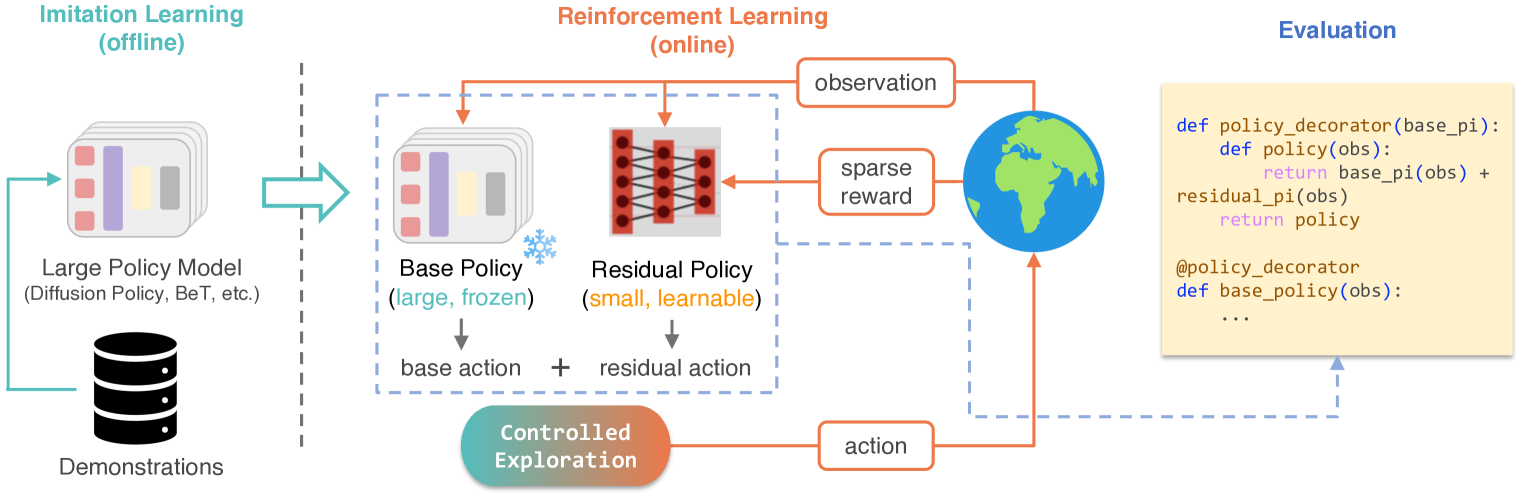

核心思路:Policy Decorator的核心思想是利用一个小的、模型无关的残差策略来修正大型模仿学习模型的输出。这个残差策略只学习对原始策略的微小调整,从而避免了对原始策略的剧烈改变,保证了动作的平滑性。同时,通过精心设计的探索策略,Policy Decorator能够有效地探索环境,收集有用的数据,提升策略性能。

技术框架:Policy Decorator的整体框架包括一个预训练的模仿学习模型和一个残差策略。模仿学习模型负责生成基础动作,残差策略负责对基础动作进行微调。在训练过程中,残差策略通过与环境交互收集数据,并使用强化学习算法进行优化。为了保证训练的稳定性,Policy Decorator采用了受控的探索策略,例如限制残差策略的输出范围,或者使用信任域优化方法。

关键创新:Policy Decorator最重要的创新在于其模型无关的残差策略设计。与直接对大型模仿学习模型进行微调不同,Policy Decorator只学习一个小的残差策略,从而降低了学习难度,提高了训练的稳定性。此外,Policy Decorator的受控探索策略也保证了在线学习的样本效率和安全性。

关键设计:Policy Decorator的关键设计包括残差策略的网络结构、损失函数和探索策略。残差策略通常采用简单的神经网络结构,例如多层感知机。损失函数通常包括强化学习的奖励函数和一个正则化项,用于约束残差策略的输出范围。探索策略可以采用ε-greedy策略或者基于不确定性的探索方法。具体的参数设置需要根据具体的任务进行调整。

🖼️ 关键图片

📊 实验亮点

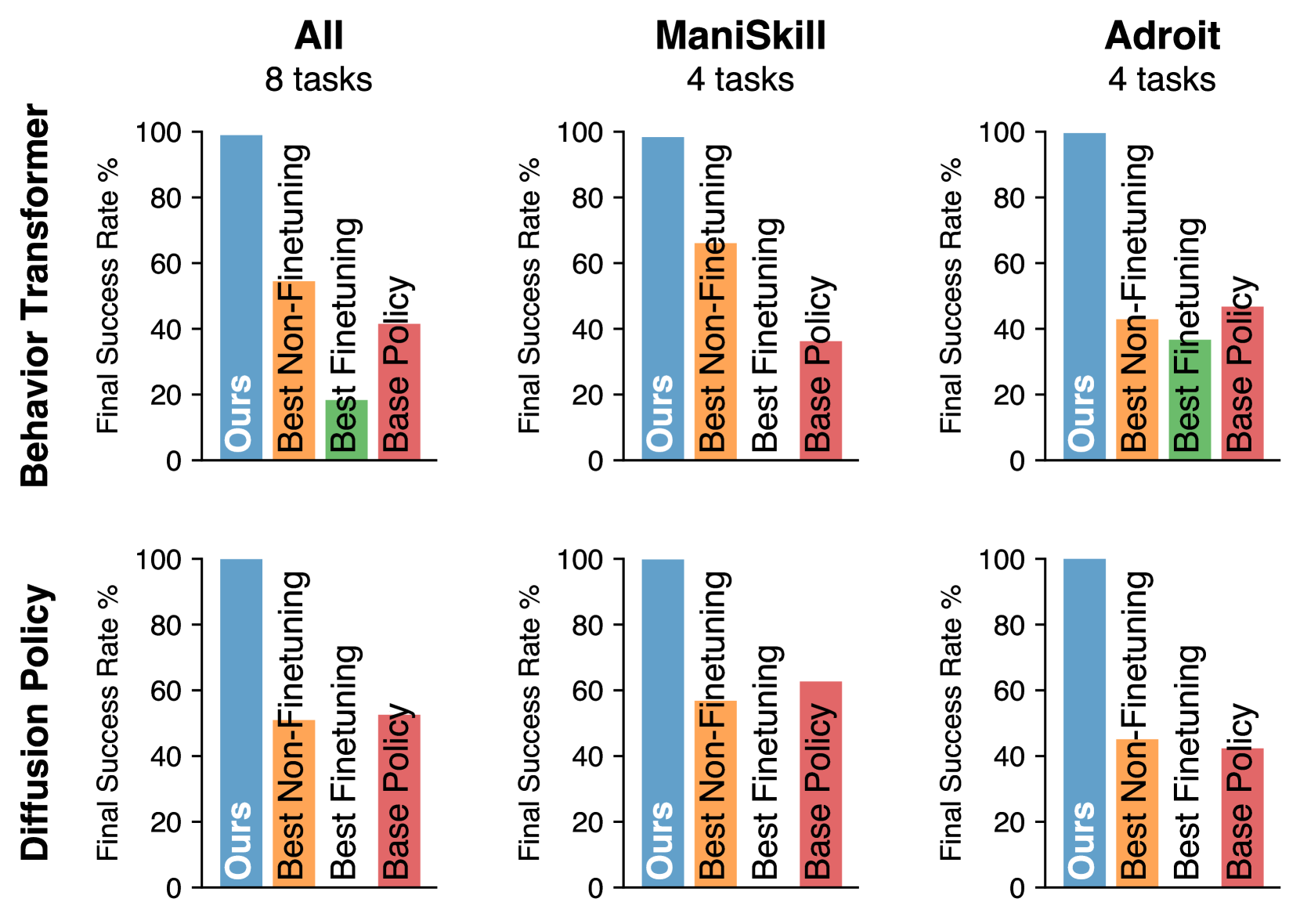

实验结果表明,Policy Decorator在ManiSkill和Adroit两个基准测试的八个任务上均取得了显著的性能提升。与直接使用强化学习进行微调相比,Policy Decorator能够更好地保持动作的平滑性,避免了剧烈的动作。此外,Policy Decorator还具有较高的样本效率,能够在较少的交互次数下达到较好的性能。

🎯 应用场景

Policy Decorator具有广泛的应用前景,可以应用于机器人操作、自动驾驶、游戏AI等领域。它可以帮助提升现有模仿学习模型的性能,使其能够更好地适应复杂多变的环境。此外,Policy Decorator还可以用于快速迁移学习,将已有的策略快速适应到新的任务中,降低开发成本。

📄 摘要(原文)

Recent advancements in robot learning have used imitation learning with large models and extensive demonstrations to develop effective policies. However, these models are often limited by the quantity, quality, and diversity of demonstrations. This paper explores improving offline-trained imitation learning models through online interactions with the environment. We introduce Policy Decorator, which uses a model-agnostic residual policy to refine large imitation learning models during online interactions. By implementing controlled exploration strategies, Policy Decorator enables stable, sample-efficient online learning. Our evaluation spans eight tasks across two benchmarks-ManiSkill and Adroit-and involves two state-of-the-art imitation learning models (Behavior Transformer and Diffusion Policy). The results show Policy Decorator effectively improves the offline-trained policies and preserves the smooth motion of imitation learning models, avoiding the erratic behaviors of pure RL policies. See our project page (https://policydecorator.github.io) for videos.