ExBody2: Advanced Expressive Humanoid Whole-Body Control

作者: Mazeyu Ji, Xuanbin Peng, Fangchen Liu, Jialong Li, Ge Yang, Xuxin Cheng, Xiaolong Wang

分类: cs.RO, cs.AI, cs.LG

发布日期: 2024-12-17 (更新: 2025-03-12)

备注: website: https://exbody2.github.io

💡 一句话要点

提出ExBody2,实现类人机器人的高级表达性全身控制

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱七:动作重定向 (Motion Retargeting)

关键词: 全身控制 类人机器人 运动捕捉 模仿学习 策略迁移

📋 核心要点

- 现有类人机器人难以在保持稳定性的同时,实现富有表现力和动态的全身运动控制。

- ExBody2通过解耦速度跟踪和标志点跟踪,并利用教师策略过滤不可行运动,训练出可迁移的全身控制策略。

- 实验表明,ExBody2能够使机器人在现实世界中执行行走、蹲伏和跳舞等复杂动作,展示了其有效性。

📝 摘要(中文)

本文旨在解决现实世界中类人机器人执行富有表现力和动态的全身运动,同时保持整体稳定性和鲁棒性的挑战。我们提出了一种高级表达性全身控制方法(ExBody2),该方法用于生成全身跟踪控制器,这些控制器在人类运动捕捉数据和模拟数据上进行训练,然后迁移到现实世界。我们引入了一种将整个身体的速度跟踪与身体标志点跟踪解耦的技术。我们使用教师策略来生成更符合机器人运动学的中间数据,并自动过滤掉不可行的全身运动。这种两步法使我们能够生成可以在机器人上部署的学生策略,从而实现行走、蹲伏和跳舞等动作。我们还深入了解了通用性和特定运动的跟踪性能之间的权衡。我们观察到,在少量数据上进行微调后,跟踪性能得到了显著提高,但牺牲了其他运动的性能。

🔬 方法详解

问题定义:论文旨在解决类人机器人在现实环境中进行复杂、动态、富有表现力的全身运动控制问题。现有的方法通常难以兼顾运动的表达性、稳定性和鲁棒性,尤其是在将模拟环境中训练的策略迁移到真实机器人时,会面临运动学约束不匹配和环境干扰等挑战。

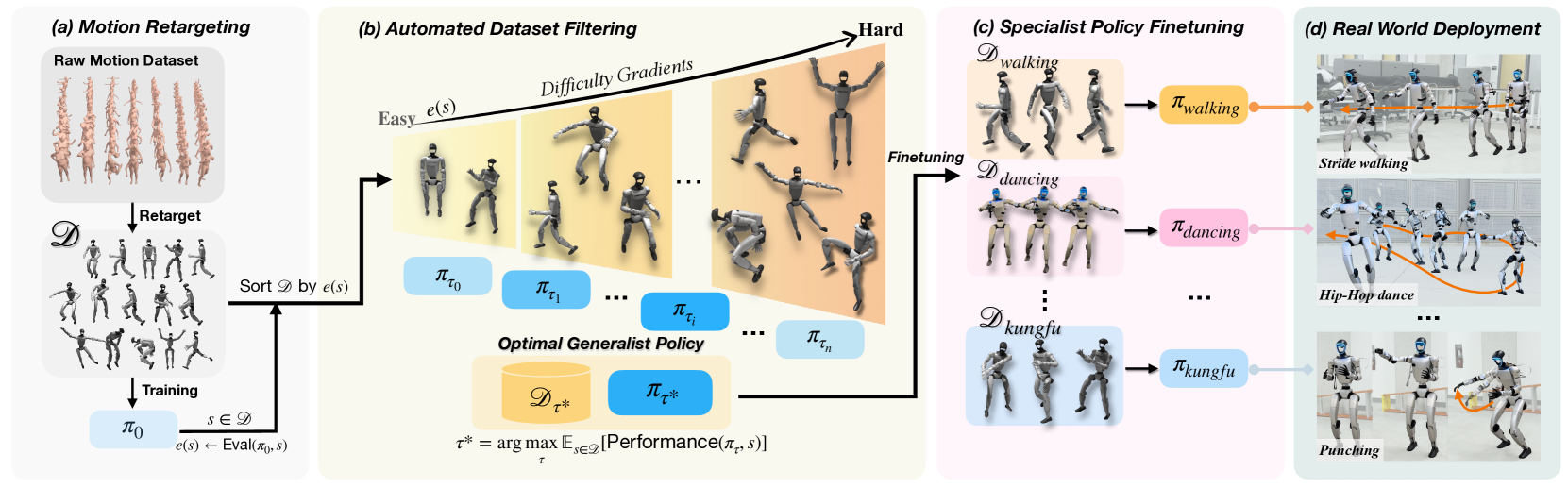

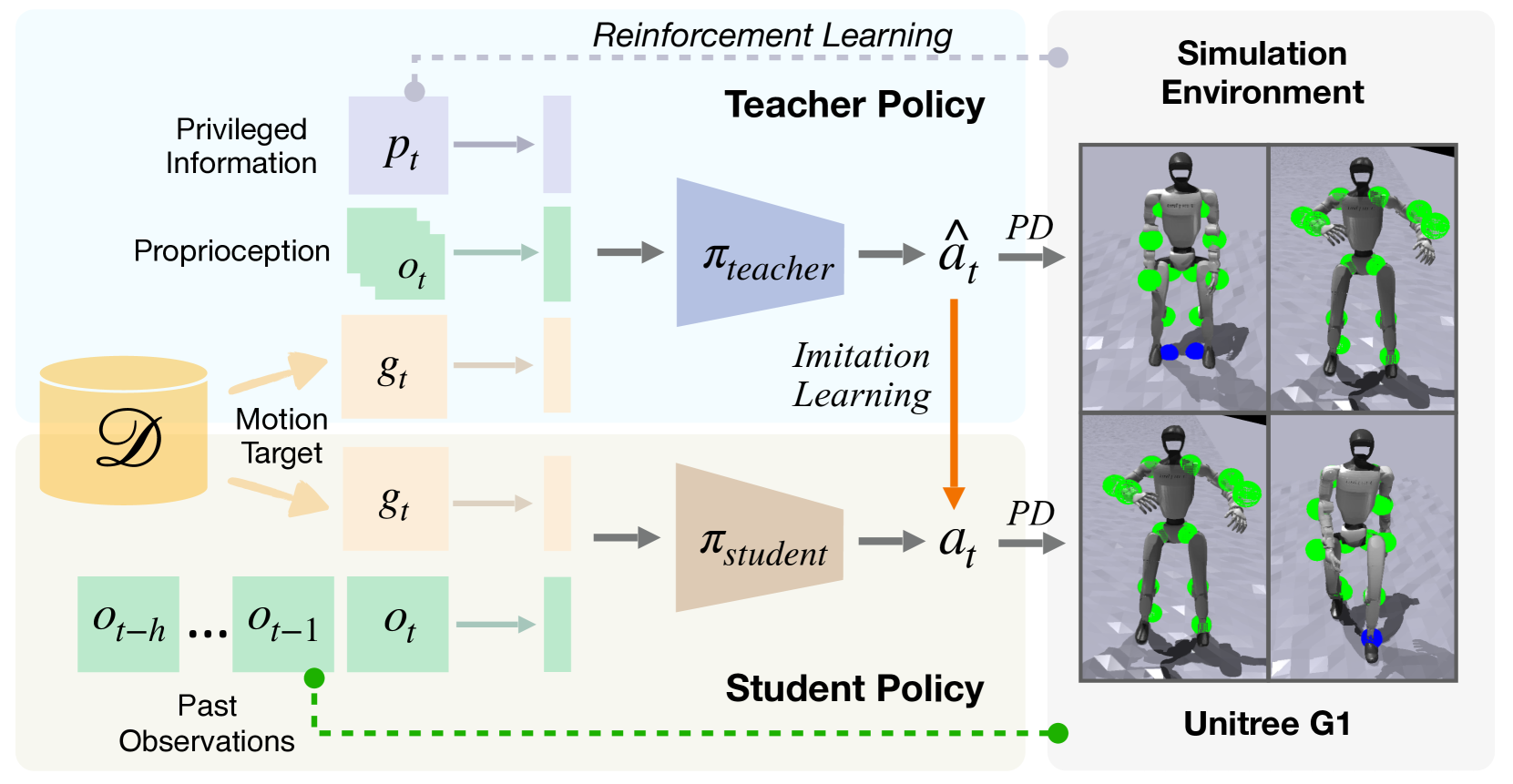

核心思路:论文的核心思路是将全身运动控制问题分解为两个阶段:首先,利用教师策略生成符合机器人运动学约束的中间数据,过滤掉不可行的运动;然后,利用这些数据训练学生策略,使其能够在真实机器人上实现稳定、鲁棒且富有表现力的全身运动。通过解耦速度跟踪和身体标志点跟踪,可以更好地控制机器人的整体运动和姿态。

技术框架:ExBody2的整体框架包含以下几个主要模块:1) 人类运动捕捉数据和模拟数据;2) 教师策略,用于生成符合机器人运动学约束的中间数据;3) 学生策略,用于在真实机器人上执行全身运动控制;4) 解耦的速度跟踪和身体标志点跟踪模块。整个流程是先利用教师策略对原始数据进行处理,生成更适合机器人学习的数据,然后利用这些数据训练学生策略,最后将学生策略部署到真实机器人上。

关键创新:ExBody2的关键创新在于以下几个方面:1) 提出了将全身速度跟踪与身体标志点跟踪解耦的技术,从而更好地控制机器人的整体运动和姿态;2) 利用教师策略自动过滤掉不可行的全身运动,生成更符合机器人运动学约束的中间数据;3) 提出了一种两步训练方法,先训练教师策略,再训练学生策略,从而提高了策略的迁移性和鲁棒性。

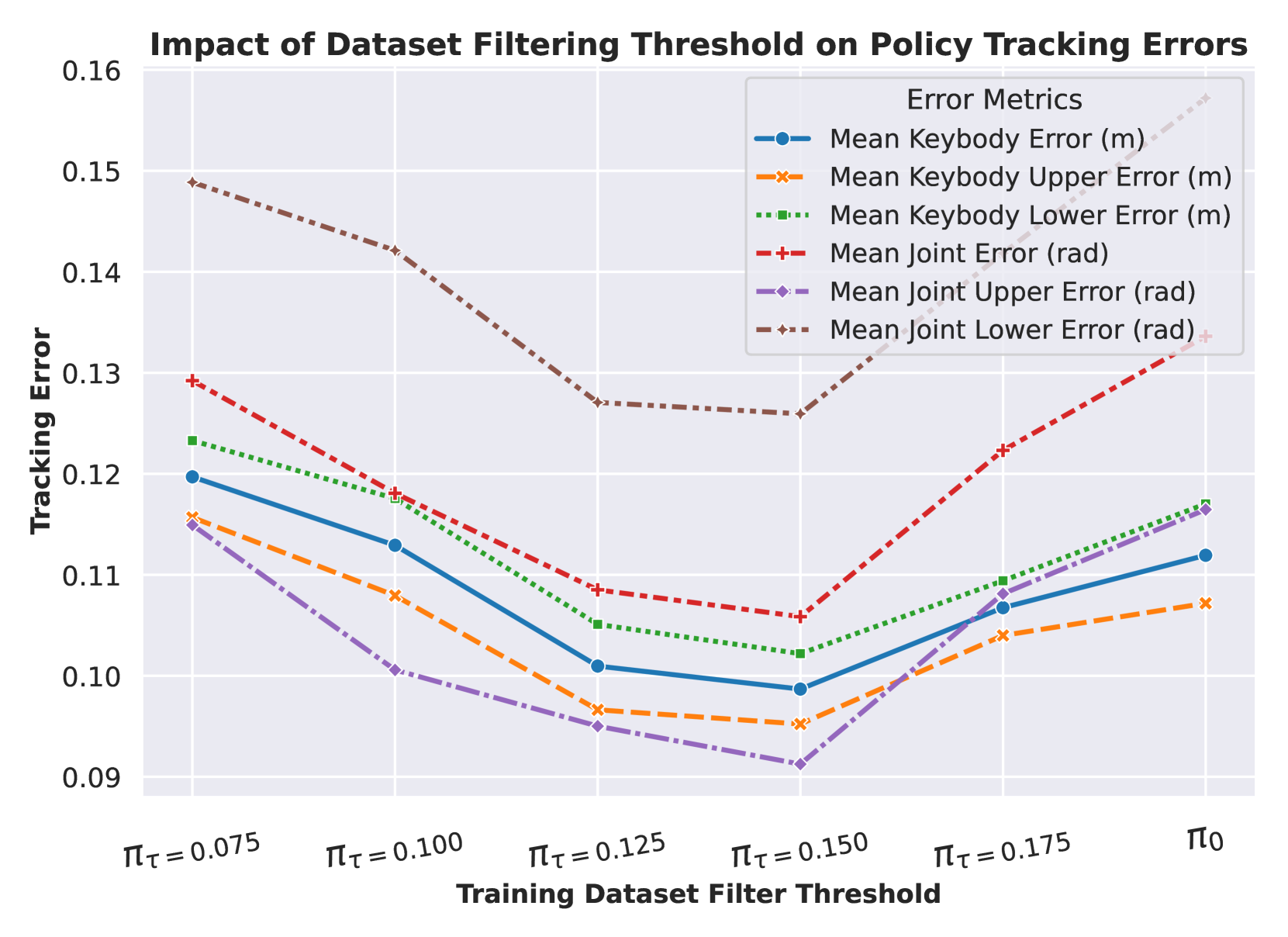

关键设计:论文中涉及的关键设计包括:教师策略和学生策略的网络结构(具体结构未知),用于解耦速度跟踪和标志点跟踪的损失函数设计(具体形式未知),以及用于过滤不可行运动的阈值设置(具体数值未知)。此外,论文还探讨了通用性和特定运动跟踪性能之间的权衡,并指出可以通过在少量数据上进行微调来提高特定运动的跟踪性能。

🖼️ 关键图片

📊 实验亮点

论文通过实验验证了ExBody2的有效性,展示了机器人在现实世界中执行行走、蹲伏和跳舞等复杂动作的能力。虽然论文中没有给出具体的性能数据,但指出在少量数据上进行微调后,特定运动的跟踪性能得到了显著提高。这表明ExBody2具有良好的泛化能力和适应性。

🎯 应用场景

ExBody2技术可应用于服务机器人、娱乐机器人、康复机器人等领域。通过使机器人能够执行更自然、更富有表现力的全身运动,可以提高人机交互的效率和舒适度,增强机器人的实用性和吸引力。该技术还有助于开发更智能、更灵活的机器人,使其能够更好地适应复杂多变的环境。

📄 摘要(原文)

This paper tackles the challenge of enabling real-world humanoid robots to perform expressive and dynamic whole-body motions while maintaining overall stability and robustness. We propose Advanced Expressive Whole-Body Control (Exbody2), a method for producing whole-body tracking controllers that are trained on both human motion capture and simulated data and then transferred to the real world. We introduce a technique for decoupling the velocity tracking of the entire body from tracking body landmarks. We use a teacher policy to produce intermediate data that better conforms to the robot's kinematics and to automatically filter away infeasible whole-body motions. This two-step approach enabled us to produce a student policy that can be deployed on the robot that can walk, crouch, and dance. We also provide insight into the trade-off between versatility and the tracking performance on specific motions. We observed significant improvement of tracking performance after fine-tuning on a small amount of data, at the expense of the others.