Volumetric Mapping with Panoptic Refinement via Kernel Density Estimation for Mobile Robots

作者: Khang Nguyen, Tuan Dang, Manfred Huber

分类: cs.RO, cs.CV

发布日期: 2024-12-15

🔗 代码/项目: GITHUB

💡 一句话要点

提出基于核密度估计的泛视分割优化方法,提升移动机器人三维重建精度

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 三维重建 泛视分割 核密度估计 移动机器人 深度学习

📋 核心要点

- 现有移动机器人三维重建方法在泛视分割中,易受超出分布场景影响,导致掩码过度覆盖对象。

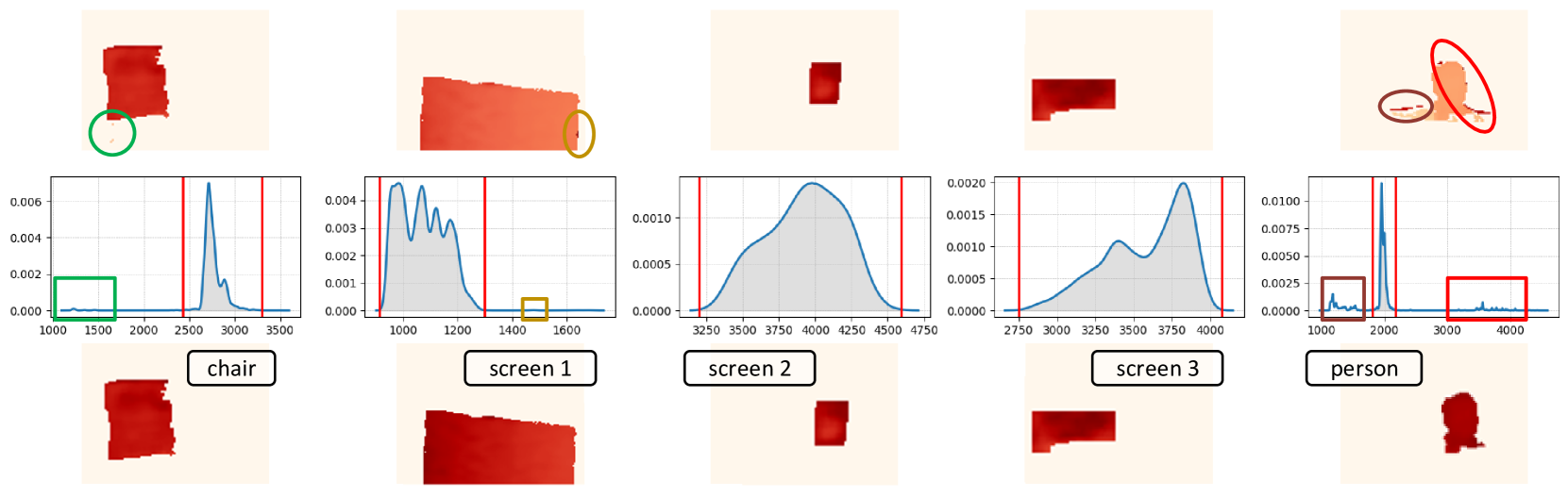

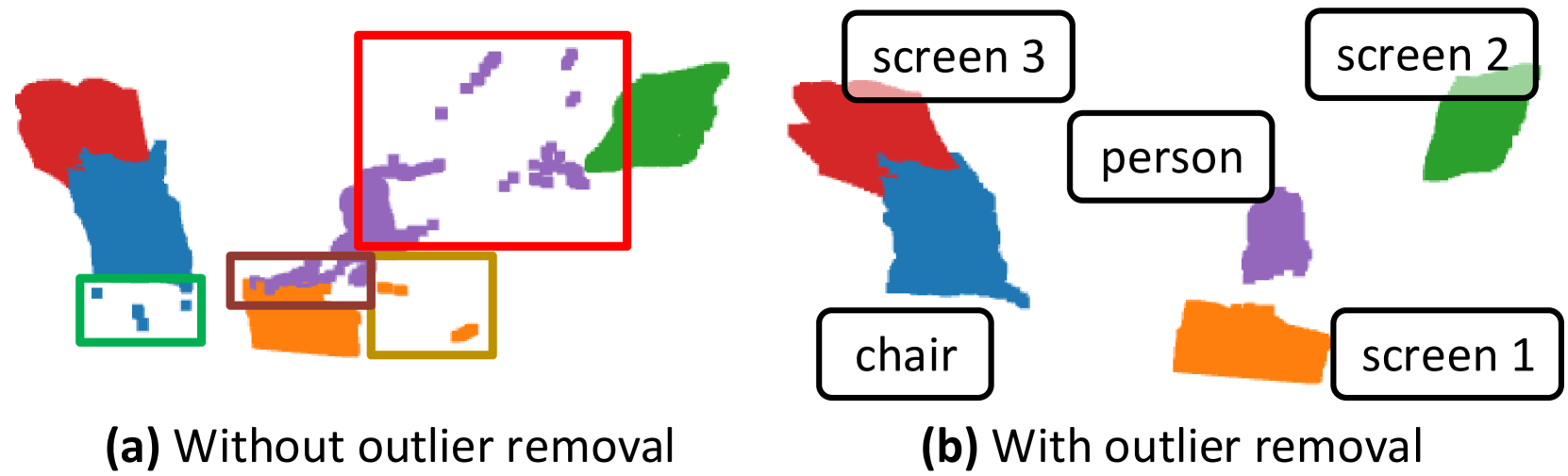

- 论文提出利用核密度估计优化分割掩码,自适应地去除深度感知中的异常值,无需额外参数。

- 实验结果表明,该方法在合成数据集和真实机器人系统上均能有效提升泛视映射的精度和质量。

📝 摘要(中文)

本文提出了一种针对移动机器人三维场景重建中泛视分割质量问题的解决方案。移动机器人通常使用轻量级网络分割RGB图像中的对象,并通过深度图定位它们。然而,这些方法经常遇到超出分布的情况,导致掩码过度覆盖对象。本文通过使用非参数统计方法细化分割误差来解决这个问题。为了提高掩码精度,我们将预测的掩码映射到深度帧中,通过核密度估计来估计它们的分布。然后,以自适应的方式拒绝深度感知中的异常值,而无需额外的参数,从而适应超出分布的情况。最后,使用投影有符号距离函数(SDF)进行三维重建。在合成数据集上的验证表明,该方法在泛视映射的定量和定性结果方面均有所改进。真实世界的测试结果进一步表明,该方法能够部署在真实的机器人系统上。源代码可在https://github.com/mkhangg/refined panoptic mapping 获取。

🔬 方法详解

问题定义:论文旨在解决移动机器人在三维场景重建中,由于泛视分割质量不高导致重建精度下降的问题。现有方法在处理超出分布(out-of-distribution)场景时,容易出现分割掩码过度覆盖对象的情况,从而影响后续的三维重建效果。这种问题在资源受限的移动机器人平台上尤为突出,因为它们通常依赖轻量级网络进行分割,而这些网络的泛化能力有限。

核心思路:论文的核心思路是利用非参数统计方法,特别是核密度估计(Kernel Density Estimation, KDE),来细化分割掩码。通过将预测的掩码投影到深度图像上,并利用KDE估计深度值的分布,可以有效地识别和去除深度感知中的异常值,从而提高掩码的精度。这种方法无需额外的参数调整,能够自适应地处理超出分布的场景。

技术框架:整体框架包括以下几个主要步骤:1) 使用轻量级网络对RGB图像进行泛视分割,得到初始的分割掩码;2) 将分割掩码投影到深度图像上,得到每个像素对应的深度值;3) 使用核密度估计方法估计深度值的分布,并识别异常值;4) 剔除异常值对应的像素,从而细化分割掩码;5) 使用投影有符号距离函数(Projective Signed Distance Function, SDF)进行三维重建。

关键创新:论文的关键创新在于将核密度估计方法应用于泛视分割的优化,从而实现对超出分布场景的自适应处理。与传统的基于参数的方法相比,该方法无需额外的参数调整,能够更好地适应不同的场景和数据分布。此外,该方法还能够有效地去除深度感知中的噪声和异常值,从而提高三维重建的精度。

关键设计:在核密度估计方面,论文可能需要选择合适的核函数(如高斯核)和带宽参数。带宽参数的选择会影响密度估计的平滑程度,需要根据具体的数据分布进行调整。在异常值剔除方面,可以设置一个阈值,将深度值低于或高于该阈值的像素视为异常值。此外,在三维重建方面,论文使用了投影有符号距离函数(SDF),这是一种常用的三维重建方法,能够有效地融合深度信息和分割信息。

🖼️ 关键图片

📊 实验亮点

论文在合成数据集上验证了该方法的有效性,结果表明,该方法能够显著提高泛视映射的精度和质量。此外,论文还在真实机器人系统上进行了测试,结果表明,该方法能够成功部署在实际应用中,并取得良好的效果。虽然论文中没有给出具体的性能数据和对比基线,但定性和定量的结果都表明该方法具有明显的优势。

🎯 应用场景

该研究成果可应用于移动机器人的自主导航、环境感知和物体操作等领域。例如,在仓储物流场景中,机器人可以利用该方法精确识别和定位货架上的商品,从而实现高效的拣选和搬运。在家庭服务机器人领域,该方法可以帮助机器人更好地理解周围环境,从而提供更智能、更安全的服务。此外,该方法还可以应用于增强现实和虚拟现实等领域,为用户提供更逼真的三维场景体验。

📄 摘要(原文)

Reconstructing three-dimensional (3D) scenes with semantic understanding is vital in many robotic applications. Robots need to identify which objects, along with their positions and shapes, to manipulate them precisely with given tasks. Mobile robots, especially, usually use lightweight networks to segment objects on RGB images and then localize them via depth maps; however, they often encounter out-of-distribution scenarios where masks over-cover the objects. In this paper, we address the problem of panoptic segmentation quality in 3D scene reconstruction by refining segmentation errors using non-parametric statistical methods. To enhance mask precision, we map the predicted masks into a depth frame to estimate their distribution via kernel densities. The outliers in depth perception are then rejected without the need for additional parameters in an adaptive manner to out-of-distribution scenarios, followed by 3D reconstruction using projective signed distance functions (SDFs). We validate our method on a synthetic dataset, which shows improvements in both quantitative and qualitative results for panoptic mapping. Through real-world testing, the results furthermore show our method's capability to be deployed on a real-robot system. Our source code is available at: https://github.com/mkhangg/refined panoptic mapping.