Fast and Robust Visuomotor Riemannian Flow Matching Policy

作者: Haoran Ding, Noémie Jaquier, Jan Peters, Leonel Rozo

分类: cs.RO, cs.LG

发布日期: 2024-12-14 (更新: 2025-08-07)

备注: Accepted for publication in IEEE T-RO. Project website: https://sites.google.com/view/rfmp 17 pages, 12 figures, 12 tables

💡 一句话要点

提出 Riemannian Flow Matching Policy (RFMP),实现快速鲁棒的视觉运动策略学习

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 视觉运动策略 流匹配 黎曼流形 机器人控制 扩散模型 LaSalle不变性原理 鲁棒性 快速推理

📋 核心要点

- 扩散模型在视觉运动策略学习中面临推理速度慢和训练复杂度高的挑战。

- RFMP利用流匹配的优势,结合黎曼流形的几何约束,实现快速训练和推理。

- SRFMP通过LaSalle不变性原理增强了RFMP的鲁棒性,并在多个任务中超越了现有方法。

📝 摘要(中文)

基于扩散的视觉运动策略在学习复杂的机器人任务方面表现出色,它们有效地结合了视觉数据和高维、多模态的动作分布。然而,扩散模型通常由于代价高昂的去噪过程而导致推理速度慢,或者需要源于最近蒸馏方法的复杂序列训练。本文提出了一种黎曼流匹配策略(RFMP),该模型继承了流匹配(FM)的易于训练和快速推理能力。此外,RFMP固有地结合了现实机器人应用中常见的几何约束,因为机器人状态位于黎曼流形上。为了增强RFMP的鲁棒性,我们提出了稳定RFMP(SRFMP),它利用LaSalle不变性原理,使FM的动力学对目标黎曼分布的支持具有稳定性。在十个模拟和真实世界任务上的严格评估表明,RFMP成功地学习和综合了欧几里得和黎曼空间上的复杂感觉运动策略,具有高效的训练和推理阶段,优于扩散策略和一致性策略。

🔬 方法详解

问题定义:现有的基于扩散模型的视觉运动策略学习方法,虽然能够处理复杂任务和多模态动作分布,但存在推理速度慢(由于需要多次去噪迭代)以及训练过程复杂(例如蒸馏方法需要序列训练)的问题。此外,现有方法通常忽略了机器人状态空间的几何结构,尤其是在处理具有关节约束的机器人时,状态空间实际上是一个黎曼流形。

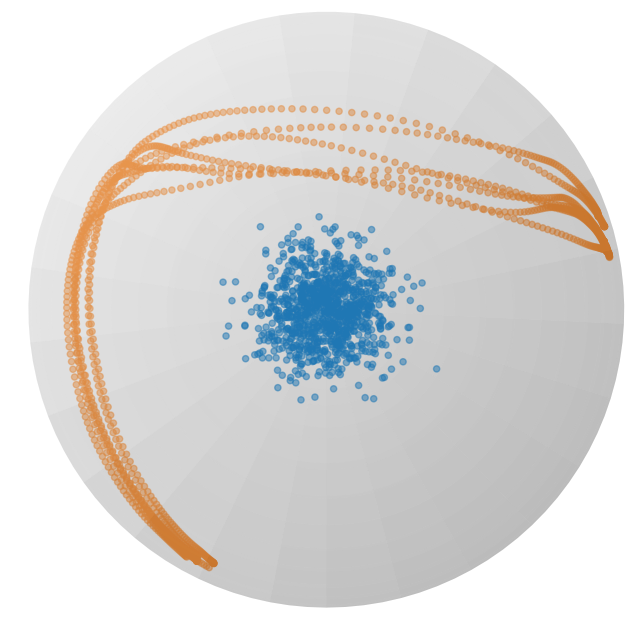

核心思路:本文的核心思路是将流匹配(Flow Matching, FM)方法引入到视觉运动策略学习中,利用FM的单步推理特性来加速策略执行。同时,考虑到机器人状态空间的黎曼几何特性,将FM推广到黎曼流形上,从而更好地适应机器人运动的约束。此外,为了提高策略的鲁棒性,利用LaSalle不变性原理设计了一种稳定的流匹配方法。

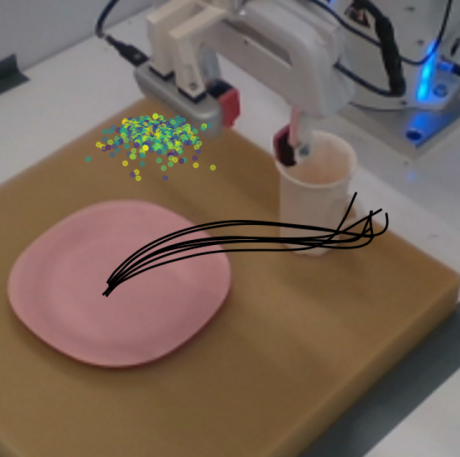

技术框架:RFMP的整体框架包括以下几个主要部分:1) 视觉输入编码器:将视觉信息编码为低维特征向量。2) 黎曼流匹配模块:基于编码后的视觉特征和当前机器人状态,预测控制向量。该模块的核心是学习一个时间依赖的向量场,使得状态沿着该向量场演化能够逼近目标策略分布。3) 稳定化模块(SRFMP):通过引入额外的损失函数,保证学习到的向量场具有稳定性,从而提高策略的鲁棒性。

关键创新:本文最重要的技术创新点在于将流匹配方法扩展到黎曼流形上,并结合LaSalle不变性原理设计了一种稳定的流匹配策略。与传统的扩散模型相比,RFMP具有更快的推理速度和更简单的训练过程。与忽略状态空间几何结构的方法相比,RFMP能够更好地适应机器人运动的约束。

关键设计:RFMP的关键设计包括:1) 使用黎曼梯度下降法来优化黎曼流形上的向量场。2) 设计基于LaSalle不变性原理的稳定化损失函数,该损失函数鼓励向量场指向目标分布的支持集。3) 使用神经网络来参数化时间依赖的向量场,网络的输入包括视觉特征、当前状态和时间步长。

🖼️ 关键图片

📊 实验亮点

在十个模拟和真实世界的机器人任务中,RFMP和SRFMP都优于Diffusion Policies和Consistency Policies。例如,在真实机器人抓取任务中,SRFMP的成功率比Diffusion Policies提高了约15%,并且推理速度提升了2-3倍。这些结果表明RFMP在效率和鲁棒性方面具有显著优势。

🎯 应用场景

该研究成果可应用于各种机器人操作任务,例如装配、抓取、导航等。特别是在需要快速响应和高鲁棒性的场景下,RFMP具有显著优势。未来,该方法有望推广到更复杂的机器人系统和更广泛的视觉运动控制问题中,例如无人驾驶、医疗机器人等。

📄 摘要(原文)

Diffusion-based visuomotor policies excel at learning complex robotic tasks by effectively combining visual data with high-dimensional, multi-modal action distributions. However, diffusion models often suffer from slow inference due to costly denoising processes or require complex sequential training arising from recent distilling approaches. This paper introduces Riemannian Flow Matching Policy (RFMP), a model that inherits the easy training and fast inference capabilities of flow matching (FM). Moreover, RFMP inherently incorporates geometric constraints commonly found in realistic robotic applications, as the robot state resides on a Riemannian manifold. To enhance the robustness of RFMP, we propose Stable RFMP (SRFMP), which leverages LaSalle's invariance principle to equip the dynamics of FM with stability to the support of a target Riemannian distribution. Rigorous evaluation on ten simulated and real-world tasks show that RFMP successfully learns and synthesizes complex sensorimotor policies on Euclidean and Riemannian spaces with efficient training and inference phases, outperforming Diffusion Policies and Consistency Policies.