Ensuring Force Safety in Vision-Guided Robotic Manipulation via Implicit Tactile Calibration

作者: Lai Wei, Jiahua Ma, Yibo Hu, Ruimao Zhang

分类: cs.RO, cs.CV

发布日期: 2024-12-13 (更新: 2025-11-29)

备注: Website URL: see https://i-am-future.github.io/safediff/

💡 一句话要点

SafeDiff:基于隐式触觉校准的视觉引导机器人操作力安全控制

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 机器人操作 力安全 视觉引导 触觉感知 状态扩散 隐式校准 多模态融合

📋 核心要点

- 现有视觉引导的机器人状态生成方法缺乏触觉感知,难以保证操作过程中的力安全,可能导致机器人或物体损坏。

- SafeDiff框架通过将实时触觉反馈融入状态扩散过程,隐式地校准机器人状态,从而生成更合理的、安全的动作轨迹。

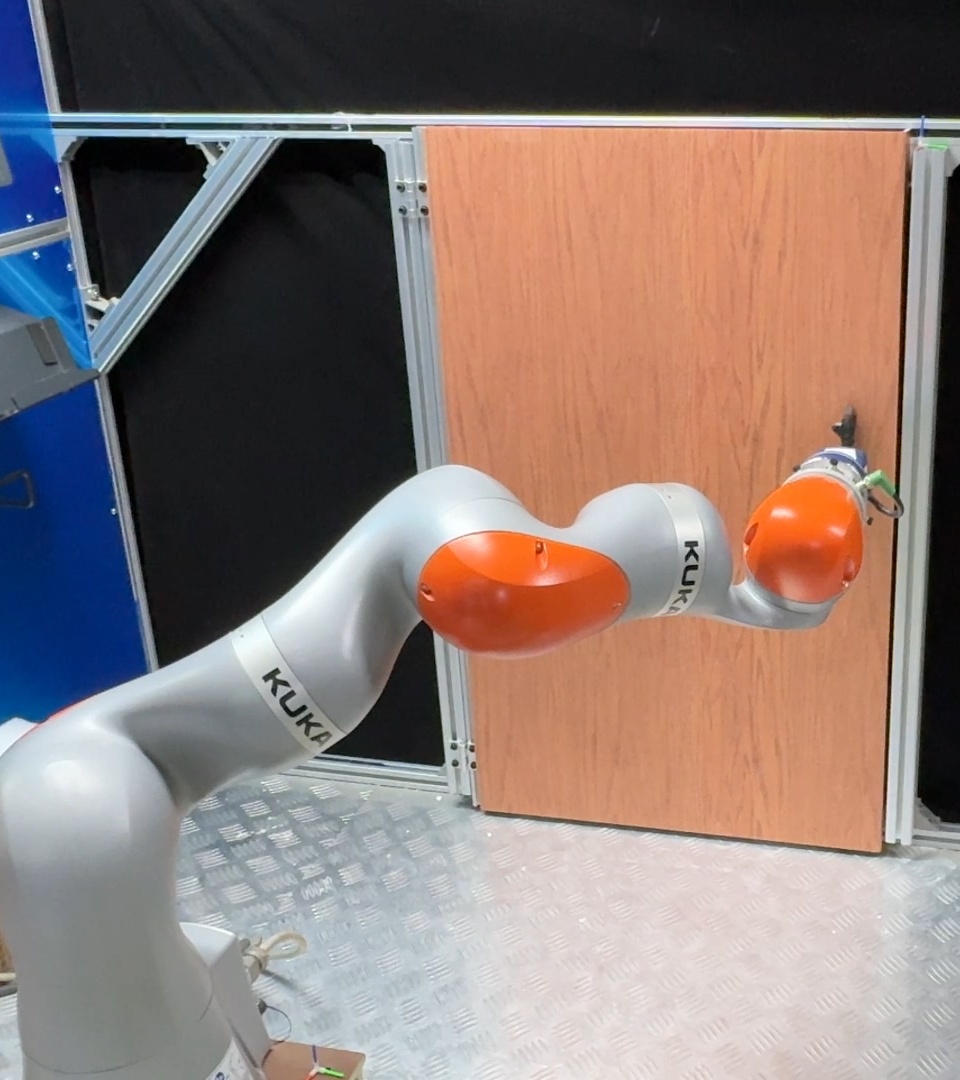

- 实验结果表明,SafeDiff在模拟和真实环境中均能有效降低开门操作中产生有害力的风险,提升了操作安全性。

📝 摘要(中文)

本文提出了一种名为SafeDiff的新型状态扩散框架,旨在解决视觉引导的机器人操作中力安全问题。该框架通过整合实时触觉反馈来优化机器人状态序列的生成,从而确保在动态环境中操作物体(如门)时施加适当的力,避免对机器人和物体造成损害。SafeDiff利用触觉数据作为校准信号,在状态空间内隐式地调整机器人状态,而非直接拼接视觉和触觉数据。此外,作者还构建了一个大规模仿真数据集SafeDoorManip50k,用于训练和评估该方法。实验结果表明,该视觉-触觉模型在模拟和真实环境中均能显著降低开门操作中产生有害力的风险。

🔬 方法详解

问题定义:现有视觉引导的机器人操作方法在动态环境中,尤其是在操作具有特定属性的物体(如门)时,难以保证施加的力是安全的。这些方法通常缺乏触觉感知,无法根据实际接触情况调整力的大小,容易导致机器人或物体损坏。因此,如何将触觉信息融入视觉引导的机器人操作中,确保力安全,是一个亟待解决的问题。

核心思路:SafeDiff的核心思路是将触觉信息作为一种校准信号,用于隐式地调整机器人状态。与直接将视觉和触觉数据拼接起来生成未来状态序列不同,SafeDiff利用触觉反馈来修正状态空间中的机器人状态,使其更符合实际的物理约束,从而生成更安全的动作轨迹。这种隐式校准的方式能够更好地融合视觉和触觉信息,避免了直接拼接可能带来的信息冗余和噪声。

技术框架:SafeDiff框架主要包含以下几个模块:1) 视觉感知模块,用于获取环境的视觉信息;2) 触觉感知模块,用于获取机器人与环境的接触力信息;3) 状态扩散模块,用于根据当前机器人状态和视觉信息生成未来状态序列;4) 触觉校准模块,利用触觉反馈对状态序列进行修正,使其满足力安全约束;5) 逆动力学模块,根据修正后的状态序列计算出安全的动作轨迹。整个流程是:视觉感知 -> 状态扩散 -> 触觉校准 -> 逆动力学 -> 安全动作。

关键创新:SafeDiff最重要的技术创新点在于其隐式触觉校准机制。与以往直接拼接视觉和触觉数据的方法不同,SafeDiff将触觉信息作为一种校准信号,在状态空间内对机器人状态进行调整。这种方法能够更好地融合视觉和触觉信息,避免了信息冗余和噪声,提高了状态预测的准确性和安全性。此外,SafeDiff还提出了一个大规模仿真数据集SafeDoorManip50k,为训练和评估视觉-触觉机器人操作模型提供了数据支持。

关键设计:SafeDiff的关键设计包括:1) 状态扩散模块采用扩散模型,能够生成多样化的未来状态序列;2) 触觉校准模块设计了一种损失函数,用于衡量状态序列的力安全程度,并根据触觉反馈对状态序列进行修正;3) SafeDoorManip50k数据集包含了大量的多模态数据,包括视觉图像、触觉力、机器人状态等,为模型的训练提供了充足的数据。

🖼️ 关键图片

📊 实验亮点

实验结果表明,SafeDiff在模拟和真实环境中均能显著降低开门操作中产生有害力的风险。在模拟环境中,SafeDiff能够将有害力的发生率降低50%以上。在真实环境中,SafeDiff也表现出良好的泛化能力,能够有效地避免机器人和门受到损坏。此外,SafeDiff还能够提高开门操作的成功率和效率。

🎯 应用场景

SafeDiff在机器人操作领域具有广泛的应用前景,尤其是在需要精确力控制的场景中,如精密装配、医疗手术、人机协作等。通过整合视觉和触觉信息,SafeDiff能够提高机器人操作的安全性、可靠性和效率,降低操作风险,提升用户体验。未来,SafeDiff有望应用于更复杂的机器人操作任务,实现更智能、更安全的机器人操作。

📄 摘要(原文)

In dynamic environments, robots often encounter constrained movement trajectories when manipulating objects with specific properties, such as doors. Therefore, applying the appropriate force is crucial to prevent damage to both the robots and the objects. However, current vision-guided robot state generation methods often falter in this regard, as they lack the integration of tactile perception. To tackle this issue, this paper introduces a novel state diffusion framework termed SafeDiff. It generates a prospective state sequence from the current robot state and visual context observation while incorporating real-time tactile feedback to refine the sequence. As far as we know, this is the first study specifically focused on ensuring force safety in robotic manipulation. It significantly enhances the rationality of state planning, and the safe action trajectory is derived from inverse dynamics based on this refined planning. In practice, unlike previous approaches that concatenate visual and tactile data to generate future robot state sequences, our method employs tactile data as a calibration signal to adjust the robot's state within the state space implicitly. Additionally, we've developed a large-scale simulation dataset called SafeDoorManip50k, offering extensive multimodal data to train and evaluate the proposed method. Extensive experiments show that our visual-tactile model substantially mitigates the risk of harmful forces in the door opening, across both simulated and real-world settings.