Subspace-wise Hybrid RL for Articulated Object Manipulation

作者: Yujin Kim, Sol Choi, Bum-Jae You, Keunwoo Jang, Yisoo Lee

分类: cs.RO

发布日期: 2024-12-11

备注: 14 pages, 10 figures, Submitted to Robotics and Autonomous Systems

💡 一句话要点

提出子空间混合强化学习(SwRL)框架,解决铰接物体操作中的复杂控制问题。

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱二:RL算法与架构 (RL & Architecture)

关键词: 铰接物体操作 强化学习 子空间学习 机器人控制 自适应控制

📋 核心要点

- 铰接物体操作因其复杂性和未知动力学而极具挑战,传统强化学习方法难以在整个任务空间中有效学习控制策略。

- 论文提出SwRL框架,将任务空间划分为多个子空间,并为每个子空间学习独立的策略,实现自适应力调节。

- 实验结果表明,该方法提高了学习效率和任务执行性能,并在仿真和真实世界环境中得到验证。

📝 摘要(中文)

铰接物体操作是一项具有挑战性的任务,它需要受约束的运动和自适应控制来处理被操作物体的未知动力学。强化学习(RL)已被广泛用于解决各种场景和类型的铰接物体,但这些任务的复杂性源于多个相互交织的目标,使得在整个任务空间中学习控制策略非常困难。为了解决这个问题,我们提出了一种子空间混合强化学习(SwRL)框架,该框架基于独立的目标,为每个划分的任务空间或子空间学习策略。这种方法能够进行自适应的力调节,以适应物体的未知动力学。此外,它有效地利用了先前被忽视的冗余子空间,从而最大限度地提高了机器人的灵活性。通过仿真和真实世界的实验验证,我们的方法提高了学习效率和任务执行性能。

🔬 方法详解

问题定义:铰接物体操作任务复杂,涉及多个相互关联的目标,直接在整个任务空间中学习控制策略非常困难。现有的强化学习方法难以有效处理铰接物体的未知动力学和约束运动,导致学习效率低下和任务执行性能不佳。

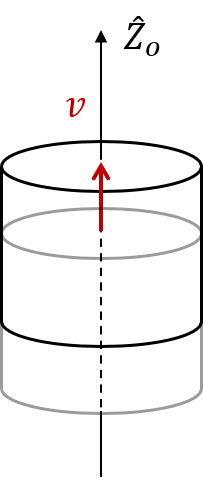

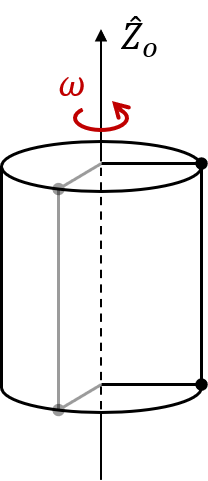

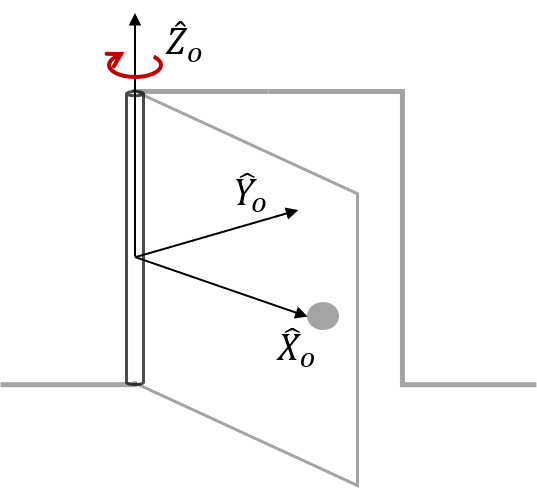

核心思路:将复杂的任务空间分解为多个独立的子空间,每个子空间对应一个特定的操作目标。通过为每个子空间学习独立的控制策略,可以简化学习过程,并允许对每个子空间进行自适应的力调节,从而更好地适应铰接物体的未知动力学。同时,充分利用机器人冗余的自由度,提升操作的灵活性。

技术框架:SwRL框架包含以下主要模块:1) 子空间划分模块:将整个任务空间划分为多个子空间,每个子空间对应一个特定的操作目标。2) 策略学习模块:为每个子空间独立地学习一个强化学习策略,该策略旨在优化该子空间内的操作性能。3) 策略融合模块:将各个子空间的策略进行融合,形成一个完整的控制策略,用于控制机器人的运动。

关键创新:SwRL的核心创新在于将任务空间分解为多个子空间,并为每个子空间学习独立的策略。这种方法能够简化学习过程,并允许对每个子空间进行自适应的力调节,从而更好地适应铰接物体的未知动力学。此外,该方法还充分利用了机器人冗余的自由度,提升操作的灵活性。

关键设计:论文中使用了特定的强化学习算法(具体算法未知)来学习每个子空间的策略。损失函数的设计需要考虑每个子空间的操作目标,例如,最小化操作误差、最大化操作速度等。网络结构的设计需要能够有效地表示每个子空间的策略,并能够进行自适应的力调节。具体参数设置未知。

🖼️ 关键图片

📊 实验亮点

该论文通过仿真和真实世界的实验验证了SwRL框架的有效性。实验结果表明,与传统的强化学习方法相比,SwRL框架能够显著提高学习效率和任务执行性能。具体的性能数据和提升幅度未知,但论文强调了在复杂铰接物体操作任务上的优势。

🎯 应用场景

该研究成果可应用于各种铰接物体操作场景,例如机器人装配、医疗手术、家庭服务等。通过提高机器人操作的灵活性和适应性,可以实现更高效、更安全、更智能的自动化操作,具有重要的实际应用价值和广阔的未来发展前景。

📄 摘要(原文)

Articulated object manipulation is a challenging task, requiring constrained motion and adaptive control to handle the unknown dynamics of the manipulated objects. While reinforcement learning (RL) has been widely employed to tackle various scenarios and types of articulated objects, the complexity of these tasks, stemming from multiple intertwined objectives makes learning a control policy in the full task space highly difficult. To address this issue, we propose a Subspace-wise hybrid RL (SwRL) framework that learns policies for each divided task space, or subspace, based on independent objectives. This approach enables adaptive force modulation to accommodate the unknown dynamics of objects. Additionally, it effectively leverages the previously underlooked redundant subspace, thereby maximizing the robot's dexterity. Our method enhances both learning efficiency and task execution performance, as validated through simulations and real-world experiments. Supplementary video is available at https://youtu.be/PkNxv0P8Atk