THUD++: Large-Scale Dynamic Indoor Scene Dataset and Benchmark for Mobile Robots

作者: Zeshun Li, Fuhao Li, Wanting Zhang, Zijie Zheng, Xueping Liu, Yongjin Liu, Long Zeng

分类: cs.RO

发布日期: 2024-12-11

备注: arXiv admin note: substantial text overlap with arXiv:2406.19791

💡 一句话要点

THUD++:用于移动机器人的大规模动态室内场景数据集与基准

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 动态场景理解 移动机器人 室内数据集 3D物体检测 行人轨迹预测

📋 核心要点

- 现有移动机器人数据集主要关注静态场景,难以评估机器人在动态环境中的性能。

- THUD++数据集结合真实数据和仿真数据,提供大规模动态室内场景,包含RGB-D图像、物体标注、相机位姿和行人轨迹。

- 实验表明,在THUD++数据集上评估现有方法,可以有效揭示移动机器人在复杂动态环境中面临的挑战。

📝 摘要(中文)

本文提出了一个面向移动机器人的大规模室内动态场景数据集THUD++,旨在解决现有数据集主要关注静态场景,难以评估机器人在动态环境中性能的问题。该数据集包含13个大规模动态场景,结合了真实机器人平台采集的真实数据和物理仿真平台生成的合成数据。RGB-D数据集包含超过9万帧图像,2000万个静态和动态物体的2D/3D bounding box标注,相机位姿和IMU数据。轨迹数据集包含室内场景中超过6000条行人轨迹。此外,该数据集还提供了一个基于Unity3D的仿真平台,允许研究人员创建自定义场景并在受控环境中测试算法。论文在THUD++上评估了最先进的室内场景理解方法,例如3D物体检测、语义分割、重定位、行人轨迹预测和导航。实验结果突出了移动机器人在复杂、拥挤和动态的室内环境中遇到的挑战。通过共享该数据集,旨在加速移动机器人算法的开发和测试,从而促进实际机器人应用。

🔬 方法详解

问题定义:现有移动机器人数据集主要集中于静态环境,缺乏对动态场景的有效支持。这使得评估和提升机器人在真实动态环境中的感知、导航和决策能力变得困难。现有方法在静态数据集上表现良好,但在动态场景中性能显著下降,无法满足实际应用需求。

核心思路:THUD++数据集的核心思路是构建一个大规模、多样化的动态室内场景数据集,包含真实数据和合成数据,以全面评估和提升移动机器人在动态环境中的性能。通过提供丰富的标注信息和仿真平台,促进相关算法的开发和测试。

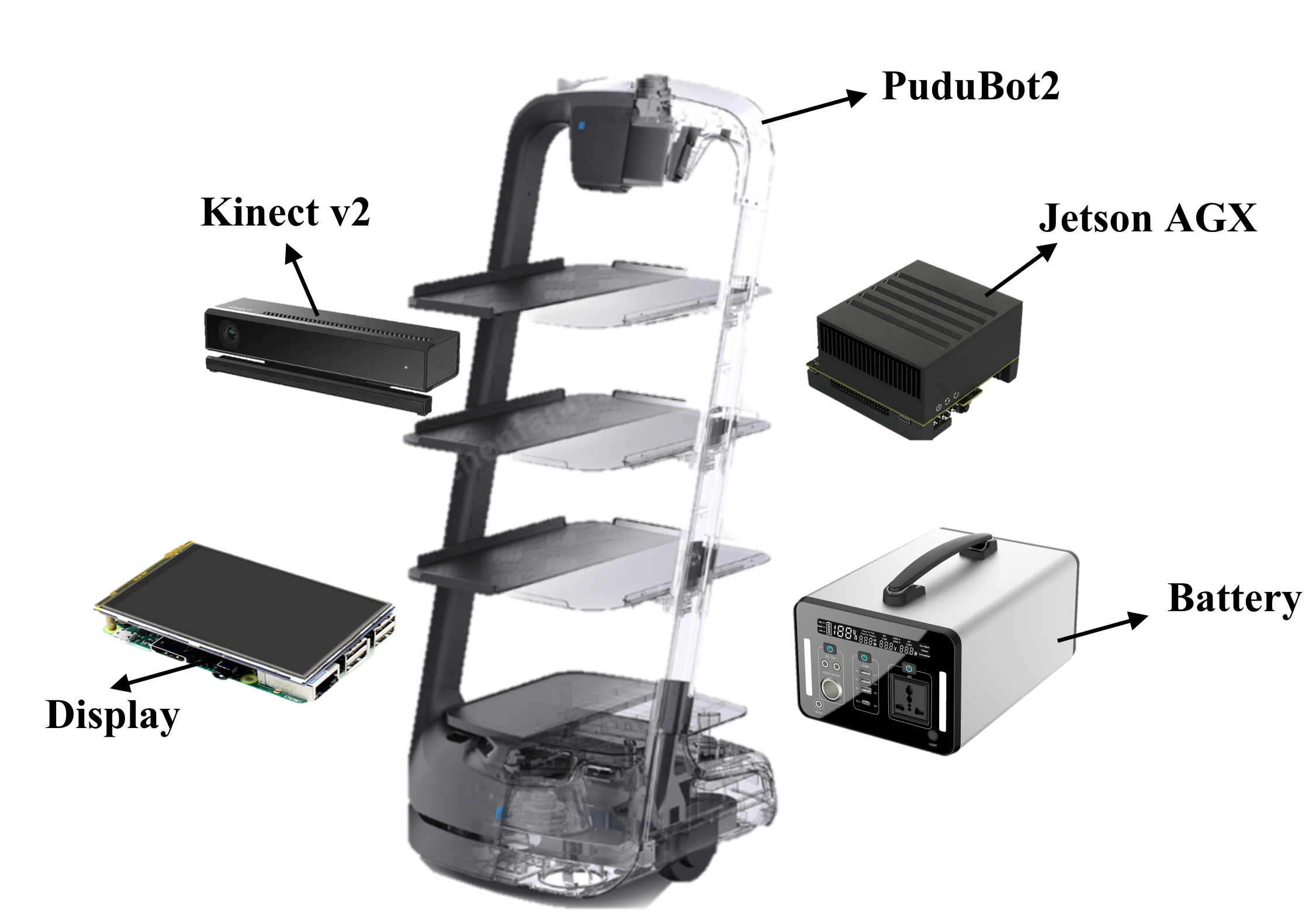

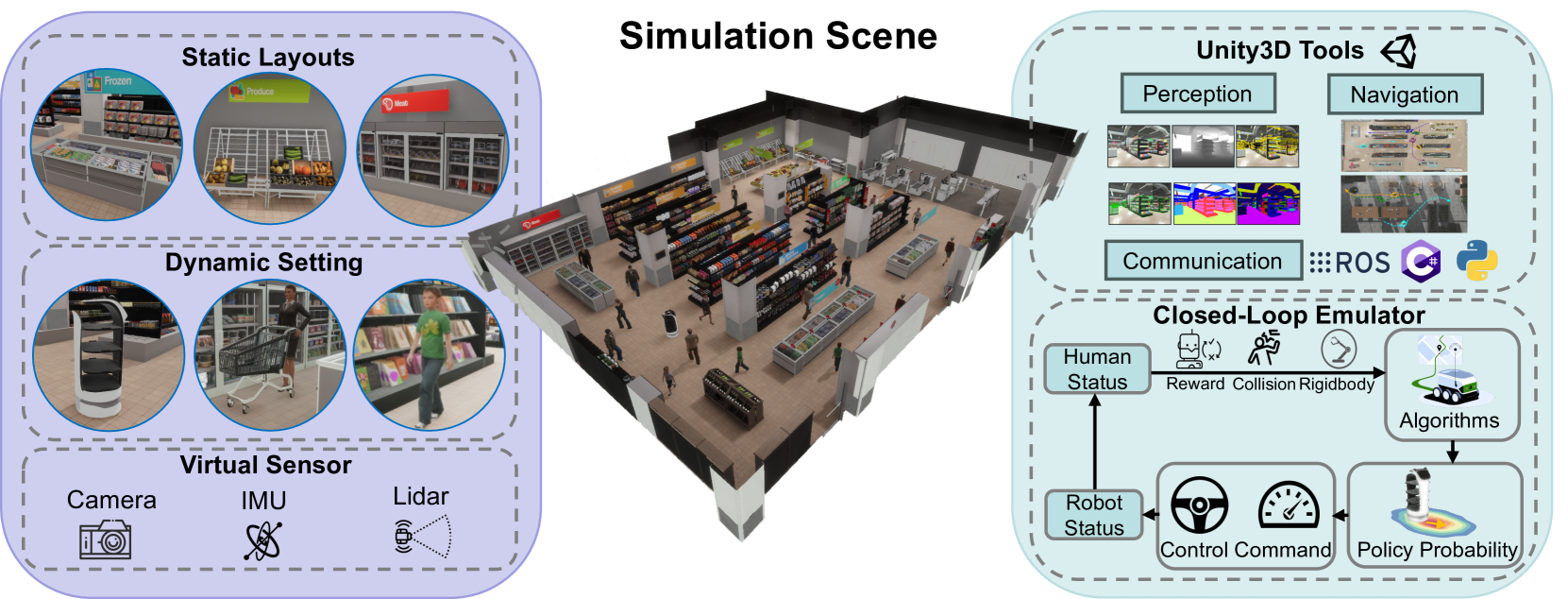

技术框架:THUD++数据集的构建包含以下几个主要部分:1) 数据采集:使用真实机器人平台采集真实室内场景数据,并使用物理仿真平台生成合成数据。2) 数据标注:对RGB-D图像进行2D/3D bounding box标注,标注静态和动态物体,并提供相机位姿和IMU数据。3) 行人轨迹数据:记录室内场景中行人的运动轨迹。4) 仿真平台:提供基于Unity3D的仿真平台,允许用户自定义场景和测试算法。

关键创新:THUD++数据集的关键创新在于其大规模和动态性。与现有数据集相比,THUD++包含更多的动态场景和行人轨迹数据,更真实地反映了移动机器人在实际环境中遇到的挑战。此外,提供的仿真平台允许在受控环境中进行算法测试和验证。

关键设计:在数据采集方面,THUD++采用了多种传感器,包括RGB-D相机和IMU,以获取全面的环境信息。在数据标注方面,采用了人工标注和自动标注相结合的方法,以提高标注效率和准确性。在仿真平台方面,采用了Unity3D引擎,可以模拟真实的物理环境和行人行为。

🖼️ 关键图片

📊 实验亮点

论文在THUD++数据集上评估了多种主流的室内场景理解算法,包括3D物体检测、语义分割、重定位、行人轨迹预测和导航。实验结果表明,现有算法在动态场景中的性能显著下降,尤其是在拥挤和复杂的环境中。例如,在行人轨迹预测任务中,现有方法的预测精度明显低于静态场景。这些实验结果突出了THUD++数据集的价值,并为未来的研究方向提供了指导。

🎯 应用场景

THUD++数据集可广泛应用于移动机器人、自动驾驶、智能监控等领域。通过该数据集,研究人员可以开发和测试更鲁棒、更高效的动态场景感知、导航和决策算法,从而提升机器人在复杂环境中的自主性和适应性。该数据集有助于推动机器人技术在物流、服务、医疗等行业的实际应用。

📄 摘要(原文)

Most existing mobile robotic datasets primarily capture static scenes, limiting their utility for evaluating robotic performance in dynamic environments. To address this, we present a mobile robot oriented large-scale indoor dataset, denoted as THUD++ (TsingHua University Dynamic) robotic dataset, for dynamic scene understanding. Our current dataset includes 13 large-scale dynamic scenarios, combining both real-world and synthetic data collected with a real robot platform and a physical simulation platform, respectively. The RGB-D dataset comprises over 90K image frames, 20M 2D/3D bounding boxes of static and dynamic objects, camera poses, and IMU. The trajectory dataset covers over 6,000 pedestrian trajectories in indoor scenes. Additionally, the dataset is augmented with a Unity3D-based simulation platform, allowing researchers to create custom scenes and test algorithms in a controlled environment. We evaluate state-of-the-art methods on THUD++ across mainstream indoor scene understanding tasks, e.g., 3D object detection, semantic segmentation, relocalization, pedestrian trajectory prediction, and navigation. Our experiments highlight the challenges mobile robots encounter in indoor environments, especially when navigating in complex, crowded, and dynamic scenes. By sharing this dataset, we aim to accelerate the development and testing of mobile robot algorithms, contributing to real-world robotic applications.