Intelligent Control of Robotic X-ray Devices using a Language-promptable Digital Twin

作者: Benjamin D. Killeen, Anushri Suresh, Catalina Gomez, Blanca Inigo, Christopher Bailey, Mathias Unberath

分类: cs.RO, cs.AI, cs.CV, cs.HC, cs.LG

发布日期: 2024-12-11

💡 一句话要点

提出基于语言提示的数字孪生方法,实现机器人X射线设备的智能控制

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 机器人X射线 自然语言控制 数字孪生 语言提示 图像分割

📋 核心要点

- 现有语言控制机器人X射线系统依赖于固定的AI模型输出,限制了其功能和灵活性。

- 该方法利用语言对齐的基础模型进行X射线图像分割,持续更新患者的数字孪生模型,实现自主控制。

- 实验结果表明,该系统能够通过语音命令实现对解剖结构的定位、可视化和准直,并取得了较高的成功率。

📝 摘要(中文)

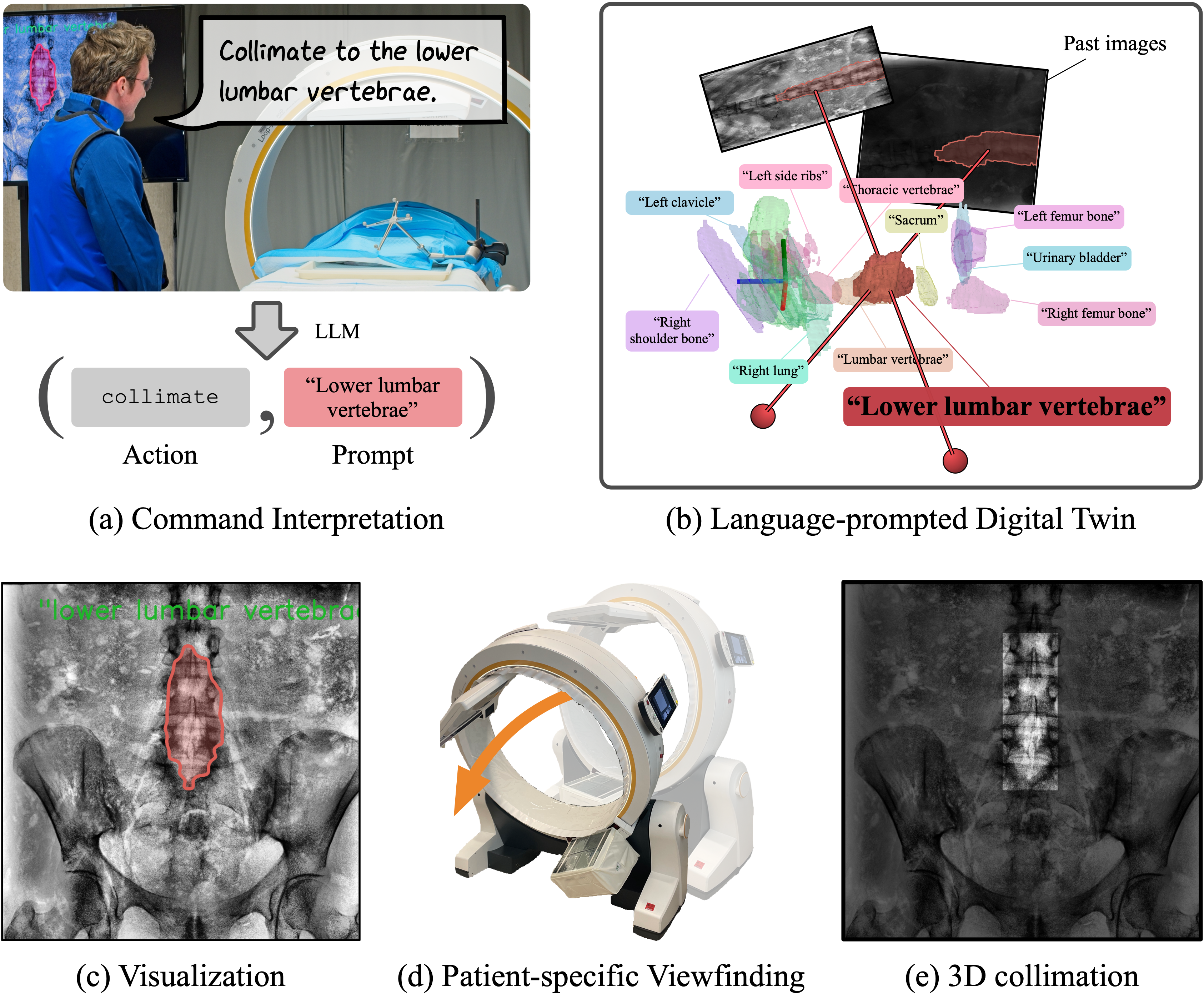

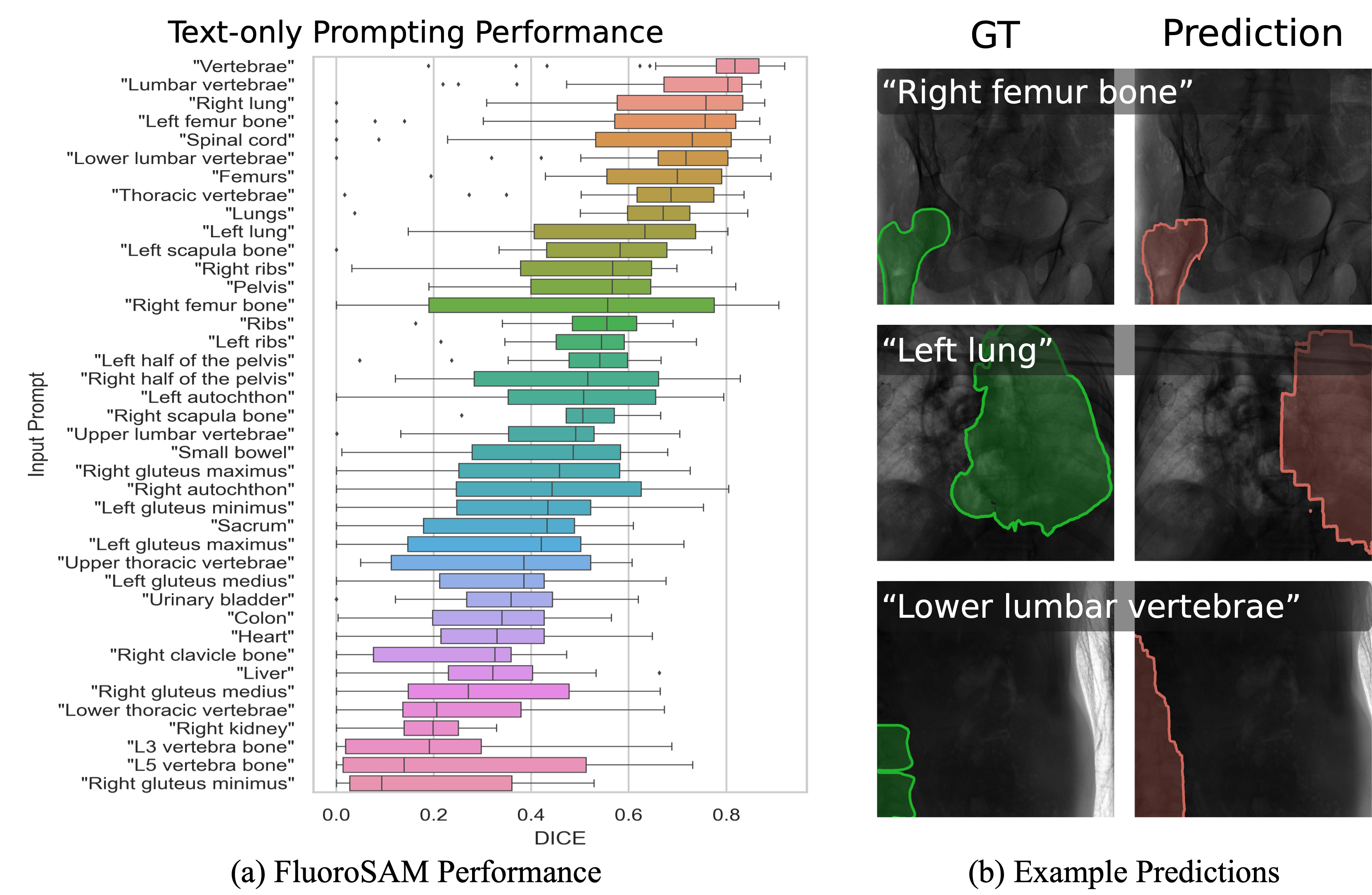

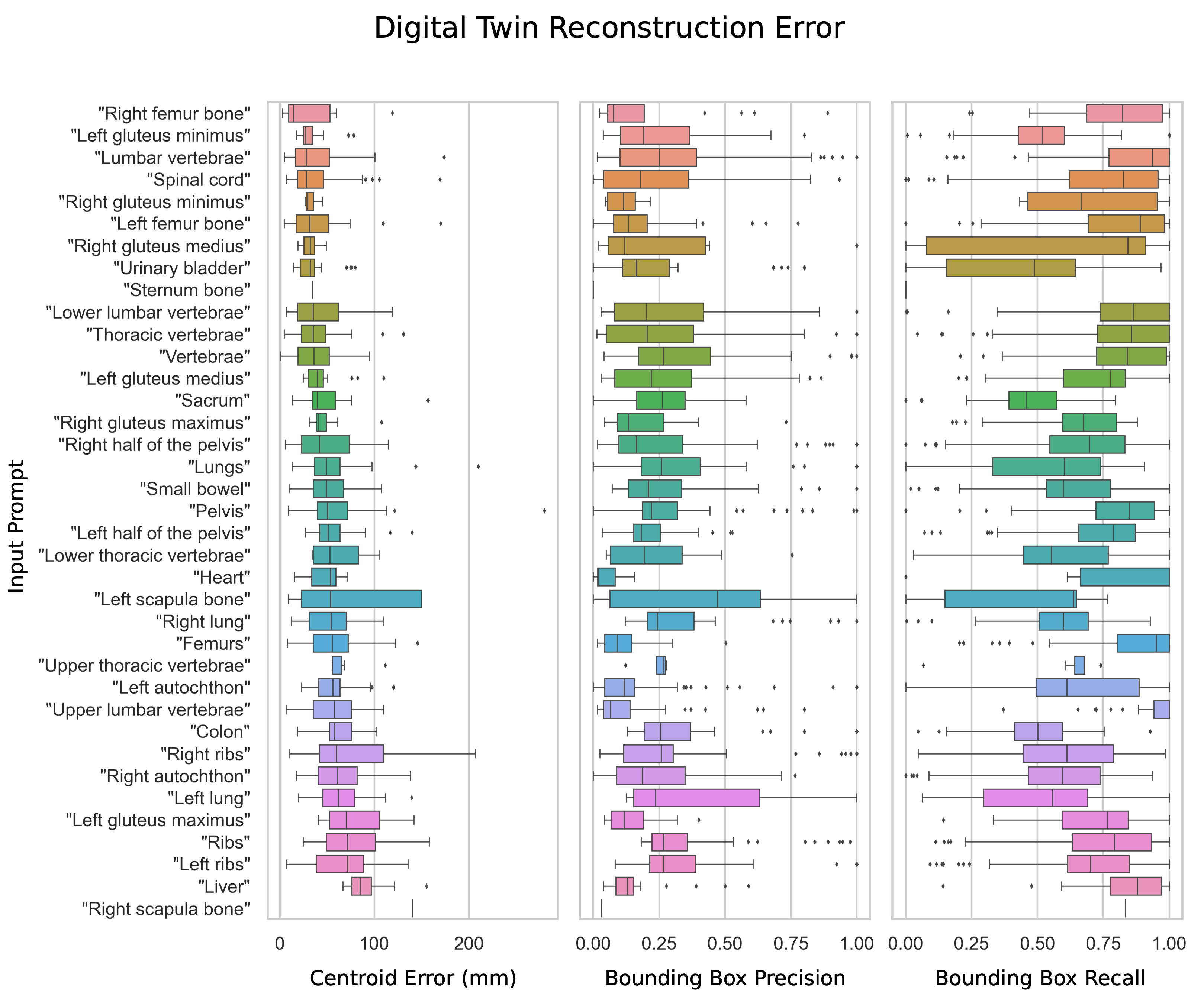

本文提出了一种利用自然语言控制机器人C型臂X射线系统的智能方法。该方法利用语言提示的AI模型,通过X射线图像分割不断更新患者的数字孪生模型,从而实现可视化、患者特定视角查找以及自动准直等自主功能。在尸体研究中,用户通过口头命令对躯干内的结构进行可视化、定位和准直,端到端成功率达到84%。对随机方向图像的分析表明,该患者数字孪生模型能够将35个常用结构定位在51.68毫米以内,从而能够从任意方向进行定位和隔离。结果表明,智能机器人X射线系统可以直接整合医生的意图。尽管现有的术中X射线分析基础模型存在失效模式,但随着它们的改进,它们可以促进高度灵活的智能机器人C型臂的发展。

🔬 方法详解

问题定义:现有机器人C型臂X射线系统的控制依赖于复杂的界面或预定义的程序,缺乏灵活性和直观性。虽然自然语言提供了一种便捷的控制方式,但需要专门的AI模型来理解X射线图像并生成语义表示。然而,这些AI模型的固定输出限制了语言控制的功能,难以适应不同的任务和程序。

核心思路:本文的核心思路是利用语言提示(Language Prompting)来增强AI模型的灵活性,从而实现更通用的机器人C型臂控制。通过构建一个基于X射线图像的患者数字孪生模型,系统可以根据用户的语言指令,动态地调整视角、进行定位和准直等操作。这种方法将用户的意图直接融入到控制过程中,提高了系统的智能化水平。

技术框架:该系统的整体框架包括以下几个主要模块:1) X射线图像采集模块:获取C型臂X射线设备拍摄的图像。2) 语言提示模块:接收用户的自然语言指令,并将其转化为AI模型可以理解的提示。3) 图像分割模块:利用语言对齐的基础模型对X射线图像进行分割,提取关键的解剖结构。4) 数字孪生构建模块:根据分割结果,不断更新患者的数字孪生模型,该模型包含患者的3D结构信息。5) 机器人控制模块:根据用户的指令和数字孪生模型的信息,控制C型臂进行视角调整、定位和准直等操作。

关键创新:该方法最重要的技术创新点在于将语言提示与数字孪生模型相结合,实现了一种更加灵活和智能的机器人C型臂控制方式。与传统的固定输出AI模型相比,语言提示可以根据用户的具体指令动态地调整模型的行为,从而适应不同的任务和程序。数字孪生模型则为机器人提供了患者的3D结构信息,使其能够进行更加精确的定位和操作。

关键设计:在图像分割模块中,使用了语言对齐的基础模型,该模型可以根据语言提示进行图像分割。数字孪生模型的构建采用了稀疏重建技术,利用少量的X射线图像即可构建出较为完整的3D结构。在机器人控制模块中,设计了一套基于PID控制器的算法,用于实现精确的视角调整和准直。

🖼️ 关键图片

📊 实验亮点

在尸体研究中,用户通过口头命令对躯干内的结构进行可视化、定位和准直,端到端成功率达到84%。对随机方向图像的分析表明,该患者数字孪生模型能够将35个常用结构定位在51.68毫米以内。这些结果表明,该系统能够有效地理解用户的意图,并实现精确的机器人控制。

🎯 应用场景

该研究成果可应用于术中导航、放射治疗计划、远程医疗等领域。通过自然语言控制机器人X射线设备,医生可以更方便地进行手术操作,减少辐射暴露,提高手术效率和精度。未来,该技术有望应用于更复杂的医疗场景,例如远程手术和个性化治疗。

📄 摘要(原文)

Natural language offers a convenient, flexible interface for controlling robotic C-arm X-ray systems, making advanced functionality and controls accessible. However, enabling language interfaces requires specialized AI models that interpret X-ray images to create a semantic representation for reasoning. The fixed outputs of such AI models limit the functionality of language controls. Incorporating flexible, language-aligned AI models prompted through language enables more versatile interfaces for diverse tasks and procedures. Using a language-aligned foundation model for X-ray image segmentation, our system continually updates a patient digital twin based on sparse reconstructions of desired anatomical structures. This supports autonomous capabilities such as visualization, patient-specific viewfinding, and automatic collimation from novel viewpoints, enabling commands 'Focus in on the lower lumbar vertebrae.' In a cadaver study, users visualized, localized, and collimated structures across the torso using verbal commands, achieving 84% end-to-end success. Post hoc analysis of randomly oriented images showed our patient digital twin could localize 35 commonly requested structures to within 51.68 mm, enabling localization and isolation from arbitrary orientations. Our results demonstrate how intelligent robotic X-ray systems can incorporate physicians' expressed intent directly. While existing foundation models for intra-operative X-ray analysis exhibit failure modes, as they improve, they can facilitate highly flexible, intelligent robotic C-arms.