LLM-guided Task and Motion Planning using Knowledge-based Reasoning

作者: Muhayy Ud Din, Jan Rosell, Waseem Akram, Isiah Zaplana, Maximo A Roa, Irfan Hussain

分类: cs.RO, cs.AI

发布日期: 2024-12-10 (更新: 2025-10-01)

备注: Submitted to knowledge based systems

💡 一句话要点

提出Onto-LLM-TAMP框架,利用知识推理提升LLM在动态环境下的任务规划能力

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 任务和运动规划 大型语言模型 知识推理 机器人 动态环境

📋 核心要点

- 现有基于LLM的TAMP方法依赖静态模板提示,难以适应动态环境和复杂任务。

- Onto-LLM-TAMP框架利用知识推理,通过任务上下文和知识库增强LLM提示,生成更准确的任务计划。

- 仿真和真实实验验证了该框架的有效性,在动态环境适应性和语义正确性方面优于基线方法。

📝 摘要(中文)

本文提出了一种新颖的Onto-LLM-TAMP框架,旨在解决基于大型语言模型(LLM)的任务和运动规划(TAMP)方法在动态环境中适应性不足的问题。该框架采用知识推理来细化和扩展用户提示,结合任务上下文推理和基于知识的环境状态描述。通过将领域特定知识集成到提示中,确保生成语义准确且上下文感知的任务计划。实验结果表明,该框架能够有效解决符号计划生成中的语义错误,例如在涉及分层对象放置的场景中保持逻辑时间目标顺序。通过仿真和真实场景验证,该框架在适应动态环境和生成语义正确的任务计划方面,相较于基线方法有显著改进。

🔬 方法详解

问题定义:现有的基于LLM的任务和运动规划方法,通常采用静态或基于模板的提示方式,这限制了它们在动态环境和复杂任务上下文中的适应性。当环境状态发生变化或任务目标更加复杂时,LLM难以生成语义上正确且逻辑一致的任务计划,例如,在分层对象放置任务中,可能出现违反时间顺序的规划。

核心思路:本文的核心思路是利用知识推理来增强LLM的提示信息,使其能够更好地理解任务上下文和环境状态。通过将领域知识融入到提示中,可以引导LLM生成更准确、更符合逻辑的任务计划。这种方法旨在弥补LLM在处理复杂和动态环境时的不足,提高其在TAMP任务中的实用性。

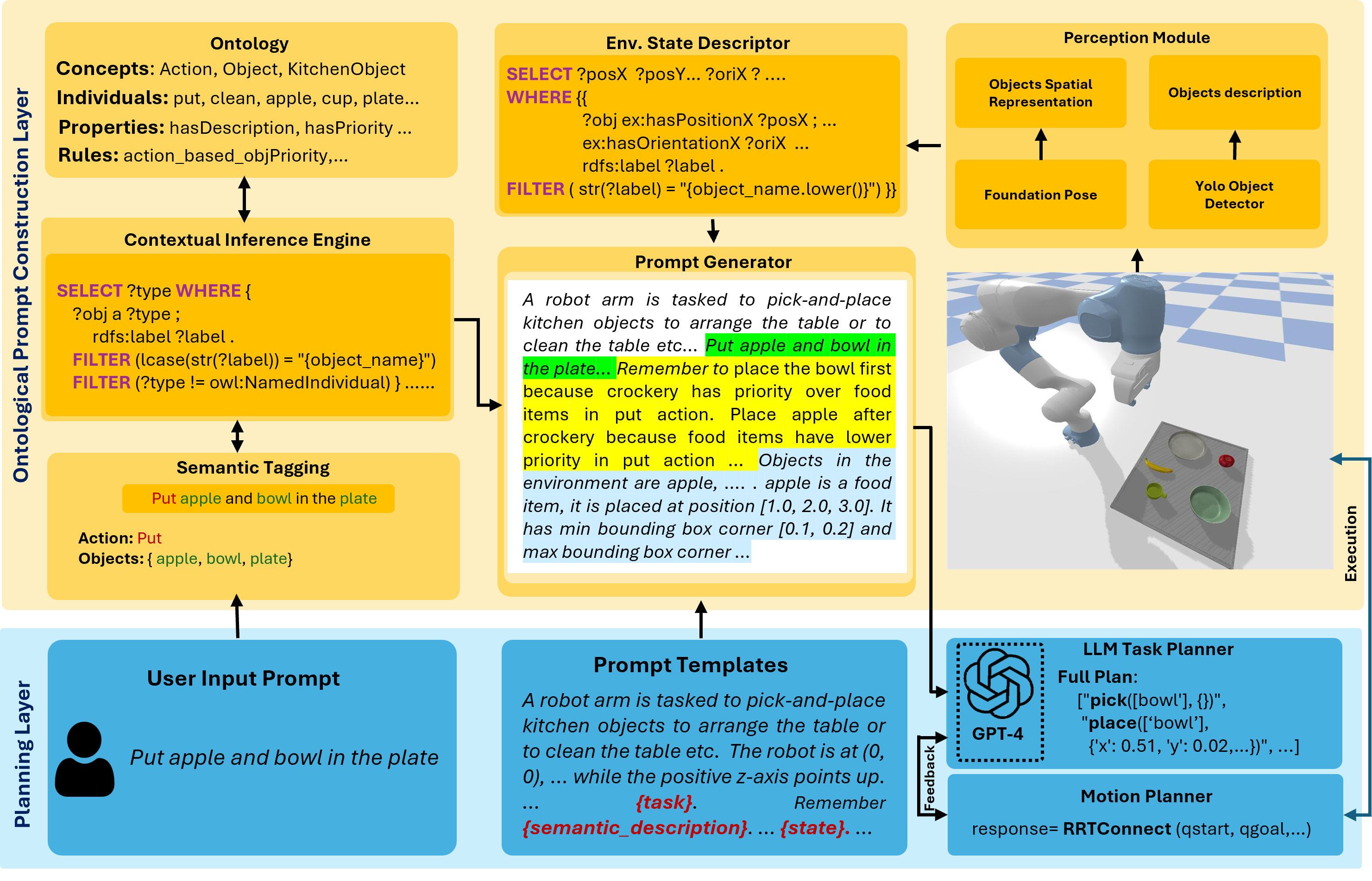

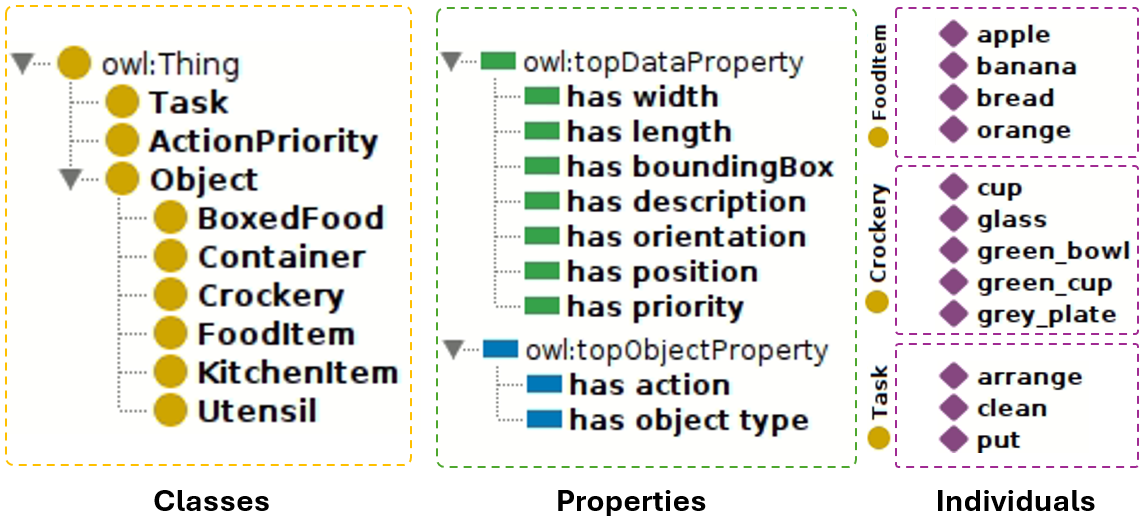

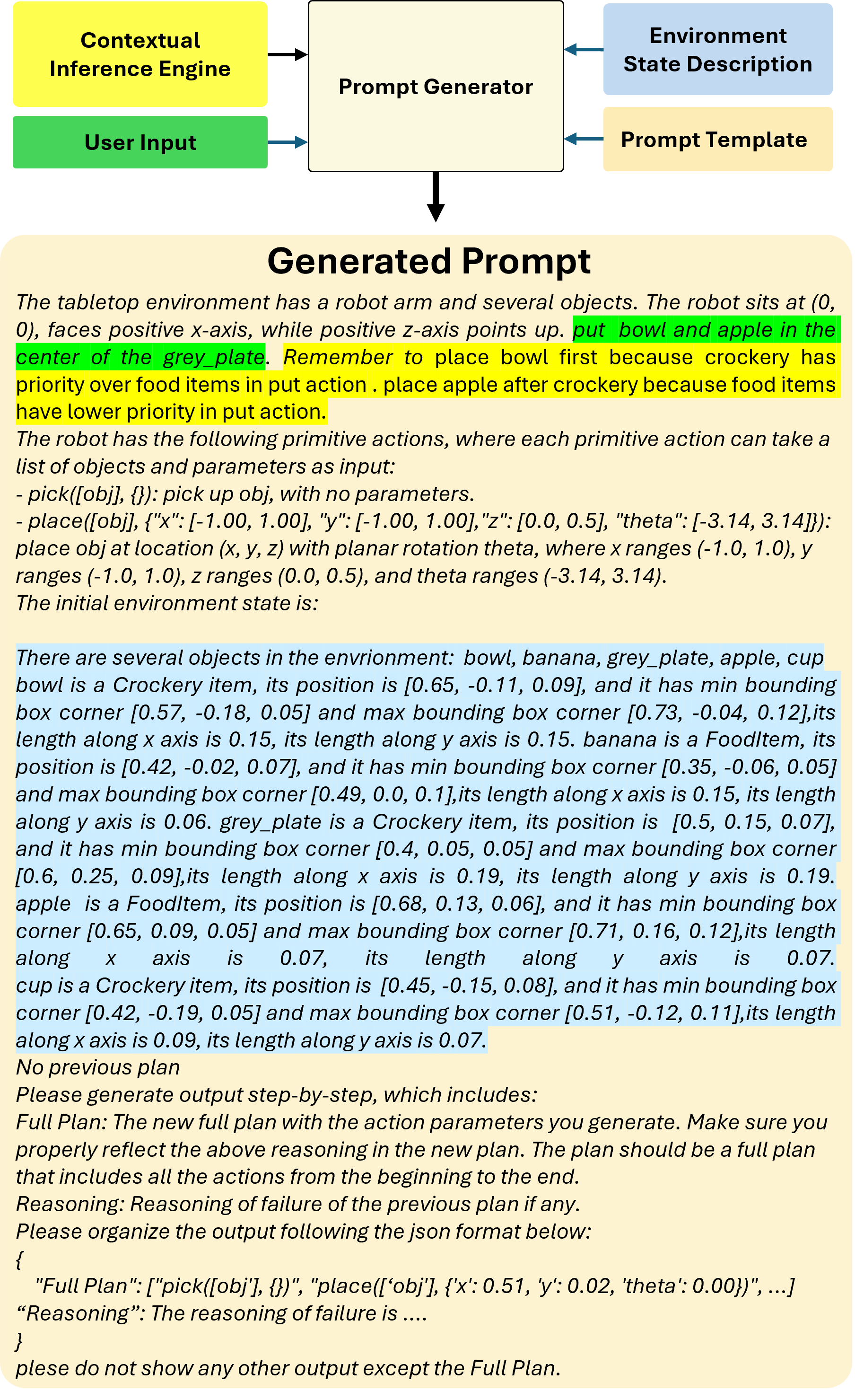

技术框架:Onto-LLM-TAMP框架主要包含以下几个模块:1) 用户输入模块:接收用户以自然语言描述的任务目标。2) 知识库模块:存储领域相关的知识,包括对象属性、关系和操作规则。3) 提示增强模块:利用知识库中的信息,对用户提示进行细化和扩展,生成包含任务上下文和环境状态描述的增强提示。4) LLM模块:接收增强提示,生成符号任务计划。5) 计划验证与执行模块:验证计划的正确性,并将其转化为低级别的运动控制指令,最终在真实或仿真环境中执行。

关键创新:该框架的关键创新在于将知识推理与LLM相结合,用于任务和运动规划。与传统的基于规则或搜索的TAMP方法相比,该框架利用LLM的自然语言理解和生成能力,简化了任务描述和计划生成的过程。与直接使用LLM进行TAMP的方法相比,该框架通过知识推理增强了LLM的提示信息,提高了计划的准确性和可靠性。

关键设计:框架的关键设计包括:1) 知识库的构建:需要根据具体的应用场景,选择合适的知识表示方法,并构建包含足够信息的知识库。2) 提示增强策略:需要设计有效的提示增强策略,将知识库中的信息融入到LLM的提示中,同时避免引入噪声或冗余信息。3) 计划验证机制:需要设计合适的计划验证机制,确保生成的计划在语义上是正确的,并且能够成功执行。具体的参数设置、损失函数、网络结构等技术细节在论文中未详细描述,属于未知信息。

🖼️ 关键图片

📊 实验亮点

该论文通过仿真和真实世界的实验验证了Onto-LLM-TAMP框架的有效性。实验结果表明,该框架能够显著提高LLM在动态环境中生成语义正确任务计划的能力。具体性能数据和提升幅度在摘要中有所提及,但未给出量化指标。与基线方法相比,该框架在解决语义错误和保持逻辑时间目标顺序方面表现更优。

🎯 应用场景

该研究成果可应用于机器人自动化、智能制造、家庭服务机器人等领域。例如,在智能制造中,机器人可以根据用户的自然语言指令,自动完成复杂的装配任务。在家庭服务领域,机器人可以根据用户的需求,完成物品整理、清洁等任务。该研究有助于提高机器人的智能化水平和自主性,使其能够更好地适应动态环境和复杂任务。

📄 摘要(原文)

Performing complex manipulation tasks in dynamic environments requires efficient Task and Motion Planning (TAMP) approaches that combine high-level symbolic plans with low-level motion control. Advances in Large Language Models (LLMs), such as GPT-4, are transforming task planning by offering natural language as an intuitive and flexible way to describe tasks, generate symbolic plans, and reason. However, the effectiveness of LLM-based TAMP approaches is limited due to static and template-based prompting, which limits adaptability to dynamic environments and complex task contexts. To address these limitations, this work proposes a novel Onto-LLM-TAMP framework that employs knowledge-based reasoning to refine and expand user prompts with task-contextual reasoning and knowledge-based environment state descriptions. Integrating domain-specific knowledge into the prompt ensures semantically accurate and context-aware task plans. The proposed framework demonstrates its effectiveness by resolving semantic errors in symbolic plan generation, such as maintaining logical temporal goal ordering in scenarios involving hierarchical object placement. The proposed framework is validated through both simulation and real-world scenarios, demonstrating significant improvements over the baseline approach in terms of adaptability to dynamic environments and the generation of semantically correct task plans.