Stereo Hand-Object Reconstruction for Human-to-Robot Handover

作者: Yik Lung Pang, Alessio Xompero, Changjae Oh, Andrea Cavallaro

分类: cs.RO, cs.CV

发布日期: 2024-12-10 (更新: 2025-05-12)

备注: 8 pages, 9 figures, 1 table. (Website: https://qm-ipalab.github.io/StereoHO/)

💡 一句话要点

提出基于双目视觉的手-物体重建方法,用于人机物体交接任务

🎯 匹配领域: 支柱六:视频提取与匹配 (Video Extraction) 支柱七:动作重定向 (Motion Retargeting)

关键词: 手-物体重建 双目视觉 人机交互 3D形状先验 物体交接

📋 核心要点

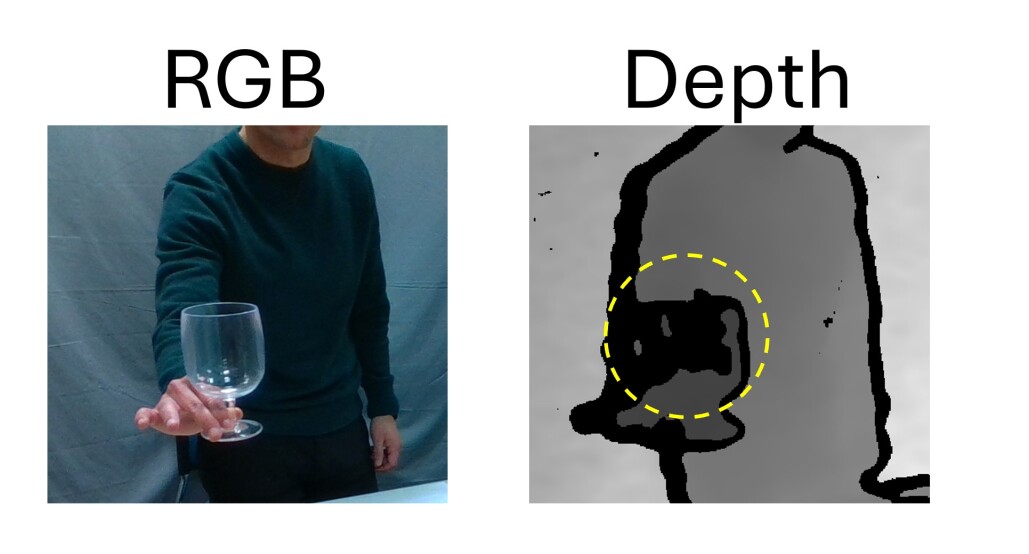

- 现有手-物体重建方法依赖手工设计的物体先验,泛化性差,且深度传感器对透明物体检测效果不佳。

- 该方法结合单视图重建结果,利用概率方法进行双目重建,并从合成数据中学习形状先验,提升泛化性。

- 实验表明,该方法在单视图和双目场景下,均降低了物体Chamfer距离,并成功应用于人机物体交接任务。

📝 摘要(中文)

本文提出了一种基于双目视觉的手-物体重建方法,旨在促进人机物体交接过程中的抓取任务。现有方法依赖于手工设计的物体几何结构先验知识,难以泛化到未见过的物体,并且深度传感器难以检测透明物体(如玻璃杯)。该方法结合单视图重建结果,通过概率方法形成一致的双目重建。从大型合成手-物体数据集中学习3D形状先验,以确保方法具有良好的泛化性,并使用RGB图像输入以更好地捕捉透明物体。实验结果表明,与现有的基于RGB的手-物体重建方法相比,该方法在单视图和双目设置下均降低了物体Chamfer距离。通过基于投影的离群点去除步骤处理重建的手-物体形状,并使用处理后的结果指导基于宽基线双目RGB相机的人机物体交接流程。该手-物体重建方法使机器人能够成功地从人类手中接收各种家用物品。

🔬 方法详解

问题定义:现有基于RGB的手-物体重建方法在处理未见过的物体和透明物体时存在局限性。手工设计的物体几何先验知识无法泛化到各种物体,而深度传感器在检测透明物体(如玻璃杯)时效果不佳。因此,需要一种能够处理各种物体,特别是透明物体,并且具有良好泛化性的手-物体重建方法。

核心思路:该论文的核心思路是利用双目视觉信息,结合单视图重建结果,通过概率方法融合形成一致的3D重建。同时,利用从大型合成数据集中学习到的3D形状先验知识来约束重建过程,提高泛化能力。使用RGB图像作为输入,可以更好地捕捉透明物体的外观信息。

技术框架:该方法主要包含以下几个阶段:1) 单视图手-物体重建:使用单张RGB图像重建手和物体的3D形状。2) 双目融合:利用双目视觉信息,将两个单视图的重建结果进行融合,得到更准确、一致的3D重建结果。3) 离群点去除:使用基于投影的方法去除重建结果中的离群点,提高重建质量。4) 人机物体交接:将重建的手-物体形状用于指导机器人完成人机物体交接任务。

关键创新:该方法的主要创新点在于:1) 提出了一种基于概率的双目融合方法,能够有效地结合单视图重建结果,提高重建精度和一致性。2) 利用从大型合成数据集中学习到的3D形状先验知识,提高了方法的泛化能力。3) 使用RGB图像作为输入,能够更好地处理透明物体。

关键设计:该方法使用了大型合成手-物体数据集进行训练,学习3D形状先验。在双目融合阶段,使用了概率模型来融合单视图的重建结果,并考虑了相机参数和物体姿态的不确定性。离群点去除阶段,使用了基于投影的方法,将3D点云投影到图像平面,并去除与图像不一致的点。

🖼️ 关键图片

📊 实验亮点

实验结果表明,该方法在单视图和双目设置下均优于现有的基于RGB的手-物体重建方法,降低了物体Chamfer距离。此外,该方法成功应用于人机物体交接任务,机器人能够从人类手中接收各种家用物品,验证了该方法的有效性和实用性。

🎯 应用场景

该研究成果可应用于人机协作、机器人辅助生活、智能制造等领域。例如,在人机协作场景中,机器人可以利用该方法准确感知人类手中的物体,并安全地完成物体交接任务。在智能制造领域,机器人可以利用该方法识别和抓取各种形状的零件,提高生产效率。

📄 摘要(原文)

Jointly estimating hand and object shape facilitates the grasping task in human-to-robot handovers. However, relying on hand-crafted prior knowledge about the geometric structure of the object fails when generalising to unseen objects, and depth sensors fail to detect transparent objects such as drinking glasses. In this work, we propose a stereo-based method for hand-object reconstruction that combines single-view reconstructions probabilistically to form a coherent stereo reconstruction. We learn 3D shape priors from a large synthetic hand-object dataset to ensure that our method is generalisable, and use RGB inputs to better capture transparent objects. We show that our method reduces the object Chamfer distance compared to existing RGB based hand-object reconstruction methods on single view and stereo settings. We process the reconstructed hand-object shape with a projection-based outlier removal step and use the output to guide a human-to-robot handover pipeline with wide-baseline stereo RGB cameras. Our hand-object reconstruction enables a robot to successfully receive a diverse range of household objects from the human.