Non-Prehensile Tool-Object Manipulation by Integrating LLM-Based Planning and Manoeuvrability-Driven Controls

作者: Hoi-Yin Lee, Peng Zhou, Anqing Duan, Wanyu Ma, Chenguang Yang, David Navarro-Alarcon

分类: cs.RO

发布日期: 2024-12-09 (更新: 2026-01-09)

💡 一句话要点

提出基于LLM规划和可操纵性驱动控制的非抓取工具-物体操作方法

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱三:空间感知与语义 (Perception & Semantics) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 非抓取操作 工具操作 大型语言模型 机器人控制 可操纵性 任务规划 视觉反馈

📋 核心要点

- 现有机器人系统在工具使用方面与生物的灵活性存在差距,难以完成复杂的非抓取操作任务。

- 该方法利用LLM进行高级任务规划,结合视觉反馈驱动的可操纵性控制器,实现工具的有效利用。

- 实验验证了该方法在不同操作场景下的有效性,展示了其在复杂环境中的工具操作能力。

📝 摘要(中文)

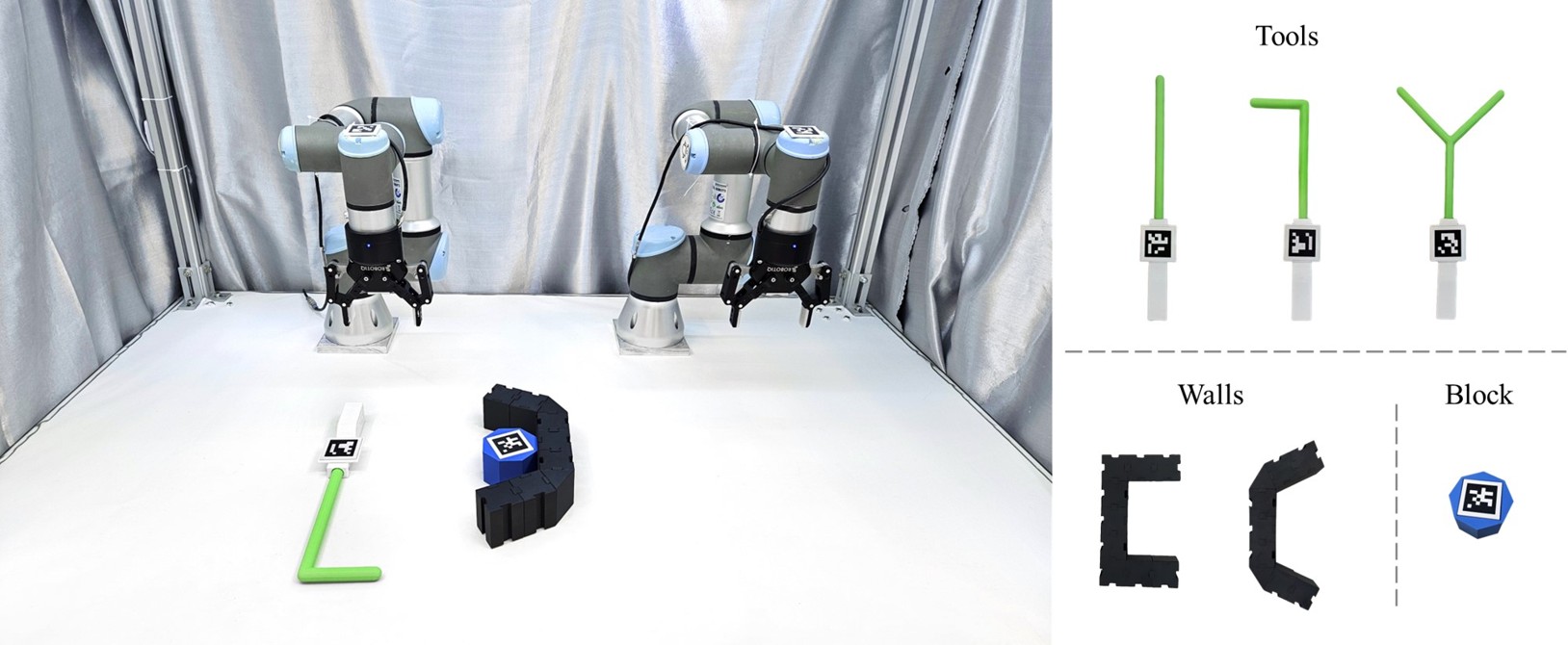

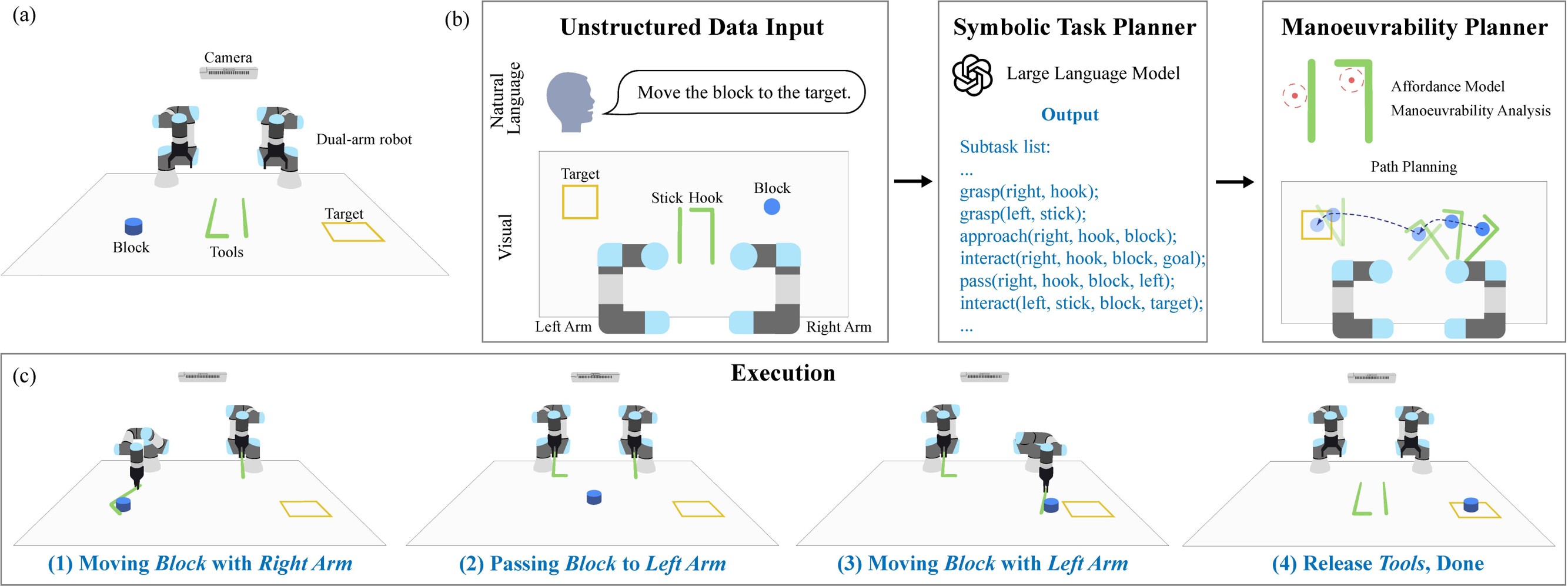

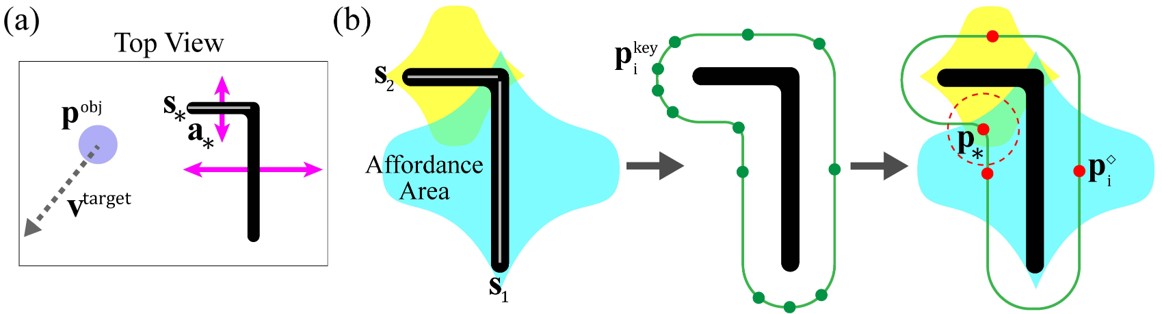

本文研究了利用大型语言模型(LLM)、工具可供性和物体可操纵性进行非抓取工具操作任务。该方法基于场景信息和自然语言指令,利用LLM实现工具-物体操作的符号任务规划,将人类语言语句转换为一系列可行的运动函数。同时,开发了一种基于视觉反馈的新型工具可供性模型,并设计了可操纵性驱动的控制器,该控制器通过步进增量方法引导机器人在狭窄区域内使用工具和进行操作。实验结果证明了该方法在各种操作场景下的有效性。

🔬 方法详解

问题定义:现有机器人非抓取工具操作方法在复杂环境和任务中表现不足,难以实现精确和高效的操作。痛点在于缺乏对环境和任务的有效理解,以及对工具操作的精细控制。

核心思路:利用大型语言模型(LLM)进行高级任务规划,将自然语言指令转化为可执行的运动序列。结合视觉反馈,建立工具的可供性模型,并设计可操纵性驱动的控制器,实现对工具操作的精确控制。

技术框架:该方法包含三个主要模块:1) 基于LLM的任务规划器,接收场景信息和自然语言指令,生成符号任务序列;2) 工具可供性模型,基于视觉反馈评估工具在当前环境下的可用性;3) 可操纵性驱动的控制器,根据可供性模型和任务序列,生成机器人的运动指令。

关键创新:将LLM引入非抓取工具操作任务,实现高级任务规划和自然语言交互。提出了一种基于视觉反馈的工具可供性模型,能够动态评估工具在不同环境下的可用性。

关键设计:LLM使用预训练模型,并通过少量样本进行微调,以适应特定的工具操作任务。可操纵性驱动的控制器采用步进增量方法,逐步调整机器人的运动,以实现精确的操作。工具可供性模型基于深度学习网络,通过视觉输入预测工具在不同位置和方向上的可用性。

🖼️ 关键图片

📊 实验亮点

实验结果表明,该方法能够成功完成各种非抓取工具操作任务,包括在狭窄空间内的操作。与传统方法相比,该方法具有更高的成功率和更强的鲁棒性。具体性能数据未知,但论文强调了该方法在不同场景下的有效性。

🎯 应用场景

该研究成果可应用于自动化装配、医疗手术、家庭服务等领域。例如,在自动化装配中,机器人可以利用工具完成复杂的零部件组装任务;在医疗手术中,医生可以通过自然语言指令控制机器人进行微创手术;在家庭服务中,机器人可以利用工具完成清洁、整理等家务。

📄 摘要(原文)

The ability to wield tools was once considered exclusive to human intelligence, but it's now known that many other animals, like crows, possess this capability. Yet, robotic systems still fall short of matching biological dexterity. In this paper, we investigate the use of Large Language Models (LLMs), tool affordances, and object manoeuvrability for non-prehensile tool-based manipulation tasks. Our novel method leverages LLMs based on scene information and natural language instructions to enable symbolic task planning for tool-object manipulation. This approach allows the system to convert a human language sentence into a sequence of feasible motion functions. We have developed a novel manoeuvrability-driven controller using a new tool affordance model derived from visual feedback. This controller helps guide the robot's tool utilization and manipulation actions, even within confined areas, using a stepping incremental approach. The proposed methodology is evaluated with experiments to prove its effectiveness under various manipulation scenarios.