AnyBimanual: Transferring Unimanual Policy for General Bimanual Manipulation

作者: Guanxing Lu, Tengbo Yu, Haoyuan Deng, Season Si Chen, Yansong Tang, Ziwei Wang

分类: cs.RO, cs.AI

发布日期: 2024-12-09 (更新: 2025-03-27)

备注: Project page: https://anybimanual.github.io/

💡 一句话要点

AnyBimanual:迁移单手策略至通用双手操作,解决数据稀缺问题

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 双手操作 单手策略迁移 强化学习 机器人操作 视觉对齐

📋 核心要点

- 双手操作数据收集成本高昂,限制了传统方法在通用任务上的应用。

- AnyBimanual通过迁移预训练的单手策略,结合技能管理和视觉对齐,实现高效的双手操作学习。

- 实验表明,AnyBimanual在模拟和真实环境中均显著优于现有方法,验证了其有效性。

📝 摘要(中文)

执行通用的、语言条件下的双手操作任务在许多应用中至关重要,例如家政服务和工业组装。然而,由于高维动作空间,收集双手操作数据非常昂贵,这给传统方法处理通用双手操作任务带来了挑战。相比之下,单手策略最近展示了在各种任务中令人印象深刻的泛化能力,这归功于缩放的模型参数和训练数据,这些可以为双手系统提供可共享的操作知识。为此,我们提出了一种名为AnyBimanual的即插即用方法,该方法通过少量的双手演示将预训练的单手策略迁移到通用的双手操作策略。具体来说,我们首先引入一个技能管理器,用于动态调度从预训练的单手策略中发现的技能表示,以用于双手操作任务,该管理器将技能原语与面向任务的补偿线性组合,以表示双手操作指令。为了减轻单手和双手系统之间的观察差异,我们提出了一种视觉对齐器,用于为工作空间的视觉嵌入生成软掩码,旨在将每个手臂的单手策略模型的视觉输入与预训练阶段的视觉输入对齐。AnyBimanual在RLBench2的12个模拟任务上表现出优越性,成功率比以前的方法提高了12.67%。在9个真实世界任务上的实验进一步验证了它的实用性,平均成功率为84.62%。

🔬 方法详解

问题定义:论文旨在解决通用语言条件下的双手操作任务,现有方法面临的主要痛点是双手操作数据收集成本高昂,导致模型难以泛化到新的任务和环境。此外,单手策略在泛化性方面表现出色,但如何有效利用单手策略的知识来指导双手操作是一个挑战。

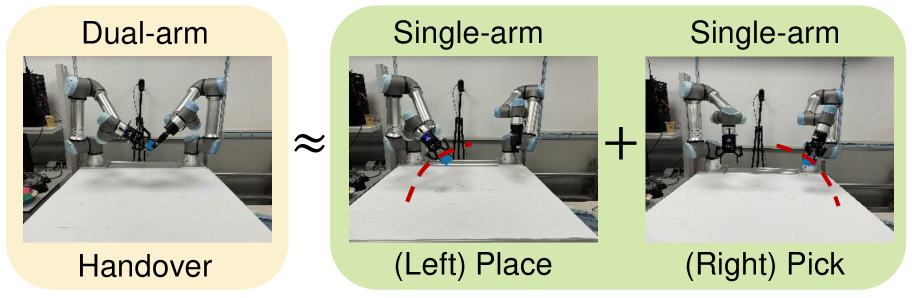

核心思路:论文的核心思路是将预训练的单手策略迁移到双手操作任务中。通过利用单手策略的泛化能力,减少对大量双手操作数据的依赖。同时,通过技能管理和视觉对齐来弥合单手和双手系统之间的差异,从而实现高效的双手操作学习。

技术框架:AnyBimanual包含两个主要模块:技能管理器和视觉对齐器。首先,技能管理器负责动态调度从预训练的单手策略中提取的技能表示,并将其组合成双手操作指令。其次,视觉对齐器通过生成软掩码来对齐单手和双手系统之间的视觉输入差异。整个流程是:输入语言指令和视觉信息,视觉信息经过视觉对齐器处理,然后与语言指令一起输入到技能管理器,技能管理器输出双手操作指令。

关键创新:论文的关键创新在于提出了一种即插即用的方法,可以将预训练的单手策略迁移到通用的双手操作策略。这种方法避免了从头开始训练双手操作策略,从而大大降低了数据收集成本。此外,技能管理器和视觉对齐器的设计有效地解决了单手和双手系统之间的差异,提高了迁移学习的效率。与现有方法相比,AnyBimanual更注重利用已有的单手知识,而不是依赖大量的双手数据。

关键设计:技能管理器使用线性组合的方式将技能原语与任务相关的补偿项结合起来,以表示双手操作指令。视觉对齐器使用软掩码来对齐单手和双手系统之间的视觉输入差异。具体的网络结构和损失函数细节在论文中未明确说明,属于未知信息。

🖼️ 关键图片

📊 实验亮点

AnyBimanual在RLBench2的12个模拟任务上,成功率比以前的方法提高了12.67%。在9个真实世界任务上的实验中,AnyBimanual的平均成功率为84.62%。这些实验结果表明,AnyBimanual在模拟和真实环境中均表现出优越的性能,验证了其有效性和实用性。

🎯 应用场景

AnyBimanual具有广泛的应用前景,例如家政服务机器人、工业组装机器人、医疗辅助机器人等。该方法可以显著降低机器人学习双手操作技能的成本,提高机器人的智能化水平和服务能力。未来,该方法可以进一步扩展到更复杂的双手操作任务中,例如需要更高精度和协调性的任务。

📄 摘要(原文)

Performing general language-conditioned bimanual manipulation tasks is of great importance for many applications ranging from household service to industrial assembly. However, collecting bimanual manipulation data is expensive due to the high-dimensional action space, which poses challenges for conventional methods to handle general bimanual manipulation tasks. In contrast, unimanual policy has recently demonstrated impressive generalizability across a wide range of tasks because of scaled model parameters and training data, which can provide sharable manipulation knowledge for bimanual systems. To this end, we propose a plug-and-play method named AnyBimanual, which transfers pre-trained unimanual policy to general bimanual manipulation policy with few bimanual demonstrations. Specifically, we first introduce a skill manager to dynamically schedule the skill representations discovered from pre-trained unimanual policy for bimanual manipulation tasks, which linearly combines skill primitives with task-oriented compensation to represent the bimanual manipulation instruction. To mitigate the observation discrepancy between unimanual and bimanual systems, we present a visual aligner to generate soft masks for visual embedding of the workspace, which aims to align visual input of unimanual policy model for each arm with those during pretraining stage. AnyBimanual shows superiority on 12 simulated tasks from RLBench2 with a sizable 12.67% improvement in success rate over previous methods. Experiments on 9 real-world tasks further verify its practicality with an average success rate of 84.62%.