Multi-cam Multi-map Visual Inertial Localization: System, Validation and Dataset

作者: Yufei Wei, Fuzhang Han, Yanmei Jiao, Zhuqing Zhang, Yiyuan Pan, Wenjun Huang, Li Tang, Huan Yin, Xiaqing Ding, Chenxiao Hu, Rong Xiong, Yue Wang

分类: cs.RO

发布日期: 2024-12-05 (更新: 2025-11-08)

💡 一句话要点

提出多相机多地图视觉惯性定位系统,实现实时、因果、有界误差的机器人定位。

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 视觉惯性定位 多相机 多地图 机器人定位 因果定位

📋 核心要点

- 传统视觉SLAM和视觉惯性里程计在机器人控制中存在因果性问题或累积漂移问题,难以满足实时控制需求。

- 提出多相机多地图视觉惯性定位系统,利用多相机信息和多地图约束,实现实时、因果且误差有界的定位。

- 通过自建数据集和公共数据集验证,该系统在实时定位精度上显著优于其他方法,并开源系统和数据集。

📝 摘要(中文)

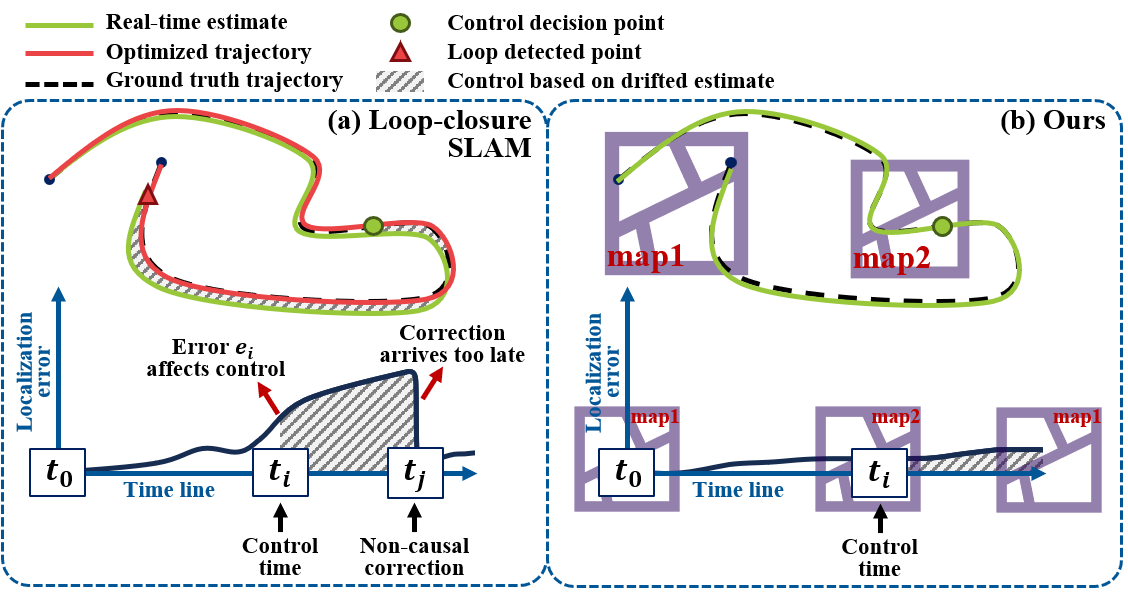

机器人控制回路需要仅依赖过去和当前测量的因果位姿估计。控制器在每个时间步使用当前位姿计算命令,无需等待未来的优化。传统视觉SLAM系统通过回顾性的回环闭合实现高精度,但这些校正发生在控制决策执行之后,违反了因果性。视觉惯性里程计保持了因果性,但会随着时间累积无界漂移。为了满足机器人控制的独特需求,我们提出了一种多相机多地图视觉惯性定位系统,通过连续的地图约束提供实时、因果的位姿估计,并具有有界的定位误差。由于标准轨迹指标评估的是后处理的轨迹,我们分析了基于地图的定位系统的误差构成,并提出了一套适用于测量因果定位性能的评估指标。为了验证我们的系统,我们设计了一个多相机IMU硬件装置,并收集了一个具有挑战性的长期校园数据集,该数据集具有多样化的光照和季节条件。在公共基准和我们自己收集的数据集上的实验结果表明,与其他方法相比,我们的系统提供了显著更高的实时定位精度。为了使社区受益,我们已将系统和数据集开源。

🔬 方法详解

问题定义:论文旨在解决机器人控制中对实时、因果位姿估计的需求。传统视觉SLAM虽然精度高,但回环检测的校正具有滞后性,不满足因果性;视觉惯性里程计虽然因果,但会累积无界漂移。因此,需要一种既能保证实时性,又能限制定位误差的系统。

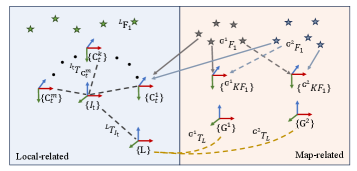

核心思路:核心思路是利用多相机和多地图信息,构建一个具有连续地图约束的视觉惯性定位系统。多相机提供更丰富的视觉信息,提高定位的鲁棒性;多地图则通过地图间的约束,限制定位误差的累积,实现有界误差。

技术框架:该系统是一个多相机多地图视觉惯性定位系统,包含以下主要模块:1) 多相机视觉前端,用于提取图像特征;2) 惯性测量单元(IMU)预积分,提供运动先验;3) 基于地图的定位模块,利用已知的地图信息进行位姿估计;4) 多地图管理模块,负责地图的创建、更新和选择。整体流程是:多相机图像和IMU数据输入系统,经过前端处理和预积分后,与地图进行匹配,得到当前位姿估计,并根据定位结果更新地图。

关键创新:关键创新在于将多相机和多地图信息融合到视觉惯性定位框架中,并设计了相应的地图管理策略。通过多地图约束,有效地限制了定位误差的累积,实现了有界误差的实时定位。此外,论文还提出了适用于因果定位性能评估的指标。

关键设计:论文中未明确给出关键参数设置、损失函数或网络结构的具体细节。但可以推断,地图管理策略(例如地图的创建、更新和选择机制)以及多相机信息的融合方式是关键的设计要素。损失函数可能包含视觉重投影误差、IMU残差以及地图约束误差等。

🖼️ 关键图片

📊 实验亮点

实验结果表明,该系统在公共数据集和自建数据集上均取得了显著的性能提升。与其他方法相比,该系统在实时定位精度上表现更优,验证了多相机多地图视觉惯性定位的有效性。自建数据集包含多样化的光照和季节条件,更贴近实际应用场景,进一步证明了该系统的鲁棒性。

🎯 应用场景

该研究成果可广泛应用于机器人导航、自动驾驶、增强现实等领域。尤其是在需要高精度、实时定位的场景下,如无人机巡检、移动机器人室内导航、自动驾驶车辆等,该系统能够提供可靠的位姿估计,支持机器人完成复杂的控制任务。未来,该技术有望进一步提升机器人的自主性和智能化水平。

📄 摘要(原文)

Robot control loops require causal pose estimates that depend only on past and present measurements. At each timestep, controllers compute commands using the current pose without waiting for future refinements. While traditional visual SLAM systems achieve high accuracy through retrospective loop closures, these corrections arrive after control decisions were already executed, violating causality. Visual-inertial odometry maintains causality but accumulates unbounded drift over time. To address the distinct requirements of robot control, we propose a multi-camera multi-map visual-inertial localization system providing real-time, causal pose estimation with bounded localization error through continuous map constraints. Since standard trajectory metrics evaluate post-processed trajectories, we analyze the error composition of map-based localization systems and propose a set of evaluation metrics suitable for measuring causal localization performance. To validate our system, we design a multi-camera IMU hardware setup and collect a challenging long-term campus dataset featuring diverse illumination and seasonal conditions. Experimental results on public benchmarks and on our own collected dataset demonstrate that our system provides significantly higher real-time localization accuracy compared to other methods. To benefit the community, we have made both the system and the dataset open source at https://anonymous.4open.science/r/Multi-cam-Multi-map-VILO-7993.