Towards an Autonomous Test Driver: High-Performance Driver Modeling via Reinforcement Learning

作者: John Subosits, Jenna Lee, Shawn Manuel, Paul Tylkin, Avinash Balachandran

分类: cs.RO

发布日期: 2024-12-05

备注: 12 pages, 11 figures

💡 一句话要点

提出基于强化学习的高性能自动驾驶模型,用于赛车车辆配置评估

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 强化学习 自动驾驶 赛车 车辆配置 模仿学习

📋 核心要点

- 赛车车辆配置的评估依赖于昂贵且耗时的人工测试,缺乏自动化和效率。

- 利用深度强化学习训练自动驾驶模型,使其能够像人类专家一样评估车辆配置。

- 通过结合模仿学习,模型可以模拟特定人类驾驶员的行为模式,实现个性化车辆设置优化。

📝 摘要(中文)

赛车运动的成功需要车辆设置、赛道理解和人类专业知识的独特结合。由于在现实世界中构建和测试许多不同的车辆配置成本高昂,因此高保真模拟是赛车开发的关键组成部分。然而,测试不同的车辆配置仍然需要专家的人工输入,以便评估它们在不同赛道上的性能。在这项工作中,我们提出了迈向自动测试驾驶员的第一步,该驾驶员使用深度强化学习进行训练,能够评估车辆设置变化对赛车性能的影响,同时以最佳人类驾驶员的水平驾驶。此外,通过将模仿学习融入到强化学习训练过程中,可以调整自动驾驶模型以表现出更像人类的行为模式。这种扩展使得针对特定驾驶员的车辆设置优化成为可能。

🔬 方法详解

问题定义:论文旨在解决赛车领域中车辆配置评估效率低下的问题。现有方法依赖于人类专家进行大量的实际测试或模拟测试,成本高昂且耗时。此外,不同驾驶员的驾驶风格不同,需要针对特定驾驶员进行车辆配置优化,而现有方法难以实现个性化定制。

核心思路:论文的核心思路是利用深度强化学习训练一个自动驾驶模型,使其能够像人类专家一样驾驶赛车,并评估不同车辆配置对赛车性能的影响。通过模仿学习,模型还可以学习特定人类驾驶员的驾驶风格,从而实现针对特定驾驶员的车辆配置优化。

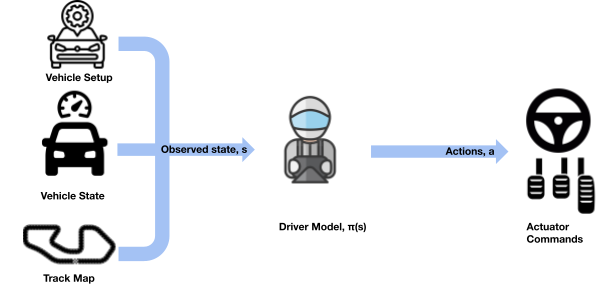

技术框架:该方法采用深度强化学习框架,包括环境模型(赛车模拟器)、智能体(自动驾驶模型)和奖励函数。智能体通过与环境交互,学习如何在赛道上驾驶赛车,并根据车辆配置的变化调整驾驶策略。模仿学习模块用于学习人类驾驶员的驾驶风格,并将其融入到强化学习训练过程中。整体流程包括:1) 使用强化学习训练一个通用的自动驾驶模型;2) 使用模仿学习学习特定人类驾驶员的驾驶风格;3) 将模仿学习的结果融入到强化学习训练过程中,得到针对特定驾驶员的自动驾驶模型;4) 使用该模型评估不同车辆配置对赛车性能的影响。

关键创新:该论文的关键创新在于将深度强化学习和模仿学习相结合,用于训练高性能的自动驾驶模型,并将其应用于赛车车辆配置评估。与传统的基于规则或优化的自动驾驶方法相比,该方法能够更好地适应复杂的赛道环境和车辆动力学,并能够学习人类驾驶员的驾驶风格。

关键设计:论文中使用了深度神经网络作为自动驾驶模型的控制器,输入包括车辆状态(速度、位置、姿态等)和赛道信息,输出为车辆控制指令(油门、刹车、转向)。奖励函数的设计至关重要,需要综合考虑赛车速度、赛道保持、碰撞避免等因素。模仿学习模块使用了行为克隆方法,通过最小化模型输出与人类驾驶员行为之间的差异来学习驾驶风格。具体的网络结构、损失函数和超参数设置在论文中进行了详细描述(未知)。

🖼️ 关键图片

📊 实验亮点

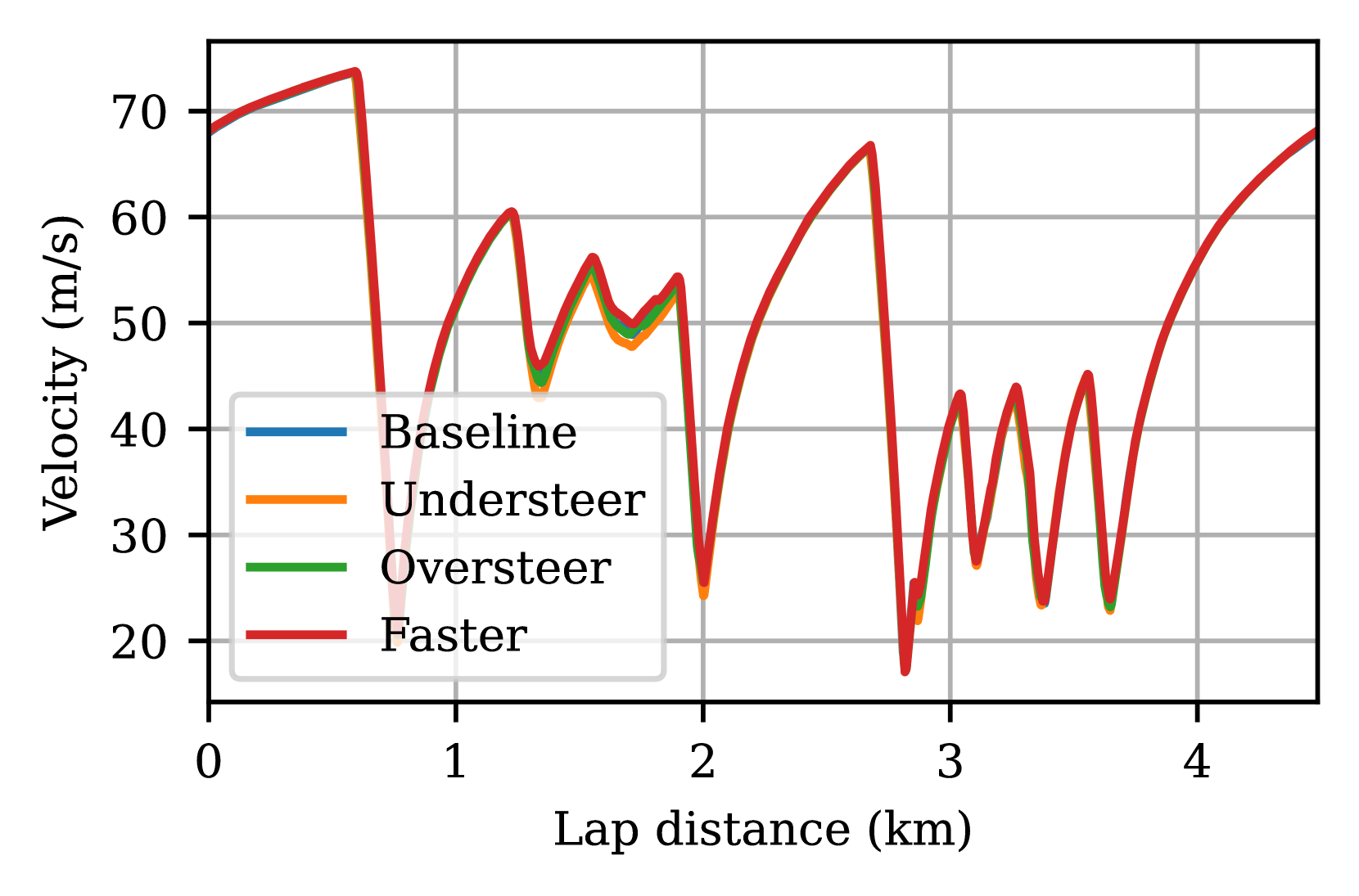

论文展示了训练出的自动驾驶模型能够达到甚至超过人类专业赛车手的驾驶水平。通过对比实验,验证了该模型在不同赛道和车辆配置下的性能表现。此外,通过模仿学习,模型能够学习并复现特定人类驾驶员的驾驶风格,为个性化车辆配置优化提供了可能。具体的性能数据和提升幅度在论文中进行了详细描述(未知)。

🎯 应用场景

该研究成果可应用于赛车游戏开发、自动驾驶车辆测试和车辆动力学研究等领域。通过自动驾驶模型,可以快速评估不同车辆配置的性能,优化车辆设计,提高赛车竞争力。此外,该方法还可以用于训练自动驾驶车辆,提高其在复杂环境下的驾驶能力。未来,该技术有望应用于更广泛的车辆工程领域,例如乘用车的性能优化和驾驶辅助系统开发。

📄 摘要(原文)

Success in racing requires a unique combination of vehicle setup, understanding of the racetrack, and human expertise. Since building and testing many different vehicle configurations in the real world is prohibitively expensive, high-fidelity simulation is a critical part of racecar development. However, testing different vehicle configurations still requires expert human input in order to evaluate their performance on different racetracks. In this work, we present the first steps towards an autonomous test driver, trained using deep reinforcement learning, capable of evaluating changes in vehicle setup on racing performance while driving at the level of the best human drivers. In addition, the autonomous driver model can be tuned to exhibit more human-like behavioral patterns by incorporating imitation learning into the RL training process. This extension permits the possibility of driver-specific vehicle setup optimization.