Touch and Tell: Multimodal Decoding of Human Emotions and Social Gestures for Robots

作者: Qiaoqiao Ren, Remko Proesmans, Yuanbo Hou, Francis wyffels, Tony Belpaeme

分类: cs.RO, cs.LG

发布日期: 2024-12-04 (更新: 2025-08-12)

💡 一句话要点

提出一种基于触觉和听觉多模态融合的情感与社交手势识别方法,用于提升人机交互中机器人理解能力。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 人机交互 情感识别 社交手势识别 多模态融合 触觉感知 听觉感知 社交机器人

📋 核心要点

- 现有方法难以可靠地通过触觉将人类情感和社交手势传达给机器人,并进行准确的解码。

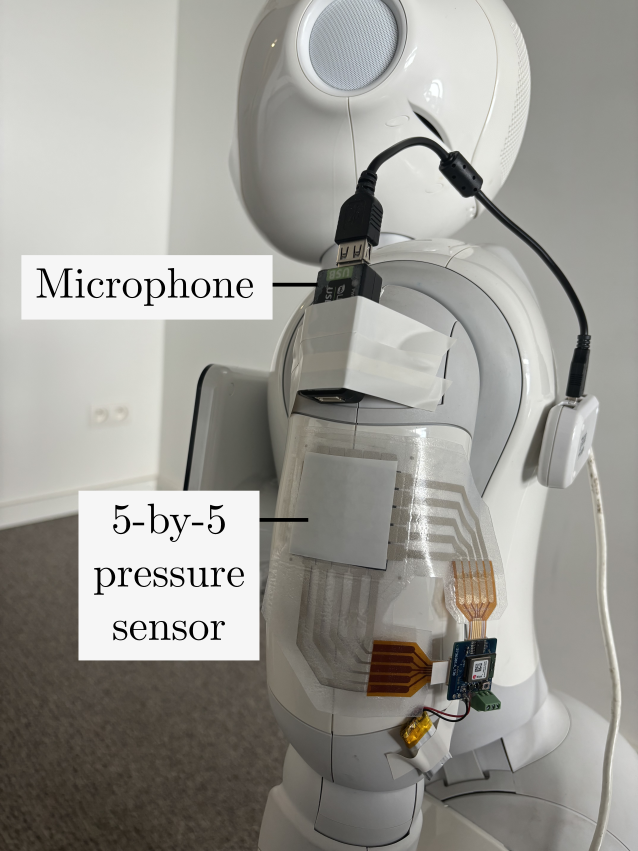

- 本研究通过在机器人上集成触觉和听觉传感器,利用多模态数据融合提升情感和手势识别的准确率。

- 实验结果表明,多模态模型显著优于单模态模型,情感识别准确率达到40%,手势识别准确率达到90.74%。

📝 摘要(中文)

人类的情感复杂,可以通过细微的触觉手势来传达。以往的研究主要集中在人类如何通过触觉识别情感,或者为机器人识别情感表达的关键特征。然而,对于如何可靠地通过触觉将这些情感和手势传达给机器人,并使用数据驱动的方法进行解释,还缺乏了解。本研究调查了通过触觉和声音表达情感和手势的一致性和可区分性。为此,我们在一个社交机器人上集成了一个定制的压阻式压力传感器和一个麦克风。28名参与者首先使用自发的触觉手势向机器人传达了10种不同的情感,然后执行了6种预定义的社交触觉手势。研究结果表明,参与者在情感和手势表达方面具有统计学上显著的一致性。然而,一些情感表现出较低的组内相关系数值,并且某些具有相似唤醒或效价水平的情感在传达上没有表现出显著差异。为了研究情感人机触觉交互中的情感和社交手势解码,我们开发了单模态模型和集成触觉和听觉特征的多模态模型。一个在多模态特征上训练的支持向量机(SVM)模型在分类10种情感时达到了最高的准确率,为40%。对于手势分类,一个卷积神经网络-长短期记忆网络(CNN-LSTM)达到了90.74%的准确率。我们的结果表明,即使单模态模型具有解码情感和触觉手势的潜力,触觉和声音的多模态融合明显优于单模态方法,从而增强了情感和手势的解码。

🔬 方法详解

问题定义:论文旨在解决机器人如何准确理解人类通过触觉传递的情感和社交手势的问题。现有方法主要集中在单模态触觉信息处理,忽略了触觉交互中伴随的声音信息,导致情感和手势识别的准确率受限。此外,不同人表达情感和手势的方式存在差异,如何建模这种个体差异也是一个挑战。

核心思路:论文的核心思路是利用多模态融合,将触觉和听觉信息结合起来,提高机器人对情感和社交手势的理解能力。触觉传感器捕捉触摸的压力信息,麦克风捕捉触摸过程中产生的声音信息。通过融合这两种模态的信息,可以更全面地了解人类的情感状态和意图。同时,论文通过实验分析了不同情感和手势表达的一致性和可区分性,为模型设计提供了依据。

技术框架:整体框架包括数据采集、特征提取、模型训练和分类四个阶段。首先,通过定制的压阻式压力传感器和麦克风采集触觉和听觉数据。然后,从采集到的数据中提取特征,例如压力值、声音频率等。接着,使用提取的特征训练单模态和多模态模型。最后,使用训练好的模型对情感和社交手势进行分类。单模态模型包括基于触觉特征的SVM和基于听觉特征的模型(具体模型未知)。多模态模型则融合了触觉和听觉特征,并使用SVM进行情感分类,使用CNN-LSTM进行手势分类。

关键创新:论文的关键创新在于多模态融合的方法。通过将触觉和听觉信息结合起来,可以更全面地了解人类的情感状态和意图。此外,论文还定制了压阻式压力传感器,并设计了实验来研究不同情感和手势表达的一致性和可区分性。

关键设计:情感分类使用SVM模型,手势分类使用CNN-LSTM模型。SVM模型使用多模态特征作为输入,目标是分类10种不同的情感。CNN-LSTM模型则利用卷积神经网络提取触觉和听觉特征的时空信息,然后使用LSTM网络对时序信息进行建模,从而实现手势分类。具体的参数设置、损失函数和网络结构等技术细节在论文中可能没有详细描述,属于未知信息。

🖼️ 关键图片

📊 实验亮点

实验结果表明,多模态模型在情感和手势识别方面均优于单模态模型。对于情感分类,基于多模态特征的SVM模型达到了40%的准确率,显著高于单模态模型(具体数据未知)。对于手势分类,CNN-LSTM模型达到了90.74%的准确率,也高于单模态模型(具体数据未知)。这些结果表明,触觉和听觉信息的融合可以有效提升机器人对人类情感和社交意图的理解能力。

🎯 应用场景

该研究成果可应用于社交机器人、智能辅助设备、虚拟现实等领域。例如,社交机器人可以通过触觉和听觉感知人类的情感状态,从而做出更自然、更贴心的反应。智能辅助设备可以通过触觉感知用户的操作意图,从而提供更便捷的服务。在虚拟现实中,用户可以通过触觉与虚拟环境进行交互,从而获得更沉浸式的体验。该研究有助于提升人机交互的自然性和智能化水平。

📄 摘要(原文)

Human emotions are complex and can be conveyed through nuanced touch gestures. Previous research has primarily focused on how humans recognize emotions through touch or on identifying key features of emotional expression for robots. However, there is a gap in understanding how reliably these emotions and gestures can be communicated to robots via touch and interpreted using data driven methods. This study investigates the consistency and distinguishability of emotional and gestural expressions through touch and sound. To this end, we integrated a custom piezoresistive pressure sensor as well as a microphone on a social robot. Twenty-eight participants first conveyed ten different emotions to the robot using spontaneous touch gestures, then they performed six predefined social touch gestures. Our findings reveal statistically significant consistency in both emotion and gesture expression among participants. However, some emotions exhibited low intraclass correlation values, and certain emotions with similar levels of arousal or valence did not show significant differences in their conveyance. To investigate emotion and social gesture decoding within affective human-robot tactile interaction, we developed single-modality models and multimodal models integrating tactile and auditory features. A support vector machine (SVM) model trained on multimodal features achieved the highest accuracy for classifying ten emotions, reaching 40 %.For gesture classification, a Convolutional Neural Network- Long Short-Term Memory Network (CNN-LSTM) achieved 90.74 % accuracy. Our results demonstrate that even though the unimodal models have the potential to decode emotions and touch gestures, the multimodal integration of touch and sound significantly outperforms unimodal approaches, enhancing the decoding of both emotions and gestures.