IRisPath: Enhancing Costmap for Off-Road Navigation with Robust IR-RGB Fusion for Improved Day and Night Traversability

作者: Saksham Sharma, Akshit Raizada, Suresh Sundaram

分类: cs.RO, cs.CV

发布日期: 2024-12-04 (更新: 2025-03-02)

💡 一句话要点

IRisPath:通过稳健的红外-RGB融合增强越野导航的Costmap,提升昼夜可通行性

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 越野导航 多模态融合 红外图像 RGB图像 深度学习 外参标定 Costmap

📋 核心要点

- 现有越野导航方法在动态地形和光照条件下表现不佳,深度学习模型易受域外不确定性影响,鲁棒性不足。

- IRisPath通过融合热成像和RGB图像,利用多模态信息互补,提高系统在不同天气和光照条件下的鲁棒性。

- 论文开源了包含热成像和RGB图像的昼夜数据集,并提出了一种高精度的目标外参标定方法,促进了该领域的研究。

📝 摘要(中文)

自主越野导航在农业、建筑、搜索救援和国防等领域有重要需求。传统的道路自主方法难以适应动态地形,导致车辆在越野条件下控制不佳。最近的深度学习模型利用感知传感器和运动反馈进行地形导航,但存在域外不确定性,如时间、天气变化会影响模型性能。我们提出了一个多模态融合网络“IRisPath”,它能够利用热成像和RGB图像,增强对动态天气和光照条件的鲁棒性。为了促进该领域的研究,我们开源了一个包含热成像和RGB图像以及可通行性伪标签的昼夜数据集。为了融合模型进行配准,我们还开发了一种新的目标外参标定方法,用于热成像、激光雷达和RGB相机,平移精度为+/-1.7cm,旋转精度为+/-0.827度。

🔬 方法详解

问题定义:论文旨在解决越野环境下自主导航系统在动态光照和天气条件下的鲁棒性问题。现有方法,特别是依赖RGB图像的深度学习模型,在夜间或恶劣天气下性能显著下降,限制了其应用范围。因此,需要一种能够适应不同环境条件,提供可靠可通行性评估的导航系统。

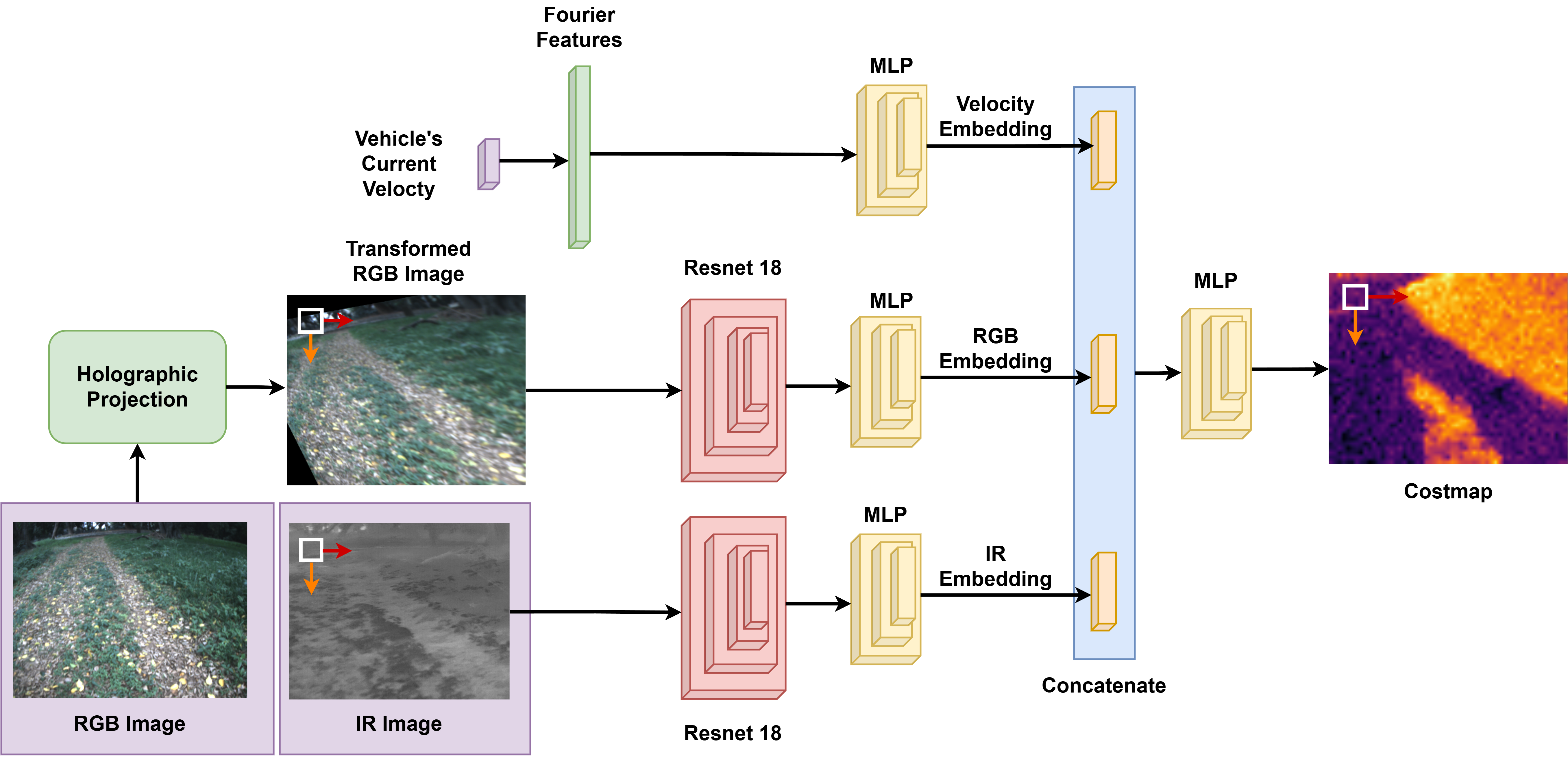

核心思路:论文的核心思路是利用热成像传感器对温度变化不敏感的特性,与RGB图像进行融合,从而提高系统在各种光照和天气条件下的鲁棒性。通过多模态信息互补,克服单一传感器在特定环境下的局限性,实现更可靠的环境感知。

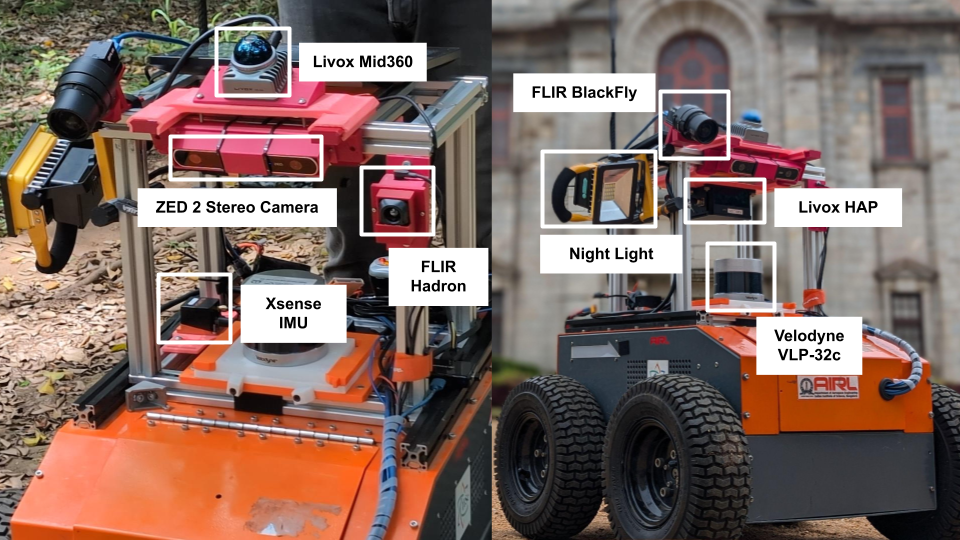

技术框架:IRisPath 采用多模态融合网络,整体流程包括:1) 数据采集:使用RGB相机、热成像相机和激光雷达采集数据,构建昼夜数据集。2) 外参标定:提出一种目标外参标定方法,用于校准RGB相机、热成像相机和激光雷达之间的外参。3) 特征提取与融合:分别从RGB图像和热成像图像中提取特征,然后进行融合。4) 可通行性预测:利用融合后的特征预测地形的可通行性,生成Costmap。

关键创新:论文的关键创新点在于:1) 提出了一种基于热成像和RGB图像融合的越野导航方法,提高了系统在各种光照和天气条件下的鲁棒性。2) 开源了一个包含热成像和RGB图像的昼夜数据集,为该领域的研究提供了数据支持。3) 提出了一种高精度的目标外参标定方法,用于校准RGB相机、热成像相机和激光雷达之间的外参。

关键设计:论文中,融合网络结构未知,损失函数未知,但外参标定方法值得关注。该方法实现了+/-1.7cm的平移精度和+/-0.827度的旋转精度,为多传感器融合提供了保障。数据集的构建也至关重要,包含了不同光照和天气条件下的数据,有助于训练鲁棒性更强的模型。

🖼️ 关键图片

📊 实验亮点

论文的主要实验亮点在于提出了一种高精度的目标外参标定方法,实现了+/-1.7cm的平移精度和+/-0.827度的旋转精度。此外,论文开源了一个包含热成像和RGB图像的昼夜数据集,为该领域的研究提供了宝贵的数据资源。虽然论文中没有明确给出性能提升的具体数据,但通过融合热成像和RGB图像,可以预期在夜间或恶劣天气条件下,可通行性预测的准确率将显著提高。

🎯 应用场景

该研究成果可应用于多种越野自主导航场景,如农业机器人、建筑机器人、搜索救援机器人和国防应用。通过提高系统在各种光照和天气条件下的鲁棒性,可以实现更可靠、更安全的越野导航,从而提高工作效率和安全性。未来,该技术有望应用于更广泛的机器人领域,例如矿业、林业等。

📄 摘要(原文)

Autonomous off-road navigation is required for applications in agriculture, construction, search and rescue and defence. Traditional on-road autonomous methods struggle with dynamic terrains, leading to poor vehicle control in off-road conditions. Recent deep-learning models have used perception sensors along with kinesthetic feedback for navigation on such terrains. However, this approach has out-of-domain uncertainty. Factors like change in time of day and weather impacts the performance of the model. We propose a multi modal fusion network "IRisPath" capable of using Thermal and RGB images to provide robustness against dynamic weather and light conditions. To aid further works in this domain, we also open-source a day-night dataset with Thermal and RGB images along with pseudo-labels for traversability. In order to co-register for fusion model we also develop a novel method for targetless extrinsic calibration of Thermal, LiDAR and RGB cameras with translation accuracy of +/-1.7cm and rotation accuracy of +/-0.827degrees.