UniGraspTransformer: Simplified Policy Distillation for Scalable Dexterous Robotic Grasping

作者: Wenbo Wang, Fangyun Wei, Lei Zhou, Xi Chen, Lin Luo, Xiaohan Yi, Yizhong Zhang, Yaobo Liang, Chang Xu, Yan Lu, Jiaolong Yang, Baining Guo

分类: cs.RO

发布日期: 2024-12-03 (更新: 2025-03-04)

备注: Accepted to CVPR 2025. Project page: https://dexhand.github.io/UniGraspTransformer

🔗 代码/项目: PROJECT_PAGE

💡 一句话要点

UniGraspTransformer:简化策略蒸馏,实现可扩展的灵巧机械臂抓取

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 灵巧抓取 机器人 Transformer 策略蒸馏 强化学习 通用抓取 视觉感知

📋 核心要点

- 现有灵巧机械臂抓取方法训练流程复杂,可扩展性受限,难以处理大量不同姿态的对象。

- UniGraspTransformer通过策略蒸馏,将多个对象上的强化学习策略提炼到一个通用Transformer网络中。

- 实验表明,UniGraspTransformer在多种对象类别上显著优于现有方法,尤其在未见对象上的泛化能力更强。

📝 摘要(中文)

本文提出了一种名为UniGraspTransformer的通用Transformer网络,用于灵巧机械臂抓取。该方法简化了训练流程,同时增强了可扩展性和性能。与UniDexGrasp++等需要复杂多步训练流程的现有方法不同,UniGraspTransformer采用简化的流程:首先,使用强化学习训练专门的策略网络,用于单个对象的抓取轨迹生成;然后,将这些轨迹提炼成一个通用的网络。这种方法使UniGraspTransformer能够有效地扩展,集成多达12个自注意力模块,以处理具有不同姿势的数千个对象。此外,它能很好地泛化到理想化和真实世界的输入,并在基于状态和基于视觉的设置中进行评估。值得注意的是,UniGraspTransformer为各种形状和方向的对象生成更广泛的抓取姿势,从而产生更多样化的抓取策略。实验结果表明,在各种对象类别中,该方法优于最先进的UniDexGrasp++,在基于视觉的设置中,对于已见对象、已见类别中的未见对象和完全未见对象,成功率分别提高了3.5%、7.7%和10.1%。

🔬 方法详解

问题定义:现有灵巧机械臂抓取方法,如UniDexGrasp++,通常需要复杂的多阶段训练流程,例如先训练多个特定对象的抓取策略,再进行迁移学习或元学习。这种复杂性限制了其可扩展性,难以处理大量具有不同姿态的对象,并且训练成本高昂。

核心思路:UniGraspTransformer的核心思路是利用策略蒸馏,将多个针对特定对象的强化学习策略“提炼”到一个通用的Transformer网络中。这样,网络就能学习到通用的抓取策略,从而提高泛化能力和可扩展性。通过简化训练流程,降低了训练成本,并提升了模型性能。

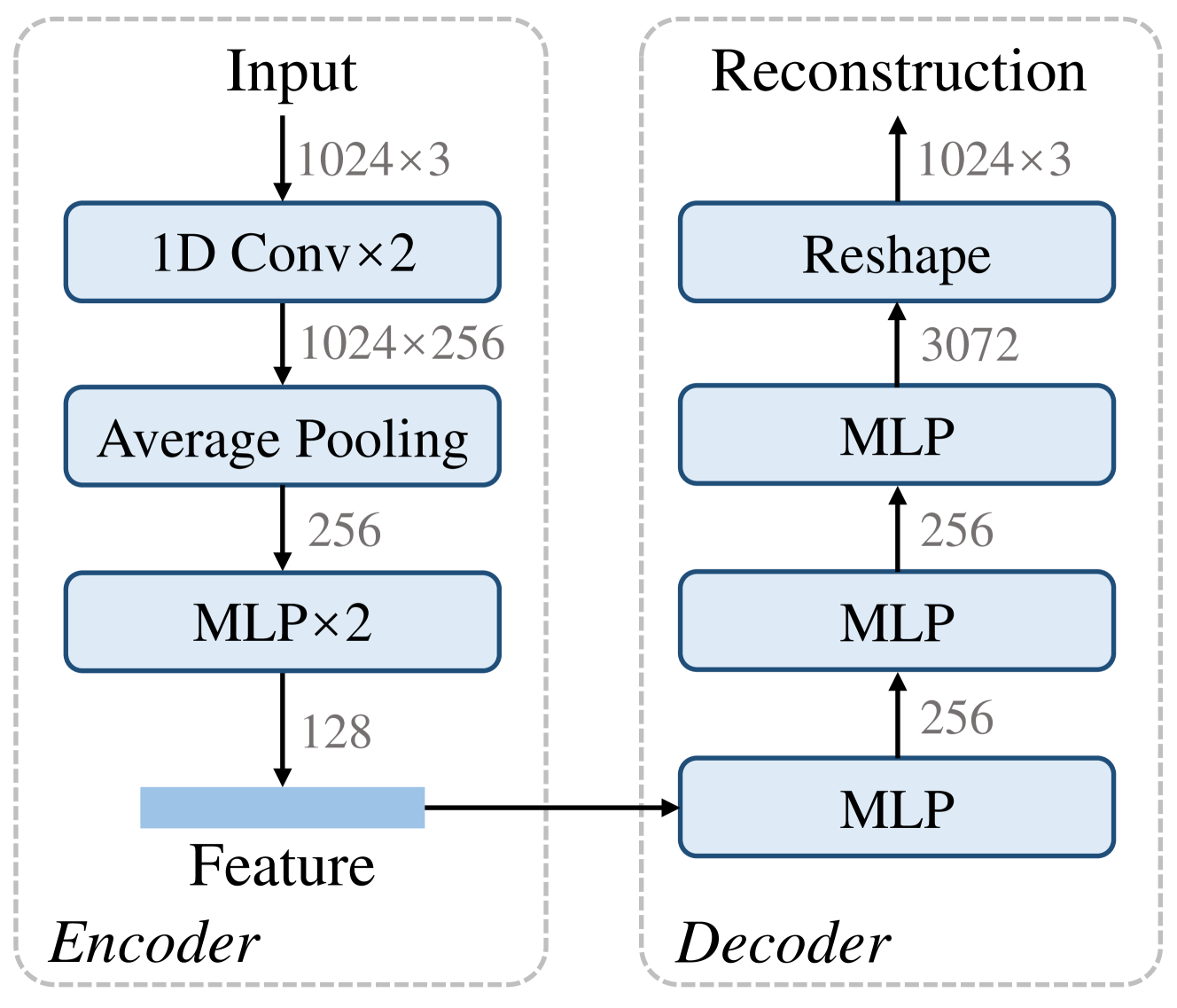

技术框架:UniGraspTransformer的整体框架包含两个主要阶段:1) 专家策略训练阶段:针对每个对象,使用强化学习训练一个专门的抓取策略网络,生成成功的抓取轨迹。2) 策略蒸馏阶段:将所有对象的抓取轨迹作为训练数据,训练一个通用的Transformer网络(UniGraspTransformer),使其学习模仿专家策略的行为。该Transformer网络接收对象的状态或视觉信息作为输入,输出抓取姿势。

关键创新:UniGraspTransformer的关键创新在于其简化的训练流程和通用的Transformer架构。与需要复杂多步训练的现有方法不同,UniGraspTransformer采用两阶段的策略蒸馏,大大简化了训练过程。此外,使用Transformer架构能够有效地处理不同对象和姿态的信息,从而提高泛化能力。

关键设计:UniGraspTransformer的关键设计包括:1) 使用强化学习训练专家策略,保证了训练数据的质量。2) 使用Transformer架构,能够有效地捕捉对象之间的关系和姿态信息。3) 使用策略蒸馏,将多个专家策略提炼到一个通用网络中,提高了泛化能力。4) 网络包含多达12个自注意力模块,以处理数千个具有不同姿势的对象。损失函数未知。

🖼️ 关键图片

📊 实验亮点

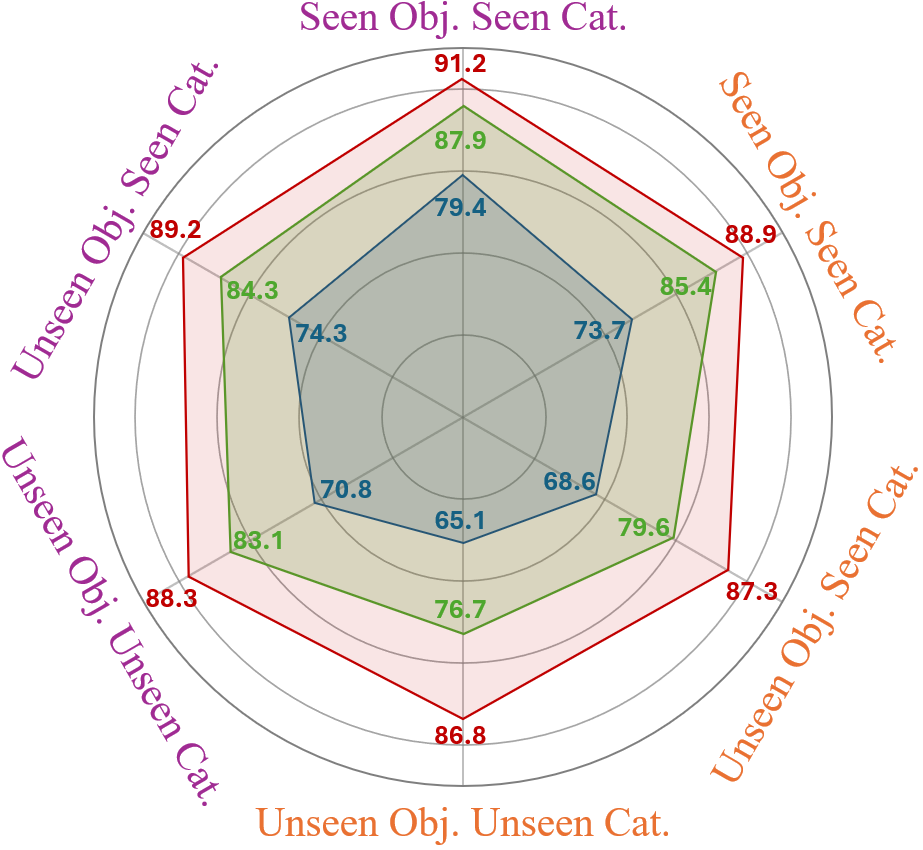

UniGraspTransformer在多个对象类别上显著优于最先进的UniDexGrasp++。在基于视觉的设置中,对于已见对象,成功率提高了3.5%;对于已见类别中的未见对象,成功率提高了7.7%;对于完全未见对象,成功率提高了10.1%。这些结果表明,UniGraspTransformer具有更强的泛化能力。

🎯 应用场景

UniGraspTransformer在工业自动化、家庭服务机器人、医疗机器人等领域具有广泛的应用前景。它可以用于实现对各种形状和大小物体的自动抓取,提高生产效率和服务质量。通过结合视觉感知技术,机器人可以自主识别和抓取目标物体,从而实现更智能化的操作。

📄 摘要(原文)

We introduce UniGraspTransformer, a universal Transformer-based network for dexterous robotic grasping that simplifies training while enhancing scalability and performance. Unlike prior methods such as UniDexGrasp++, which require complex, multi-step training pipelines, UniGraspTransformer follows a streamlined process: first, dedicated policy networks are trained for individual objects using reinforcement learning to generate successful grasp trajectories; then, these trajectories are distilled into a single, universal network. Our approach enables UniGraspTransformer to scale effectively, incorporating up to 12 self-attention blocks for handling thousands of objects with diverse poses. Additionally, it generalizes well to both idealized and real-world inputs, evaluated in state-based and vision-based settings. Notably, UniGraspTransformer generates a broader range of grasping poses for objects in various shapes and orientations, resulting in more diverse grasp strategies. Experimental results demonstrate significant improvements over state-of-the-art, UniDexGrasp++, across various object categories, achieving success rate gains of 3.5%, 7.7%, and 10.1% on seen objects, unseen objects within seen categories, and completely unseen objects, respectively, in the vision-based setting. Project page: https://dexhand.github.io/UniGraspTransformer.