Optimizing Plastic Waste Collection in Water Bodies Using Heterogeneous Autonomous Surface Vehicles with Deep Reinforcement Learning

作者: Alejandro Mendoza Barrionuevo, Samuel Yanes Luis, Daniel Gutiérrez Reina, Sergio L. Toral Marín

分类: cs.RO, cs.LG

发布日期: 2024-12-03

备注: This article is currently under revision for the Robotics and Automation Letters (IEEE)

💡 一句话要点

提出基于深度强化学习的异构自主水面船队协作方案,优化水域塑料垃圾清理。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 深度强化学习 自主水面船队 异构机器人 水域垃圾清理 多智能体协作

📋 核心要点

- 现有水面垃圾清理方法缺乏效率,难以适应复杂水域环境,且异构船队协作策略不足。

- 利用深度强化学习,构建侦察队和清理队协作机制,侦察队提供污染模型,清理队高效收集垃圾。

- 实验表明,该方法在不同水域场景下优于传统启发式算法,尤其在复杂环境中表现出更强的适应性。

📝 摘要(中文)

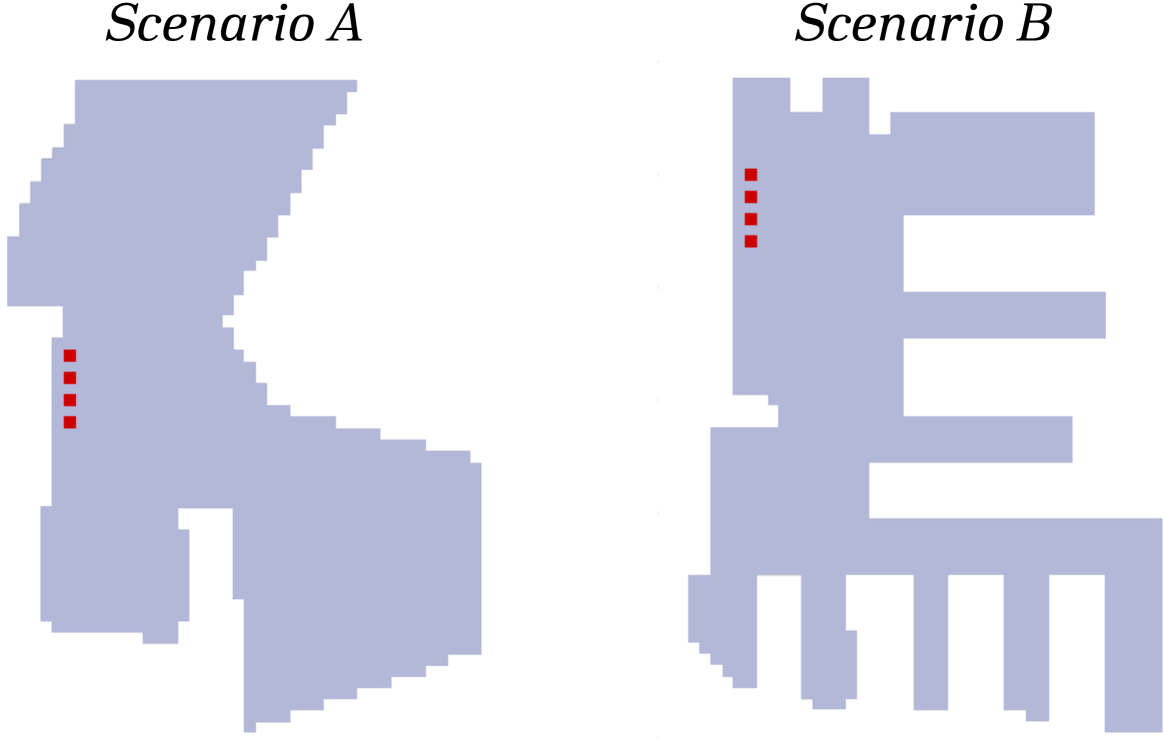

本文提出了一种基于无模型深度强化学习的框架,用于异构自主水面船队的信息路径规划,以定位和收集塑料垃圾。该系统采用两支船队:侦察队和清理队。通过深度强化学习方法实现两队之间的协调,使智能体能够学习最大化清理效率的策略。主要目标是侦察队提供最新的污染模型,而清理队根据该模型收集尽可能多的垃圾。这种策略促成了异构团队的形成,通过定制的奖励函数支持的团队间合作来优化船队效率。将所提出算法的不同训练方式与两种不同场景(一种具有高凸性,另一种具有狭窄的走廊和具有挑战性的访问)中的其他最先进的启发式方法进行了比较。结果表明,基于深度强化学习的算法优于其他基准启发式方法,表现出卓越的适应性。此外,使用贪婪动作进行训练进一步提高了性能,尤其是在具有复杂布局的场景中。

🔬 方法详解

问题定义:该论文旨在解决如何利用异构自主水面船队高效地定位和清理水域中的塑料垃圾问题。现有方法通常依赖于人工干预或简单的启发式算法,效率低下,难以适应复杂的水域环境,并且缺乏对异构船队之间有效协作的考虑。

核心思路:论文的核心思路是利用深度强化学习(DRL)来训练异构船队,使其能够自主学习最优的垃圾清理策略。通过将船队分为侦察队和清理队,并设计合适的奖励函数,鼓励两队之间进行协作,从而提高整体的清理效率。侦察队负责构建污染模型,清理队根据该模型进行垃圾收集。

技术框架:该框架包含两个主要的智能体团队:侦察队和清理队。侦察队负责探索水域环境,收集污染信息,并构建污染模型。清理队则根据侦察队提供的污染模型,规划路径并收集垃圾。两个团队通过深度强化学习算法进行训练,学习如何协同工作以最大化垃圾清理效率。整体流程是:环境状态输入 -> 侦察队行动 -> 更新污染模型 -> 清理队行动 -> 计算奖励 -> 更新策略。

关键创新:该论文的关键创新在于利用深度强化学习实现了异构自主水面船队的协作式垃圾清理。与传统的启发式算法相比,DRL能够学习到更优的策略,并且具有更强的适应性。此外,通过设计定制的奖励函数,鼓励侦察队和清理队之间的协作,进一步提高了清理效率。

关键设计:论文中使用了深度Q网络(DQN)作为强化学习算法的基础。奖励函数的设计至关重要,它需要平衡侦察队的探索和清理队的收集任务。具体而言,奖励函数可能包含以下几个部分:收集到的垃圾数量、侦察队提供的污染模型准确度、以及团队之间的协作程度。此外,论文还探索了使用贪婪动作进行训练的方法,以进一步提高性能,尤其是在复杂环境中。

🖼️ 关键图片

📊 实验亮点

实验结果表明,基于深度强化学习的算法在垃圾清理效率方面优于其他基准启发式方法。在具有复杂布局的场景中,使用贪婪动作进行训练的DRL算法表现出更强的适应性和更高的清理效率。具体性能数据(例如,清理垃圾的百分比或清理时间)需要参考原始论文。

🎯 应用场景

该研究成果可应用于江河湖泊等水域的塑料垃圾清理,具有重要的环保价值。通过部署自主水面船队,可以有效降低人工清理成本,提高清理效率,并减少对水域生态环境的干扰。未来,该技术还可扩展到其他水面污染物的清理,如油污、藻类等。

📄 摘要(原文)

This paper presents a model-free deep reinforcement learning framework for informative path planning with heterogeneous fleets of autonomous surface vehicles to locate and collect plastic waste. The system employs two teams of vehicles: scouts and cleaners. Coordination between these teams is achieved through a deep reinforcement approach, allowing agents to learn strategies to maximize cleaning efficiency. The primary objective is for the scout team to provide an up-to-date contamination model, while the cleaner team collects as much waste as possible following this model. This strategy leads to heterogeneous teams that optimize fleet efficiency through inter-team cooperation supported by a tailored reward function. Different trainings of the proposed algorithm are compared with other state-of-the-art heuristics in two distinct scenarios, one with high convexity and another with narrow corridors and challenging access. According to the obtained results, it is demonstrated that deep reinforcement learning based algorithms outperform other benchmark heuristics, exhibiting superior adaptability. In addition, training with greedy actions further enhances performance, particularly in scenarios with intricate layouts.