RoboHanger: Learning Generalizable Robotic Hanger Insertion for Diverse Garments

作者: Yuxing Chen, Songlin Wei, Bowen Xiao, Jiangran Lyu, Jiayi Chen, Feng Zhu, He Wang

分类: cs.RO

发布日期: 2024-12-02 (更新: 2025-07-04)

备注: https://pku-epic.github.io/RoboHanger/

💡 一句话要点

RoboHanger:学习通用机器人衣架插入,适用于多样化服装

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱二:RL算法与架构 (RL & Architecture)

关键词: 机器人 服装悬挂 衣架插入 深度强化学习 Sim2Real 策略学习 任务分解 深度图像

📋 核心要点

- 现有机器人服装悬挂方法难以处理服装的高自由度和任务的长期性,且缺乏有效数据。

- 该论文将衣架插入任务分解为多个子任务,并使用低维动作参数化进行策略学习,简化学习过程。

- 通过在自建模拟器中训练,该方法在真实环境中对未见过的服装实现了较高的衣架插入成功率。

📝 摘要(中文)

本文研究了服装悬挂任务中的关键步骤:如何将衣架插入到服装中,这在机器人领域鲜有探索。我们解决了将衣架插入到最初平放在桌子上的各种未见过的服装中的问题。由于任务的长期性、服装的高度自由度和数据的缺乏,这项任务具有挑战性。为了简化学习过程,我们首先将任务分解为几个子任务。然后,我们将每个子任务制定为策略学习问题,并提出了一种低维动作参数化方法。为了克服数据有限的挑战,我们构建了自己的模拟器,并创建了144个合成服装资产,以有效地收集高质量的训练数据。我们的方法使用单视角深度图像和对象掩码作为输入,从而减轻了Sim2Real的外观差距,并实现了对新服装的高度泛化能力。在模拟和现实中的大量实验验证了我们提出的方法。通过在模拟器中对各种服装进行训练,我们的方法在现实世界中对8种不同的未见过服装实现了75%的成功率。

🔬 方法详解

问题定义:该论文旨在解决机器人自动将衣架插入到不同类型服装中的问题。现有方法难以处理服装的形变、褶皱等带来的高自由度,以及任务的长期性,导致泛化能力差。此外,真实世界数据的收集成本高昂,限制了算法的训练和优化。

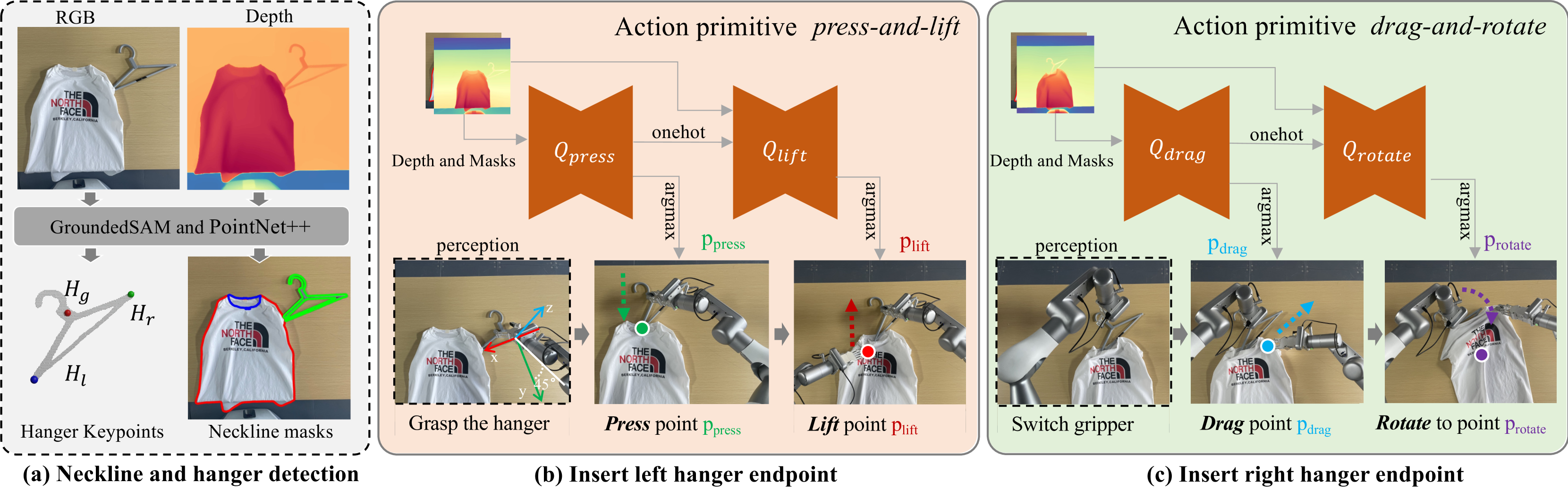

核心思路:论文的核心思路是将复杂的衣架插入任务分解为多个可学习的子任务,例如:定位服装开口、调整衣架姿态、插入衣架等。通过分而治之的方式,降低了每个子任务的复杂度,使得策略学习更加高效。同时,利用模拟器生成大量合成数据,弥补真实数据不足的问题。

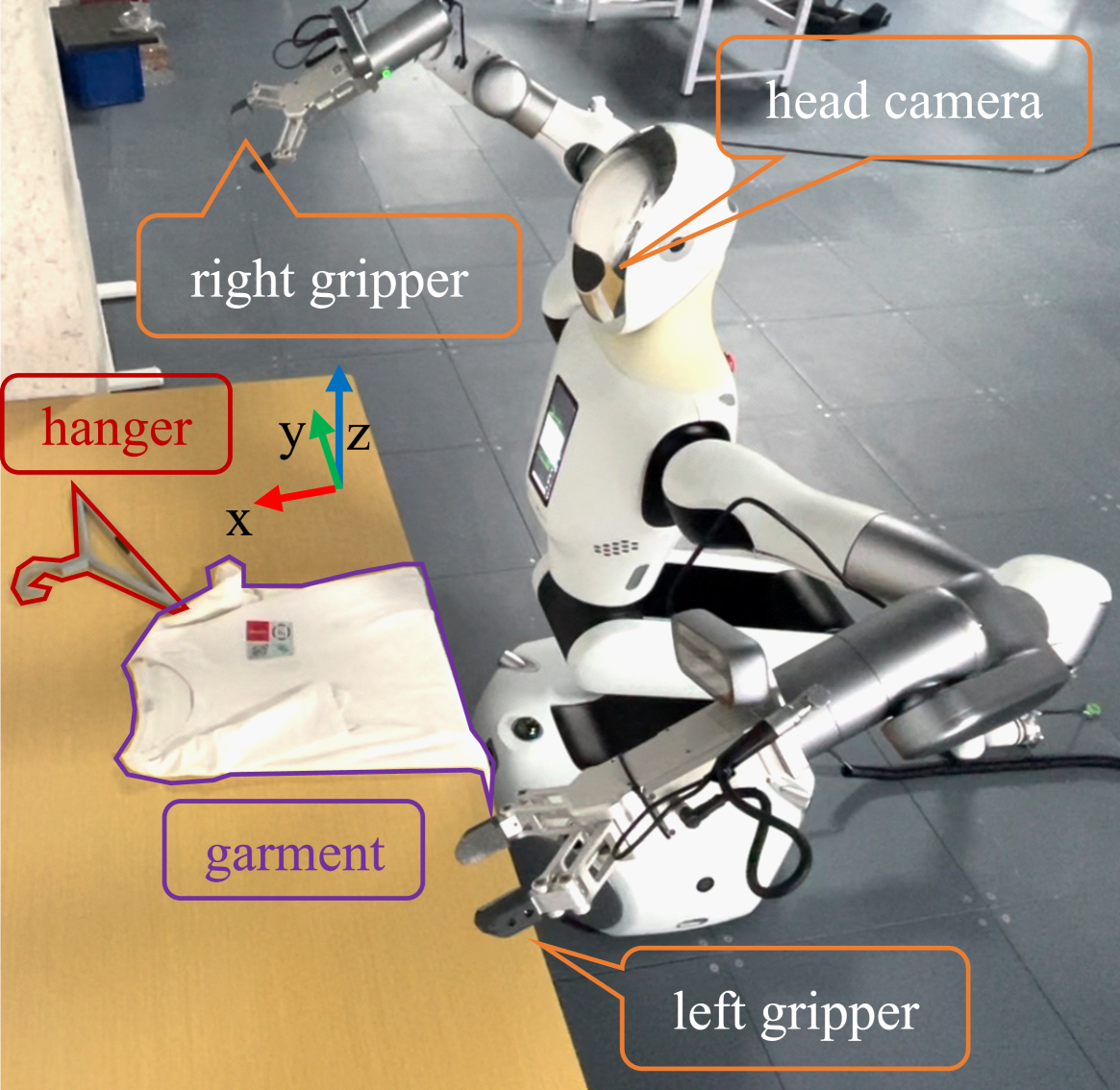

技术框架:整体框架包含以下几个主要模块:1) 感知模块:利用单目深度相机获取服装的深度图像和对象掩码;2) 任务分解模块:将衣架插入任务分解为多个子任务;3) 策略学习模块:为每个子任务训练一个策略网络,学习合适的动作参数;4) 动作执行模块:将策略网络输出的动作参数转化为机器人的具体动作,控制机器人执行衣架插入操作。

关键创新:该论文的关键创新在于:1) 提出了一种低维动作参数化方法,降低了动作空间的维度,简化了策略学习过程;2) 构建了一个高质量的服装模拟器,生成了大量多样化的合成数据,有效解决了数据稀缺问题;3) 采用单目深度图像和对象掩码作为输入,降低了Sim2Real的差距,提高了算法的泛化能力。

关键设计:论文使用深度强化学习训练策略网络,奖励函数的设计考虑了任务的成功率和效率。模拟器中,服装的材质、形状、颜色等参数随机生成,以增加数据的多样性。动作参数化方面,论文将机器人的动作分解为平移和旋转,并使用相对坐标系,降低了动作空间的维度。

🖼️ 关键图片

📊 实验亮点

该方法在模拟器中训练后,在真实环境中对8种未见过的服装进行了测试,取得了75%的成功率。这表明该方法具有良好的泛化能力和鲁棒性。此外,该方法仅使用单目深度图像作为输入,降低了对硬件的要求,更易于实际应用。

🎯 应用场景

该研究成果可应用于服装制造、仓储物流、智能家居等领域。在服装制造中,机器人可以自动完成衣架插入,提高生产效率。在仓储物流中,机器人可以自动整理和悬挂服装,降低人工成本。在智能家居中,机器人可以帮助用户整理衣物,提升生活品质。未来,该技术有望进一步推广到其他柔性物体的操作任务中。

📄 摘要(原文)

For the task of hanging clothes, learning how to insert a hanger into a garment is a crucial step, but has rarely been explored in robotics. In this work, we address the problem of inserting a hanger into various unseen garments that are initially laid flat on a table. This task is challenging due to its long-horizon nature, the high degrees of freedom of the garments and the lack of data. To simplify the learning process, we first propose breaking the task into several subtasks. Then, we formulate each subtask as a policy learning problem and propose a low-dimensional action parameterization. To overcome the challenge of limited data, we build our own simulator and create 144 synthetic clothing assets to effectively collect high-quality training data. Our approach uses single-view depth images and object masks as input, which mitigates the Sim2Real appearance gap and achieves high generalization capabilities for new garments. Extensive experiments in both simulation and reality validate our proposed method. By training on various garments in the simulator, our method achieves a 75\% success rate with 8 different unseen garments in the real world.