ARMOR: Egocentric Perception for Humanoid Robot Collision Avoidance and Motion Planning

作者: Daehwa Kim, Mario Srouji, Chen Chen, Jian Zhang

分类: cs.RO, cs.LG

发布日期: 2024-11-30

💡 一句话要点

ARMOR:用于人形机器人避障和运动规划的以自我为中心的感知系统

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱二:RL算法与架构 (RL & Architecture) 支柱六:视频提取与匹配 (Video Extraction)

关键词: 人形机器人 碰撞避免 运动规划 以自我为中心感知 模仿学习

📋 核心要点

- 人形机器人感知能力不足,难以在复杂环境中进行运动规划,是当前研究面临的核心问题。

- ARMOR系统通过集成可穿戴深度传感器,构建分布式感知系统,增强机器人对环境的感知能力,从而实现更灵活的运动规划。

- 实验结果表明,ARMOR系统在避障和运动规划方面显著优于传统方案,并在真实机器人上成功部署。

📝 摘要(中文)

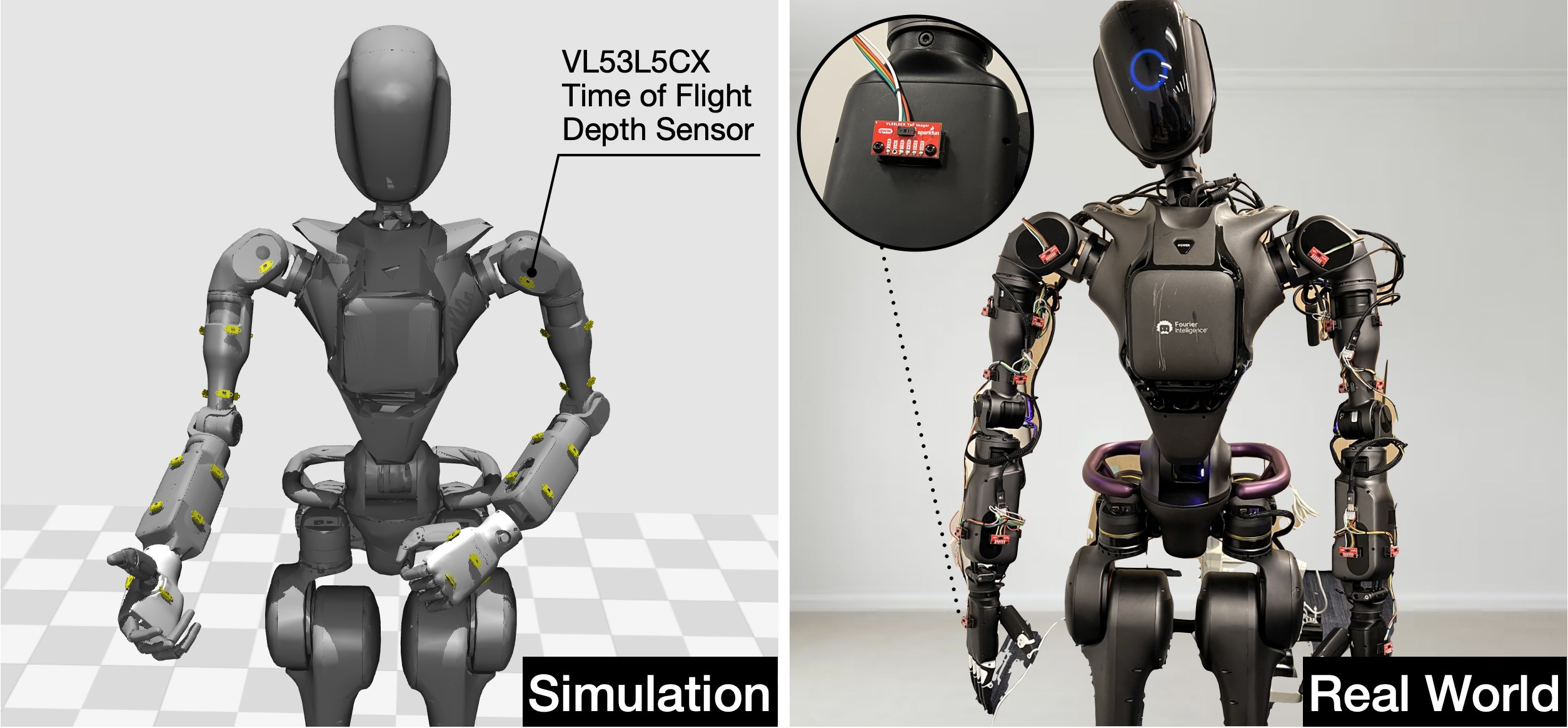

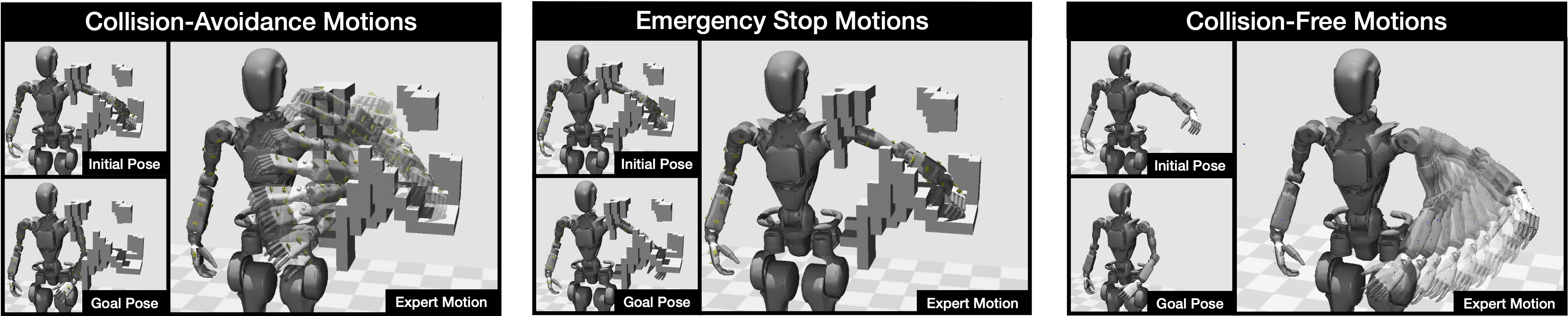

本文介绍了一种名为ARMOR的新型以自我为中心的感知系统,该系统集成了硬件和软件,特别为人形机器人设计了类似穿戴式的深度传感器,以解决人形机器人在密集环境中进行运动规划时感知能力不足的问题。这种分布式感知方法增强了机器人对周围环境的空间感知能力,并促进了更灵活的运动规划。此外,通过利用AMASS数据集中约86小时的人类真实运动数据,在模拟环境中训练了一个基于Transformer的模仿学习(IL)策略,用于动态避障。实验表明,ARMOR感知系统优于配备多个头部和外部深度摄像头的设置,碰撞次数减少了63.7%,成功率提高了78.7%。与基于采样的运动规划专家cuRobo相比,IL策略的碰撞次数减少了31.6%,成功率提高了16.9%,计算延迟降低了26倍。最后,ARMOR感知系统已部署在Fourier Intelligence的真实GR1人形机器人上。源代码、硬件描述和3D CAD文件链接将在arXiv版本中更新。

🔬 方法详解

问题定义:人形机器人在复杂环境中进行运动规划时,由于感知能力的限制,容易发生碰撞,导致任务失败。现有的感知方案,例如头部安装多个深度相机或外部相机,存在视野盲区、遮挡等问题,无法提供全面、准确的环境信息。

核心思路:ARMOR的核心思路是采用分布式感知,通过在机器人身上集成类似穿戴式的深度传感器,从以自我为中心的视角获取环境信息。这种方式可以减少视野盲区和遮挡,提供更全面、准确的环境感知,从而支持更安全、高效的运动规划。

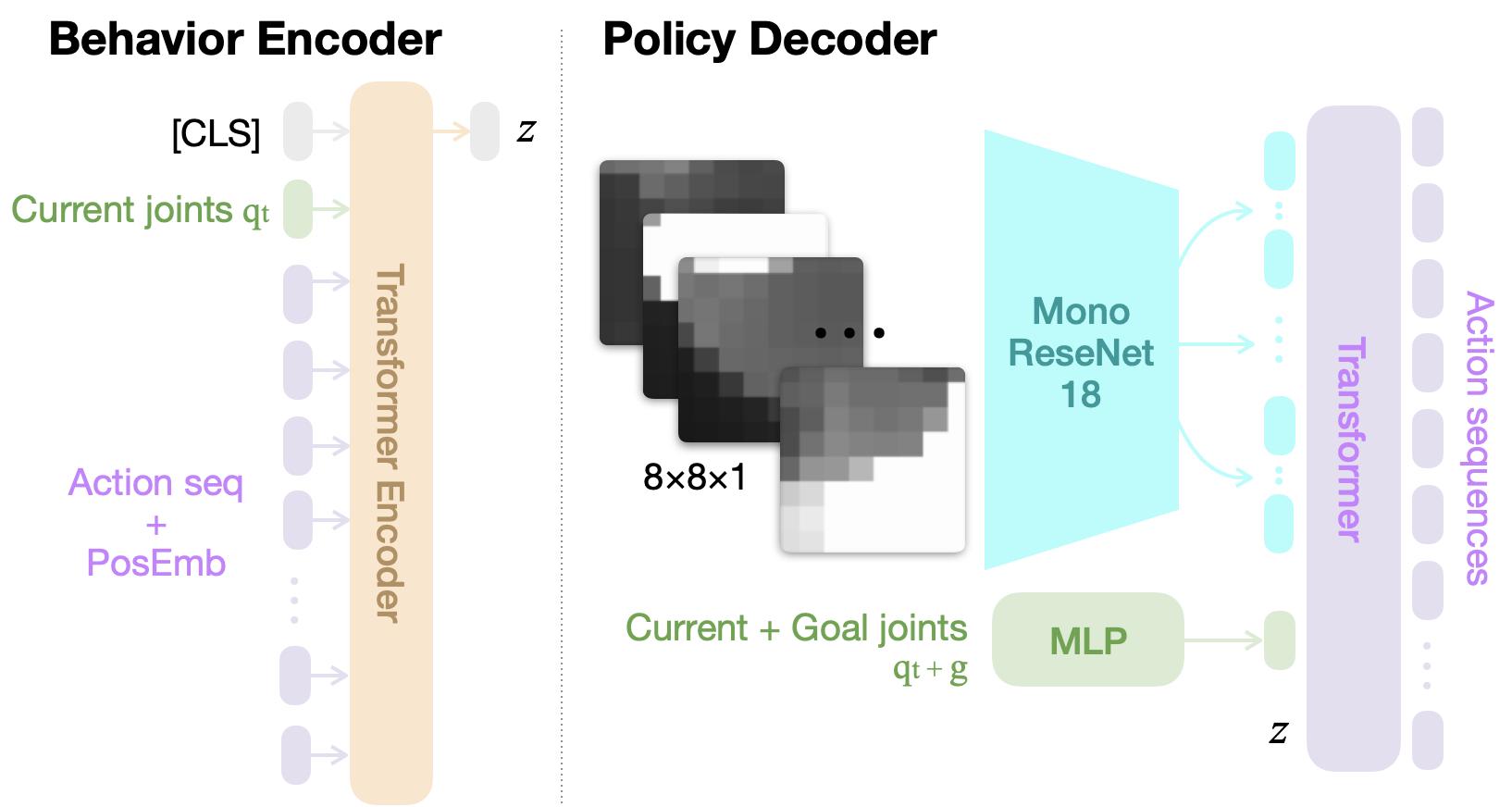

技术框架:ARMOR系统主要包含两个部分:硬件部分和软件部分。硬件部分是集成了深度传感器的可穿戴设备,软件部分包括感知模块和运动规划模块。感知模块负责处理深度传感器数据,构建环境地图;运动规划模块则基于环境地图,生成无碰撞的运动轨迹。此外,还使用模仿学习训练了一个基于Transformer的策略,用于动态避障。

关键创新:ARMOR的关键创新在于其以自我为中心的分布式感知方法。与传统的集中式感知方法相比,ARMOR可以提供更全面、准确的环境信息,从而提高机器人的运动规划能力。此外,使用模仿学习训练避障策略,可以提高机器人的反应速度和适应性。

关键设计:Transformer网络结构被用于模仿学习策略的训练,利用AMASS数据集中的人类运动数据。损失函数的设计旨在最小化机器人与环境的碰撞,并最大化任务完成的成功率。深度传感器的选择和布局也经过精心设计,以最大程度地减少视野盲区和遮挡。

🖼️ 关键图片

📊 实验亮点

实验结果表明,ARMOR感知系统在避障和运动规划方面显著优于传统方案。与配备多个头部和外部深度摄像头的设置相比,碰撞次数减少了63.7%,成功率提高了78.7%。与基于采样的运动规划专家cuRobo相比,IL策略的碰撞次数减少了31.6%,成功率提高了16.9%,计算延迟降低了26倍。这些数据表明,ARMOR系统具有很强的实用价值。

🎯 应用场景

ARMOR系统可应用于各种需要人形机器人在复杂环境中进行作业的场景,例如:仓储物流、医疗康复、灾难救援等。该系统能够提高机器人的自主性和安全性,使其能够更好地适应复杂、动态的环境,完成各种任务。未来,该技术有望推动人形机器人在更多领域的应用。

📄 摘要(原文)

Humanoid robots have significant gaps in their sensing and perception, making it hard to perform motion planning in dense environments. To address this, we introduce ARMOR, a novel egocentric perception system that integrates both hardware and software, specifically incorporating wearable-like depth sensors for humanoid robots. Our distributed perception approach enhances the robot's spatial awareness, and facilitates more agile motion planning. We also train a transformer-based imitation learning (IL) policy in simulation to perform dynamic collision avoidance, by leveraging around 86 hours worth of human realistic motions from the AMASS dataset. We show that our ARMOR perception is superior against a setup with multiple dense head-mounted, and externally mounted depth cameras, with a 63.7% reduction in collisions, and 78.7% improvement on success rate. We also compare our IL policy against a sampling-based motion planning expert cuRobo, showing 31.6% less collisions, 16.9% higher success rate, and 26x reduction in computational latency. Lastly, we deploy our ARMOR perception on our real-world GR1 humanoid from Fourier Intelligence. We are going to update the link to the source code, HW description, and 3D CAD files in the arXiv version of this text.