λ: A Benchmark for Data-Efficiency in Long-Horizon Indoor Mobile Manipulation Robotics

作者: Ahmed Jaafar, Shreyas Sundara Raman, Sudarshan Harithas, Yichen Wei, Sofia Juliani, Anneke Wernerfelt, Benedict Quartey, Ifrah Idrees, Jason Xinyu Liu, Stefanie Tellex

分类: cs.RO, cs.AI, cs.LG

发布日期: 2024-11-28 (更新: 2025-08-01)

备注: Accepted to IROS 2025. Sudarshan Harithas and Yichen Wei contributed equally. 8 pages. 7 figures

💡 一句话要点

提出LAMBDA基准,用于评估长时程室内移动操作机器人数据效率

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 移动操作 长时程任务 数据效率 神经符号方法 基准数据集

📋 核心要点

- 长时程移动操作任务的学习对于家庭和工作场所的机器人技术至关重要,但现有方法通常数据效率低下。

- LAMBDA基准通过人工收集的真实轨迹,评估模型在复杂室内环境下的长时程任务数据效率。

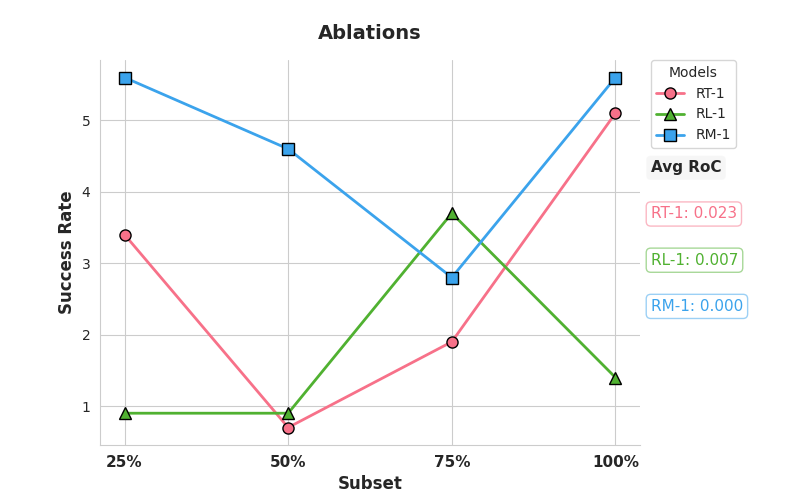

- 实验表明,神经符号方法在LAMBDA基准上表现优于端到端学习方法,且所需数据更少。

📝 摘要(中文)

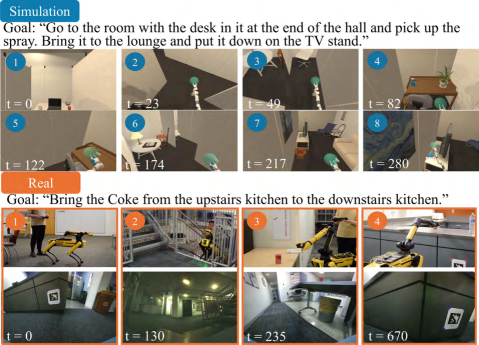

本文提出了LAMBDA(λ)基准,即用于定向活动移动操作基准的长时程动作,旨在评估模型在语言条件下的长时程、多房间、多楼层、拾取和放置任务中的数据效率。该基准包含571个人工收集的演示,提供了模拟和真实世界环境中的真实性和多样性。与规划器生成的数据不同,这些轨迹提供了自然的变异性和可重放验证性,确保了稳健的学习和评估。利用λ基准测试了当前端到端学习方法和模块化神经符号方法,后者结合了基础模型与任务和运动规划。结果表明,即使经过预训练,学习方法的成功率也较低,而神经符号方法的性能明显更好,且所需数据更少。

🔬 方法详解

问题定义:现有长时程移动操作任务的学习方法通常需要大量数据,数据效率低下,难以在真实环境中部署。规划器生成的数据缺乏真实性和多样性,限制了模型的泛化能力。因此,需要一个更贴近实际、数据量适中的基准来评估和提升模型的数据效率。

核心思路:论文的核心思路是构建一个更具真实性和可管理数据量的基准数据集,即LAMBDA。该数据集包含人工收集的、具有自然变异性的长时程移动操作任务轨迹,并利用该数据集来评估不同学习方法的数据效率,特别是神经符号方法。

技术框架:LAMBDA基准包含571个人工收集的演示数据,涵盖多房间、多楼层的室内环境,以及语言条件下的拾取和放置任务。论文使用LAMBDA基准来评估端到端学习方法和模块化神经符号方法。神经符号方法结合了基础模型(用于感知和语言理解)与任务和运动规划器(用于生成可执行的动作序列)。

关键创新:LAMBDA基准的关键创新在于其数据的真实性和可管理性。与以往的规划器生成的数据集不同,LAMBDA数据集中的轨迹由人工收集,包含了人类操作的自然变异性和不确定性,更贴近真实世界的场景。此外,数据集的大小适中,更易于收集和使用,降低了研究成本。神经符号方法通过结合基础模型和任务规划器,提高了模型的泛化能力和数据效率。

关键设计:LAMBDA数据集包含多种室内环境和任务,并提供了语言描述作为任务条件。神经符号方法使用预训练的基础模型来处理语言指令和感知环境信息,然后使用任务和运动规划器将高级指令转化为具体的动作序列。具体的参数设置、损失函数和网络结构等技术细节在论文中未详细说明,属于未知信息。

🖼️ 关键图片

📊 实验亮点

实验结果表明,在LAMBDA基准上,即使经过预训练,端到端学习方法的成功率仍然较低,而神经符号方法的性能明显更好,且所需数据更少。这表明神经符号方法在长时程移动操作任务中具有更高的数据效率和泛化能力,为未来的机器人研究提供了新的方向。

🎯 应用场景

该研究成果可应用于家庭服务机器人、仓储物流机器人、医疗辅助机器人等领域。通过提高机器人数据效率,降低部署成本,使其能够更好地理解人类指令,完成复杂的长时程任务,例如整理房间、搬运物品、辅助病人等,从而提升生活质量和工作效率。

📄 摘要(原文)

Learning to execute long-horizon mobile manipulation tasks is crucial for advancing robotics in household and workplace settings. However, current approaches are typically data-inefficient, underscoring the need for improved models that require realistically sized benchmarks to evaluate their efficiency. To address this, we introduce the LAMBDA (λ) benchmark-Long-horizon Actions for Mobile-manipulation Benchmarking of Directed Activities-which evaluates the data efficiency of models on language-conditioned, long-horizon, multi-room, multi-floor, pick-and-place tasks using a dataset of manageable size, more feasible for collection. Our benchmark includes 571 human-collected demonstrations that provide realism and diversity in simulated and real-world settings. Unlike planner-generated data, these trajectories offer natural variability and replay-verifiability, ensuring robust learning and evaluation. We leverage λ to benchmark current end-to-end learning methods and a modular neuro-symbolic approach that combines foundation models with task and motion planning. We find that learning methods, even when pretrained, yield lower success rates, while a neuro-symbolic method performs significantly better and requires less data.