Semi-Supervised Neural Processes for Articulated Object Interactions

作者: Emily Liu, Michael Noseworthy, Nicholas Roy

分类: cs.RO, cs.LG

发布日期: 2024-11-28

💡 一句话要点

提出半监督神经过程(SSNP)模型,解决铰接物体交互中标签数据稀缺问题。

🎯 匹配领域: 支柱一:机器人控制 (Robot Control)

关键词: 半监督学习 神经过程 机器人操作 铰接物体交互 奖励预测

📋 核心要点

- 机器人操作学习面临标注数据稀缺的挑战,获取大量带标签的交互数据成本高昂。

- 论文提出半监督神经过程(SSNP),利用大量无标签视觉数据进行预训练,提升模型泛化能力。

- 在开门任务中,SSNP仅使用少量数据就超越了其他半监督方法,验证了其有效性。

📝 摘要(中文)

针对机器人物体操作中标记动作数据稀缺的挑战,本文提出了一种半监督神经过程(SSNP)。由于机器人与大量物体交互的成本高昂且通常不可行,因此利用丰富的无交互物体视觉数据进行预训练和特征提取至关重要。然而,现有基于图像数据进行预训练的方法难以适应特定任务的预测,因为学习到的特征不一定相关。SSNP是一种自适应奖励预测模型,专为只有少量物体具有标记交互数据的场景设计。除了预测奖励标签外,SSNP的潜在空间还通过自编码目标与来自更大物体集合的被动数据进行联合训练。与两种数据联合训练使模型能够更有效地关注可泛化的特征,并最大限度地减少对大量再训练的需求,从而降低计算需求。通过开门任务验证了SSNP的有效性,与其它半监督方法相比,SSNP表现更优,并且仅使用了其他自适应模型所需的一小部分数据。

🔬 方法详解

问题定义:论文旨在解决铰接物体交互任务中,由于带标签的交互数据稀缺,导致机器人难以学习有效的操作策略的问题。现有方法依赖大量带标签数据,或者难以将从无标签数据中学到的特征迁移到特定任务中,泛化能力不足。

核心思路:论文的核心思路是利用半监督学习,结合少量带标签的交互数据和大量无标签的物体视觉数据,训练一个自适应的奖励预测模型。通过联合训练,模型可以学习到更具泛化性的特征表示,从而在只有少量带标签数据的情况下也能取得良好的性能。

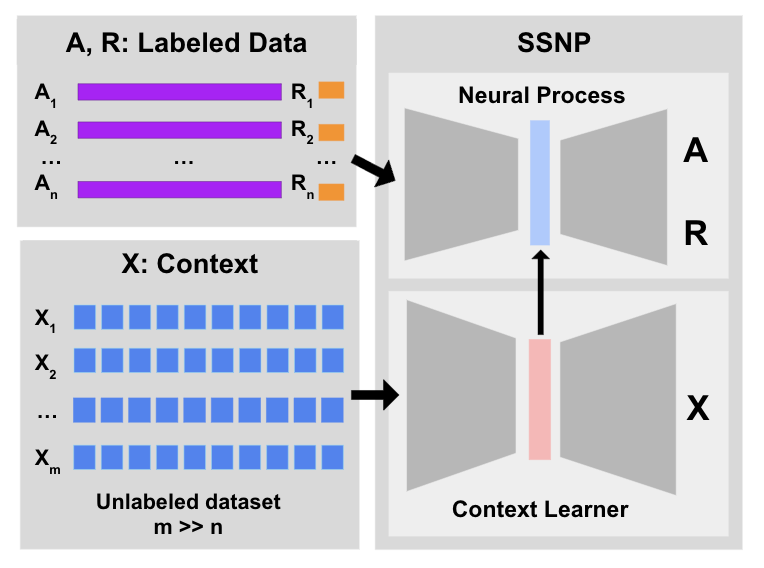

技术框架:SSNP模型包含一个编码器、一个解码器和一个潜在变量空间。编码器将带标签的交互数据(例如,物体状态、动作和奖励)编码到潜在空间中。同时,编码器也接收无标签的物体视觉数据,并将其编码到同一个潜在空间中。解码器则根据潜在空间中的表示预测奖励值。整个框架通过联合训练的方式,同时优化奖励预测的准确性和潜在空间的表示能力。

关键创新:SSNP的关键创新在于其半监督学习框架,能够有效地利用无标签数据来提升模型的泛化能力。此外,SSNP采用神经过程(Neural Process)作为基础模型,具有良好的自适应性和不确定性建模能力。通过将神经过程与自编码器相结合,SSNP能够学习到更鲁棒和可泛化的特征表示。

关键设计:SSNP的关键设计包括:1) 使用变分自编码器(VAE)作为潜在变量模型,鼓励潜在空间学习到有意义的表示;2) 使用负对数似然作为奖励预测的损失函数,并使用KL散度作为正则化项,防止过拟合;3) 联合优化奖励预测损失和自编码损失,平衡带标签数据和无标签数据的影响。

🖼️ 关键图片

📊 实验亮点

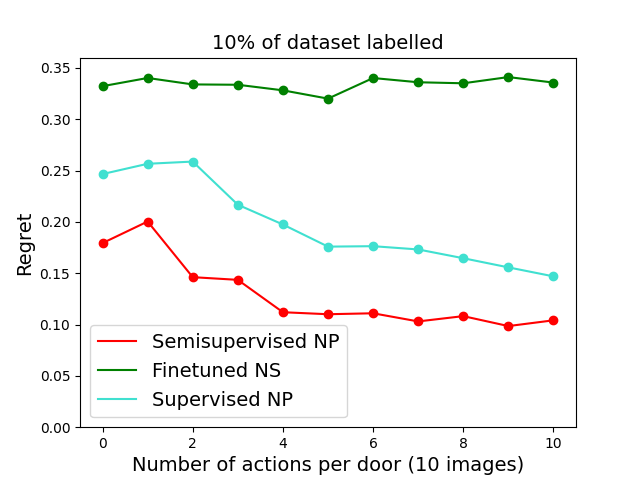

实验结果表明,在开门任务中,SSNP模型在仅使用少量带标签数据的情况下,性能优于其他半监督学习方法。具体而言,SSNP使用的数据量仅为其他自适应模型的几分之一,但仍然取得了更好的奖励预测精度和更快的学习速度,验证了其在数据稀缺场景下的有效性。

🎯 应用场景

该研究成果可应用于各种机器人操作任务,尤其是在交互数据获取成本高昂的场景下,例如家庭服务机器人、工业机器人等。通过利用大量的视觉数据,可以显著降低对带标签数据的需求,加速机器人学习和部署,并提升机器人在复杂环境中的适应能力。

📄 摘要(原文)

The scarcity of labeled action data poses a considerable challenge for developing machine learning algorithms for robotic object manipulation. It is expensive and often infeasible for a robot to interact with many objects. Conversely, visual data of objects, without interaction, is abundantly available and can be leveraged for pretraining and feature extraction. However, current methods that rely on image data for pretraining do not easily adapt to task-specific predictions, since the learned features are not guaranteed to be relevant. This paper introduces the Semi-Supervised Neural Process (SSNP): an adaptive reward-prediction model designed for scenarios in which only a small subset of objects have labeled interaction data. In addition to predicting reward labels, the latent-space of the SSNP is jointly trained with an autoencoding objective using passive data from a much larger set of objects. Jointly training with both types of data allows the model to focus more effectively on generalizable features and minimizes the need for extensive retraining, thereby reducing computational demands. The efficacy of SSNP is demonstrated through a door-opening task, leading to better performance than other semi-supervised methods, and only using a fraction of the data compared to other adaptive models.