HI-SLAM2: Geometry-Aware Gaussian SLAM for Fast Monocular Scene Reconstruction

作者: Wei Zhang, Qing Cheng, David Skuddis, Niclas Zeller, Daniel Cremers, Norbert Haala

分类: cs.RO, cs.CV

发布日期: 2024-11-27 (更新: 2025-04-29)

备注: Under review process

🔗 代码/项目: PROJECT_PAGE

💡 一句话要点

HI-SLAM2:基于几何感知的快速单目场景重建高斯SLAM

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 单目SLAM 场景重建 3D高斯溅射 几何感知 姿态图优化

📋 核心要点

- 现有方法在单目场景重建中,难以同时保证渲染质量和几何精度,存在权衡。

- HI-SLAM2结合单目先验和学习型密集SLAM,利用3D高斯溅射高效建模场景,提升几何估计能力。

- 实验表明,HI-SLAM2在重建和渲染质量上显著优于现有神经SLAM方法,甚至超越RGB-D方法。

📝 摘要(中文)

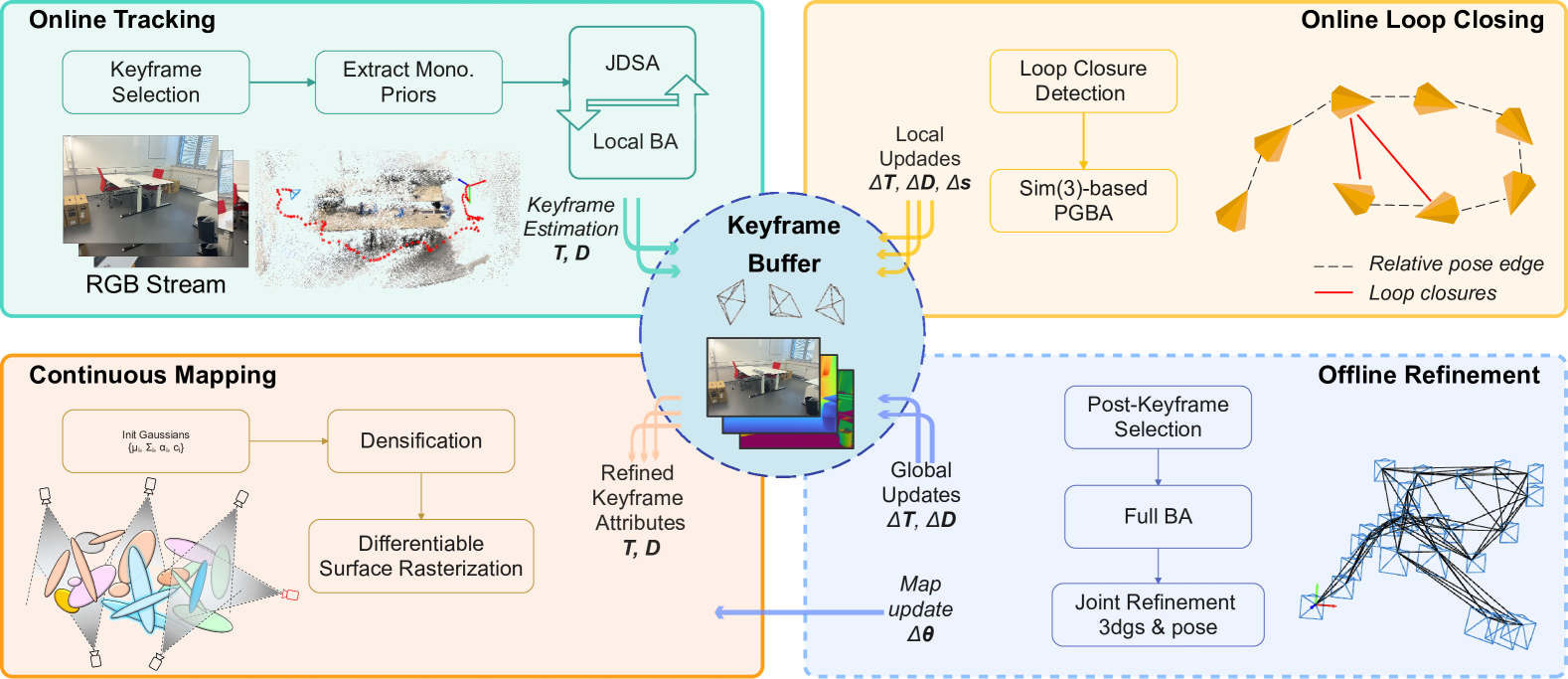

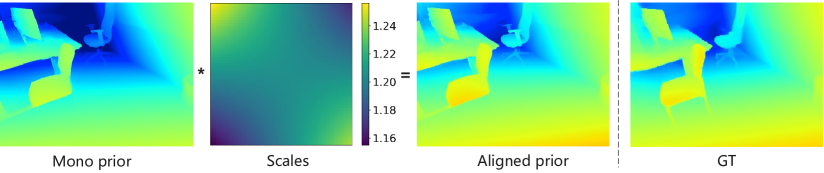

本文提出HI-SLAM2,一个几何感知的Gaussian SLAM系统,仅使用RGB输入即可实现快速而精确的单目场景重建。现有的神经SLAM或基于3DGS的SLAM方法通常需要在渲染质量和几何精度之间进行权衡,我们的研究表明,仅使用RGB输入即可同时实现这两者。该方法的关键思想是通过将易于获得的单目先验与基于学习的密集SLAM相结合,来增强几何估计能力,然后使用3D高斯溅射作为我们的核心地图表示,以有效地建模场景。在闭环时,我们的方法通过有效的姿态图BA和基于锚定关键帧更新显式地变形3D高斯单元,来确保即时的全局一致性。此外,我们引入了一种基于网格的尺度对齐策略,以在先验深度中保持改进的尺度一致性,从而获得更精细的深度细节。通过在Replica、ScanNet和ScanNet++上的大量实验,我们证明了相对于现有神经SLAM方法的显着改进,甚至在重建和渲染质量方面都超过了基于RGB-D的方法。项目页面和源代码将在https://hi-slam2.github.io/上提供。

🔬 方法详解

问题定义:现有的单目SLAM方法,特别是基于神经渲染或3D高斯溅射的方法,通常需要在渲染质量和几何精度之间做出妥协。这意味着,为了获得更好的视觉效果,往往牺牲了场景几何结构的准确性,反之亦然。这种权衡限制了这些方法在需要高精度几何信息的应用中的实用性。

核心思路:HI-SLAM2的核心思路是结合易于获得的单目先验知识与基于学习的密集SLAM,从而增强几何估计的能力。通过引入单目先验,系统可以更好地理解场景的几何结构,从而在重建过程中减少歧义。同时,利用3D高斯溅射作为核心地图表示,可以高效地建模场景,并实现高质量的渲染。

技术框架:HI-SLAM2的整体框架包括以下几个主要模块:1) 基于学习的密集SLAM:利用深度学习方法估计场景的深度信息。2) 单目先验:引入单目视觉中的几何约束,例如尺度一致性等。3) 3D高斯溅射:使用3D高斯分布来表示场景,并进行渲染。4) 姿态图优化:通过姿态图优化来保证全局一致性。5) 尺度对齐:使用基于网格的尺度对齐策略来保持尺度一致性。

关键创新:HI-SLAM2的关键创新在于其几何感知的SLAM方法,它能够同时实现高质量的渲染和高精度的几何重建。与现有方法相比,HI-SLAM2通过结合单目先验和学习型SLAM,显著提升了几何估计的准确性。此外,该方法还引入了一种基于网格的尺度对齐策略,进一步提高了尺度一致性。

关键设计:HI-SLAM2的关键设计包括:1) 使用深度学习网络估计深度信息,并结合单目先验进行优化。2) 使用3D高斯溅射作为地图表示,并进行高效的渲染。3) 引入姿态图优化,保证全局一致性。4) 设计基于网格的尺度对齐策略,维护尺度一致性。具体的参数设置、损失函数和网络结构等细节未在摘要中详细说明,属于未知信息。

🖼️ 关键图片

📊 实验亮点

HI-SLAM2在Replica、ScanNet和ScanNet++数据集上进行了广泛的实验,结果表明,该方法在重建和渲染质量方面均优于现有的神经SLAM方法,甚至超过了基于RGB-D的方法。具体的性能数据和提升幅度未在摘要中给出,属于未知信息。但总体而言,实验结果验证了HI-SLAM2的有效性和优越性。

🎯 应用场景

HI-SLAM2在机器人导航、增强现实、虚拟现实、三维地图重建等领域具有广泛的应用前景。该方法能够快速准确地重建场景,为机器人提供可靠的环境信息,从而实现自主导航。同时,高质量的渲染效果也为AR/VR应用提供了更好的用户体验。此外,HI-SLAM2还可以用于创建高精度的三维地图,为城市规划、文物保护等领域提供支持。

📄 摘要(原文)

We present HI-SLAM2, a geometry-aware Gaussian SLAM system that achieves fast and accurate monocular scene reconstruction using only RGB input. Existing Neural SLAM or 3DGS-based SLAM methods often trade off between rendering quality and geometry accuracy, our research demonstrates that both can be achieved simultaneously with RGB input alone. The key idea of our approach is to enhance the ability for geometry estimation by combining easy-to-obtain monocular priors with learning-based dense SLAM, and then using 3D Gaussian splatting as our core map representation to efficiently model the scene. Upon loop closure, our method ensures on-the-fly global consistency through efficient pose graph bundle adjustment and instant map updates by explicitly deforming the 3D Gaussian units based on anchored keyframe updates. Furthermore, we introduce a grid-based scale alignment strategy to maintain improved scale consistency in prior depths for finer depth details. Through extensive experiments on Replica, ScanNet, and ScanNet++, we demonstrate significant improvements over existing Neural SLAM methods and even surpass RGB-D-based methods in both reconstruction and rendering quality. The project page and source code will be made available at https://hi-slam2.github.io/.