MALMM: Multi-Agent Large Language Models for Zero-Shot Robotics Manipulation

作者: Harsh Singh, Rocktim Jyoti Das, Mingfei Han, Preslav Nakov, Ivan Laptev

分类: cs.RO, cs.AI

发布日期: 2024-11-26 (更新: 2025-08-25)

备注: 48 pages

💡 一句话要点

提出MALMM:一种用于零样本机器人操作的多智能体大语言模型框架

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多智能体系统 大语言模型 机器人操作 零样本学习 动态重规划

📋 核心要点

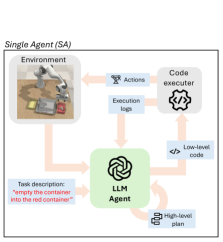

- 现有基于LLM的机器人操作方法在长时程任务中容易出现幻觉,且由于单次生成计划缺乏实时反馈,适应性有限。

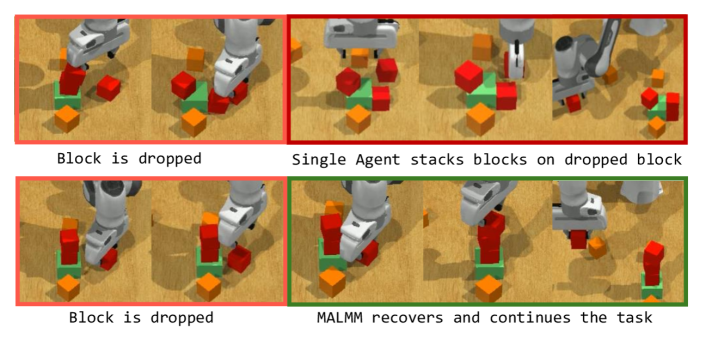

- MALMM框架通过多智能体协作,将高层规划和底层控制代码生成解耦,并引入环境反馈机制,实现动态重规划。

- 实验表明,MALMM在多个RLBench任务上实现了零样本机器人操作,无需预训练技能策略或上下文学习示例。

📝 摘要(中文)

本文提出了一种新颖的多智能体大语言模型框架,名为MALMM,用于机器人操作。该框架将高层规划和底层控制代码生成分配给专门的LLM智能体,并由一个额外的智能体进行监督,该智能体动态地管理状态转移。通过在每一步之后结合来自环境的观察,MALMM能够有效地处理中间失败并实现自适应的重新规划。与现有方法不同,该方法不依赖于预训练的技能策略或上下文学习示例,并且可以推广到各种新任务。在九个RLBench任务(包括长时程任务)上的评估表明,MALMM能够在零样本设置中解决机器人操作问题,从而克服了现有基于LLM的操作方法的主要局限性。

🔬 方法详解

问题定义:现有基于大语言模型(LLM)的机器人操作方法,尤其是在长时程任务中,容易产生幻觉,导致计划偏离实际。此外,这些方法通常一次性生成整个计划,缺乏实时反馈和调整能力,难以应对中间步骤的失败,泛化能力受限。因此,需要一种能够处理长时程任务、具备实时反馈和自适应能力的机器人操作框架。

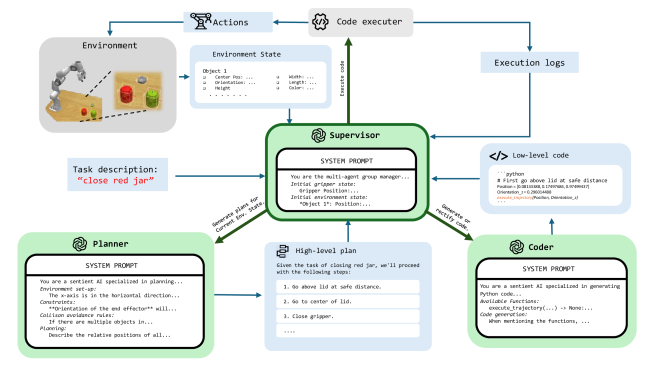

核心思路:MALMM的核心思路是将复杂的机器人操作任务分解为多个子任务,并分配给不同的LLM智能体。每个智能体负责特定的功能,例如高层规划或底层控制代码生成。通过引入一个监督智能体来管理智能体之间的状态转移,并结合环境反馈,实现动态重规划,从而提高任务的鲁棒性和适应性。

技术框架:MALMM框架包含多个LLM智能体,包括:1) 高层规划智能体,负责生成任务的整体规划;2) 底层控制代码生成智能体,负责将高层规划转化为具体的控制代码;3) 监督智能体,负责监控任务执行状态,管理智能体之间的状态转移,并在出现失败时触发重规划。框架的整体流程是:高层规划智能体生成初始计划,底层控制代码生成智能体生成相应的控制代码,机器人执行代码并获取环境反馈,监督智能体根据环境反馈判断是否需要重规划,如果需要则重新调用高层规划智能体生成新的计划。

关键创新:MALMM的关键创新在于其多智能体协作的架构和动态重规划机制。与传统的单智能体方法相比,MALMM能够更好地处理复杂任务,并通过环境反馈实现自适应调整。此外,MALMM无需预训练的技能策略或上下文学习示例,具有更强的泛化能力。

关键设计:MALMM的关键设计包括:1) 智能体的角色分配,确保每个智能体负责特定的功能;2) 状态转移机制,确保智能体之间的协作和信息传递;3) 环境反馈机制,确保能够及时检测到任务执行中的失败;4) 重规划策略,确保能够在失败后生成新的可行计划。具体的参数设置和网络结构取决于所使用的LLM模型和具体的机器人操作任务。

🖼️ 关键图片

📊 实验亮点

MALMM在九个RLBench任务上进行了评估,包括长时程任务。实验结果表明,MALMM能够在零样本设置中成功解决这些任务,无需预训练的技能策略或上下文学习示例。与现有的基于LLM的机器人操作方法相比,MALMM在任务成功率和鲁棒性方面均有显著提升。具体性能数据未知,但论文强调了其在零样本学习和长时程任务处理方面的优势。

🎯 应用场景

MALMM框架具有广泛的应用前景,可应用于各种机器人操作任务,例如家庭服务机器人、工业自动化机器人和医疗机器人。该框架能够提高机器人的自主性和适应性,使其能够更好地完成复杂任务,并降低对人工干预的依赖。未来,MALMM可以进一步扩展到其他领域,例如自动驾驶和智能制造。

📄 摘要(原文)

Large Language Models (LLMs) have demonstrated remarkable planning abilities across various domains, including robotics manipulation and navigation. While recent efforts in robotics have leveraged LLMs both for high-level and low-level planning, these approaches often face significant challenges, such as hallucinations in long-horizon tasks and limited adaptability due to the generation of plans in a single pass without real-time feedback. To address these limitations, we propose a novel multi-agent LLM framework, Multi-Agent Large Language Model for Manipulation (MALMM) that distributes high-level planning and low-level control code generation across specialized LLM agents, supervised by an additional agent that dynamically manages transitions. By incorporating observations from the environment after each step, our framework effectively handles intermediate failures and enables adaptive re-planning. Unlike existing methods, our approach does not rely on pre-trained skill policies or in-context learning examples and generalizes to a variety of new tasks. We evaluate our approach on nine RLBench tasks, including long-horizon tasks, and demonstrate its ability to solve robotics manipulation in a zero-shot setting, thereby overcoming key limitations of existing LLM-based manipulation methods.