FunGrasp: Functional Grasping for Diverse Dexterous Hands

作者: Linyi Huang, Hui Zhang, Zijian Wu, Sammy Christen, Jie Song

分类: cs.RO, cs.CV

发布日期: 2024-11-24

备注: Project page: https://hly-123.github.io/FunGrasp/

🔗 代码/项目: PROJECT_PAGE

💡 一句话要点

FunGrasp:面向多样灵巧手的通用功能性抓取系统

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱二:RL算法与架构 (RL & Architecture) 支柱七:动作重定向 (Motion Retargeting)

关键词: 灵巧手抓取 功能性抓取 人到机器人迁移 强化学习 Sim-to-real 机器人控制 RGBD图像

📋 核心要点

- 现有灵巧手抓取研究主要关注力量抓取,忽略了任务和物体相关的特定功能性抓取姿态。

- FunGrasp系统通过RGBD图像估计人类手部姿态,并利用人到机器人(H2R)重定向模块迁移到不同机器人手。

- 该系统结合强化学习、特权学习等技术,实现了模拟到真实的迁移,并在多种机器人手上验证了其有效性。

📝 摘要(中文)

功能性抓取对于人类执行特定任务至关重要,例如通过手指孔抓握剪刀来切割材料,或通过刀刃抓握以安全地传递剪刀。使灵巧的机器人手具备功能性抓取能力,对于它们部署以完成各种现实世界任务至关重要。然而,最近在灵巧抓取方面的研究通常侧重于力量抓握,而忽略了特定于任务和对象的功能性抓取姿势。本文介绍了一种名为FunGrasp的系统,该系统能够实现各种机器人手的功能性灵巧抓取,并对未见过的对象进行一次性迁移。给定功能性人类抓取的单个RGBD图像,我们的系统估计手部姿势,并通过人到机器人(H2R)抓取重定向模块将其转移到不同的机器人手上。在重定向的抓取姿势的指导下,通过模拟中的强化学习训练策略以进行动态抓取控制。为了实现强大的sim-to-real迁移,我们采用了多种技术,包括特权学习、系统辨识、领域随机化和重力补偿。在我们的实验中,我们证明了我们的系统能够使用单个RGBD图像实现对未见过的对象的各种功能性抓取,并且可以成功地部署在各种灵巧的机器人手上。通过全面的消融研究验证了各个组件的重要性。

🔬 方法详解

问题定义:论文旨在解决灵巧机器人手如何实现功能性抓取的问题。现有方法主要关注力量抓取,缺乏对特定任务和物体功能性抓取姿态的考虑,导致机器人难以完成需要特定抓取方式的任务,例如安全传递剪刀或使用工具。

核心思路:论文的核心思路是模仿人类的功能性抓取。通过RGBD图像获取人类的功能性抓取姿态,然后将该姿态迁移到不同的机器人手上,并利用强化学习训练抓取策略,从而使机器人能够执行类似的功能性抓取。

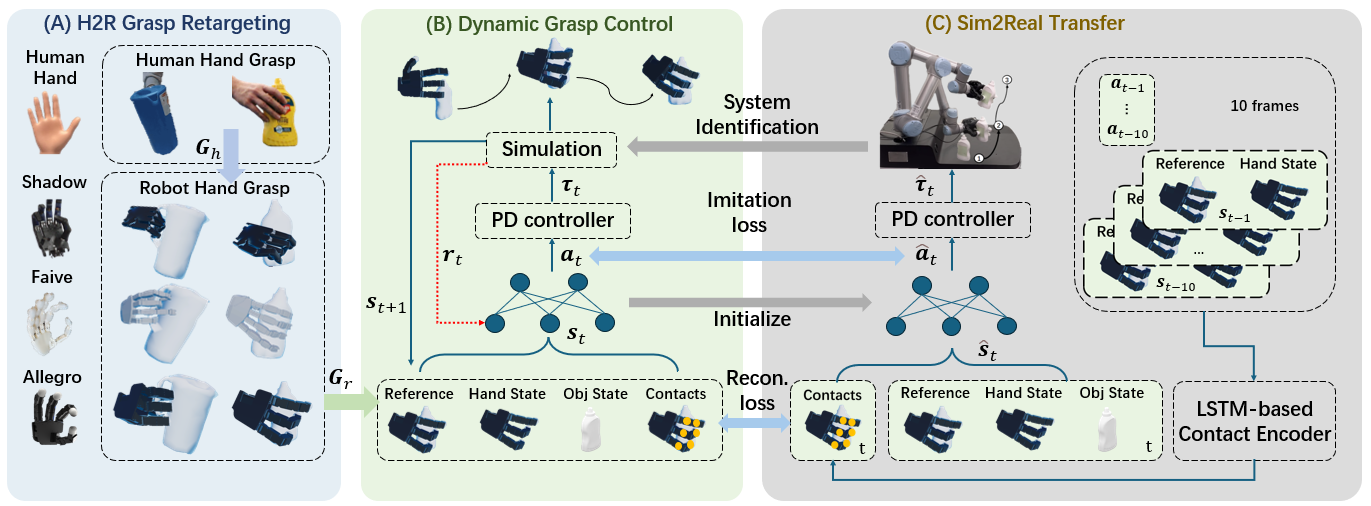

技术框架:FunGrasp系统的整体框架包含以下几个主要模块:1) 人类抓取姿态估计:利用RGBD图像估计人类手部的姿态。2) 人到机器人(H2R)抓取重定向:将人类手部的姿态迁移到不同的机器人手上,考虑到不同机器人手的结构差异。3) 强化学习抓取策略训练:在模拟环境中,利用强化学习训练抓取策略,使机器人能够根据重定向的姿态进行动态抓取控制。4) Sim-to-real迁移:采用特权学习、系统辨识、领域随机化和重力补偿等技术,实现从模拟环境到真实环境的迁移。

关键创新:该论文的关键创新在于:1) 提出了一个能够实现各种机器人手的功能性灵巧抓取的系统,并对未见过的对象进行一次性迁移。2) 结合了人类抓取姿态估计、人到机器人(H2R)抓取重定向和强化学习抓取策略训练,实现功能性抓取。3) 采用多种技术,包括特权学习、系统辨识、领域随机化和重力补偿,实现了强大的sim-to-real迁移。

关键设计:在人到机器人(H2R)抓取重定向模块中,需要考虑到不同机器人手的结构差异,例如手指长度、关节角度范围等。在强化学习抓取策略训练中,需要设计合适的奖励函数,鼓励机器人学习到稳定的抓取姿态。在Sim-to-real迁移中,领域随机化策略需要仔细设计,以覆盖真实环境中的各种变化。

🖼️ 关键图片

📊 实验亮点

实验结果表明,FunGrasp系统能够使用单个RGBD图像实现对未见过的对象的各种功能性抓取,并且可以成功地部署在各种灵巧的机器人手上。通过消融实验验证了各个组件的重要性,例如人到机器人(H2R)抓取重定向模块和强化学习抓取策略训练模块。虽然具体的性能数据未在摘要中给出,但强调了系统在不同机器人手上的通用性和对新物体的适应性。

🎯 应用场景

该研究成果可应用于各种需要灵巧操作的场景,例如:工业自动化中,机器人可以根据零件的形状和功能,选择合适的抓取方式进行装配;医疗领域中,机器人可以辅助医生进行精细的手术操作;家庭服务机器人可以帮助人们完成各种家务,例如安全地传递刀具或使用工具。该研究的推广将极大地提升机器人的智能化水平和应用范围。

📄 摘要(原文)

Functional grasping is essential for humans to perform specific tasks, such as grasping scissors by the finger holes to cut materials or by the blade to safely hand them over. Enabling dexterous robot hands with functional grasping capabilities is crucial for their deployment to accomplish diverse real-world tasks. Recent research in dexterous grasping, however, often focuses on power grasps while overlooking task- and object-specific functional grasping poses. In this paper, we introduce FunGrasp, a system that enables functional dexterous grasping across various robot hands and performs one-shot transfer to unseen objects. Given a single RGBD image of functional human grasping, our system estimates the hand pose and transfers it to different robotic hands via a human-to-robot (H2R) grasp retargeting module. Guided by the retargeted grasping poses, a policy is trained through reinforcement learning in simulation for dynamic grasping control. To achieve robust sim-to-real transfer, we employ several techniques including privileged learning, system identification, domain randomization, and gravity compensation. In our experiments, we demonstrate that our system enables diverse functional grasping of unseen objects using single RGBD images, and can be successfully deployed across various dexterous robot hands. The significance of the components is validated through comprehensive ablation studies. Project page: https://hly-123.github.io/FunGrasp/ .