PG-SLAM: Photo-realistic and Geometry-aware RGB-D SLAM in Dynamic Environments

作者: Haoang Li, Xiangqi Meng, Xingxing Zuo, Zhe Liu, Hesheng Wang, Daniel Cremers

分类: cs.RO, cs.CV

发布日期: 2024-11-24

💡 一句话要点

提出PG-SLAM,解决动态环境下RGB-D SLAM的真实感和几何感知问题

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 动态SLAM RGB-D SLAM 高斯溅射 场景重建 相机定位

📋 核心要点

- 现有动态环境下的SLAM方法通常直接滤除动态物体,导致场景重建不完整和相机定位精度受限。

- PG-SLAM通过扩展高斯溅射,分别对动态前景(人和物体)和静态背景进行建模,并结合几何与外观约束进行优化。

- 实验结果表明,PG-SLAM在相机定位和场景表示方面优于现有方法,提升了动态场景SLAM的性能。

📝 摘要(中文)

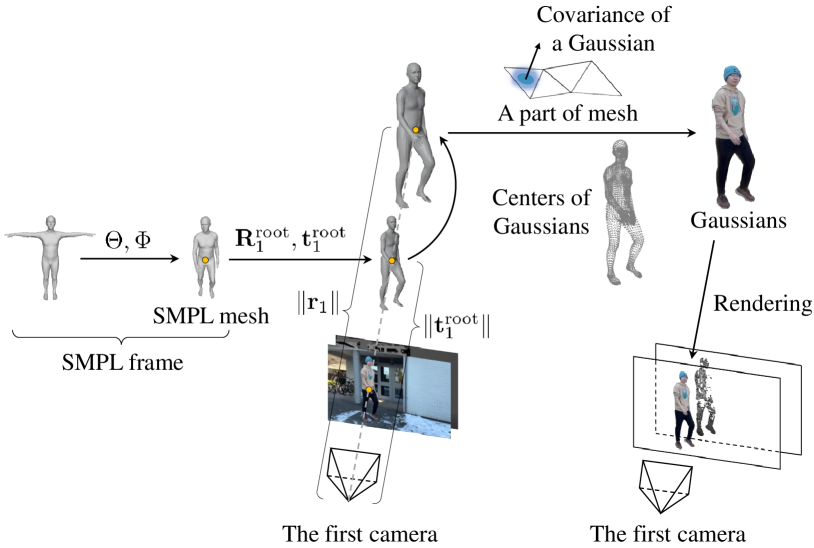

本文提出了一种逼真且具有几何感知的RGB-D SLAM方法,用于动态环境。该方法通过扩展高斯溅射来实现。它由三个主要模块组成:1) 映射包括非刚性人和刚性物体在内的动态前景;2) 重建静态背景;3) 定位相机。为了映射前景,我们专注于建模形变和/或运动。我们考虑了人的形状先验,并利用了人和物体的几何和外观约束。对于背景映射,我们通过将外观约束集成到几何对齐中,设计了相邻局部地图之间的优化策略。至于相机定位,我们利用静态背景和动态前景来增加观测,以进行噪声补偿。我们通过将3D高斯与2D光流和像素块相关联来探索几何和外观约束。在各种真实世界数据集上的实验表明,我们的方法在相机定位和场景表示方面优于最先进的方法。源代码将在论文被接受后公开。

🔬 方法详解

问题定义:现有的动态环境下的SLAM方法,要么直接滤除动态物体,导致场景重建不完整,相机定位精度受限;要么使用点云、稀疏关节或粗糙网格来表示动态物体,无法提供逼真的表示。因此,如何在动态环境中实现逼真且具有几何感知的SLAM是一个挑战。

核心思路:PG-SLAM的核心思路是将场景分解为静态背景和动态前景,分别进行建模和优化。对于动态前景,利用形状先验和几何、外观约束来建模人和物体的运动和形变。对于静态背景,通过相邻局部地图之间的优化来提高重建质量。同时,利用静态背景和动态前景进行相机定位,增加观测,补偿噪声。

技术框架:PG-SLAM的整体框架包含三个主要模块:1) 动态前景映射模块,用于建模非刚性人和刚性物体的运动和形变;2) 静态背景重建模块,用于重建静态场景;3) 相机定位模块,利用静态背景和动态前景进行相机位姿估计。这三个模块相互协作,共同完成动态环境下的SLAM任务。

关键创新:PG-SLAM的关键创新在于:1) 将高斯溅射扩展到动态环境,实现了逼真的场景表示;2) 结合形状先验和几何、外观约束,有效地建模了动态前景的运动和形变;3) 利用静态背景和动态前景进行相机定位,提高了定位精度和鲁棒性。

关键设计:在动态前景映射模块中,利用人体形状先验约束,并结合几何(如深度一致性)和外观(如光流一致性)约束来优化动态物体的表示。在静态背景重建模块中,设计了相邻局部地图之间的优化策略,通过将外观约束集成到几何对齐中,提高重建质量。在相机定位模块中,将3D高斯与2D光流和像素块相关联,从而利用动态前景的信息进行相机位姿估计。

🖼️ 关键图片

📊 实验亮点

PG-SLAM在多个真实世界数据集上进行了评估,实验结果表明,该方法在相机定位和场景表示方面均优于现有方法。具体性能数据(例如,相机定位的均方根误差降低百分比,场景重建的视觉质量提升)将在论文中详细展示。

🎯 应用场景

PG-SLAM在机器人导航、增强现实、虚拟现实、自动驾驶等领域具有广泛的应用前景。例如,在机器人导航中,可以帮助机器人在动态环境中进行更准确的定位和地图构建。在增强现实和虚拟现实中,可以提供更逼真的场景体验。在自动驾驶中,可以提高车辆对动态环境的感知能力。

📄 摘要(原文)

Simultaneous localization and mapping (SLAM) has achieved impressive performance in static environments. However, SLAM in dynamic environments remains an open question. Many methods directly filter out dynamic objects, resulting in incomplete scene reconstruction and limited accuracy of camera localization. The other works express dynamic objects by point clouds, sparse joints, or coarse meshes, which fails to provide a photo-realistic representation. To overcome the above limitations, we propose a photo-realistic and geometry-aware RGB-D SLAM method by extending Gaussian splatting. Our method is composed of three main modules to 1) map the dynamic foreground including non-rigid humans and rigid items, 2) reconstruct the static background, and 3) localize the camera. To map the foreground, we focus on modeling the deformations and/or motions. We consider the shape priors of humans and exploit geometric and appearance constraints of humans and items. For background mapping, we design an optimization strategy between neighboring local maps by integrating appearance constraint into geometric alignment. As to camera localization, we leverage both static background and dynamic foreground to increase the observations for noise compensation. We explore the geometric and appearance constraints by associating 3D Gaussians with 2D optical flows and pixel patches. Experiments on various real-world datasets demonstrate that our method outperforms state-of-the-art approaches in terms of camera localization and scene representation. Source codes will be publicly available upon paper acceptance.