One to rule them all: natural language to bind communication, perception and action

作者: Simone Colombani, Dimitri Ognibene, Giuseppe Boccignone

分类: cs.RO, cs.AI, cs.HC

发布日期: 2024-11-22

💡 一句话要点

提出一种基于LLM的机器人动作规划架构,融合通信、感知与规划,实现自然语言指令驱动的动态任务执行。

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 机器人动作规划 自然语言处理 大型语言模型 人机交互 ReAct框架

📋 核心要点

- 现有机器人难以理解复杂指令并在动态环境中执行任务,缺乏灵活性和自然交互能力。

- 利用LLM的预训练知识,结合改进的ReAct框架,实现自然语言到机器人动作的转换和动态规划。

- 通过环境反馈和失败分析,系统能够动态调整计划,提升机器人在复杂环境中的适应性和任务执行能力。

📝 摘要(中文)

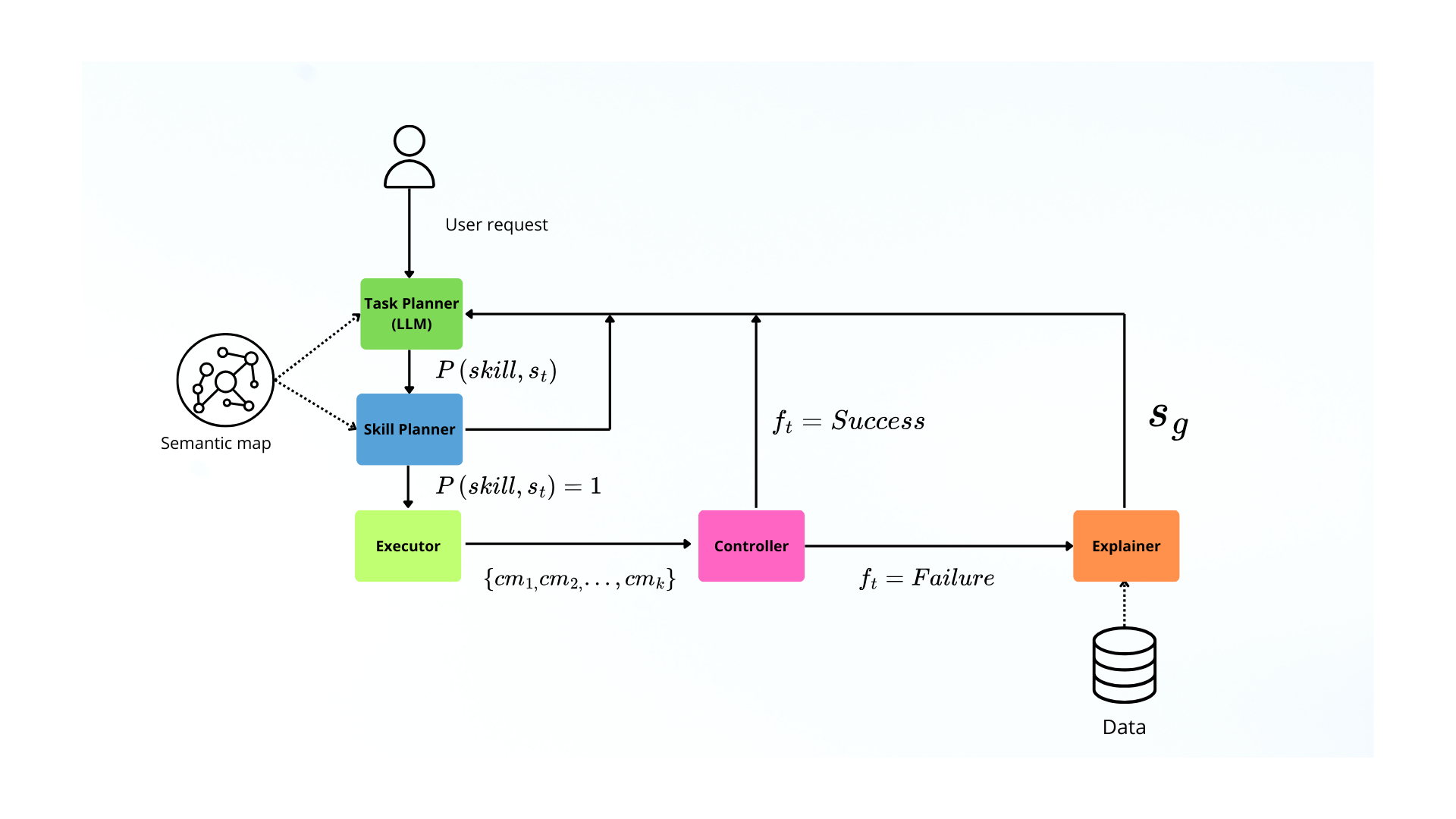

本文提出了一种用于机器人动作规划的先进架构,该架构集成了通信、感知和规划,并利用大型语言模型(LLM)。该系统旨在将自然语言表达的命令转换为可执行的机器人动作,同时结合环境信息并根据实时反馈动态更新计划。规划模块是系统的核心,其中嵌入在改进的ReAct框架中的LLM用于解释和执行用户命令。通过利用其广泛的预训练知识,LLM可以有效地处理用户请求,而无需引入关于变化环境的新知识。改进的ReAct框架通过提供实时环境感知和物理动作的结果来进一步增强执行空间。通过将鲁棒和动态的语义地图表示为图与控制组件和失败解释相结合,该架构增强了机器人在共享和动态环境中与人类用户的适应性、任务执行和无缝协作。通过与环境的持续反馈循环,系统可以动态调整计划以适应意外变化,从而优化机器人执行任务的能力。使用先前经验的数据集可以提供关于失败的详细反馈,并使用关于如何克服该问题的建议来更新LLM的下一次迭代的上下文。

🔬 方法详解

问题定义:现有机器人动作规划方法在处理复杂自然语言指令、动态环境变化以及与人类自然交互方面存在不足。痛点在于难以将高级指令转化为低级可执行动作,并且缺乏对环境变化的实时适应能力。

核心思路:利用大型语言模型(LLM)的强大自然语言理解和生成能力,将自然语言指令转化为机器人可执行的动作序列。通过改进的ReAct框架,结合环境感知和动作反馈,实现动态规划和实时调整,从而提高机器人的适应性和鲁棒性。

技术框架:该架构包含以下主要模块:1) 自然语言指令输入:接收用户以自然语言表达的指令。2) 规划模块(基于LLM和ReAct框架):将自然语言指令解析为可执行的动作序列,并根据环境信息和动作反馈进行动态调整。3) 环境感知模块:提供实时的环境信息,例如物体位置、障碍物等。4) 动作执行模块:执行规划模块生成的动作序列。5) 反馈模块:收集动作执行结果和环境变化信息,并反馈给规划模块,用于动态调整计划。

关键创新:该方法的核心创新在于将LLM嵌入到改进的ReAct框架中,从而实现了自然语言指令驱动的动态机器人动作规划。与传统方法相比,该方法无需手动设计复杂的规则和知识库,而是利用LLM的预训练知识来理解和执行指令,从而提高了系统的灵活性和可扩展性。此外,通过持续的环境反馈和失败分析,系统能够动态调整计划,从而提高了机器人的适应性和鲁棒性。

关键设计:改进的ReAct框架是关键设计之一。它允许LLM在规划过程中与环境进行交互,通过观察环境和执行动作来获取信息,并根据反馈动态调整计划。此外,使用语义地图表示环境信息,并结合控制组件和失败解释,进一步增强了机器人的适应性和任务执行能力。数据集用于提供关于失败的详细反馈,并使用关于如何克服该问题的建议来更新LLM的下一次迭代的上下文。

🖼️ 关键图片

📊 实验亮点

论文重点在于架构设计和概念验证,未提供具体的性能数据。亮点在于利用LLM的强大能力,实现了自然语言指令驱动的动态机器人动作规划,并结合环境反馈和失败分析,提高了机器人的适应性和鲁棒性。未来工作可以关注在具体任务上的性能评估和对比实验。

🎯 应用场景

该研究成果可应用于多种场景,例如:家庭服务机器人,帮助老年人或残疾人完成日常任务;工业机器人,执行复杂的装配或搬运任务;搜索救援机器人,在危险环境中进行搜索和救援;以及医疗机器人,辅助医生进行手术或护理。该研究有望提升人机交互的自然性和效率,促进机器人技术的广泛应用。

📄 摘要(原文)

In recent years, research in the area of human-robot interaction has focused on developing robots capable of understanding complex human instructions and performing tasks in dynamic and diverse environments. These systems have a wide range of applications, from personal assistance to industrial robotics, emphasizing the importance of robots interacting flexibly, naturally and safely with humans. This paper presents an advanced architecture for robotic action planning that integrates communication, perception, and planning with Large Language Models (LLMs). Our system is designed to translate commands expressed in natural language into executable robot actions, incorporating environmental information and dynamically updating plans based on real-time feedback. The Planner Module is the core of the system where LLMs embedded in a modified ReAct framework are employed to interpret and carry out user commands. By leveraging their extensive pre-trained knowledge, LLMs can effectively process user requests without the need to introduce new knowledge on the changing environment. The modified ReAct framework further enhances the execution space by providing real-time environmental perception and the outcomes of physical actions. By combining robust and dynamic semantic map representations as graphs with control components and failure explanations, this architecture enhances a robot adaptability, task execution, and seamless collaboration with human users in shared and dynamic environments. Through the integration of continuous feedback loops with the environment the system can dynamically adjusts the plan to accommodate unexpected changes, optimizing the robot ability to perform tasks. Using a dataset of previous experience is possible to provide detailed feedback about the failure. Updating the LLMs context of the next iteration with suggestion on how to overcame the issue.