InCrowd-VI: A Realistic Visual-Inertial Dataset for Evaluating SLAM in Indoor Pedestrian-Rich Spaces for Human Navigation

作者: Marziyeh Bamdad, Hans-Peter Hutter, Alireza Darvishy

分类: cs.RO, cs.CV

发布日期: 2024-11-21 (更新: 2024-12-17)

备注: 24 pages, 8 figures, 6 tables

DOI: 10.3390/s24248164

💡 一句话要点

InCrowd-VI:用于人群密集室内环境SLAM评估的真实视觉惯性数据集

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 视觉惯性SLAM 数据集 室内导航 人群密集环境 视觉里程计

📋 核心要点

- 现有SLAM方法在人群密集场景下缺乏鲁棒性,主要原因是缺乏真实数据集,难以有效评估和改进算法。

- InCrowd-VI数据集旨在提供真实、具有挑战性的人群室内环境视觉惯性数据,用于评估和提升SLAM算法在复杂场景下的性能。

- 实验表明,现有VO和SLAM算法在InCrowd-VI数据集上表现出性能瓶颈,突显了该数据集对推动相关研究的价值。

📝 摘要(中文)

本文提出了InCrowd-VI,一种新型视觉惯性数据集,专为人群密集的室内环境中人类导航的SLAM算法评估而设计。该数据集使用Meta Aria Project眼镜记录,捕捉了无环境控制的真实场景。InCrowd-VI包含58个序列,总计5公里的轨迹长度和1.5小时的记录时间,包括RGB、立体图像和IMU测量数据。数据集涵盖了行人遮挡、变化的拥挤程度、复杂的布局和光照变化等重要挑战。数据集提供了由Meta Aria项目机器感知SLAM服务生成的、精度约为2厘米的地面真值轨迹,以及每个序列的半稠密3D点云。对InCrowd-VI上最先进的视觉里程计(VO)和SLAM算法的评估表明,这些算法在真实场景中存在严重的性能限制。在具有挑战性的条件下,系统超过了0.5米的所需定位精度和1%的漂移阈值,经典方法的漂移高达5-10%。虽然基于深度学习的方法保持了较高的姿态估计覆盖率(>90%),但未能实现步行导航所需的实时处理速度。这些结果表明,需要一个新的数据集来推进SLAM研究,以用于复杂室内环境中视力受损人士的导航。该数据集和相关工具可在https://incrowd-vi.cloudlab.zhaw.ch/公开获取。

🔬 方法详解

问题定义:论文旨在解决现有SLAM算法在人群密集的室内环境中,由于缺乏真实数据集而难以有效评估和提升性能的问题。现有方法在行人遮挡、光照变化、复杂场景布局等挑战下,定位精度和鲁棒性显著下降,无法满足视力受损人士导航的需求。

核心思路:论文的核心思路是构建一个真实、具有挑战性的视觉惯性数据集,该数据集包含人群密集的室内环境下的RGB图像、立体图像和IMU数据,以及高精度的地面真值轨迹和半稠密3D点云。通过在该数据集上评估现有SLAM算法,可以发现其在真实场景下的性能瓶颈,从而推动相关算法的改进。

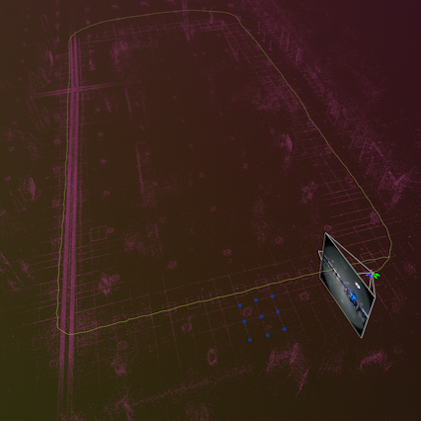

技术框架:InCrowd-VI数据集的构建主要包括数据采集、地面真值生成和数据集发布三个阶段。数据采集使用Meta Aria Project眼镜,记录真实室内环境下的视觉和惯性数据。地面真值轨迹由Meta Aria项目机器感知SLAM服务生成,精度约为2厘米。数据集以公开可访问的方式发布,并提供相关工具,方便研究人员使用。

关键创新:该数据集的关键创新在于其真实性和挑战性。与现有数据集相比,InCrowd-VI数据集捕捉了真实的人群密集室内环境,包含行人遮挡、光照变化、复杂场景布局等多种挑战,更贴近实际应用场景。此外,该数据集提供了高精度的地面真值轨迹和半稠密3D点云,方便研究人员进行算法评估和改进。

关键设计:InCrowd-VI数据集包含58个序列,总计5公里的轨迹长度和1.5小时的记录时间。数据采集设备为Meta Aria Project眼镜,包含RGB相机、立体相机和IMU传感器。地面真值轨迹由Meta Aria项目机器感知SLAM服务生成,精度约为2厘米。数据集以ROS bag格式存储,方便研究人员使用。

🖼️ 关键图片

📊 实验亮点

在InCrowd-VI数据集上,现有VO和SLAM算法表现出明显的性能瓶颈。经典方法在具有挑战性的条件下漂移高达5-10%,超过了0.5米的定位精度要求和1%的漂移阈值。基于深度学习的方法虽然保持了较高的姿态估计覆盖率(>90%),但未能实现实时处理速度。这些结果表明,InCrowd-VI数据集能够有效评估现有SLAM算法在真实场景下的性能,并为算法改进提供指导。

🎯 应用场景

该研究成果可应用于视力受损人士的室内导航、机器人自主导航、增强现实等领域。通过使用InCrowd-VI数据集,可以开发出更鲁棒、更精确的SLAM算法,从而提高这些应用在复杂环境下的性能和可靠性,为用户提供更好的体验。

📄 摘要(原文)

Simultaneous localization and mapping (SLAM) techniques can be used to navigate the visually impaired, but the development of robust SLAM solutions for crowded spaces is limited by the lack of realistic datasets. To address this, we introduce InCrowd-VI, a novel visual-inertial dataset specifically designed for human navigation in indoor pedestrian-rich environments. Recorded using Meta Aria Project glasses, it captures realistic scenarios without environmental control. InCrowd-VI features 58 sequences totaling a 5 km trajectory length and 1.5 hours of recording time, including RGB, stereo images, and IMU measurements. The dataset captures important challenges such as pedestrian occlusions, varying crowd densities, complex layouts, and lighting changes. Ground-truth trajectories, accurate to approximately 2 cm, are provided in the dataset, originating from the Meta Aria project machine perception SLAM service. In addition, a semi-dense 3D point cloud of scenes is provided for each sequence. The evaluation of state-of-the-art visual odometry (VO) and SLAM algorithms on InCrowd-VI revealed severe performance limitations in these realistic scenarios. Under challenging conditions, systems exceeded the required localization accuracy of 0.5 meters and the 1\% drift threshold, with classical methods showing drift up to 5-10\%. While deep learning-based approaches maintained high pose estimation coverage (>90\%), they failed to achieve real-time processing speeds necessary for walking pace navigation. These results demonstrate the need and value of a new dataset to advance SLAM research for visually impaired navigation in complex indoor environments. The dataset and associated tools are publicly available at https://incrowd-vi.cloudlab.zhaw.ch/.