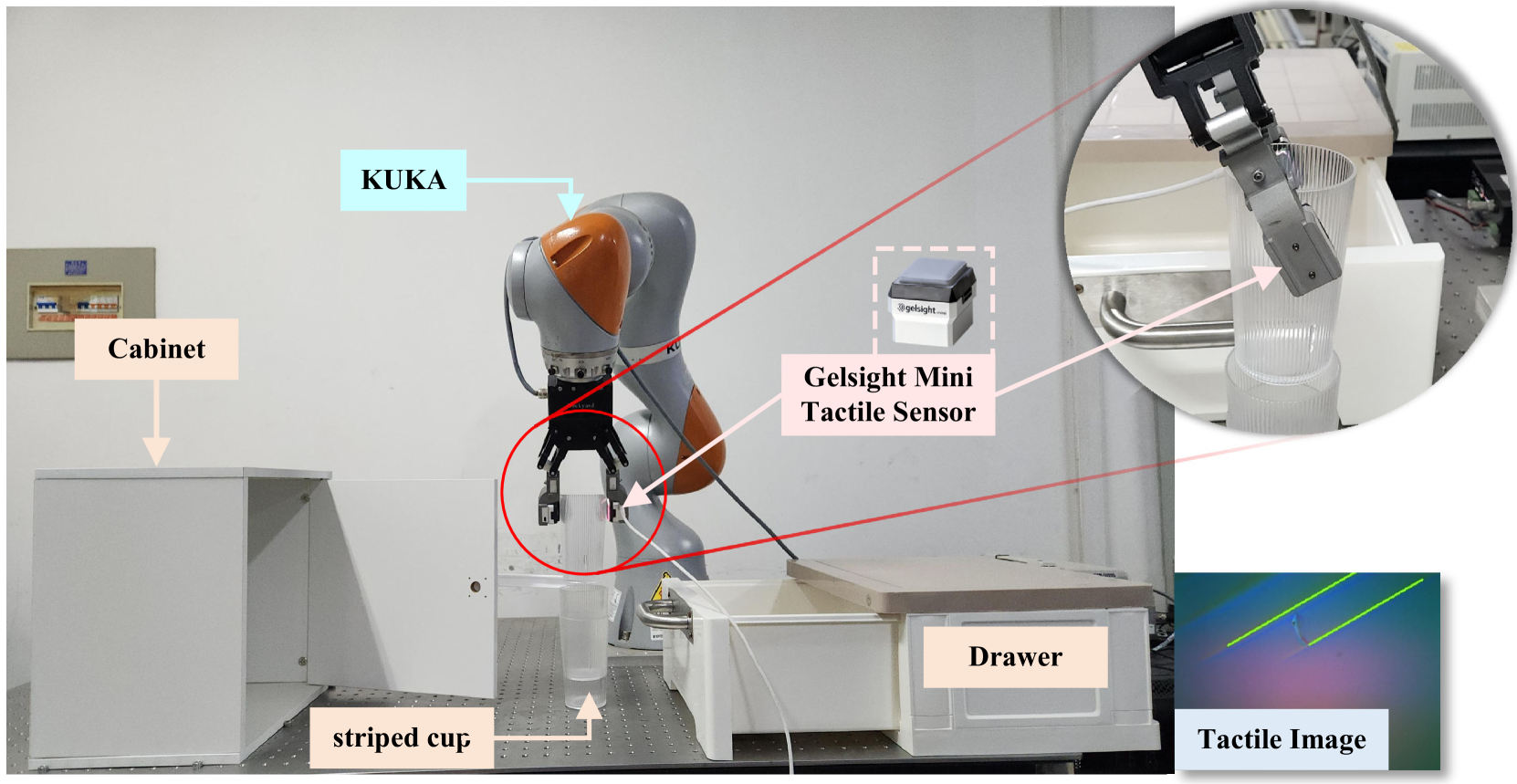

Semantic-Geometric-Physical-Driven Robot Manipulation Skill Transfer via Skill Library and Tactile Representation

作者: Mingchao Qi, Yuanjin Li, Xing Liu, Zhengxiong Liu, Panfeng Huang

分类: cs.RO, cs.AI

发布日期: 2024-11-18 (更新: 2025-06-18)

🔗 代码/项目: GITHUB

💡 一句话要点

提出基于知识图谱和触觉表示的机器人操作技能迁移框架,提升非结构化环境适应性。

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 机器人操作 技能迁移 知识图谱 触觉感知 大型语言模型

📋 核心要点

- 现有机器人操作技能迁移方法难以应对非结构化环境中的长时程、富接触任务,泛化能力不足。

- 构建基于知识图谱的技能库,结合触觉信息,实现任务、运动和物理层面的分层技能迁移。

- 实验验证了该方法在不同任务场景下的有效性,展示了其技能迁移和环境适应能力。

📝 摘要(中文)

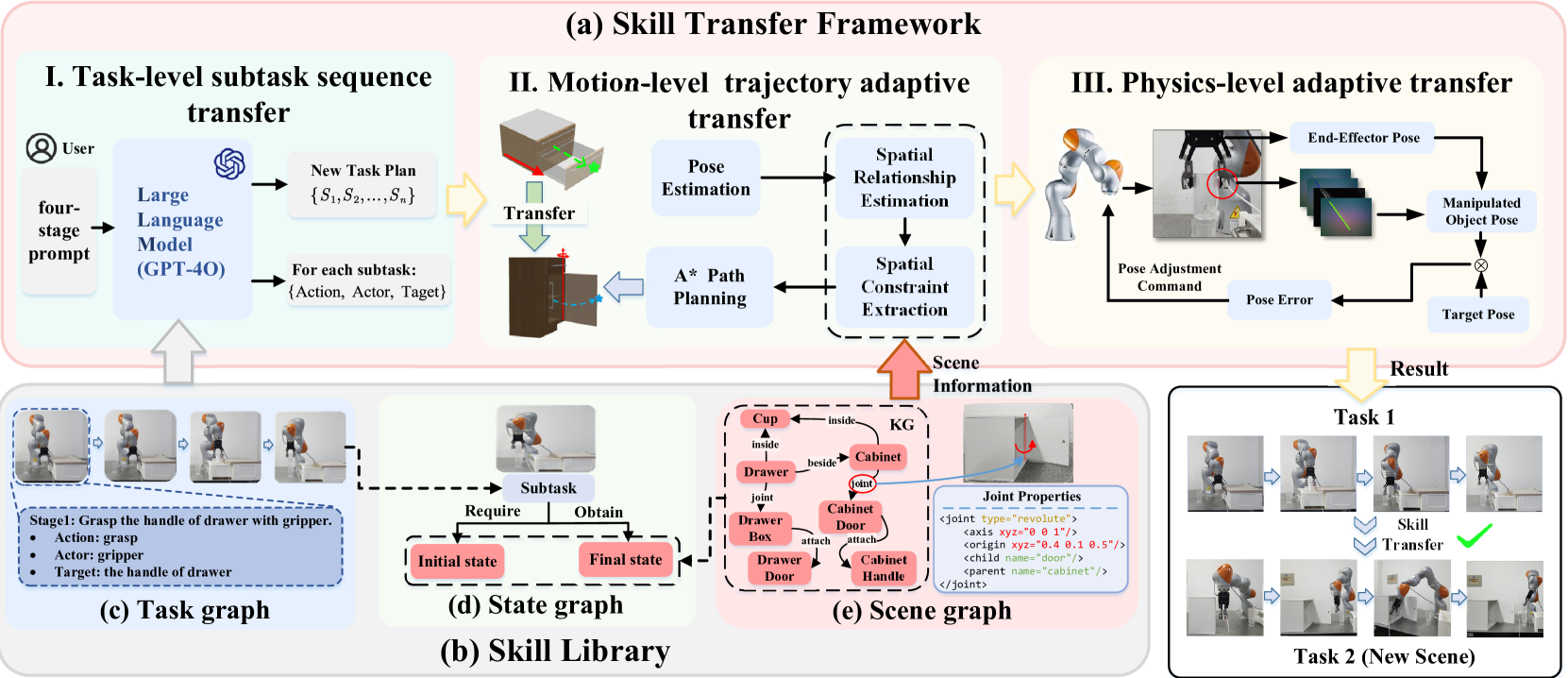

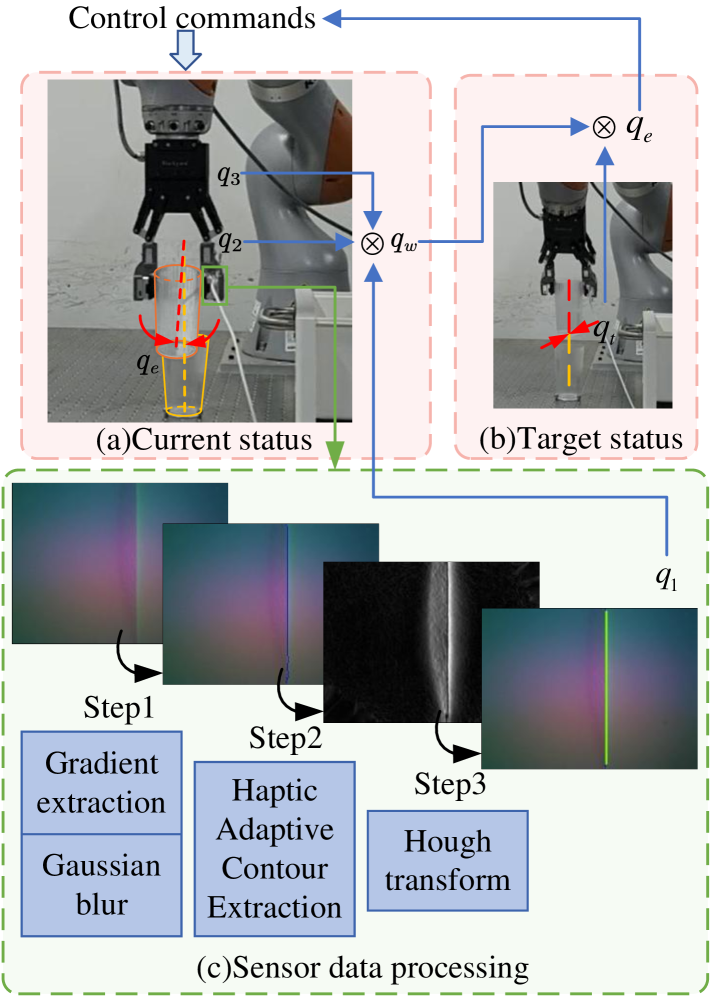

本文提出了一种基于知识图谱的机器人操作技能库构建方法,旨在解决非结构化环境中机器人操作的挑战,特别是长时程和富接触任务中高效的技能迁移问题。该方法利用“任务图”和“场景图”分层组织操作知识,分别表示任务特定和场景特定的信息,并引入“状态图”来促进高层任务规划和低层场景信息之间的交互。在此基础上,进一步提出了一个基于技能库和触觉表示的分层技能迁移框架,该框架集成了用于技能迁移的高层推理和用于执行的低层精度。在任务层面,利用大型语言模型(LLMs)并结合上下文学习与四阶段思维链提示范式来实现子任务序列迁移。在运动层面,开发了一种基于技能库和启发式路径规划算法的自适应轨迹迁移方法。在物理层面,提出了一种基于触觉表示的自适应轮廓提取和姿态感知方法,该方法从视觉-触觉图像中动态获取高精度轮廓和姿态信息,调整接触位置和姿态等参数,以确保迁移技能在新环境中的有效性。实验结果表明了所提出的方法在不同任务场景中的技能迁移和适应能力。

🔬 方法详解

问题定义:论文旨在解决非结构化环境中机器人操作技能迁移的问题。现有方法在面对复杂、多变的场景时,难以实现高效的技能迁移,尤其是在长时程和富接触任务中,泛化能力不足,需要人工干预进行调整。

核心思路:论文的核心思路是构建一个基于知识图谱的技能库,并结合触觉信息,实现分层技能迁移。通过知识图谱对任务、场景和状态进行建模,利用大型语言模型进行高层推理,并结合触觉反馈进行低层精细调整,从而实现技能在不同环境中的自适应迁移。

技术框架:该框架包含以下几个主要模块:1) 知识图谱构建模块,包括任务图、场景图和状态图;2) 基于LLM的任务级技能迁移模块,采用上下文学习和四阶段思维链提示;3) 基于技能库和启发式路径规划的运动级技能迁移模块;4) 基于触觉表示的物理级技能迁移模块,用于自适应轮廓提取和姿态感知。整体流程是:首先利用知识图谱对任务和环境进行建模,然后利用LLM进行高层任务规划,接着利用技能库和启发式算法进行运动规划,最后利用触觉信息进行物理层面的精细调整。

关键创新:该论文的关键创新在于:1) 提出了基于知识图谱的技能库构建方法,能够有效地组织和管理机器人操作知识;2) 提出了基于触觉表示的自适应轮廓提取和姿态感知方法,能够动态获取高精度轮廓和姿态信息,从而提高技能迁移的鲁棒性;3) 结合LLM和触觉反馈,实现了任务、运动和物理层面的分层技能迁移。

关键设计:在任务级技能迁移中,采用了四阶段思维链提示范式,包括问题分解、方案生成、方案评估和方案选择。在运动级技能迁移中,采用了A*算法进行启发式路径规划。在物理级技能迁移中,利用视觉-触觉图像进行轮廓提取和姿态感知,并根据触觉反馈动态调整接触位置和姿态。

🖼️ 关键图片

📊 实验亮点

论文通过实验验证了所提出的技能迁移框架的有效性。实验结果表明,该方法能够成功地将技能从一个任务场景迁移到另一个任务场景,并且能够适应不同的物体和环境。具体的性能数据和对比基线在论文中进行了详细的描述。

🎯 应用场景

该研究成果可应用于各种非结构化环境下的机器人操作任务,例如家庭服务机器人、工业机器人、医疗机器人等。通过技能迁移,机器人可以快速适应新的任务和环境,降低开发成本,提高工作效率。未来,该技术有望实现机器人在复杂环境下的自主操作,推动机器人技术的广泛应用。

📄 摘要(原文)

Developing general robotic systems capable of manipulating in unstructured environments is a significant challenge, particularly as the tasks involved are typically long-horizon and rich-contact, requiring efficient skill transfer across different task scenarios. To address these challenges, we propose knowledge graph-based skill library construction method. This method hierarchically organizes manipulation knowledge using "task graph" and "scene graph" to represent task-specific and scene-specific information, respectively. Additionally, we introduce "state graph" to facilitate the interaction between high-level task planning and low-level scene information. Building upon this foundation, we further propose a novel hierarchical skill transfer framework based on the skill library and tactile representation, which integrates high-level reasoning for skill transfer and low-level precision for execution. At the task level, we utilize large language models (LLMs) and combine contextual learning with a four-stage chain-of-thought prompting paradigm to achieve subtask sequence transfer. At the motion level, we develop an adaptive trajectory transfer method based on the skill library and the heuristic path planning algorithm. At the physical level, we propose an adaptive contour extraction and posture perception method based on tactile representation. This method dynamically acquires high-precision contour and posture information from visual-tactile images, adjusting parameters such as contact position and posture to ensure the effectiveness of transferred skills in new environments. Experiments demonstrate the skill transfer and adaptability capabilities of the proposed methods across different task scenarios. Project website: https://github.com/MingchaoQi/skill_transfer