Motion Before Action: Diffusing Object Motion as Manipulation Condition

作者: Yue Su, Xinyu Zhan, Hongjie Fang, Yong-Lu Li, Cewu Lu, Lixin Yang

分类: cs.RO

发布日期: 2024-11-14 (更新: 2025-04-12)

🔗 代码/项目: PROJECT_PAGE

💡 一句话要点

提出MBA:通过扩散物体运动信息来提升机器人操作模仿学习性能

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱二:RL算法与架构 (RL & Architecture) 支柱四:生成式动作 (Generative Motion)

关键词: 机器人操作 模仿学习 扩散模型 物体运动预测 动作生成

📋 核心要点

- 现有机器人操作任务中,从观测中推断物体运动表示可以提升性能,但如何有效利用运动信息仍是挑战。

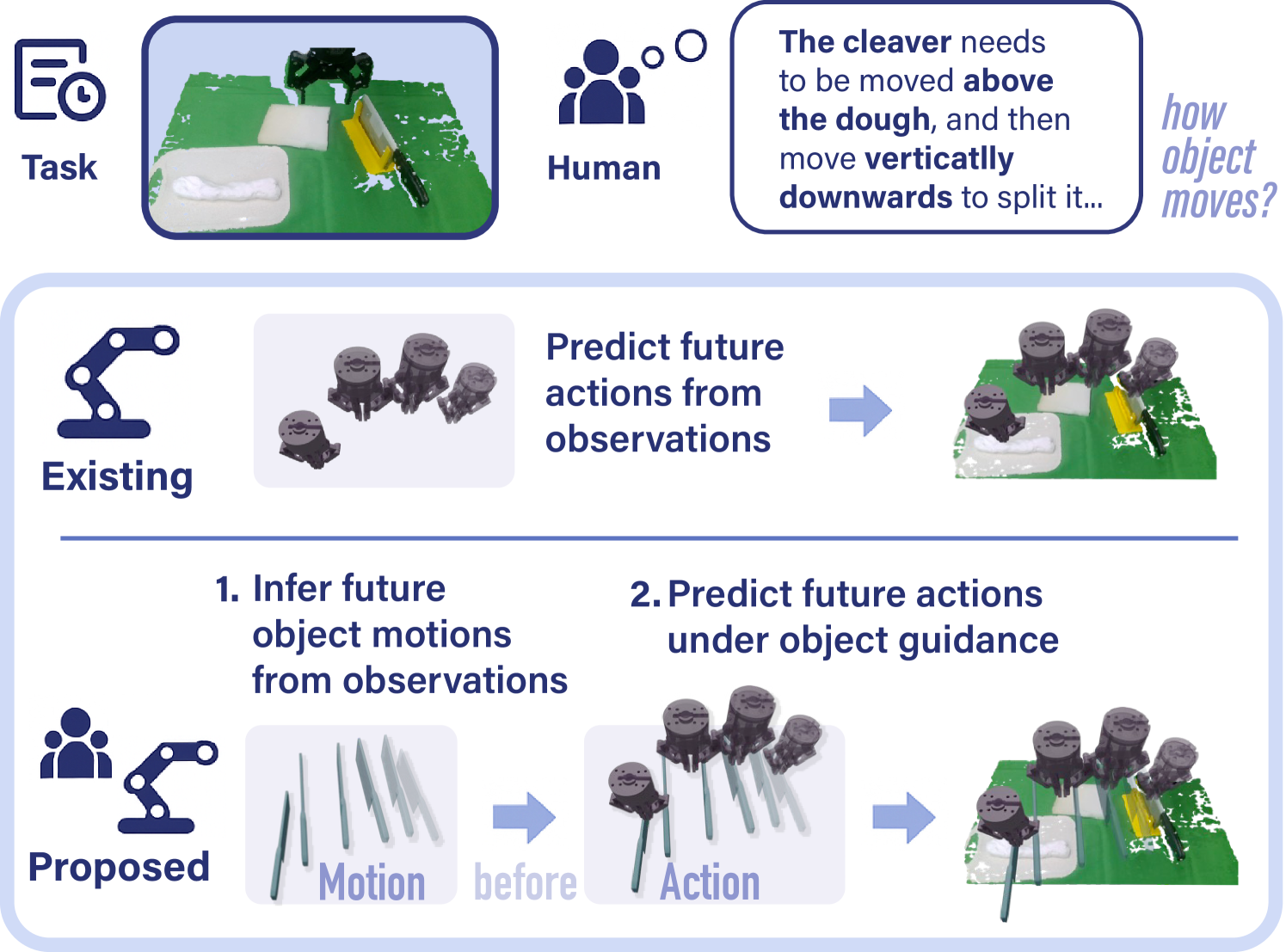

- MBA模块的核心思想是先预测物体的未来姿态序列,然后将该序列作为条件来引导机器人动作的生成。

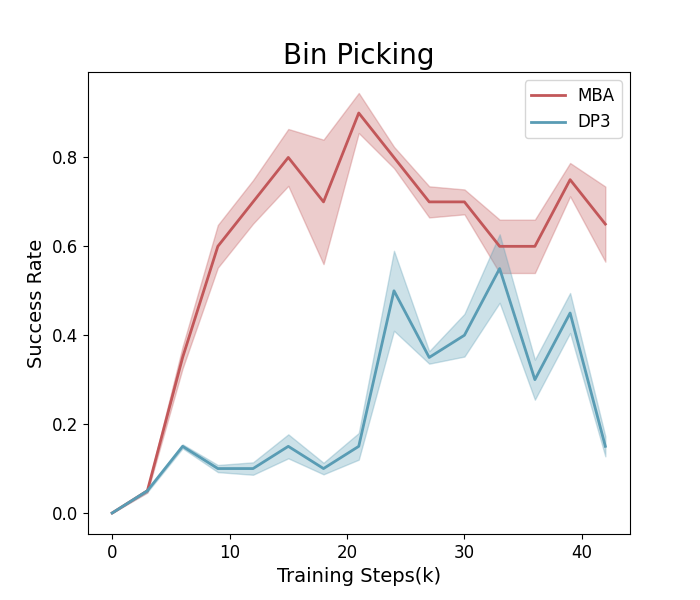

- 实验结果表明,MBA可以显著提升现有策略在模拟和真实环境中的操作性能,具有广泛的应用潜力。

📝 摘要(中文)

本文提出了一种新的机器人模仿学习范式,通过推理视觉观测中的物体运动信息来生成动作序列。我们提出了MBA(Motion Before Action)模块,该模块采用两个级联的扩散过程,首先生成物体运动轨迹,然后以该轨迹为条件指导机器人动作生成。MBA被设计为一个即插即用组件,可以灵活地集成到现有的具有扩散动作头的机器人操作策略中。在模拟和真实环境中的大量实验表明,我们的方法显著提高了现有策略在各种操作任务中的性能。

🔬 方法详解

问题定义:现有机器人模仿学习方法难以有效利用视觉观测中的物体运动信息,导致操作性能受限。如何从视觉输入中提取并利用物体运动信息,从而提升机器人操作的准确性和泛化性,是本文要解决的关键问题。现有方法要么直接从视觉输入预测动作,忽略了运动信息的重要性,要么难以有效地将运动信息融入到动作生成过程中。

核心思路:本文的核心思路是“Motion Before Action”,即在生成机器人动作之前,先预测物体的运动轨迹。通过将物体运动轨迹作为条件,引导机器人动作的生成,从而使机器人能够更好地理解和执行操作任务。这种解耦的方式使得模型能够更专注于学习物体运动和动作之间的关系,从而提高学习效率和性能。

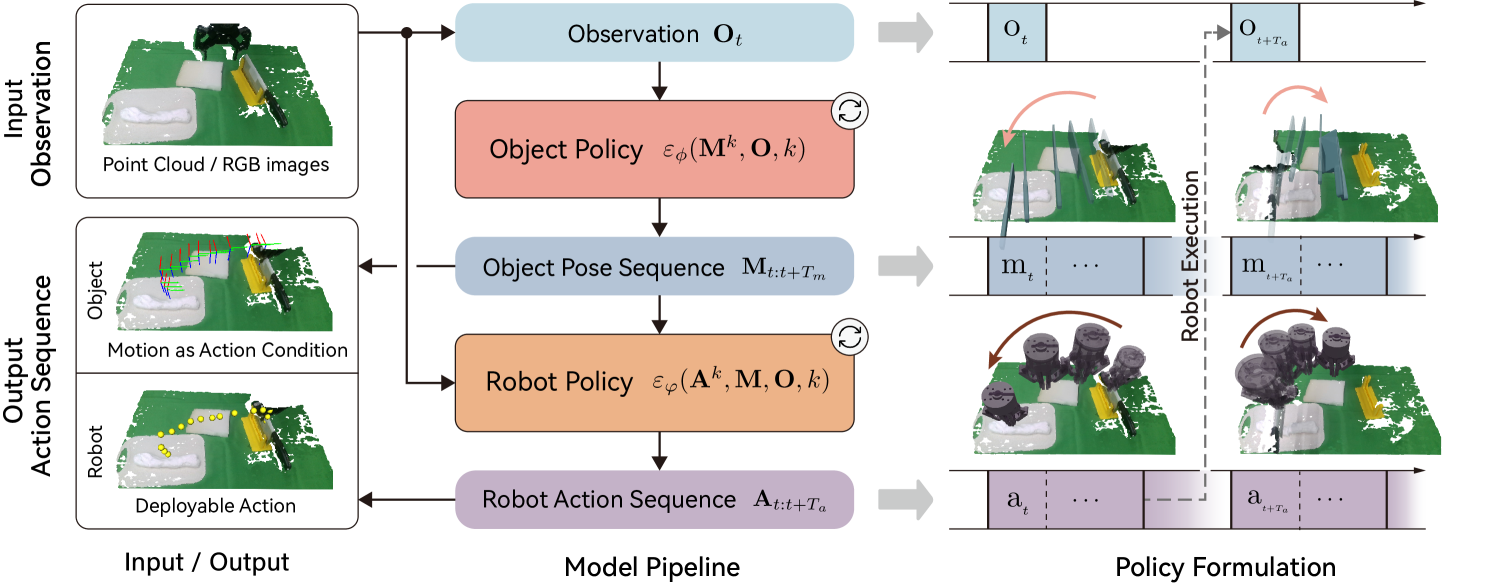

技术框架:MBA模块包含两个级联的扩散过程:物体运动生成器和机器人动作生成器。首先,物体运动生成器根据视觉观测预测物体未来的姿态序列。然后,机器人动作生成器以物体运动生成器预测的姿态序列为条件,生成相应的机器人动作序列。MBA模块可以作为即插即用组件,集成到现有的机器人操作策略中。整体流程是:视觉输入 -> 物体运动生成器 -> 物体运动轨迹 -> 机器人动作生成器 -> 机器人动作。

关键创新:本文最重要的技术创新点在于提出了“Motion Before Action”的范式,将物体运动预测和机器人动作生成解耦,并使用级联的扩散模型来实现。与现有方法直接从视觉输入预测动作不同,MBA模块显式地建模了物体运动,并将其作为动作生成的条件。这种方法能够更好地利用视觉信息中的运动线索,从而提高机器人操作的性能。

关键设计:物体运动生成器和机器人动作生成器均采用扩散模型,具体来说是Denoising Diffusion Probabilistic Models (DDPMs)。损失函数包括扩散模型的标准损失函数,以及用于约束物体运动轨迹和机器人动作的额外损失项(具体损失函数细节未知)。网络结构细节未知,但强调了MBA模块的即插即用性,意味着其设计应具有良好的兼容性。

🖼️ 关键图片

📊 实验亮点

在模拟和真实环境中的实验结果表明,MBA模块能够显著提升现有策略的性能。具体提升幅度未知,但强调了在多种操作任务上的有效性。实验结果验证了“Motion Before Action”范式的有效性,并展示了MBA模块的即插即用特性。

🎯 应用场景

该研究成果可广泛应用于各种机器人操作任务,例如装配、抓取、放置等。通过提升机器人对物体运动的理解能力,可以提高机器人在复杂环境中的操作性能和鲁棒性。该方法在工业自动化、家庭服务机器人等领域具有重要的应用价值,有望推动机器人技术的进一步发展。

📄 摘要(原文)

Inferring object motion representations from observations enhances the performance of robotic manipulation tasks. This paper introduces a new paradigm for robot imitation learning that generates action sequences by reasoning about object motion from visual observations. We propose MBA (Motion Before Action), a novel module that employs two cascaded diffusion processes for object motion generation and robot action generation under object motion guidance. MBA first predicts the future pose sequence of the object based on observations, then uses this sequence as a condition to guide robot action generation. Designed as a plug-and-play component, MBA can be flexibly integrated into existing robotic manipulation policies with diffusion action heads. Extensive experiments in both simulated and real-world environments demonstrate that our approach substantially improves the performance of existing policies across a wide range of manipulation tasks. Project page: https://selen-suyue.github.io/MBApage/