Predictive Visuo-Tactile Interactive Perception Framework for Object Properties Inference

作者: Anirvan Dutta, Etienne Burdet, Mohsen Kaboli

分类: cs.RO

发布日期: 2024-11-13

💡 一句话要点

提出基于视觉-触觉预测交互感知的物体属性推断框架

🎯 匹配领域: 支柱一:机器人控制 (Robot Control)

关键词: 交互感知 物体属性推断 视觉触觉融合 主动探索 图神经网络

📋 核心要点

- 现有方法难以精确推断物体刚度、质量等物理属性,限制了机器人在复杂环境中的操作能力。

- 论文提出一种预测感知框架,结合视觉和触觉信息,通过主动探索动作学习物体属性。

- 真实机器人实验表明,该框架在物体跟踪、目标驱动任务和环境变化检测方面优于现有方法。

📝 摘要(中文)

本研究针对自主机器人在非结构化环境中持续运行的需求,提出了一种预测感知框架,用于推断物体的物理属性,如刚度、质量、质心、摩擦系数和形状。精确识别这些属性对于稳定、可控地操作物体至关重要,并且是预测推、拉、举等操作结果的必要条件。该框架利用配备视觉和触觉传感器的机器人系统,通过非抓取式推动和抓取式拉动等通用探索动作,自主推断各种同质、异质和铰接物体的物理属性。框架包含一种新颖的主动形状感知方法,用于无缝启动探索。创新的双重可微滤波与图神经网络相结合,学习物体-机器人交互,并对间接可观察的时不变物体属性进行一致的推断。此外,论文还设计了一种N步信息增益方法,以主动选择信息量最大的动作,从而实现高效的学习和推断。大量的真实机器人实验表明,该预测感知框架的性能优于最先进的基线方法,并在物体跟踪、目标驱动任务和环境变化检测三个主要应用中展示了其有效性。

🔬 方法详解

问题定义:论文旨在解决机器人自主推断物体物理属性的问题,包括刚度、质量、质心、摩擦系数和形状等。现有方法在处理复杂物体(如异质或铰接物体)时,以及在利用多模态信息进行高效推理方面存在不足,导致机器人难以在非结构化环境中稳定、可控地操作物体。

核心思路:论文的核心思路是利用机器人与物体的交互过程,通过视觉和触觉传感器获取数据,并建立一个预测模型来推断物体的物理属性。通过主动选择信息量最大的交互动作,可以更有效地学习和推断这些属性。这种方法结合了主动探索和预测学习,旨在提高物体属性推断的准确性和效率。

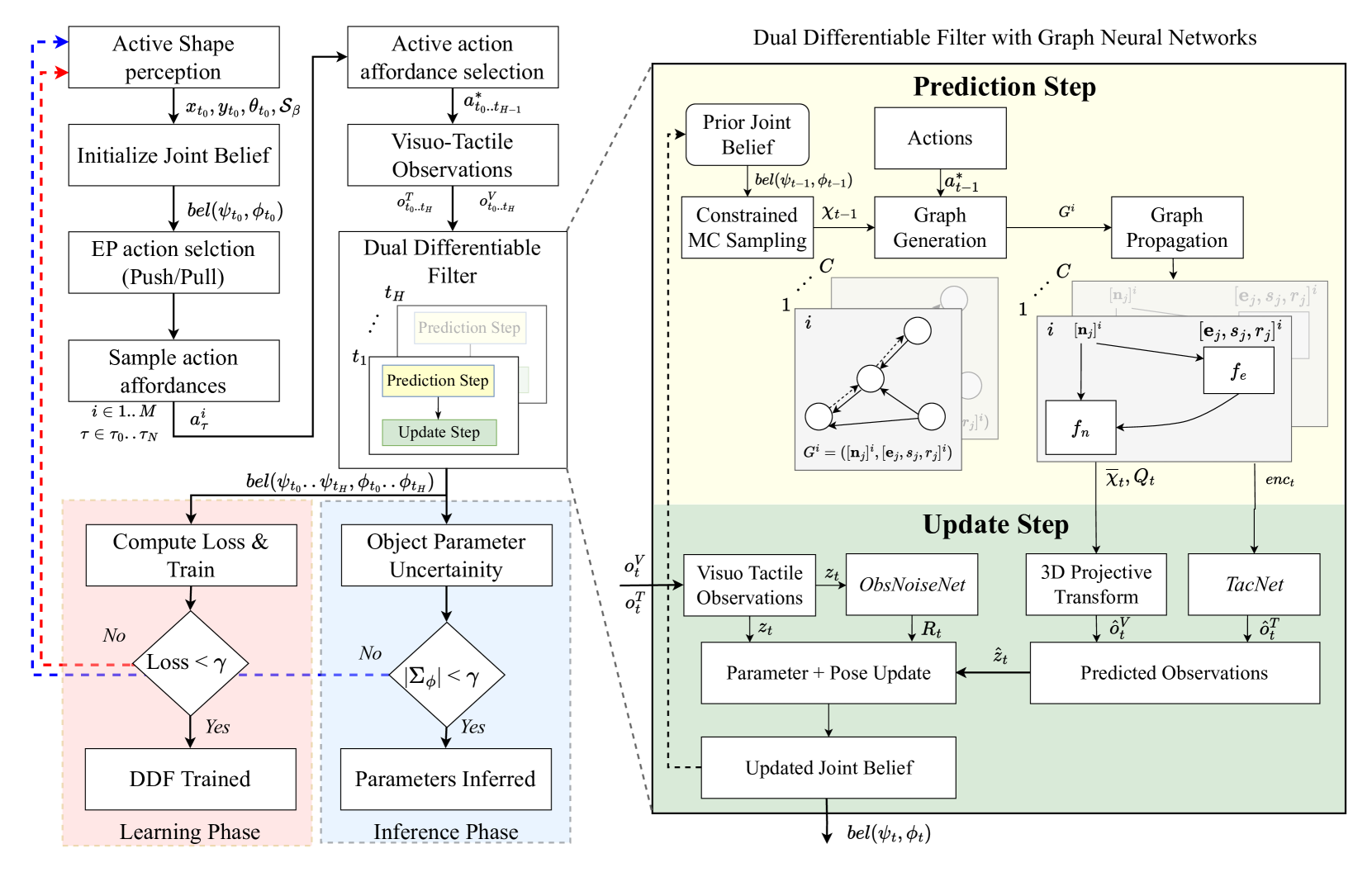

技术框架:该框架包含以下主要模块:1) 主动形状感知:用于启动探索过程,确定初始的交互动作。2) 交互动作执行:机器人执行非抓取式推动和抓取式拉动等动作。3) 视觉和触觉数据采集:通过传感器获取交互过程中的视觉和触觉信息。4) 双重可微滤波与图神经网络:学习物体-机器人交互,并推断物体属性。5) N步信息增益:用于主动选择下一个最informative的动作。整个流程通过循环迭代,不断优化物体属性的推断结果。

关键创新:该论文的关键创新在于:1) 提出了一种双重可微滤波与图神经网络相结合的方法,用于学习物体-机器人交互,并进行一致的物体属性推断。2) 设计了一种N步信息增益方法,用于主动选择信息量最大的动作,从而实现高效的学习和推断。3) 结合视觉和触觉信息,利用主动探索策略,提高了物体属性推断的准确性和鲁棒性。

关键设计:论文中使用了图神经网络(GNN)来建模物体和机器人的交互关系,GNN的结构和参数需要根据具体的任务进行设计。损失函数的设计需要考虑多个因素,包括预测的物体属性与真实值之间的误差,以及动作选择的效率。N步信息增益的计算需要权衡探索的深度和计算复杂度。具体的参数设置和网络结构在论文中可能没有详细描述,需要参考相关的文献。

🖼️ 关键图片

📊 实验亮点

实验结果表明,该预测感知框架在物体属性推断方面优于现有基线方法。在物体跟踪、目标驱动任务和环境变化检测等应用中,该框架表现出更高的准确性和鲁棒性。具体的性能数据和提升幅度在论文中可能有所体现,但此处未明确给出。

🎯 应用场景

该研究成果可应用于各种需要机器人自主操作物体的场景,如智能仓储、自动化装配、家庭服务机器人等。通过准确推断物体属性,机器人可以更安全、更有效地完成抓取、搬运、放置等任务。此外,该技术还可用于机器人环境感知和环境建模,提高机器人在复杂环境中的适应能力。

📄 摘要(原文)

Interactive exploration of the unknown physical properties of objects such as stiffness, mass, center of mass, friction coefficient, and shape is crucial for autonomous robotic systems operating continuously in unstructured environments. Precise identification of these properties is essential to manipulate objects in a stable and controlled way, and is also required to anticipate the outcomes of (prehensile or non-prehensile) manipulation actions such as pushing, pulling, lifting, etc. Our study focuses on autonomously inferring the physical properties of a diverse set of various homogeneous, heterogeneous, and articulated objects utilizing a robotic system equipped with vision and tactile sensors. We propose a novel predictive perception framework for identifying object properties of the diverse objects by leveraging versatile exploratory actions: non-prehensile pushing and prehensile pulling. As part of the framework, we propose a novel active shape perception to seamlessly initiate exploration. Our innovative dual differentiable filtering with Graph Neural Networks learns the object-robot interaction and performs consistent inference of indirectly observable time-invariant object properties. In addition, we formulate a $N$-step information gain approach to actively select the most informative actions for efficient learning and inference. Extensive real-robot experiments with planar objects show that our predictive perception framework results in better performance than the state-of-the-art baseline and demonstrate our framework in three major applications for i) object tracking, ii) goal-driven task, and iii) change in environment detection.