DexH2R: Task-oriented Dexterous Manipulation from Human to Robots

作者: Shuqi Zhao, Xinghao Zhu, Yuxin Chen, Chenran Li, Lichen Xie, Xiang Zhang, Mingyu Ding, Masayoshi Tomizuka

分类: cs.RO

发布日期: 2024-11-07 (更新: 2026-01-13)

💡 一句话要点

提出DexH2R框架,结合人手动作重定向与任务导向残差策略,提升灵巧操作泛化性。

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱七:动作重定向 (Motion Retargeting)

关键词: 灵巧操作 人机协作 动作重定向 残差策略 强化学习

📋 核心要点

- 现有灵巧操作方法依赖复杂数据收集或泛化性差,难以应对新场景。

- DexH2R结合人手动作重定向与任务导向残差策略,弥合具身差距。

- 实验表明,DexH2R在模拟和真实环境中均优于现有方法,提升达40%。

📝 摘要(中文)

灵巧操作是人类能力的关键组成部分,能够与各种物体进行交互。最近,从人类演示和遥操作中学习的进展推动了机器人在这方面的能力。然而,这些方法要么需要复杂的数据收集,例如耗费大量人力进行眼-机器人接触,要么在面对新场景时泛化能力较差。为了解决这两个挑战,我们提出了一个框架DexH2R,它结合了人手动作重定向与任务导向的残差动作策略,通过弥合人类和机器人灵巧手之间的具身差距来提高任务性能。具体来说,DexH2R直接从重定向的原始动作和任务导向的奖励中学习残差策略,无需耗费大量人力的遥操作系统。此外,我们通过引入人类手和物体的期望轨迹,在测试时为新场景提供指导,使灵巧手能够获得具有高泛化性的新技能。在模拟和真实环境中的大量实验表明了我们工作的有效性,在各种设置中优于先前的最先进方法40%。

🔬 方法详解

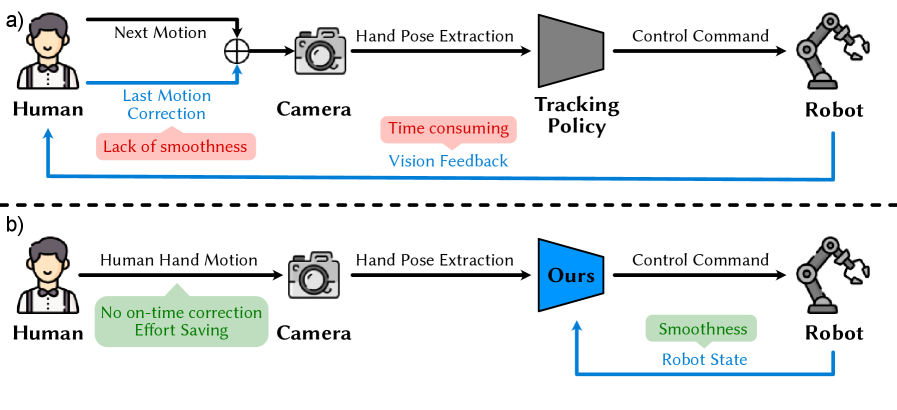

问题定义:论文旨在解决机器人灵巧操作中,从人类演示学习时数据收集困难和泛化性不足的问题。现有方法要么需要昂贵的遥操作系统和大量人工标注,要么在新场景下的表现不佳,无法有效利用人类的灵巧操作经验。

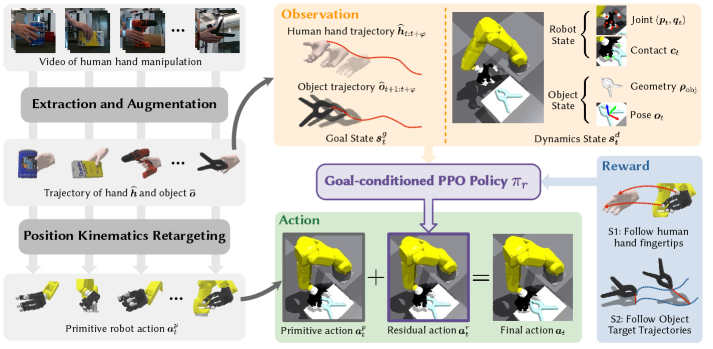

核心思路:论文的核心思路是将人类的灵巧操作动作通过重定向的方式迁移到机器人手上,并在此基础上学习一个残差策略,以弥补人手和机器人手之间的差异。通过任务导向的奖励函数来指导残差策略的学习,从而提高任务完成的成功率和泛化能力。

技术框架:DexH2R框架主要包含两个阶段:1) 人手动作重定向阶段:将人类手部的动作轨迹映射到机器人手部的动作空间。2) 残差策略学习阶段:利用重定向后的动作作为初始动作,通过强化学习或模仿学习等方法,学习一个残差策略,以优化机器人的操作动作。在测试阶段,可以结合人类手部和物体的期望轨迹,进一步指导机器人的操作。

关键创新:该论文的关键创新在于结合了人手动作重定向和任务导向的残差策略学习。通过重定向,可以有效地利用人类的灵巧操作经验,而残差策略学习则可以弥补人手和机器人手之间的差异,提高任务完成的成功率。此外,测试时引入人类轨迹指导,进一步提升了泛化能力。

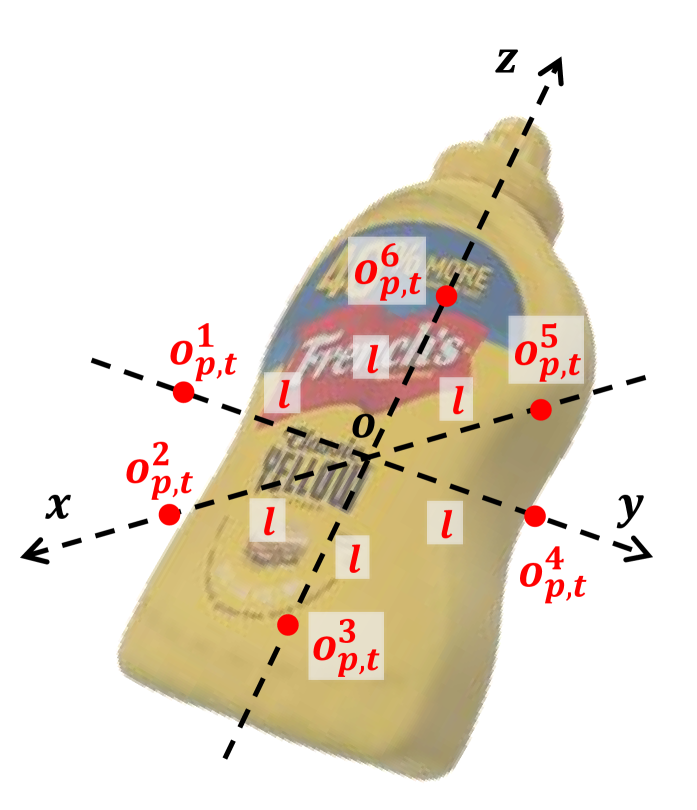

关键设计:论文中可能涉及的关键设计包括:1) 人手动作重定向的具体方法,例如使用运动学映射或深度学习模型。2) 残差策略学习的奖励函数设计,需要能够有效地引导机器人完成任务。3) 残差策略的网络结构设计,需要能够有效地学习和表达残差动作。4) 测试时人类轨迹指导的融合方式,例如通过注意力机制或加权平均等方法。

🖼️ 关键图片

📊 实验亮点

实验结果表明,DexH2R框架在各种灵巧操作任务中均取得了显著的性能提升,相较于现有最先进方法,性能提升高达40%。该框架在模拟和真实环境中均表现出良好的泛化能力,能够有效地应对新场景和新任务的挑战。这些结果验证了该框架的有效性和实用性。

🎯 应用场景

该研究成果可应用于各种需要灵巧操作的机器人应用场景,例如:工业自动化中的精密装配、医疗手术机器人中的微创操作、家庭服务机器人中的物品整理等。通过学习人类的灵巧操作技能,机器人可以更好地适应复杂和动态的环境,提高工作效率和安全性,具有广阔的应用前景。

📄 摘要(原文)

Dexterous manipulation is a critical aspect of human capability, enabling interaction with a wide variety of objects. Recent advancements in learning from human demonstrations and teleoperation have enabled progress for robots in such ability. However, these approaches either require complex data collection such as costly human effort for eye-robot contact, or suffer from poor generalization when faced with novel scenarios. To solve both challenges, we propose a framework, DexH2R, that combines human hand motion retargeting with a task-oriented residual action policy, improving task performance by bridging the embodiment gap between human and robotic dexterous hands. Specifically, DexH2R learns the residual policy directly from retargeted primitive actions and task-oriented rewards, eliminating the need for labor-intensive teleoperation systems. Moreover, we incorporate test-time guidance for novel scenarios by taking in desired trajectories of human hands and objects, allowing the dexterous hand to acquire new skills with high generalizability. Extensive experiments in both simulation and real-world environments demonstrate the effectiveness of our work, outperforming prior state-of-the-arts by 40% across various settings.