STEER: Flexible Robotic Manipulation via Dense Language Grounding

作者: Laura Smith, Alex Irpan, Montserrat Gonzalez Arenas, Sean Kirmani, Dmitry Kalashnikov, Dhruv Shah, Ted Xiao

分类: cs.RO, cs.AI

发布日期: 2024-11-05

备注: Project website: https://lauramsmith.github.io/steer/

💡 一句话要点

STEER:基于密集语言对齐的柔性机器人操作框架

🎯 匹配领域: 支柱一:机器人控制 (Robot Control)

关键词: 机器人操作 语言对齐 强化学习 视觉语言模型 柔性控制

📋 核心要点

- 现有机器人系统难以适应真实世界复杂多变的场景,缺乏高层推理与底层控制的有效桥梁。

- STEER框架通过训练语言对齐策略,将高层常识推理转化为可执行的底层控制,实现智能操作。

- 实验证明,STEER学习的技能可以组合成新行为,适应新情况或执行全新任务,无需额外训练数据。

📝 摘要(中文)

现实世界的复杂性要求机器人系统能够智能地适应未见的情况。我们提出了STEER,一个机器人学习框架,它将高层次的常识推理与精确、灵活的低层次控制联系起来。我们的方法通过使用密集标注训练语言对齐策略,将复杂的环境感知转化为可执行的低层次行为。通过围绕自然语言表达的基本、模块化的操作技能构建策略训练,STEER为人类或视觉-语言模型(VLMs)提供了一个富有表现力的接口,通过推理任务和上下文来智能地编排机器人的行为。我们的实验表明,通过STEER学习的技能可以组合起来,合成新的行为,以适应新的情况或执行全新的任务,而无需额外的数据收集或训练。

🔬 方法详解

问题定义:现有机器人操作方法难以将高层语义理解与底层精确控制有效结合,导致在复杂、未知的环境中泛化能力不足。痛点在于缺乏一种能够灵活地将人类指令或视觉-语言模型的推理结果转化为机器人具体动作的机制。

核心思路:STEER的核心思路是利用自然语言作为桥梁,将高层语义信息与底层控制策略对齐。通过训练语言条件下的机器人策略,使得机器人能够根据语言指令执行相应的操作。这种方法允许人类或视觉-语言模型通过自然语言来指导机器人的行为,从而实现更灵活和智能的机器人操作。

技术框架:STEER框架主要包含以下几个模块:1) 密集标注的数据集构建,用于训练语言对齐的策略;2) 基于语言条件的操作策略学习,利用深度学习模型将语言指令映射到机器人动作;3) 模块化技能组合,将学习到的基本操作技能组合成更复杂的行为。整体流程是:输入语言指令,通过策略网络生成机器人动作序列,执行动作并观察环境变化,根据反馈调整策略。

关键创新:STEER的关键创新在于其密集语言对齐策略。不同于以往的稀疏奖励或模仿学习,STEER通过对机器人操作过程中的每个步骤进行语言标注,从而更有效地学习语言与动作之间的对应关系。这种密集标注的方式使得机器人能够更好地理解语言指令的细粒度含义,并生成更精确的动作。

关键设计:STEER的关键设计包括:1) 使用Transformer网络作为策略网络的主干,以捕捉语言指令中的长程依赖关系;2) 设计了一种新的损失函数,用于鼓励策略网络生成与语言指令更相关的动作;3) 采用模块化技能表示,将复杂的任务分解为一系列基本操作技能,从而提高策略的泛化能力。具体的参数设置和网络结构细节在论文中有详细描述。

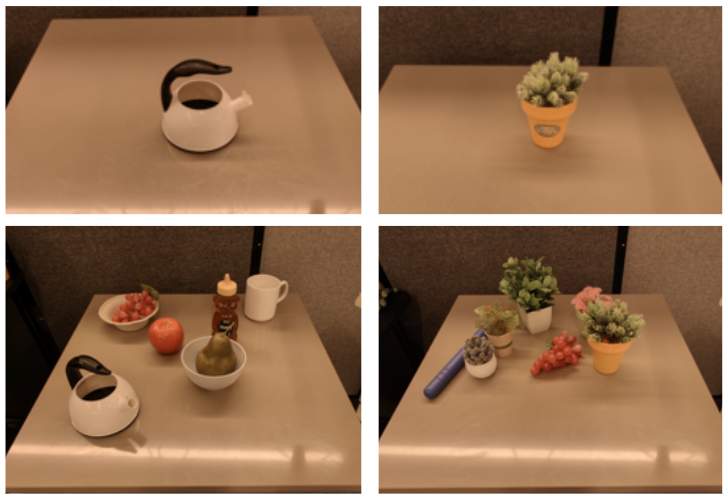

🖼️ 关键图片

📊 实验亮点

实验结果表明,STEER框架能够有效地学习语言对齐的机器人操作策略。通过组合学习到的基本技能,STEER能够执行全新的任务,而无需额外的数据收集或训练。与传统的模仿学习方法相比,STEER在复杂环境中的泛化能力更强,能够更好地适应未知的场景。

🎯 应用场景

STEER框架具有广泛的应用前景,例如在家庭服务机器人、工业自动化、医疗辅助机器人等领域。它可以使机器人能够更好地理解人类指令,执行更复杂的任务,并适应不断变化的环境。未来,STEER有望成为人机协作的重要技术支撑,推动机器人技术的进一步发展。

📄 摘要(原文)

The complexity of the real world demands robotic systems that can intelligently adapt to unseen situations. We present STEER, a robot learning framework that bridges high-level, commonsense reasoning with precise, flexible low-level control. Our approach translates complex situational awareness into actionable low-level behavior through training language-grounded policies with dense annotation. By structuring policy training around fundamental, modular manipulation skills expressed in natural language, STEER exposes an expressive interface for humans or Vision-Language Models (VLMs) to intelligently orchestrate the robot's behavior by reasoning about the task and context. Our experiments demonstrate the skills learned via STEER can be combined to synthesize novel behaviors to adapt to new situations or perform completely new tasks without additional data collection or training.