LVI-GS: Tightly-coupled LiDAR-Visual-Inertial SLAM using 3D Gaussian Splatting

作者: Huibin Zhao, Weipeng Guan, Peng Lu

分类: cs.RO

发布日期: 2024-11-05

💡 一句话要点

LVI-GS:一种基于3D高斯溅射的紧耦合激光雷达-视觉-惯性SLAM框架

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 激光雷达 视觉惯性SLAM 三维高斯溅射 三维重建 可微渲染

📋 核心要点

- 现有SLAM方法难以兼顾几何精度和视觉细节,尤其是在复杂环境中。

- LVI-GS利用3D高斯溅射,结合激光雷达和视觉信息,实现高精度和高保真度的三维重建。

- 通过金字塔训练、深度损失和CUDA加速等策略,LVI-GS实现了实时且高质量的建图效果。

📝 摘要(中文)

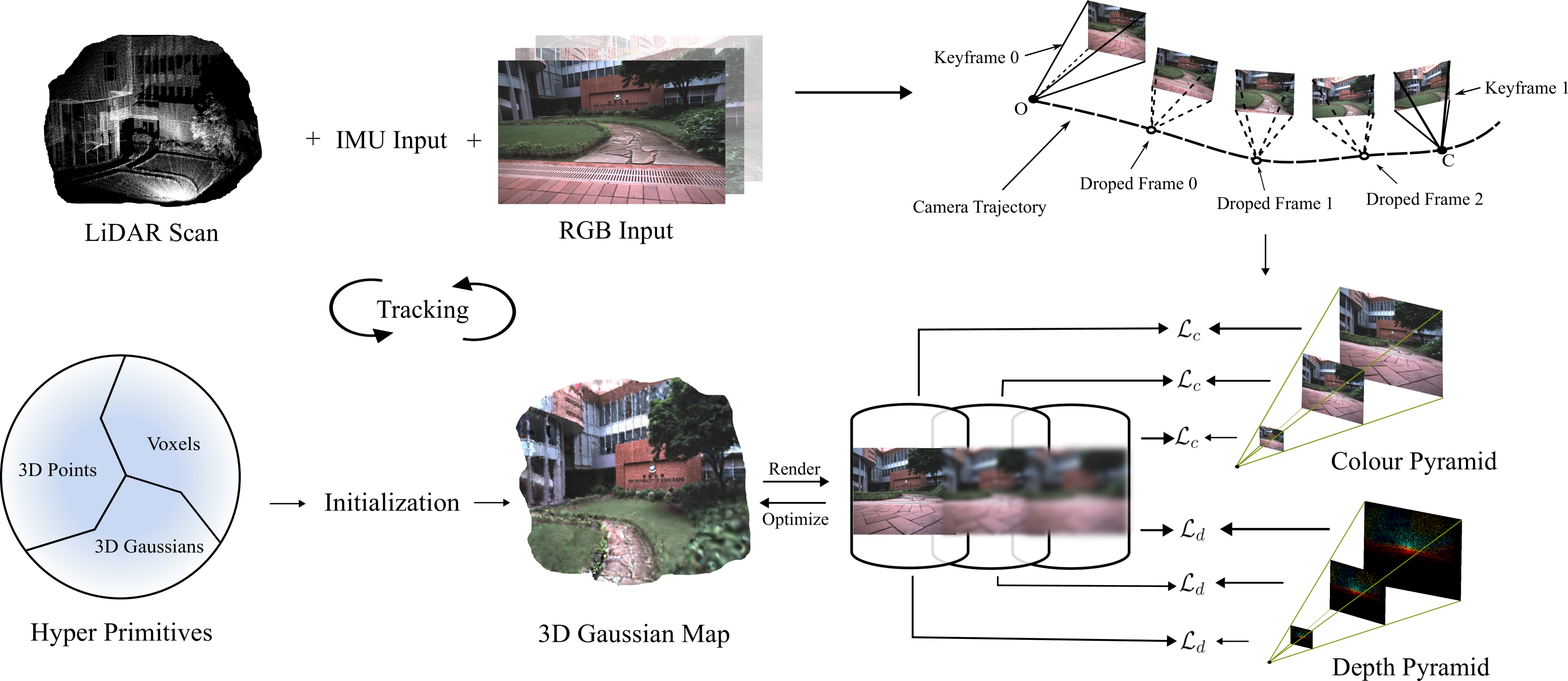

本文提出了一种名为LVI-GS的紧耦合激光雷达-视觉-惯性(LVI)建图框架,该框架利用3D高斯溅射(3DGS)技术,结合激光雷达和图像传感器的互补特性,以捕获三维场景的几何结构和视觉细节。该方法首先使用彩色激光雷达点云初始化3D高斯分布,然后利用可微渲染进行优化。为了实现高保真建图,引入了基于金字塔的训练方法,以有效地学习多层次特征,并结合从激光雷达测量导出的深度损失,以提高几何特征感知能力。通过精心设计的高斯图扩展、关键帧选择、线程管理和自定义CUDA加速策略,该框架实现了实时的照片级真实感建图。数值实验表明,与最先进的三维重建系统相比,该方法具有优越的性能。

🔬 方法详解

问题定义:现有SLAM系统在复杂环境中难以同时保证几何精度和视觉细节的重建质量。基于视觉的SLAM方法容易受到光照变化和纹理缺失的影响,而基于激光雷达的SLAM方法则缺乏丰富的颜色信息。因此,如何有效地融合激光雷达和视觉信息,实现高精度、高保真度的三维重建是一个关键问题。

核心思路:LVI-GS的核心思路是利用3D高斯溅射(3DGS)作为三维场景的表示方法,并将其与激光雷达和视觉信息紧密耦合。3DGS具有可微渲染的特性,可以方便地进行优化。通过将激光雷达点云初始化为3D高斯分布,并利用视觉信息和激光雷达深度信息进行优化,可以同时获得高精度的几何结构和丰富的视觉细节。

技术框架:LVI-GS框架主要包含以下几个模块:1) 初始化模块:利用彩色激光雷达点云初始化3D高斯分布。2) 优化模块:利用可微渲染和深度损失函数优化3D高斯分布的参数,包括位置、协方差、颜色等。3) 金字塔训练模块:采用基于金字塔的训练方法,学习多层次的特征。4) 扩展模块:设计高斯图扩展策略,动态调整高斯点的数量。5) 加速模块:通过关键帧选择、线程管理和自定义CUDA加速,实现实时性能。

关键创新:LVI-GS的关键创新在于将3D高斯溅射与激光雷达-视觉-惯性SLAM紧密耦合。与传统的基于点云或体素的SLAM方法相比,3DGS具有可微渲染的特性,可以方便地利用视觉信息进行优化。此外,该方法还引入了基于金字塔的训练方法和深度损失函数,进一步提高了重建质量。

关键设计:在金字塔训练中,使用了多尺度的图像和深度信息,以学习不同层次的特征。深度损失函数用于约束高斯点的深度与激光雷达测量值一致。为了实现实时性能,采用了关键帧选择策略,只对关键帧进行优化。此外,还使用了自定义CUDA加速,以提高渲染和优化的速度。

🖼️ 关键图片

📊 实验亮点

实验结果表明,LVI-GS在三维重建质量方面优于现有的方法。与state-of-the-art的三维重建系统相比,LVI-GS在重建精度和视觉效果方面都有显著提升。此外,LVI-GS还实现了实时性能,可以在实际应用中使用。

🎯 应用场景

LVI-GS具有广泛的应用前景,例如自动驾驶、机器人导航、虚拟现实、增强现实、三维地图重建等领域。该方法可以用于构建高精度、高保真度的三维地图,为自动驾驶车辆提供精确的环境感知,为机器人提供可靠的导航信息,为用户提供沉浸式的虚拟现实体验。

📄 摘要(原文)

3D Gaussian Splatting (3DGS) has shown its ability in rapid rendering and high-fidelity mapping. In this paper, we introduce LVI-GS, a tightly-coupled LiDAR-Visual-Inertial mapping framework with 3DGS, which leverages the complementary characteristics of LiDAR and image sensors to capture both geometric structures and visual details of 3D scenes. To this end, the 3D Gaussians are initialized from colourized LiDAR points and optimized using differentiable rendering. In order to achieve high-fidelity mapping, we introduce a pyramid-based training approach to effectively learn multi-level features and incorporate depth loss derived from LiDAR measurements to improve geometric feature perception. Through well-designed strategies for Gaussian-Map expansion, keyframe selection, thread management, and custom CUDA acceleration, our framework achieves real-time photo-realistic mapping. Numerical experiments are performed to evaluate the superior performance of our method compared to state-of-the-art 3D reconstruction systems.