Modeling Uncertainty in 3D Gaussian Splatting through Continuous Semantic Splatting

作者: Joey Wilson, Marcelino Almeida, Min Sun, Sachit Mahajan, Maani Ghaffari, Parker Ewen, Omid Ghasemalizadeh, Cheng-Hao Kuo, Arnie Sen

分类: cs.RO, cs.CV

发布日期: 2024-11-04

💡 一句话要点

提出基于连续语义Splatting的3D高斯不确定性建模方法,提升机器人应用安全性。

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 3D高斯Splatting 不确定性建模 连续语义映射 概率栅格化 机器人应用

📋 核心要点

- 3D高斯Splatting在场景理解方面表现出色,但缺乏不确定性建模,限制了其在安全关键机器人领域的应用。

- 论文提出连续语义Splatting方法,将概率语义映射从体素扩展到椭球,结合3D-GS的精确性和不确定性量化能力。

- 通过概率语义更新和栅格化,算法能够提供带有可量化不确定性的像素分割预测,并通过实验验证了其有效性。

📝 摘要(中文)

本文提出了一种新的算法,用于在3D高斯Splatting(3D-GS)中概率性地更新和栅格化语义地图。虽然之前的方法已经引入了在3D-GS中学习栅格化特征以增强场景理解的算法,但3D-GS可能会在没有警告的情况下失效,这对安全关键型机器人应用提出了挑战。为了解决这一差距,我们提出了一种方法,将连续语义映射从体素扩展到椭球,结合了3D-GS的精确结构和量化概率机器人地图不确定性的能力。给定一组图像,我们的算法直接在3D椭球上执行概率语义更新,通过使用共轭先验来获得期望和方差。我们还提出了一种概率栅格化方法,该方法返回具有可量化不确定性的逐像素分割预测。我们将我们的方法与类似的基于概率体素的方法进行比较,以验证我们对3D椭球的扩展,并对不确定性量化和时间平滑进行消融研究。

🔬 方法详解

问题定义:现有的3D高斯Splatting方法虽然在场景重建和渲染方面表现出色,但在安全关键的机器人应用中,缺乏对场景理解的不确定性建模。3D-GS可能在没有预警的情况下失效,导致机器人做出错误的决策,因此需要一种能够量化不确定性的方法。

核心思路:论文的核心思路是将连续语义映射的思想从体素扩展到3D高斯Splatting所使用的椭球表示。通过在椭球上进行概率语义更新,可以同时获得语义信息的期望和方差,从而量化不确定性。这种方法结合了3D-GS的精确结构和概率机器人地图的不确定性量化能力。

技术框架:该算法的整体流程包括以下几个阶段:1) 给定一组图像作为输入;2) 对3D高斯椭球进行概率语义更新,利用共轭先验计算期望和方差;3) 进行概率栅格化,生成带有可量化不确定性的逐像素分割预测;4) 对结果进行评估和分析。

关键创新:最重要的技术创新点是将连续语义映射从体素扩展到椭球。与基于体素的方法相比,基于椭球的方法能够更精确地表示场景结构,并且能够更好地利用3D-GS的优势。此外,论文还提出了概率栅格化方法,能够生成带有不确定性信息的分割预测。

关键设计:论文使用了共轭先验来进行概率语义更新,这使得能够高效地计算期望和方差。具体的参数设置和损失函数在论文中没有详细说明,属于未知信息。网络结构也未明确给出。

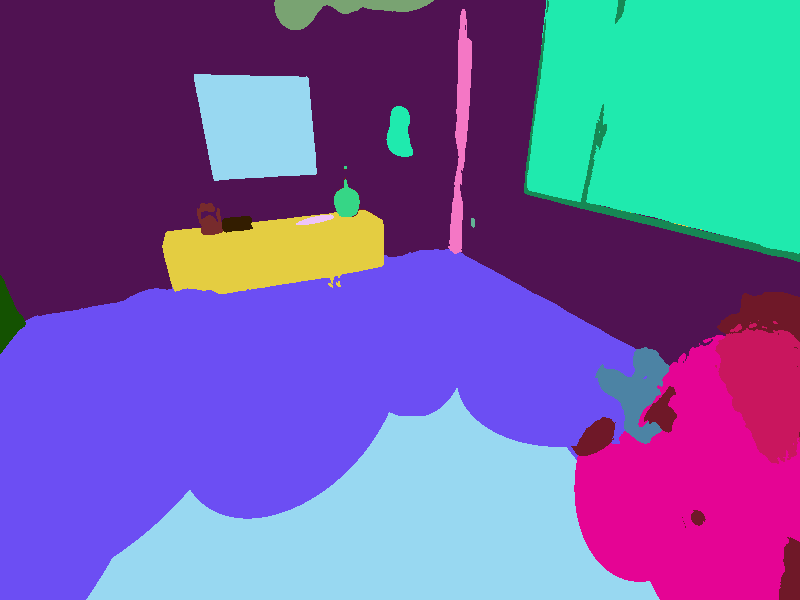

🖼️ 关键图片

📊 实验亮点

论文通过实验验证了所提出的方法在不确定性量化方面的有效性。与基于概率体素的方法相比,该方法能够更精确地表示场景结构,并提供更可靠的不确定性估计。此外,消融研究表明,时间平滑能够进一步提高不确定性量化的准确性。具体的性能数据和提升幅度在摘要中未提及,属于未知信息。

🎯 应用场景

该研究成果可应用于安全关键型机器人应用,例如自动驾驶、无人机导航、医疗机器人等。通过量化场景理解的不确定性,机器人可以更加安全可靠地执行任务,避免因环境感知错误而导致的事故。此外,该方法还可以用于增强现实和虚拟现实等领域,提供更加逼真和可靠的场景体验。

📄 摘要(原文)

In this paper, we present a novel algorithm for probabilistically updating and rasterizing semantic maps within 3D Gaussian Splatting (3D-GS). Although previous methods have introduced algorithms which learn to rasterize features in 3D-GS for enhanced scene understanding, 3D-GS can fail without warning which presents a challenge for safety-critical robotic applications. To address this gap, we propose a method which advances the literature of continuous semantic mapping from voxels to ellipsoids, combining the precise structure of 3D-GS with the ability to quantify uncertainty of probabilistic robotic maps. Given a set of images, our algorithm performs a probabilistic semantic update directly on the 3D ellipsoids to obtain an expectation and variance through the use of conjugate priors. We also propose a probabilistic rasterization which returns per-pixel segmentation predictions with quantifiable uncertainty. We compare our method with similar probabilistic voxel-based methods to verify our extension to 3D ellipsoids, and perform ablation studies on uncertainty quantification and temporal smoothing.