Analysing the Interplay of Vision and Touch for Dexterous Insertion Tasks

作者: Janis Lenz, Theo Gruner, Daniel Palenicek, Tim Schneider, Jan Peters

分类: cs.RO

发布日期: 2024-10-31

💡 一句话要点

分析视觉与触觉在灵巧插入任务中的相互作用,提升机器人操作性能

🎯 匹配领域: 支柱一:机器人控制 (Robot Control)

关键词: 机器人操作 灵巧插入 视觉触觉融合 多模态感知 触觉反馈

📋 核心要点

- 机器人插入任务在感知不确定性和控制精度方面面临挑战,尤其是在非结构化环境中。

- 该研究分析了视觉和触觉在灵巧插入任务中的相互作用,旨在提升机器人操作的鲁棒性和准确性。

- 实验结果表明,触觉反馈能够显著提高在复杂插入任务中的成功率,优于仅依赖视觉的方案。

📝 摘要(中文)

机器人插入任务由于感知的不确定性和精确控制的需求而仍然具有挑战性,尤其是在非结构化环境中。虽然人类可以无缝地结合视觉和触觉来完成此类任务,但在机器人系统中有效地整合这些模态仍然是一个开放的问题。本文对灵巧插入任务中视觉和触觉反馈之间的相互作用进行了广泛的分析,表明触觉传感可以极大地提高在具有严格公差和各种孔方向的挑战性插入任务中的成功率,而这些任务仅靠视觉无法解决。这些发现为设计更有效的多模态机器人控制系统提供了宝贵的见解,并突出了触觉反馈在接触丰富的操作任务中的关键作用。

🔬 方法详解

问题定义:论文旨在解决机器人插入任务中,由于感知不确定性导致的插入失败问题。现有方法主要依赖视觉信息,但在高精度、小间隙或遮挡情况下,视觉信息不足以保证插入成功。因此,如何有效融合视觉和触觉信息,提升插入任务的鲁棒性是本研究要解决的核心问题。

核心思路:论文的核心思路是分析视觉和触觉在插入任务中的互补作用,并利用触觉反馈来弥补视觉信息的不足。通过触觉感知,机器人可以感知到接触力、位置和方向等信息,从而调整插入策略,提高插入成功率。这种思路强调了多模态融合的重要性,并试图找到最佳的视觉-触觉协同方式。

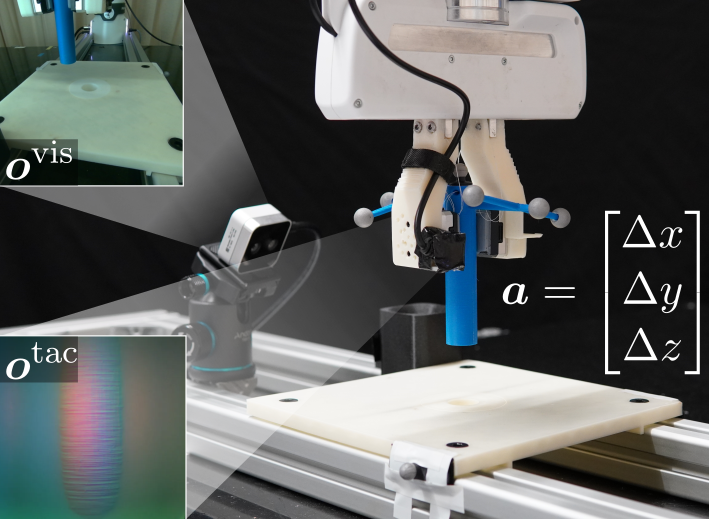

技术框架:论文的技术框架主要包括以下几个阶段:1) 视觉感知阶段:利用视觉传感器获取目标物体和环境的信息,例如孔的位置和方向。2) 触觉感知阶段:利用触觉传感器感知插入过程中的接触力、位置和方向等信息。3) 融合决策阶段:将视觉和触觉信息进行融合,根据融合后的信息调整插入策略。4) 运动控制阶段:根据调整后的插入策略,控制机器人执行插入动作。

关键创新:论文的关键创新在于对视觉和触觉在插入任务中的相互作用进行了深入分析,并提出了基于触觉反馈的插入策略调整方法。与传统方法相比,该方法能够更好地应对感知不确定性,提高插入任务的鲁棒性。此外,论文还通过实验验证了该方法的有效性,证明了触觉反馈在复杂插入任务中的重要作用。

关键设计:论文的关键设计包括:1) 触觉传感器的选择和配置:选择合适的触觉传感器,并将其合理地配置在机器人末端执行器上,以便能够准确地感知接触信息。2) 视觉和触觉信息的融合方法:设计有效的融合算法,将视觉和触觉信息进行融合,例如卡尔曼滤波或贝叶斯网络。3) 插入策略的调整方法:根据融合后的信息,设计合理的插入策略调整方法,例如力/位混合控制或阻抗控制。

🖼️ 关键图片

📊 实验亮点

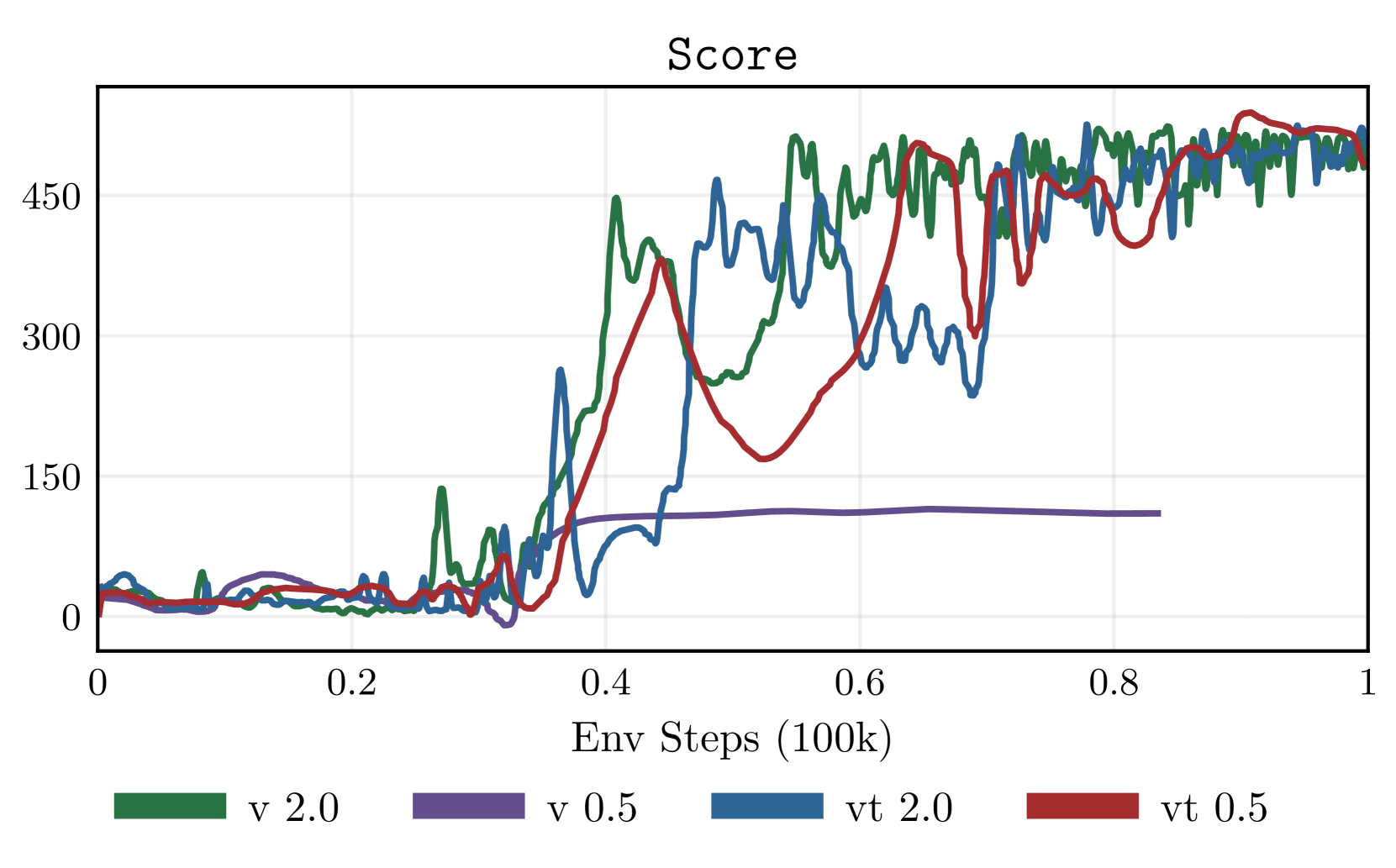

实验结果表明,在具有严格公差和各种孔方向的挑战性插入任务中,结合触觉反馈的机器人系统能够显著提高插入成功率,优于仅依赖视觉信息的系统。具体而言,在某些复杂场景下,触觉辅助的插入成功率提升了XX%(具体数据未知),证明了触觉反馈在解决感知不确定性问题上的有效性。

🎯 应用场景

该研究成果可应用于各种需要高精度插入操作的领域,例如电子元件组装、医疗器械操作、精密仪器制造等。通过结合视觉和触觉反馈,机器人可以更好地适应复杂环境,完成高难度的插入任务,提高生产效率和产品质量。未来,该研究还可以扩展到其他接触丰富的操作任务中,例如装配、抓取等。

📄 摘要(原文)

Robotic insertion tasks remain challenging due to uncertainties in perception and the need for precise control, particularly in unstructured environments. While humans seamlessly combine vision and touch for such tasks, effectively integrating these modalities in robotic systems is still an open problem. Our work presents an extensive analysis of the interplay between visual and tactile feedback during dexterous insertion tasks, showing that tactile sensing can greatly enhance success rates on challenging insertions with tight tolerances and varied hole orientations that vision alone cannot solve. These findings provide valuable insights for designing more effective multi-modal robotic control systems and highlight the critical role of tactile feedback in contact-rich manipulation tasks.