ANAVI: Audio Noise Awareness using Visuals of Indoor environments for NAVIgation

作者: Vidhi Jain, Rishi Veerapaneni, Yonatan Bisk

分类: cs.RO, cs.AI, cs.CV

发布日期: 2024-10-24

备注: 8th Conference on Robot Learning (CoRL) 2024

💡 一句话要点

提出ANAVI,利用室内视觉信息实现机器人音频噪声感知与路径规划

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱八:物理动画 (Physics-based Animation)

关键词: 机器人导航 噪声感知 视觉感知 声学建模 路径规划

📋 核心要点

- 现有机器人缺乏对自身行为产生噪声的感知能力,难以在噪声敏感环境中规划合适的路径。

- ANAVI通过训练机器人利用视觉信息预测室内环境中的噪声水平,从而实现对环境噪声的感知。

- 实验表明,配备ANAVI的机器人能够根据环境噪声约束进行路径规划,降低噪声对环境的影响。

📝 摘要(中文)

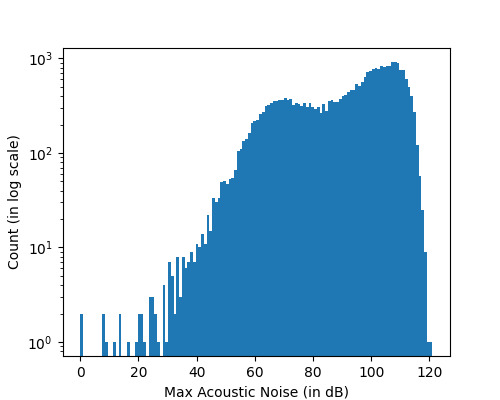

本文提出了一种名为ANAVI的方法,即利用室内环境的视觉信息来实现音频噪声感知,从而为机器人提供更安静的路径规划。人类自然地意识到自身产生的噪声及其对周围环境的影响,但目前的机器人缺乏这种意识。实现机器人音频感知的关键挑战在于如何估计机器人在某个位置的动作在听者位置产生的噪声大小。由于声音取决于房间的几何结构和材料组成,我们训练机器人通过被动地观察室内环境来感知声音强度。为此,我们生成了模拟住宅中不同听者位置的“脉冲”声音数据,并训练了我们的声学噪声预测器(ANP)。接下来,我们收集了与导航相关的不同动作的声学特征。通过将ANP与动作声学特征相结合,我们使用轮式机器人(Hello Robot Stretch)和腿式机器人(Unitree Go2)进行了实验,证明了这些机器人能够遵守环境的噪声约束。

🔬 方法详解

问题定义:现有机器人导航算法通常忽略了机器人自身行为产生的噪声对环境的影响。在医院、图书馆等噪声敏感环境中,机器人的运动噪声可能会干扰他人。因此,需要让机器人具备噪声感知能力,从而规划出更安静的路径。

核心思路:论文的核心思路是利用室内环境的视觉信息来预测声学噪声。由于声音的传播受到房间几何结构和材料的影响,因此可以通过视觉信息来推断声音的传播特性。通过训练一个声学噪声预测器(ANP),机器人可以根据视觉输入预测不同位置的噪声水平。

技术框架:ANAVI方法包含以下几个主要步骤:1) 数据生成:在模拟环境中生成不同位置的“脉冲”声音数据,并记录相应的视觉信息。2) ANP训练:使用生成的数据训练声学噪声预测器(ANP),使其能够根据视觉输入预测噪声水平。3) 动作声学特征提取:收集机器人不同动作(例如,移动、转弯)产生的声学特征。4) 路径规划:将ANP与动作声学特征相结合,规划出满足噪声约束的路径。

关键创新:ANAVI的关键创新在于利用视觉信息进行声学噪声预测。与传统的声学建模方法相比,ANAVI无需复杂的声学传感器,而是通过视觉感知来实现噪声感知。此外,ANAVI还考虑了机器人自身动作产生的噪声,从而能够更全面地评估噪声对环境的影响。

关键设计:ANP的网络结构未知,损失函数未知。动作声学特征的提取方法未知。路径规划算法的具体实现未知。论文中提到使用了模拟环境生成数据,但模拟环境的具体参数设置未知。

🖼️ 关键图片

📊 实验亮点

论文通过在轮式机器人(Hello Robot Stretch)和腿式机器人(Unitree Go2)上进行实验,验证了ANAVI的有效性。实验结果表明,配备ANAVI的机器人能够根据环境噪声约束进行路径规划,降低噪声对环境的影响。具体的性能数据未知。

🎯 应用场景

ANAVI技术可应用于各种需要噪声控制的场景,例如医院、图书馆、住宅等。它可以帮助机器人规划更安静的路径,减少对环境的干扰。此外,该技术还可以用于评估不同材料和布局对室内声学环境的影响,从而为建筑设计提供参考。

📄 摘要(原文)

We propose Audio Noise Awareness using Visuals of Indoors for NAVIgation for quieter robot path planning. While humans are naturally aware of the noise they make and its impact on those around them, robots currently lack this awareness. A key challenge in achieving audio awareness for robots is estimating how loud will the robot's actions be at a listener's location? Since sound depends upon the geometry and material composition of rooms, we train the robot to passively perceive loudness using visual observations of indoor environments. To this end, we generate data on how loud an 'impulse' sounds at different listener locations in simulated homes, and train our Acoustic Noise Predictor (ANP). Next, we collect acoustic profiles corresponding to different actions for navigation. Unifying ANP with action acoustics, we demonstrate experiments with wheeled (Hello Robot Stretch) and legged (Unitree Go2) robots so that these robots adhere to the noise constraints of the environment. See code and data at https://anavi-corl24.github.io/