GenDP: 3D Semantic Fields for Category-Level Generalizable Diffusion Policy

作者: Yixuan Wang, Guang Yin, Binghao Huang, Tarik Kelestemur, Jiuguang Wang, Yunzhu Li

分类: cs.RO, cs.CV, cs.LG

发布日期: 2024-10-23

备注: Accepted to Conference on Robot Learning (CoRL 2024). Project Page: https://robopil.github.io/GenDP/

💡 一句话要点

GenDP:利用3D语义场提升扩散策略在类别级操作任务中的泛化能力

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱二:RL算法与架构 (RL & Architecture)

关键词: 机器人操作 扩散策略 3D语义场 类别级泛化 深度学习

📋 核心要点

- 现有基于扩散的机器人策略在泛化到新物体和场景时存在困难,主要原因是缺乏对几何和语义信息的明确建模。

- GenDP通过引入3D语义场,显式地编码了场景的几何和语义信息,从而提升了扩散策略的泛化能力。

- 实验结果表明,GenDP在多个操作任务中显著提高了扩散策略的成功率,尤其是在未见过的物体实例上,成功率从20%提升到93%。

📝 摘要(中文)

基于扩散的策略在执行复杂的机器人操作任务中表现出卓越的能力,但缺乏对几何和语义的显式表征,这通常限制了它们对未见过的物体和布局的泛化能力。为了增强扩散策略的泛化能力,我们引入了一种新颖的框架,该框架通过3D语义场结合了显式的空间和语义信息。我们利用大型基础视觉模型从多视角RGBD观测中生成3D描述符场,然后将这些描述符场与参考描述符进行比较以获得语义场。所提出的方法显式地考虑了几何和语义信息,从而在需要类别级泛化的任务中实现了强大的泛化能力,解决了几何歧义,并关注了细微的几何细节。我们在八个涉及铰接物体和来自多个物体类别的具有不同形状和纹理的实例的任务中评估了我们的方法。我们的方法通过将扩散策略在未见过的实例上的平均成功率从20%提高到93%,证明了其有效性。此外,我们提供了详细的分析和可视化,以解释性能提升的来源,并解释我们的方法如何泛化到新的实例。

🔬 方法详解

问题定义:现有的基于扩散模型的机器人操作策略在处理具有类别级泛化要求的任务时,面临着几何歧义和语义理解不足的挑战。它们难以处理未见过的物体实例,导致泛化性能较差。核心痛点在于缺乏对场景几何和语义信息的有效建模,使得策略难以理解和适应新的环境。

核心思路:GenDP的核心思路是利用3D语义场显式地编码场景的几何和语义信息。通过将多视角RGBD观测转换为3D描述符场,并与参考描述符进行比较,从而获得语义场。这种方法能够让策略更好地理解场景,从而提高泛化能力。这样设计的目的是为了克服传统扩散策略对几何和语义信息理解不足的缺点。

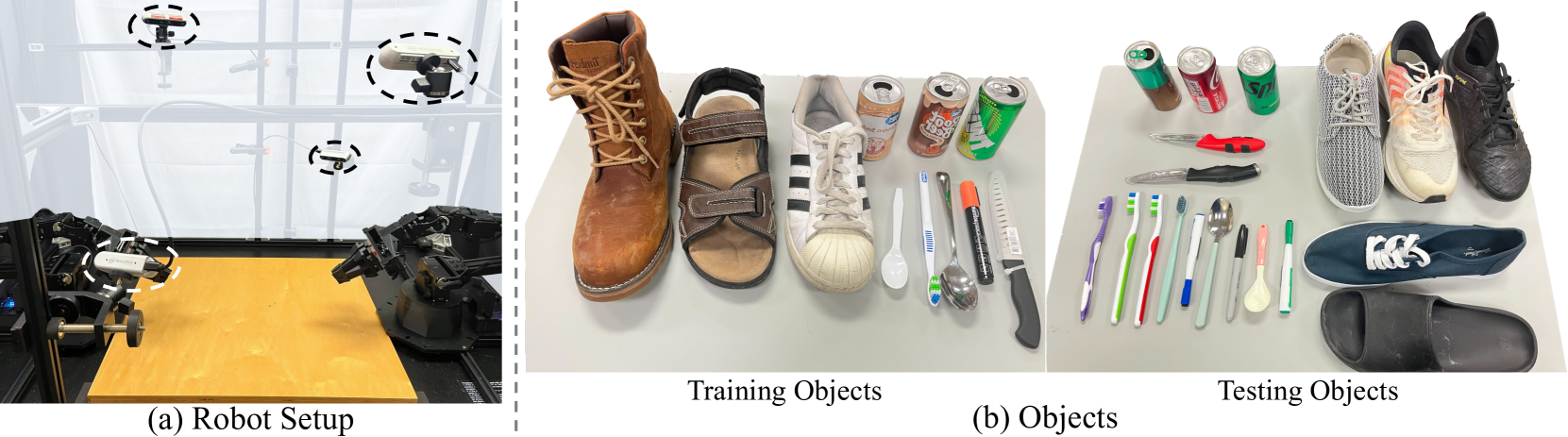

技术框架:GenDP的整体框架包括以下几个主要模块:1) 多视角RGBD观测输入;2) 利用大型基础视觉模型生成3D描述符场;3) 将描述符场与参考描述符进行比较,生成语义场;4) 将语义场作为扩散策略的输入,指导策略生成动作。整个流程旨在将视觉信息转化为可供策略理解和利用的语义信息。

关键创新:GenDP最重要的技术创新点在于引入了3D语义场,将几何和语义信息显式地编码到策略中。与现有方法相比,GenDP不再依赖于隐式的特征学习,而是直接利用3D空间中的语义信息来指导策略的学习和执行。这种显式建模的方式使得策略更容易理解和泛化到新的场景。

关键设计:GenDP的关键设计包括:1) 使用大型基础视觉模型(如CLIP)提取多视角RGBD图像的特征,生成3D描述符场;2) 定义合适的参考描述符,用于与3D描述符场进行比较,生成语义场;3) 设计合适的网络结构,将语义场作为扩散策略的输入,并优化策略的训练过程。具体的损失函数和网络结构细节在论文中有详细描述。

🖼️ 关键图片

📊 实验亮点

GenDP在八个不同的机器人操作任务中进行了评估,结果表明,GenDP能够显著提高扩散策略的泛化能力。在未见过的物体实例上,GenDP将扩散策略的平均成功率从20%提高到93%。此外,论文还提供了详细的分析和可视化,解释了GenDP如何利用3D语义场来解决几何歧义和理解语义信息,从而实现更好的泛化性能。

🎯 应用场景

GenDP具有广泛的应用前景,可以应用于各种需要机器人操作的场景,例如家庭服务机器人、工业自动化、医疗辅助机器人等。通过提高机器人对新物体和环境的泛化能力,GenDP可以降低机器人的部署成本,并使其能够更好地适应复杂和动态的环境。未来,GenDP有望成为实现通用机器人操作的关键技术之一。

📄 摘要(原文)

Diffusion-based policies have shown remarkable capability in executing complex robotic manipulation tasks but lack explicit characterization of geometry and semantics, which often limits their ability to generalize to unseen objects and layouts. To enhance the generalization capabilities of Diffusion Policy, we introduce a novel framework that incorporates explicit spatial and semantic information via 3D semantic fields. We generate 3D descriptor fields from multi-view RGBD observations with large foundational vision models, then compare these descriptor fields against reference descriptors to obtain semantic fields. The proposed method explicitly considers geometry and semantics, enabling strong generalization capabilities in tasks requiring category-level generalization, resolving geometric ambiguities, and attention to subtle geometric details. We evaluate our method across eight tasks involving articulated objects and instances with varying shapes and textures from multiple object categories. Our method demonstrates its effectiveness by increasing Diffusion Policy's average success rate on unseen instances from 20% to 93%. Additionally, we provide a detailed analysis and visualization to interpret the sources of performance gain and explain how our method can generalize to novel instances.