Guiding Reinforcement Learning with Incomplete System Dynamics

作者: Shuyuan Wang, Jingliang Duan, Nathan P. Lawrence, Philip D. Loewen, Michael G. Forbes, R. Bhushan Gopaluni, Lixian Zhang

分类: cs.RO, eess.SY

发布日期: 2024-10-22 (更新: 2024-10-24)

备注: Accepted to IROS 2024

💡 一句话要点

利用不完备系统动力学引导强化学习,提升连续控制任务的样本效率。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 强化学习 系统动力学 连续控制 样本效率 机器人

📋 核心要点

- 无模型强化学习依赖大量试错,样本效率低,泛化性差,且对奖励函数设计要求高。

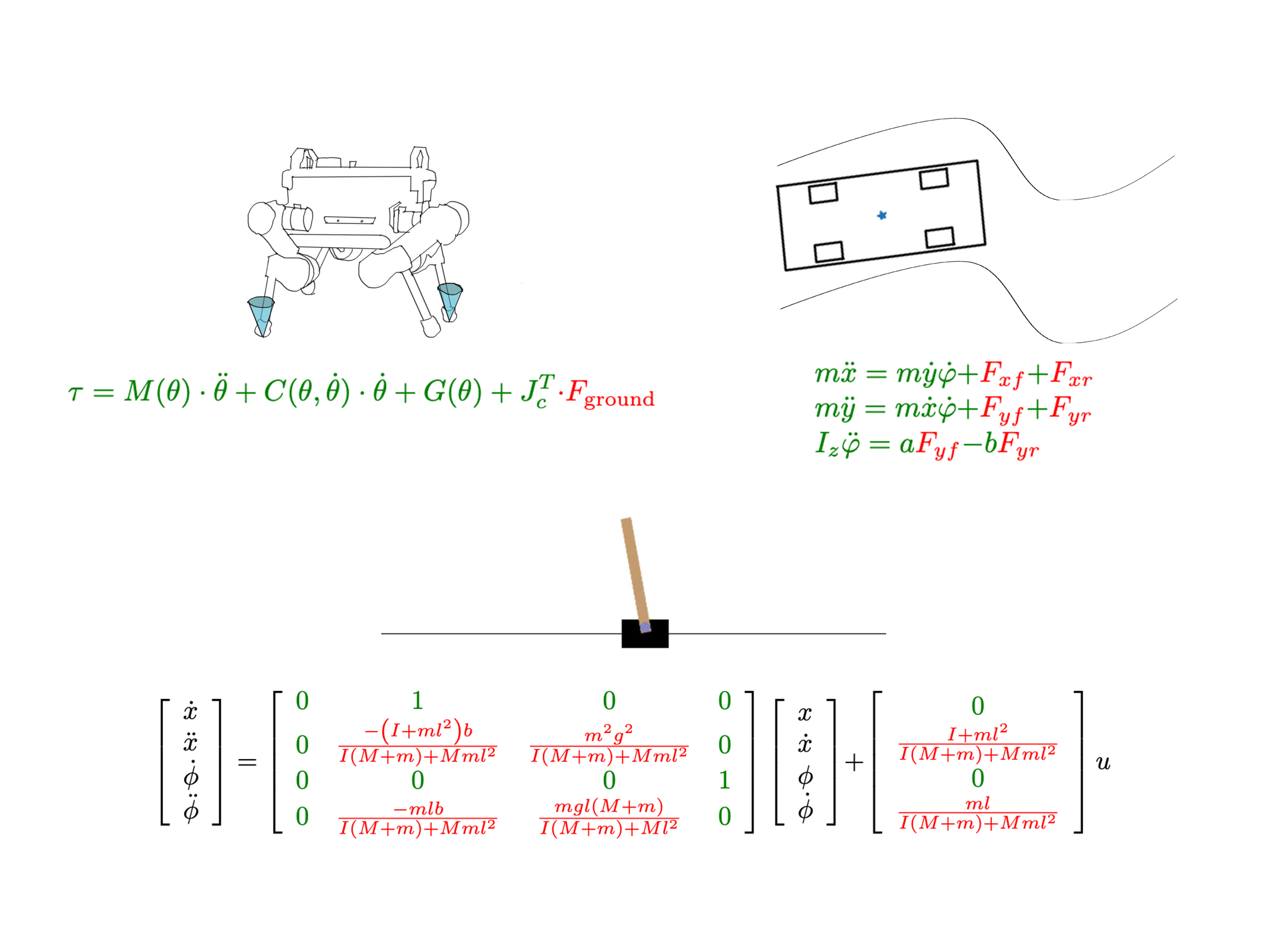

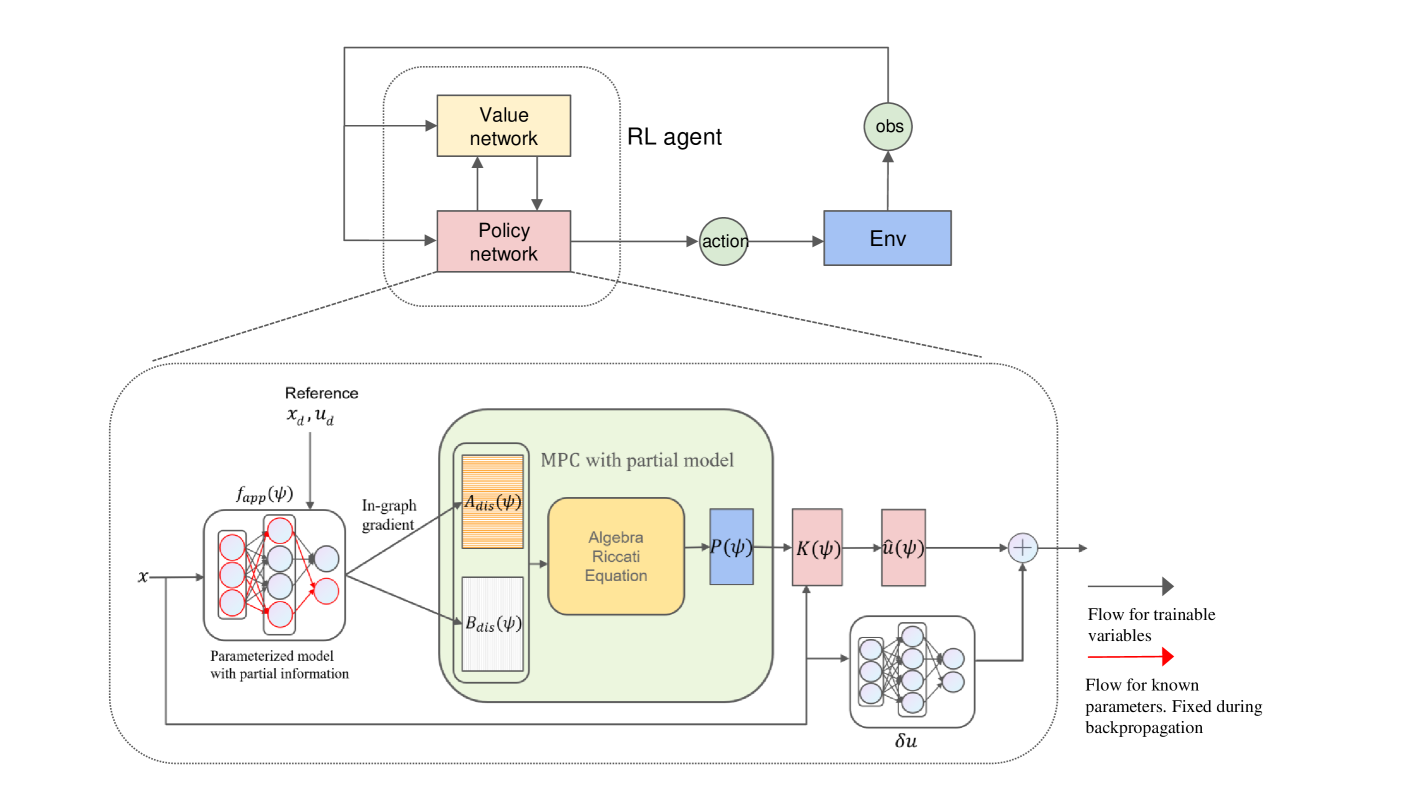

- 论文提出利用部分已知的系统动力学信息引导强化学习,解耦已知和未知信息,构建嵌入式控制器。

- 实验表明,该方法在连续控制任务中显著提升了样本效率,并在真实地面车辆上验证了泛化性和鲁棒性。

📝 摘要(中文)

本文提出了一种利用不完备系统动力学信息引导强化学习(RL)的方法。传统的无模型强化学习是一种反应式方法,完全依赖试错学习,存在样本效率低、泛化性差以及需要精心设计的奖励函数等问题。另一方面,基于完整系统动力学的控制器不需要数据。本文针对介于两者之间的情形,即模型信息不足以设计完整的控制器,但又足以表明无模型方法并非最佳选择的情况。通过解耦系统动力学中已知和未知的信息,获得一个由部分模型引导的嵌入式控制器,从而提高RL增强方法的学习效率。模块化设计允许部署主流的RL算法来优化策略。仿真结果表明,与标准RL方法相比,该方法显著提高了连续控制任务的样本效率,并且优于传统的控制方法。在真实地面车辆上的实验也验证了该方法的性能,包括泛化性和鲁棒性。

🔬 方法详解

问题定义:传统的无模型强化学习在系统动力学信息匮乏时,需要大量的试错来学习控制策略,导致样本效率低下。尤其是在连续控制任务中,探索空间巨大,学习难度更高。此外,对奖励函数的设计也十分敏感,需要精心调整才能引导智能体学习到期望的行为。现有方法要么完全依赖数据,要么完全依赖模型,缺乏有效利用部分模型信息的方法。

核心思路:论文的核心思路是将已知的系统动力学信息融入到强化学习过程中,通过构建一个由部分模型引导的嵌入式控制器,来约束和引导智能体的探索行为。这样可以减少不必要的探索,提高样本效率,并降低对奖励函数设计的依赖。核心在于解耦系统动力学中的已知和未知部分,充分利用已知信息。

技术框架:整体框架包含两个主要部分:一是基于部分系统动力学构建的嵌入式控制器,二是利用强化学习算法对该控制器进行优化和改进。首先,根据已知的系统动力学信息,设计一个初步的控制器,例如PID控制器或模型预测控制器。然后,利用强化学习算法,例如PPO或DDPG,对该控制器的参数进行优化,或者学习一个额外的策略来补偿模型的不确定性。整个过程可以看作是一个混合控制架构,其中部分模型提供先验知识,强化学习负责学习剩余的未知部分。

关键创新:该方法最重要的创新点在于将部分系统动力学信息与强化学习相结合,提出了一种新的混合控制框架。与传统的无模型强化学习相比,该方法可以显著提高样本效率,并降低对奖励函数设计的依赖。与完全依赖模型的控制方法相比,该方法可以处理系统动力学不确定性的情况,具有更强的鲁棒性。此外,模块化的设计使得可以灵活地选择不同的强化学习算法。

关键设计:论文的关键设计在于如何有效地解耦系统动力学中的已知和未知部分,并将其融入到强化学习过程中。具体来说,可以通过将系统动力学模型表示为状态转移概率的形式,然后将已知的部分作为先验知识,用于指导强化学习的探索。此外,还可以设计一个损失函数,鼓励强化学习算法学习到的策略与基于部分模型的控制器输出尽可能接近,从而提高学习的稳定性。

🖼️ 关键图片

📊 实验亮点

实验结果表明,该方法在连续控制任务中显著提高了样本效率。例如,在仿真环境中,与标准的PPO算法相比,该方法可以将学习时间缩短50%以上。在真实地面车辆上的实验也验证了该方法的泛化性和鲁棒性,即使在面对未知的环境扰动时,该车辆仍然能够稳定地行驶。

🎯 应用场景

该研究成果可应用于各种需要连续控制的机器人系统,例如自动驾驶、无人机、工业机器人等。尤其是在系统动力学模型不完全已知,或者存在不确定性的情况下,该方法可以有效地提高控制性能和鲁棒性。此外,该方法还可以用于优化传统的控制算法,例如PID控制器或模型预测控制器,使其能够适应更复杂的环境。

📄 摘要(原文)

Model-free reinforcement learning (RL) is inherently a reactive method, operating under the assumption that it starts with no prior knowledge of the system and entirely depends on trial-and-error for learning. This approach faces several challenges, such as poor sample efficiency, generalization, and the need for well-designed reward functions to guide learning effectively. On the other hand, controllers based on complete system dynamics do not require data. This paper addresses the intermediate situation where there is not enough model information for complete controller design, but there is enough to suggest that a model-free approach is not the best approach either. By carefully decoupling known and unknown information about the system dynamics, we obtain an embedded controller guided by our partial model and thus improve the learning efficiency of an RL-enhanced approach. A modular design allows us to deploy mainstream RL algorithms to refine the policy. Simulation results show that our method significantly improves sample efficiency compared with standard RL methods on continuous control tasks, and also offers enhanced performance over traditional control approaches. Experiments on a real ground vehicle also validate the performance of our method, including generalization and robustness.