Combining Ontological Knowledge and Large Language Model for User-Friendly Service Robots

作者: Haru Nakajima, Jun Miura

分类: cs.RO

发布日期: 2024-10-22

备注: Accepted to IEEE/RSJ International Conference on Intelligent Robots and Systems (IROS2024)

💡 一句话要点

结合本体知识与大语言模型,提升服务机器人用户友好性

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 服务机器人 大语言模型 本体知识 人机交互 取物任务

📋 核心要点

- 现有机器人取物任务在处理用户模糊指令时,依赖本体知识存在局限性,当出现无法解决的歧义时需要用户介入。

- 该论文提出结合大语言模型(LLM)的常识知识与本体数据,以减少用户交互,提升机器人取物任务的可用性。

- 通过集成LLM和本体知识库,构建了一个机器人取物系统,并评估了其在实际任务中的有效性,旨在提升用户体验。

📝 摘要(中文)

机器人辅助生活日益重要,人们期望机器人能承担或协助完成诸如地面清洁、餐桌布置和清理、物品取放等家务。人工智能,特别是大语言模型(LLM)和视觉语言模型(VLM)等基础模型,正在深刻地影响着这一领域。LLM通过促进自然交互和提供广泛的通用知识,被证明对机器人任务非常有价值。本文重点关注LLM在“取物”任务中的优势,即机器人根据用户模糊的指令取回特定物品。我们之前的研究利用扩展的本体来处理环境数据以消除这种模糊性,但当无法解决的歧义需要用户干预时,会面临局限性。本文通过集成LLM以提供额外的常识知识来增强我们的方法,并将其与本体数据配对,以减轻幻觉问题并减少用户查询的需求,从而提高系统的可用性。我们提出了一个合并这些知识库的系统,并评估其在“取物”任务中的有效性,旨在提供更无缝和高效的机器人辅助体验。

🔬 方法详解

问题定义:论文旨在解决服务机器人在“取物”任务中,由于用户指令模糊不清,导致机器人无法准确理解用户意图的问题。现有方法主要依赖本体知识进行推理,但当本体知识不足以消除歧义时,需要频繁地向用户提问,影响了用户体验和任务效率。现有方法的痛点在于缺乏常识推理能力,无法处理超出本体知识范围的模糊指令。

核心思路:论文的核心思路是将大语言模型(LLM)的常识知识融入到机器人系统中,与本体知识相结合,从而增强机器人对用户模糊指令的理解能力。LLM可以提供更广泛的背景知识和推理能力,帮助机器人消除歧义,减少对用户交互的依赖。这种结合利用了LLM的泛化能力和本体知识的精确性,旨在实现更鲁棒和用户友好的机器人系统。

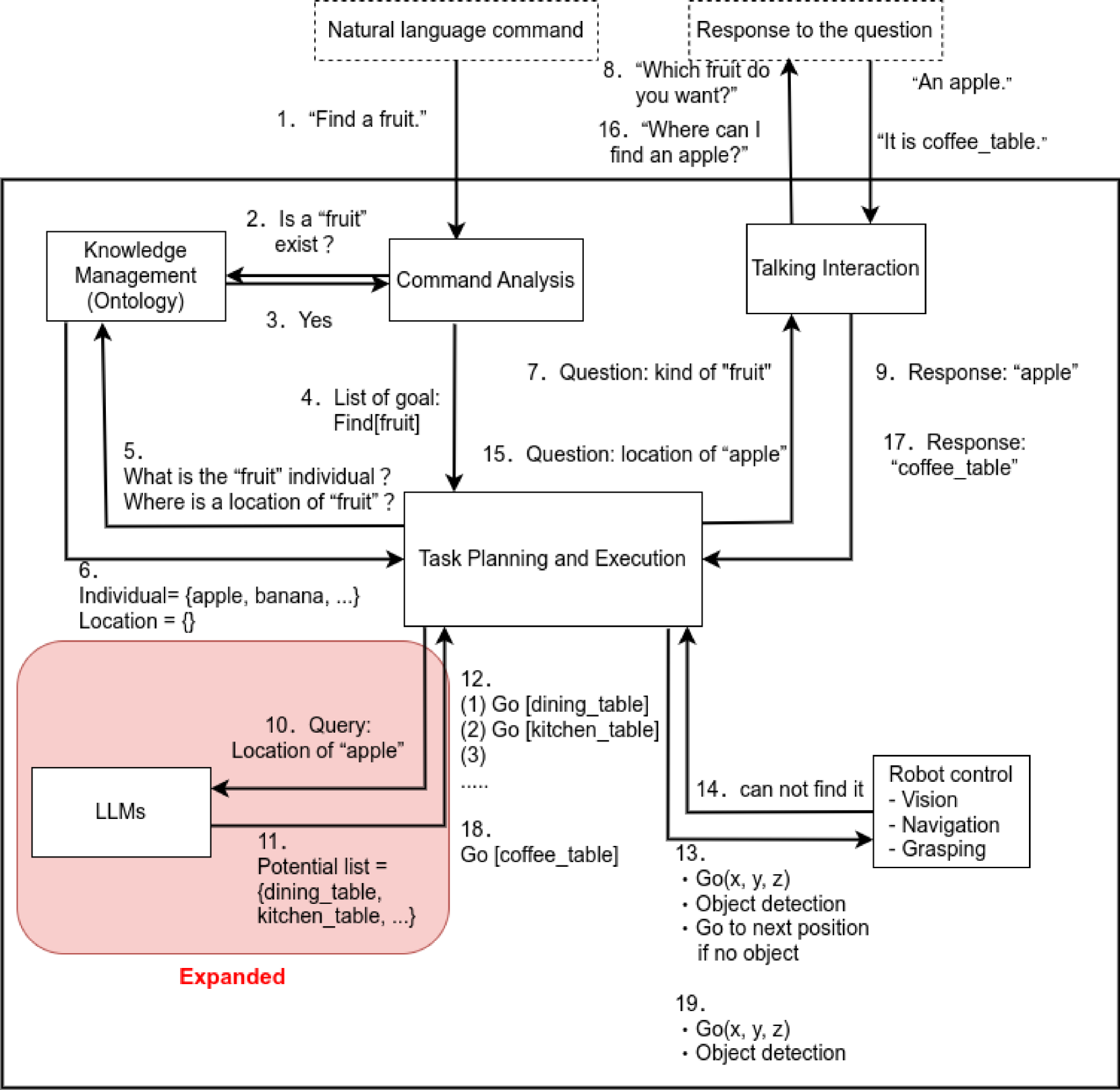

技术框架:该系统包含以下主要模块:1) 用户指令接收模块,负责接收用户的自然语言指令;2) 本体知识库,存储环境和物品的结构化知识;3) 大语言模型(LLM),提供常识知识和推理能力;4) 指令解析模块,结合本体知识和LLM的输出,解析用户指令,确定目标物品;5) 机器人控制模块,控制机器人执行取物任务。整体流程是:用户输入指令 -> 指令解析模块结合本体知识和LLM进行解析 -> 机器人控制模块执行取物任务。

关键创新:该论文最重要的技术创新点在于将LLM的常识知识与本体知识相结合,用于解决机器人取物任务中的模糊指令问题。与现有方法相比,该方法能够利用LLM的泛化能力,处理超出本体知识范围的指令,从而减少用户交互,提升系统可用性。本质区别在于引入了LLM作为知识来源,弥补了传统本体知识的不足。

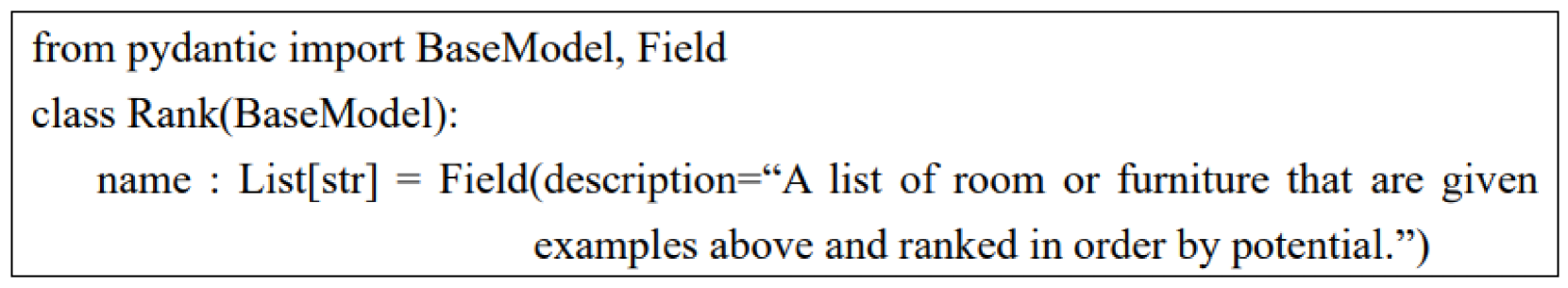

关键设计:论文中没有明确给出关键的参数设置、损失函数、网络结构等技术细节。但是,可以推断,LLM的选择和prompt的设计是关键。如何有效地利用LLM的知识,避免幻觉问题,以及如何将LLM的输出与本体知识进行融合,是需要仔细考虑的设计细节。此外,如何评估LLM的输出质量,并根据评估结果调整LLM的prompt,也是一个重要的设计方向。

🖼️ 关键图片

📊 实验亮点

论文重点在于方法论的提出和系统框架的搭建,实验结果的具体性能数据未知。亮点在于结合了本体知识和LLM,旨在减少用户交互,提升系统可用性。未来的实验可以对比该方法与仅使用本体知识或仅使用LLM的方法,量化评估LLM的加入带来的性能提升,例如成功率、任务完成时间、用户交互次数等。

🎯 应用场景

该研究成果可应用于家庭服务机器人、医疗辅助机器人、仓储物流机器人等领域。通过提升机器人对用户指令的理解能力,可以实现更智能、更便捷的机器人服务,提高工作效率和用户满意度。未来,该技术有望进一步扩展到更复杂的机器人任务中,例如人机协作、智能家居等。

📄 摘要(原文)

Lifestyle support through robotics is an increasingly promising field, with expectations for robots to take over or assist with chores like floor cleaning, table setting and clearing, and fetching items. The growth of AI, particularly foundation models, such as large language models (LLMs) and visual language models (VLMs), is significantly shaping this sector. LLMs, by facilitating natural interactions and providing vast general knowledge, are proving invaluable for robotic tasks. This paper zeroes in on the benefits of LLMs for "bring-me" tasks, where robots fetch specific items for users, often based on vague instructions. Our previous efforts utilized an ontology extended to handle environmental data to decipher such vagueness, but faced limitations when unresolvable ambiguities required user intervention for clarity. Here, we enhance our approach by integrating LLMs for providing additional commonsense knowledge, pairing it with ontological data to mitigate the issue of hallucinations and reduce the need for user queries, thus improving system usability. We present a system that merges these knowledge bases and assess its efficacy on "bring-me" tasks, aiming to provide a more seamless and efficient robotic assistance experience.