DiffusionSeeder: Seeding Motion Optimization with Diffusion for Rapid Motion Planning

作者: Huang Huang, Balakumar Sundaralingam, Arsalan Mousavian, Adithyavairavan Murali, Ken Goldberg, Dieter Fox

分类: cs.RO

发布日期: 2024-10-22

💡 一句话要点

DiffusionSeeder:利用扩散模型优化运动规划种子,加速机器人运动规划。

🎯 匹配领域: 支柱一:机器人控制 (Robot Control)

关键词: 机器人运动规划 扩散模型 运动优化 深度学习 sim2real 轨迹生成 GPU加速

📋 核心要点

- 现有基于GPU加速的运动优化方法在复杂环境中易陷入局部最小值,依赖图搜索算法生成种子轨迹导致速度下降。

- DiffusionSeeder利用扩散模型生成高质量、多模态的轨迹作为运动优化的种子,提升规划速度和成功率。

- 实验表明,DiffusionSeeder在模拟和真实机器人上均显著提升了运动规划的速度和成功率,展现了良好的sim2real迁移能力。

📝 摘要(中文)

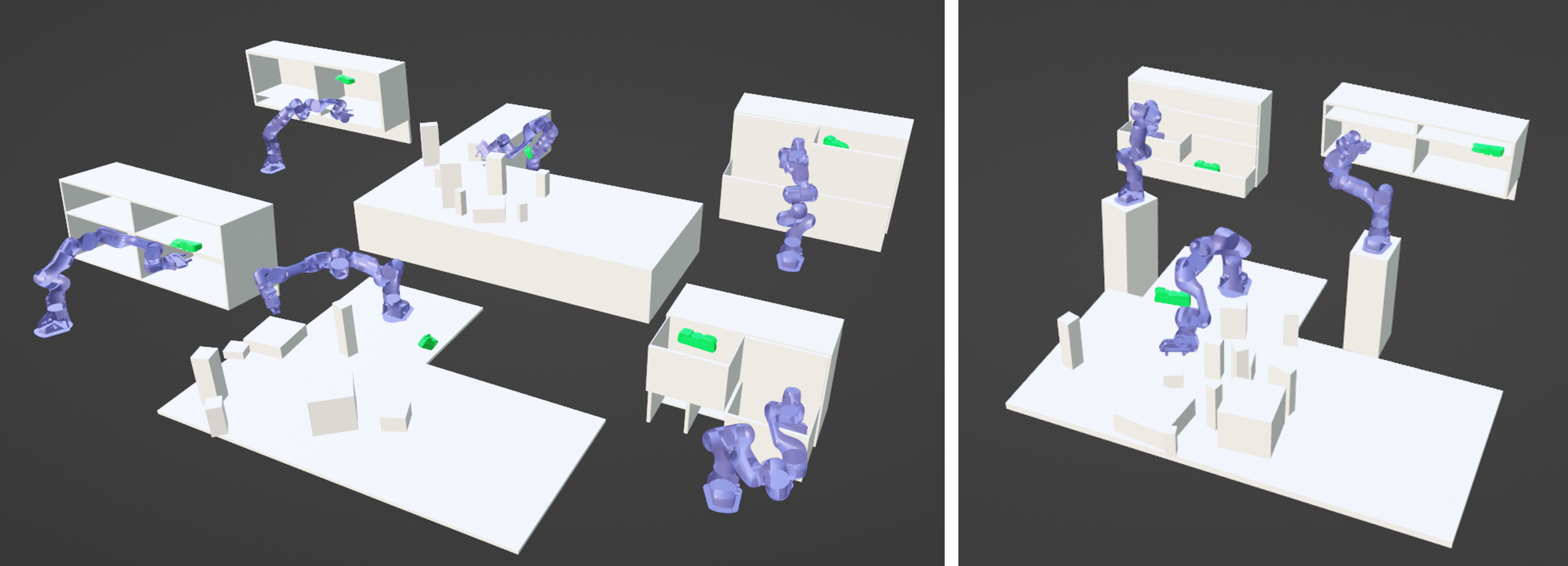

本研究提出DiffusionSeeder,一种基于扩散模型的方法,用于生成高质量的轨迹,以作为运动优化的种子,从而加速机器人运动规划。DiffusionSeeder以场景的初始深度图像观测为输入,生成多模态的轨迹,然后通过少量迭代的运动优化进行微调。我们将DiffusionSeeder集成到GPU加速的运动优化方法cuRobo中,在部分可观测的模拟环境中,平均提速12倍,对于更复杂的问题提速36倍,同时成功率提高10%。结果表明,使用来自学习的扩散模型的多样化解决方案是有效的。在Franka机器人上的物理实验证明了DiffusionSeeder到真实机器人的sim2real迁移能力,平均成功率为86%,规划时间为26ms,相比cuRobo,成功率提高了51%,速度提高了2.5倍。

🔬 方法详解

问题定义:论文旨在解决机器人运动规划中,在复杂、障碍物密集的环境中,运动优化方法容易陷入局部最小值,而传统的图搜索算法生成种子轨迹速度慢的问题。现有方法在简单场景下收敛快,但在复杂场景下表现不佳,需要更好的初始化方法。

核心思路:论文的核心思路是利用扩散模型生成高质量、多样化的轨迹,作为运动优化的初始种子。扩散模型能够学习到复杂环境下的运动模式,从而生成更接近最优解的轨迹,避免优化过程陷入局部最小值。这样可以减少对图搜索算法的依赖,提高规划速度。

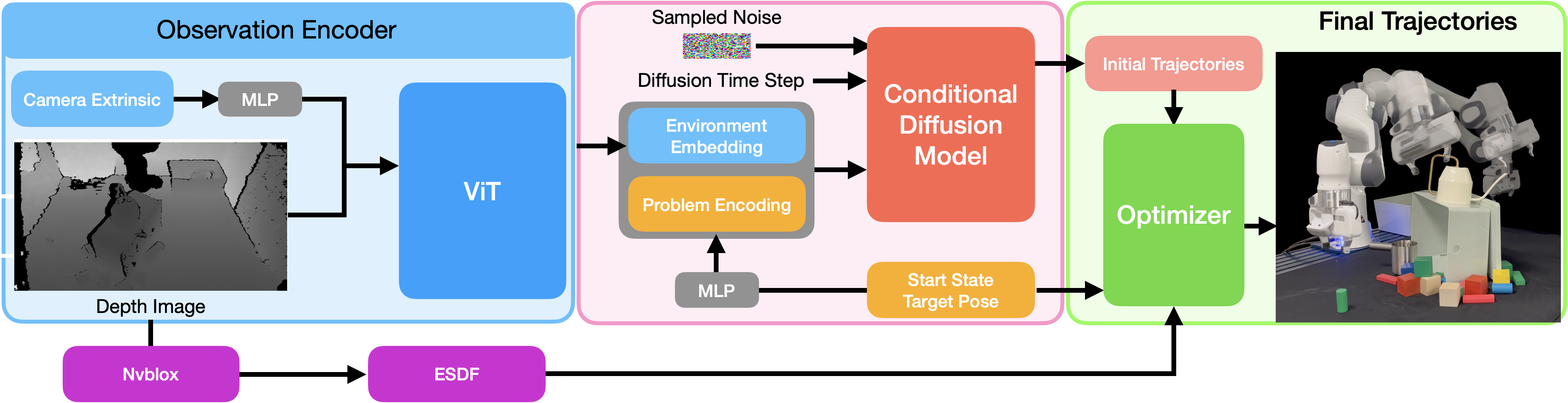

技术框架:DiffusionSeeder的整体框架包括以下几个阶段:1) 输入:获取场景的初始深度图像观测。2) 扩散模型:使用训练好的扩散模型,基于深度图像生成多条候选轨迹。3) 运动优化:使用cuRobo等运动优化方法,对扩散模型生成的轨迹进行微调,得到最终的运动规划结果。

关键创新:最重要的技术创新点是利用扩散模型生成运动规划的种子轨迹。与传统的随机采样或图搜索方法相比,扩散模型能够学习到环境的先验知识,生成更智能、更有效的初始轨迹。这使得运动优化过程能够更快地收敛到全局最优解。

关键设计:论文中没有详细描述扩散模型的具体网络结构和训练细节,但提到使用深度图像作为输入,生成多模态的轨迹。关键设计可能包括:1) 扩散模型的架构选择(例如,U-Net)。2) 损失函数的设计,可能包括轨迹平滑性、避障等约束。3) 如何生成多样化的轨迹,例如,通过控制扩散过程中的噪声。

🖼️ 关键图片

📊 实验亮点

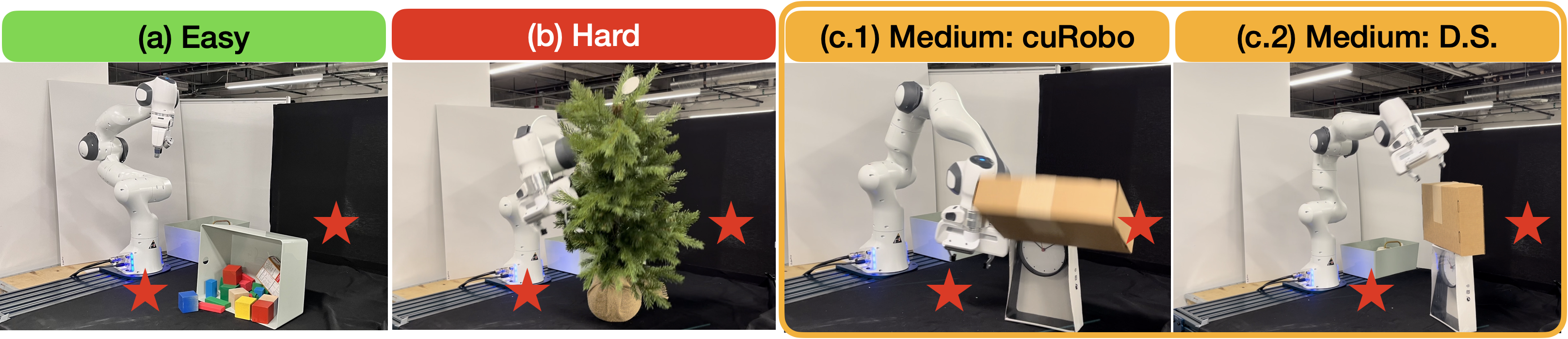

实验结果表明,DiffusionSeeder在模拟环境中,与cuRobo相比,平均提速12倍,对于更复杂的问题提速36倍,同时成功率提高10%。在真实Franka机器人上的实验中,DiffusionSeeder的平均成功率为86%,规划时间为26ms,相比cuRobo,成功率提高了51%,速度提高了2.5倍。这些数据表明DiffusionSeeder在速度和成功率方面均显著优于现有方法。

🎯 应用场景

DiffusionSeeder在机器人操作、自动驾驶、游戏AI等领域具有广泛的应用前景。它可以用于解决复杂环境下的机器人抓取、装配、导航等问题,提高机器人的自主性和适应性。该方法还可以应用于虚拟环境中的角色动画生成,提升游戏体验。未来,DiffusionSeeder有望成为机器人运动规划领域的重要组成部分。

📄 摘要(原文)

Running optimization across many parallel seeds leveraging GPU compute have relaxed the need for a good initialization, but this can fail if the problem is highly non-convex as all seeds could get stuck in local minima. One such setting is collision-free motion optimization for robot manipulation, where optimization converges quickly on easy problems but struggle in obstacle dense environments (e.g., a cluttered cabinet or table). In these situations, graph-based planning algorithms are used to obtain seeds, resulting in significant slowdowns. We propose DiffusionSeeder, a diffusion based approach that generates trajectories to seed motion optimization for rapid robot motion planning. DiffusionSeeder takes the initial depth image observation of the scene and generates high quality, multi-modal trajectories that are then fine-tuned with a few iterations of motion optimization. We integrate DiffusionSeeder to generate the seed trajectories for cuRobo, a GPU-accelerated motion optimization method, which results in 12x speed up on average, and 36x speed up for more complicated problems, while achieving 10% higher success rate in partially observed simulation environments. Our results show the effectiveness of using diverse solutions from a learned diffusion model. Physical experiments on a Franka robot demonstrate the sim2real transfer of DiffusionSeeder to the real robot, with an average success rate of 86% and planning time of 26ms, improving on cuRobo by 51% higher success rate while also being 2.5x faster.