Task-oriented Robotic Manipulation with Vision Language Models

作者: Nurhan Bulus Guran, Hanchi Ren, Jingjing Deng, Xianghua Xie

分类: cs.RO

发布日期: 2024-10-21 (更新: 2025-05-20)

💡 一句话要点

提出一种结合视觉语言模型与空间推理的机器人操作框架,提升任务导向操作性能。

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱七:动作重定向 (Motion Retargeting) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 机器人操作 视觉语言模型 空间推理 大型语言模型 任务导向 场景理解 树状结构

📋 核心要点

- 现有机器人操作方法在准确理解空间关系方面存在挑战,限制了其在复杂任务中的应用。

- 该方法将视觉场景转化为树状结构,利用大型语言模型进行空间推理,从而指导机器人操作。

- 实验表明,该方法提高了机器人对空间关系的理解和交互效率,增强了任务导向操作能力。

📝 摘要(中文)

本文提出了一种新颖的框架,该框架集成了视觉语言模型(VLM)和一个结构化的空间推理流程,以执行基于高级、任务导向输入的物体操作。该方法将视觉场景转换为编码空间关系的树状结构表示。然后,大型语言模型(LLM)处理这些树,以推断重构的配置,从而确定如何为给定的高级任务组织这些对象。为了支持该框架,本文还提出了一个新的数据集,其中包含手动标注的描述对象之间空间关系的文本,以及对象级别的属性标注,例如脆性、质量、材料和透明度。实验结果表明,该方法不仅提高了对视觉环境中对象之间空间关系的理解,而且使机器人能够更有效地与这些对象交互。因此,该方法显著增强了机器人操作任务中的空间推理能力。据我们所知,这是文献中第一个此类方法,提供了一种新颖的解决方案,使机器人能够更有效地组织和利用周围环境中的对象。

🔬 方法详解

问题定义:论文旨在解决机器人操作中空间关系理解不足的问题。现有方法难以准确理解和利用物体间的空间关系,导致在复杂操作任务中表现不佳。痛点在于缺乏有效的空间推理机制,无法将视觉信息转化为可执行的操作指令。

核心思路:论文的核心思路是将视觉场景转化为结构化的空间关系表示(树状结构),然后利用大型语言模型(LLM)进行推理,从而获得重构的物体配置方案。这种方法将视觉感知与语言理解相结合,使机器人能够理解任务目标并规划操作步骤。

技术框架:整体框架包含以下几个主要模块:1) 视觉场景理解模块:利用视觉语言模型提取场景中的物体信息和空间关系。2) 空间关系树构建模块:将提取的信息转化为树状结构,节点表示物体,边表示空间关系。3) 大型语言模型推理模块:利用LLM对空间关系树进行推理,生成重构的物体配置方案。4) 机器人操作执行模块:根据LLM的推理结果,控制机器人执行相应的操作。

关键创新:最重要的创新点在于将视觉语言模型与结构化的空间推理流程相结合。通过将视觉场景转化为树状结构,并利用LLM进行推理,该方法能够更有效地理解和利用物体间的空间关系。与现有方法相比,该方法具有更强的空间推理能力和任务导向性。

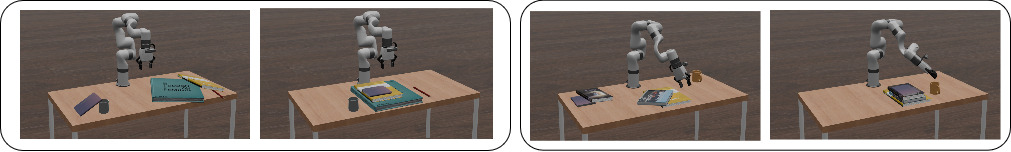

关键设计:论文提出了一个新的数据集,用于训练和评估该框架。该数据集包含手动标注的描述对象之间空间关系的文本,以及对象级别的属性标注。此外,论文还设计了一种特定的树状结构来表示空间关系,并针对机器人操作任务对LLM进行了微调。具体的参数设置、损失函数和网络结构等技术细节在论文中进行了详细描述。

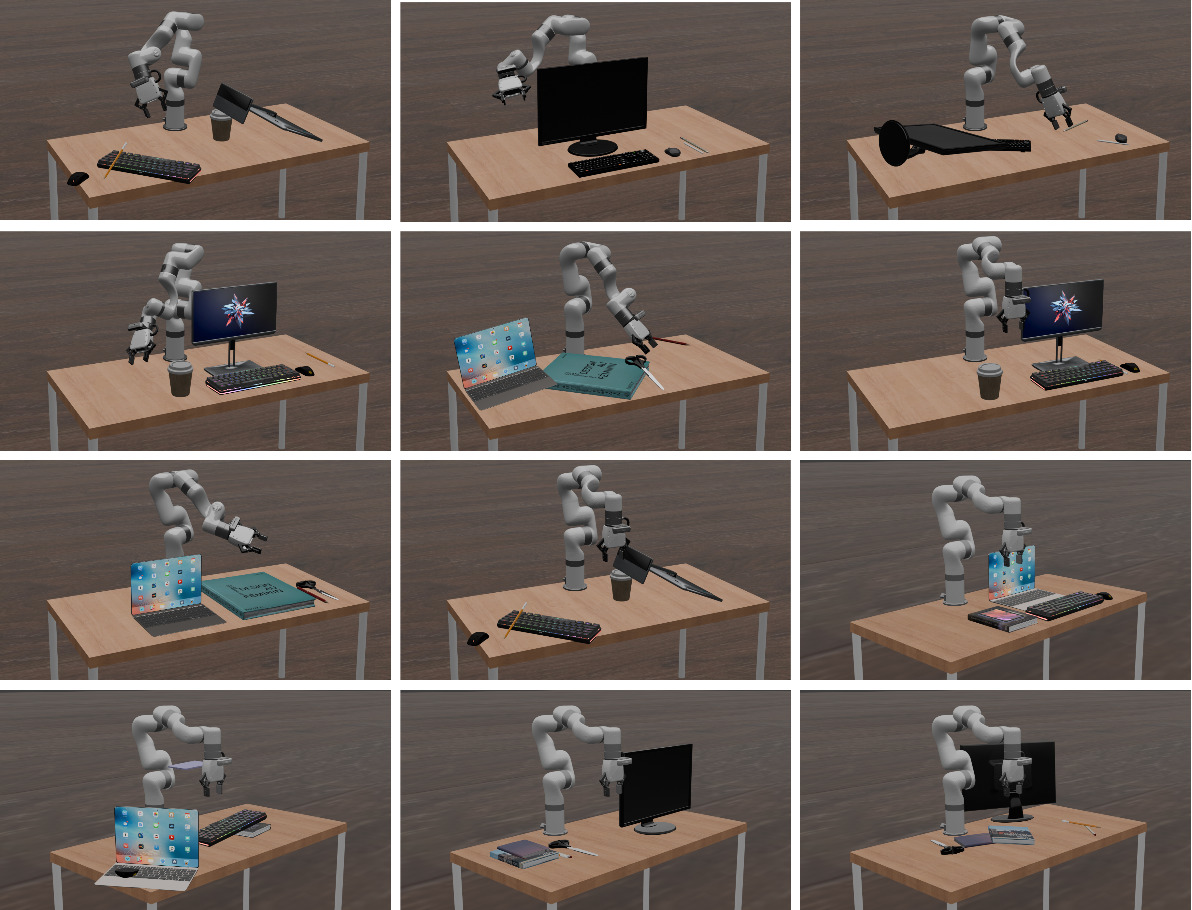

🖼️ 关键图片

📊 实验亮点

论文提出了一个新的数据集,包含手动标注的空间关系描述和物体属性。实验结果表明,该方法在空间关系理解和机器人操作任务中取得了显著的提升,证明了该框架的有效性。具体的性能数据和对比基线在论文中进行了详细展示,量化了该方法的优越性。

🎯 应用场景

该研究成果可应用于各种需要机器人进行复杂操作的场景,例如智能仓储、自动化装配、家庭服务机器人等。通过提升机器人对空间关系的理解和操作能力,可以实现更高效、更智能的自动化生产和服务,具有广阔的应用前景和实际价值。未来,该技术有望进一步发展,实现更高级别的任务规划和自主操作。

📄 摘要(原文)

Vision Language Models (VLMs) play a crucial role in robotic manipulation by enabling robots to understand and interpret the visual properties of objects and their surroundings, allowing them to perform manipulation based on this multimodal understanding. Accurately understanding spatial relationships remains a non-trivial challenge, yet it is essential for effective robotic manipulation. In this work, we introduce a novel framework that integrates VLMs with a structured spatial reasoning pipeline to perform object manipulation based on high-level, task-oriented input. Our approach is the transformation of visual scenes into tree-structured representations that encode the spatial relations. These trees are subsequently processed by a Large Language Model (LLM) to infer restructured configurations that determine how these objects should be organised for a given high-level task. To support our framework, we also present a new dataset containing manually annotated captions that describe spatial relations among objects, along with object-level attribute annotations such as fragility, mass, material, and transparency. We demonstrate that our method not only improves the comprehension of spatial relationships among objects in the visual environment but also enables robots to interact with these objects more effectively. As a result, this approach significantly enhances spatial reasoning in robotic manipulation tasks. To our knowledge, this is the first method of its kind in the literature, offering a novel solution that allows robots to more efficiently organize and utilize objects in their surroundings.