Visual Manipulation with Legs

作者: Xialin He, Chengjing Yuan, Wenxuan Zhou, Ruihan Yang, David Held, Xiaolong Wang

分类: cs.RO

发布日期: 2024-10-15 (更新: 2024-10-24)

备注: More details can be found on our project page: https://legged-manipulation.github.io/

💡 一句话要点

提出基于视觉的四足机器人腿部操作系统,实现非抓取操作

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱二:RL算法与架构 (RL & Architecture)

关键词: 四足机器人 腿部操作 非抓取操作 强化学习 模型预测控制

📋 核心要点

- 现有四足机器人操作能力有限,通常依赖于末端执行器,缺乏动物利用四肢进行移动和操作的灵活性。

- 该研究提出一种视觉操作策略,结合强化学习和模型预测控制,使四足机器人能够利用腿部进行非抓取操作,实现物体操作。

- 实验结果表明,该系统在物体姿态对齐任务中表现出色,验证了其在模拟和真实环境中进行腿部操作的有效性和通用性。

📝 摘要(中文)

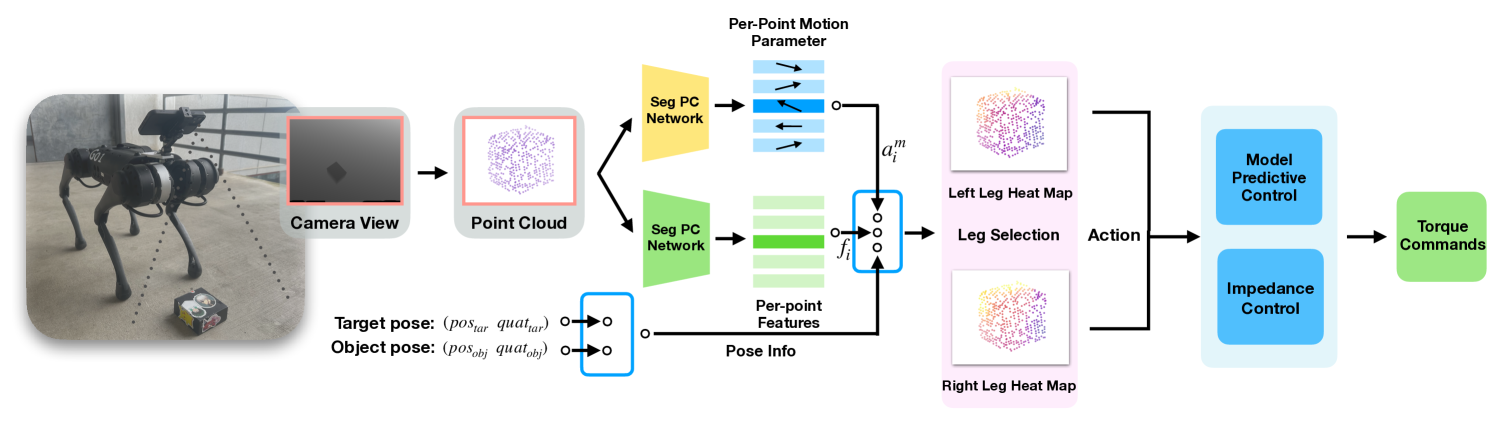

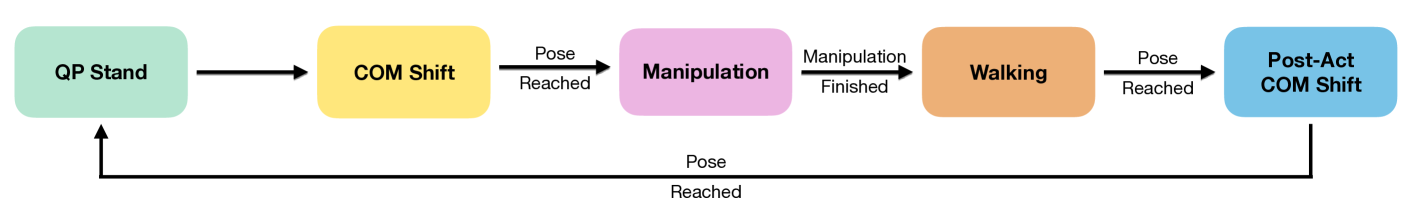

本文提出了一种使四足机器人能够像动物一样使用腿进行移动和操作的系统。该系统受到非抓取操作的启发,使四足机器人能够使用腿与物体交互。系统包含两个主要模块:视觉操作策略模块和loco-manipulator模块。视觉操作策略通过强化学习(RL)训练,使用点云观测和以物体为中心的动作来决定腿应如何与物体交互。Loco-manipulator控制器基于阻抗控制和模型预测控制(MPC)管理腿部运动和身体姿势调整。除了使用单条腿操作物体外,系统还可以根据critic maps选择左腿或右腿,并通过底座调整将物体移动到远处的目标。实验在模拟和真实环境中评估了该系统在物体姿态对齐任务上的性能,证明了腿部操作比以前的工作更加通用。

🔬 方法详解

问题定义:现有四足机器人通常依赖于末端执行器进行操作,这限制了它们的灵活性和操作范围。如何使四足机器人像动物一样,利用腿部进行更灵活、通用的物体操作,是一个重要的研究问题。现有方法在复杂环境下的鲁棒性和泛化能力不足,难以适应真实世界的挑战。

核心思路:本文的核心思路是模仿动物利用四肢进行移动和操作的方式,设计一个基于视觉的四足机器人腿部操作系统。该系统通过强化学习训练视觉操作策略,使机器人能够根据环境感知和任务目标,自主选择合适的腿部动作与物体交互。同时,结合模型预测控制,实现腿部运动和身体姿势的协调控制,从而完成复杂的物体操作任务。

技术框架:该系统主要包含两个模块:视觉操作策略模块和loco-manipulator模块。视觉操作策略模块负责根据点云观测信息,通过强化学习生成以物体为中心的腿部动作。Loco-manipulator模块则基于阻抗控制和模型预测控制,将高层动作指令转化为具体的腿部运动和身体姿势调整。此外,系统还包含一个critic map,用于评估不同腿部动作的优劣,从而选择最佳的腿部进行操作。整个流程包括感知、决策和控制三个阶段,形成一个闭环控制系统。

关键创新:该研究的关键创新在于将视觉操作策略与loco-manipulator控制相结合,实现了四足机器人腿部的非抓取操作。与传统的末端执行器操作相比,腿部操作具有更大的灵活性和适应性,能够处理更复杂的物体操作任务。此外,该研究还提出了基于critic map的腿部选择机制,进一步提高了系统的操作效率和鲁棒性。

关键设计:视觉操作策略模块采用深度强化学习算法进行训练,奖励函数的设计至关重要,需要综合考虑任务目标、动作代价和稳定性等因素。Loco-manipulator模块采用模型预测控制,需要精确建模机器人的动力学模型,并进行实时优化。Critic map的设计需要充分考虑环境感知和任务需求,选择合适的特征进行评估。具体的网络结构、参数设置和优化算法等细节,需要根据具体任务进行调整和优化。

🖼️ 关键图片

📊 实验亮点

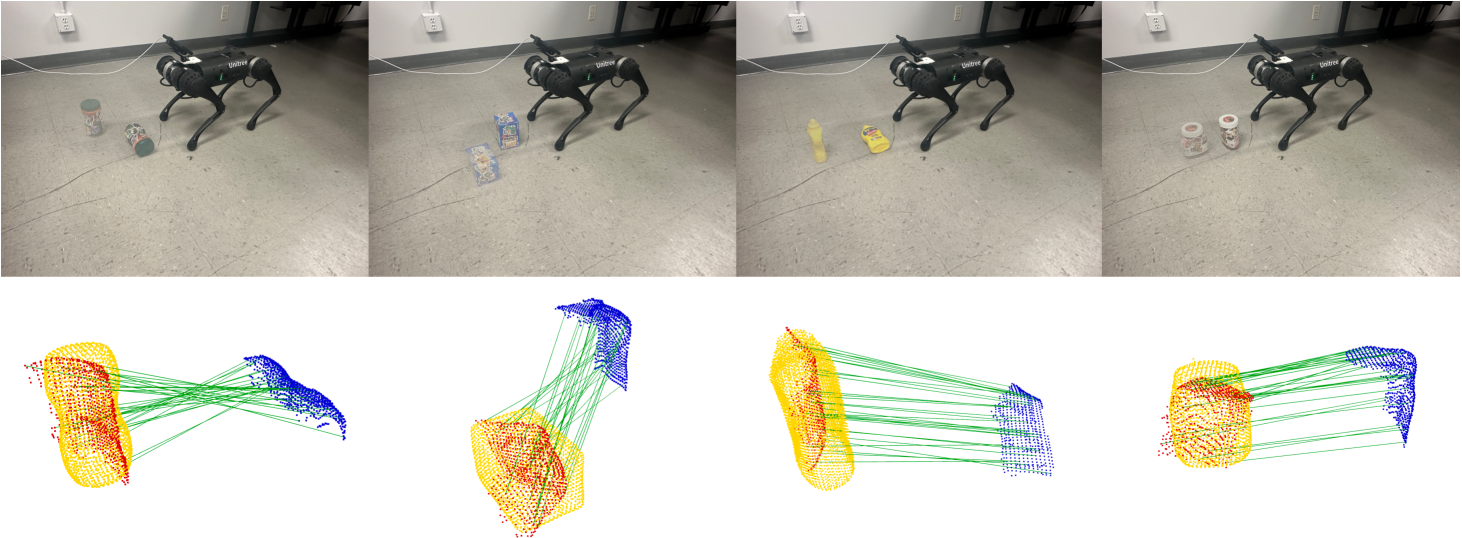

实验结果表明,该系统在物体姿态对齐任务中取得了显著的成果。在模拟环境中,该系统能够成功地将物体调整到目标姿态,并且具有较强的鲁棒性。在真实环境中,该系统也能够有效地进行腿部操作,并且能够适应不同的物体和环境。与之前的研究相比,该系统在操作的灵活性和通用性方面都有了显著的提升。

🎯 应用场景

该研究成果可应用于物流、仓储、家庭服务等领域。例如,四足机器人可以利用腿部操作,在复杂环境中搬运货物、整理物品,甚至进行精细的家庭服务。此外,该技术还可以应用于灾难救援、野外勘探等场景,使机器人能够在恶劣环境下执行任务,提高工作效率和安全性。未来,随着技术的不断发展,四足机器人腿部操作将会在更多领域发挥重要作用。

📄 摘要(原文)

Animals use limbs for both locomotion and manipulation. We aim to equip quadruped robots with similar versatility. This work introduces a system that enables quadruped robots to interact with objects using their legs, inspired by non-prehensile manipulation. The system has two main components: a visual manipulation policy module and a loco-manipulator module. The visual manipulation policy, trained with reinforcement learning (RL) using point cloud observations and object-centric actions, decides how the leg should interact with the object. The loco-manipulator controller manages leg movements and body pose adjustments, based on impedance control and Model Predictive Control (MPC). Besides manipulating objects with a single leg, the system can select from the left or right leg based on critic maps and move objects to distant goals through base adjustment. Experiments evaluate the system on object pose alignment tasks in both simulation and the real world, demonstrating more versatile object manipulation skills with legs than previous work. Videos can be found at https://legged-manipulation.github.io/